待写

LLaMA模型

论文原文:https://arxiv.org/abs/2302.13971v1

预训练数据

模型架构

模型就是用的transformer的decoder,所以在结构上它与GPT是非常类似的,只是有一些细节需要注意一下。

1、RMS Pre-Norm

2、SwiGLU激活函数

3、RoPE旋转位置编码

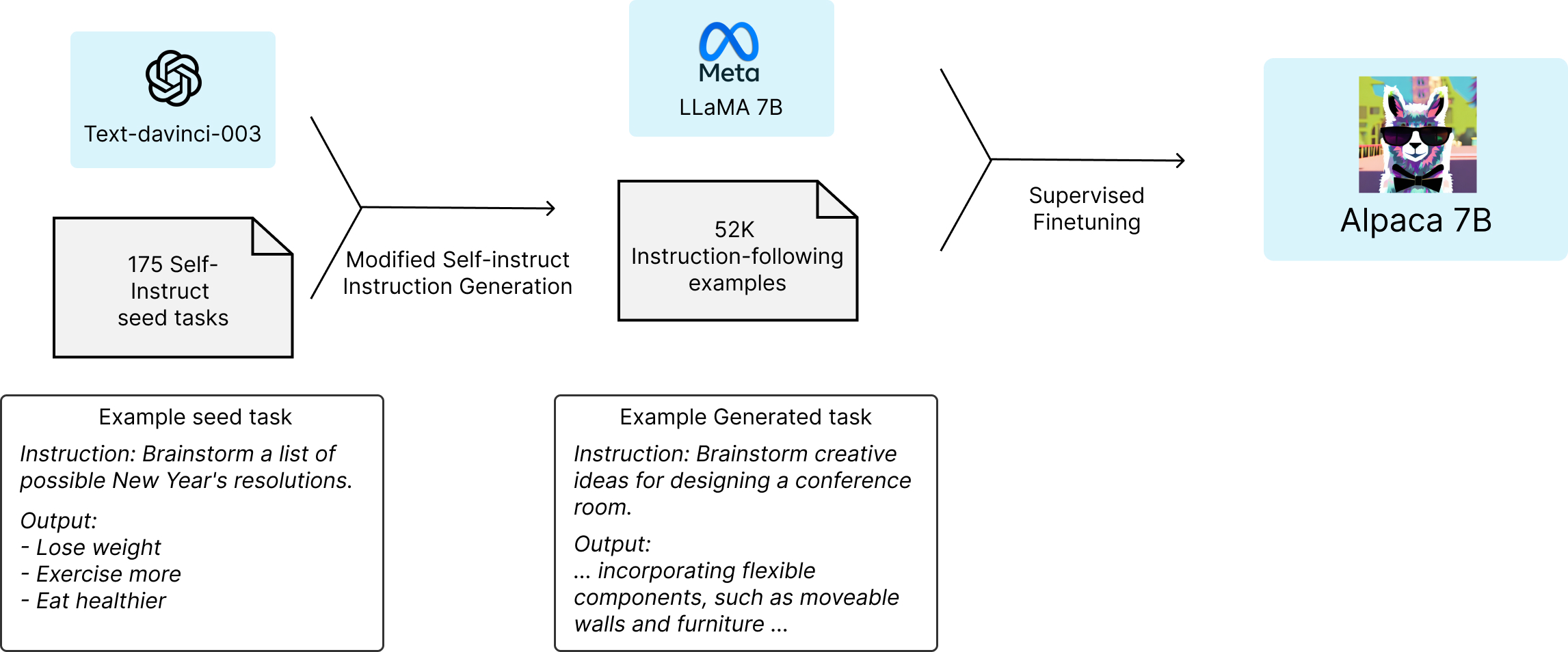

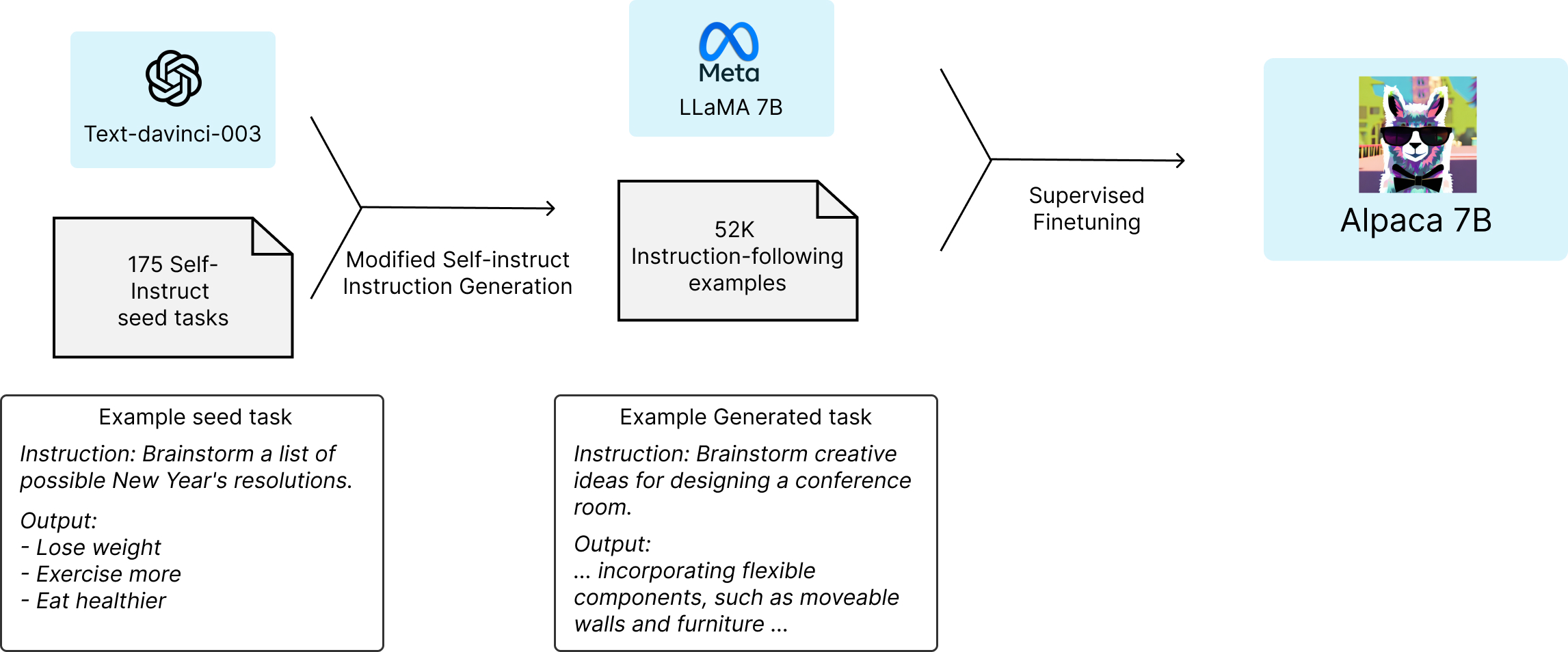

Alpaca模型

[Stanford CRFM]

中文聊天aipaca

GitHub - ymcui/Chinese-LLaMA-Alpaca

待写

论文原文:https://arxiv.org/abs/2302.13971v1

预训练数据

模型架构

模型就是用的transformer的decoder,所以在结构上它与GPT是非常类似的,只是有一些细节需要注意一下。

1、RMS Pre-Norm

2、SwiGLU激活函数

3、RoPE旋转位置编码

[Stanford CRFM]

GitHub - ymcui/Chinese-LLaMA-Alpaca

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/593391.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!