PyTorch学习笔记:nn.ReLU——ReLU激活函数

torch.nn.ReLU(inplace=False)

功能:逐元素应用ReLU函数对数据进行激活

函数方程:

R

e

L

U

(

x

)

=

(

x

)

+

=

max

(

0

,

x

)

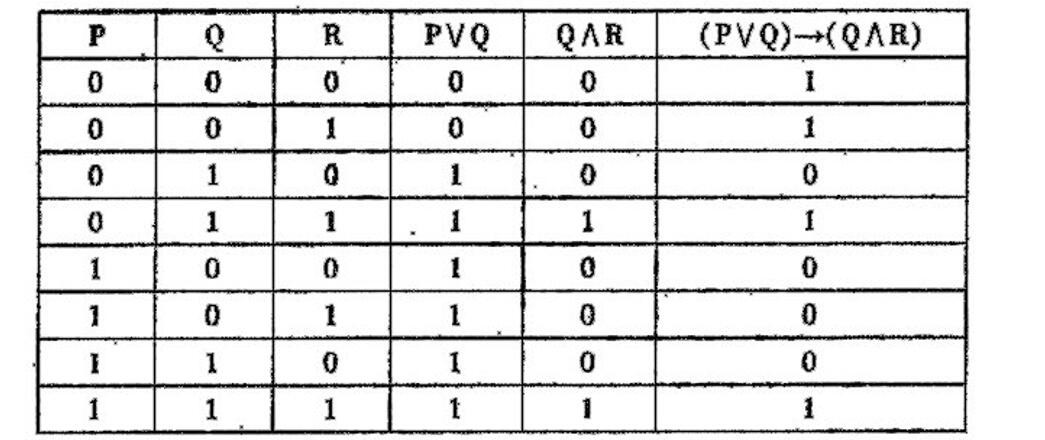

ReLU(x)=(x)^+=\max(0,x)

ReLU(x)=(x)+=max(0,x)

输入:

inplace:是否改变输入数据,如果设置为True,则会直接修改输入数据;如果设置为False,则不对输入数据做修改

注意:

- 输入可以是任意尺寸的数据,输出尺寸与输入尺寸相同

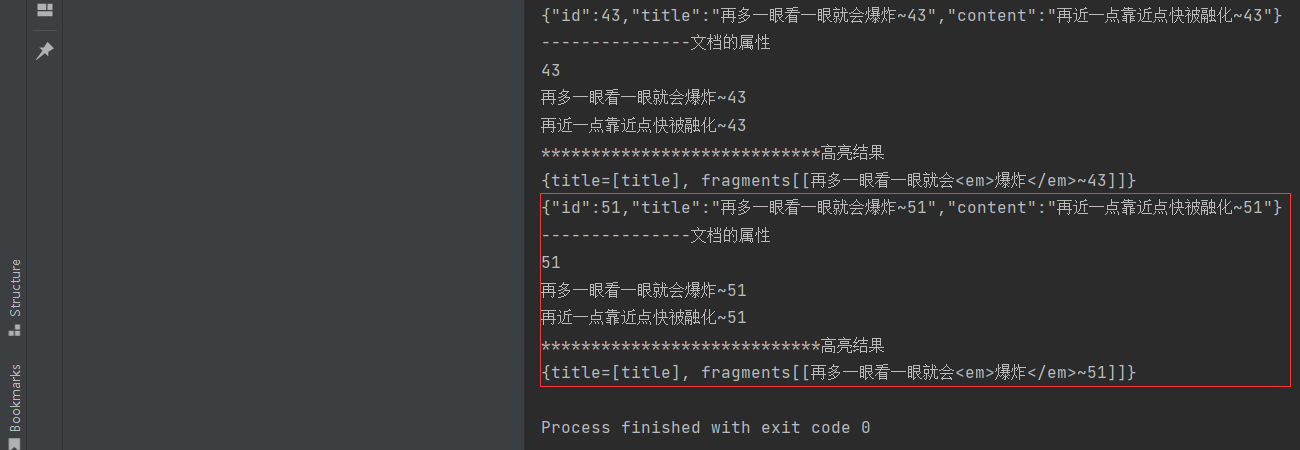

代码案例

一般用法

import torch.nn as nn

import torch

a = torch.randn(10)

relu = nn.ReLU()

b = relu(a)

print(a)

print(b)

输出

# 经过relu之前

tensor([ 1.4481, -1.6880, 1.1357, 2.2152, -1.9795, -1.3784, -0.5270, -0.5725, 1.5533, -1.7112])

# 经过relu之后

tensor([1.4481, 0.0000, 1.1357, 2.2152, 0.0000, 0.0000, 0.0000, 0.0000, 1.5533, 0.0000])

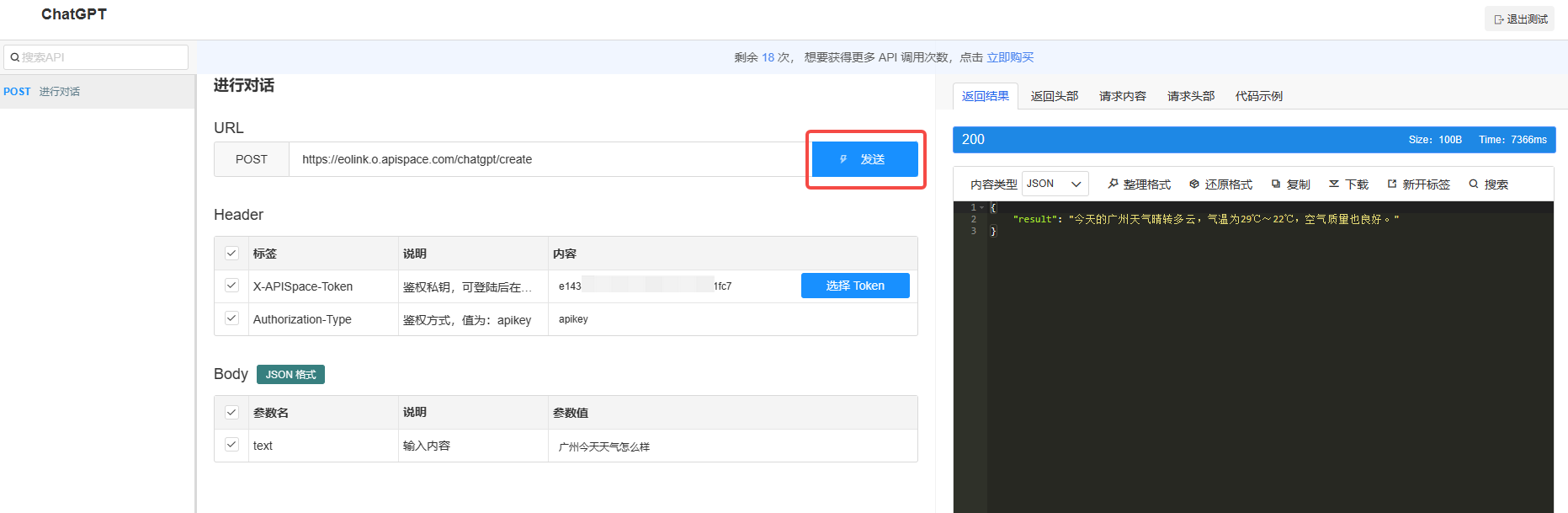

官方文档

nn.ReLU():https://pytorch.org/docs/stable/generated/torch.nn.ReLU.html?highlight=relu#torch.nn.ReLU

初步完稿于:2022年1月28日