文章目录

- 一、创建 CephFS 文件系统 MDS 接口

- 1)在管理节点创建 mds 服务

- 2)查看各个节点的 mds 服务

- 3)创建存储池,启用 ceph 文件系统

- 4)查看mds状态,一个up,其余两个待命,目前的工作的是node01上的mds服务

- 5)创建用户

- 二、客户端操作

- 1)客户端要在 public 网络内

- 2)在客户端创建工作目录

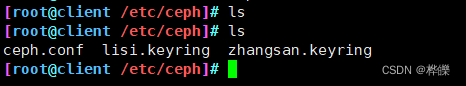

- 3)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

- 4)在客户端安装 ceph 软件包

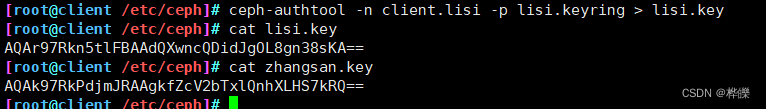

- 5)在客户端制作秘钥文件

- 6)客户端挂载

- 三、创建 Ceph 块存储系统 RBD 接口

- 1、创建一个名为 rbd-demo 的专门用于 RBD 的存储池

- 2、将存储池转换为 RBD 模式

- 3、初始化存储池

- 4、创建镜像

- 5、镜像管理

- 1、查看存储池下存在哪些镜像

- 2、查看镜像的详细信息

- 3、修改镜像大小

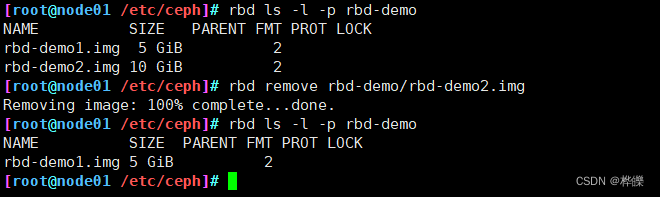

- 7、删除镜像

- 1、直接删除镜像

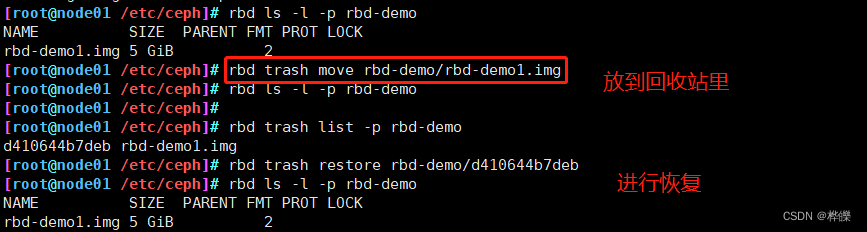

- 2、推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

- 8、Linux客户端使用

- 1、在管理节点创建并授权一个用户可访问指定的 RBD 存储池

- 2、修改RBD镜像特性,CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭

- 3、将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下

- 4、linux客户端操作

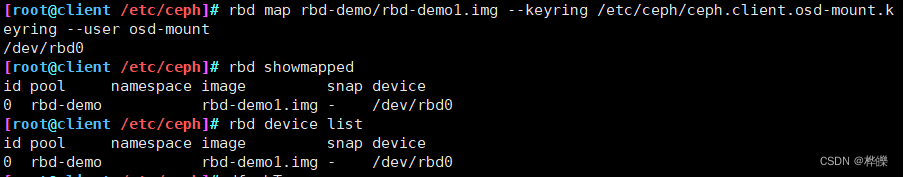

- 5、执行客户端映射

- 6、查看映射

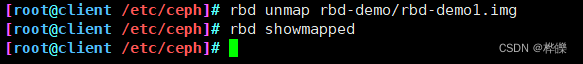

- 7、断开映射

- 8、格式化并挂载

- 9、在线扩容

- 9、快照管理

- 1、在客户端写入文件

- 2、在管理节点对镜像创建快照

- 3、列出指定镜像所有快照

- 4、回滚镜像到指定

- 1、在客户端操作

- 2、在管理节点操作

- 3、在客户端重新映射并挂载

- 5、限制镜像可创建快照数

- 6、快照分层

- 1、快照克隆

- 7、快照展平

- 10、镜像的导出导入

- 四、创建 Ceph 对象存储系统 RGW 接口

- 1、对象存储概念

- 2、创建 RGW 接口

- 1、在管理节点创建一个 RGW 守护进程

- 2、创建成功后默认情况下会自动创建一系列用于 RGW 的存储池

- 3、默认情况下 RGW 监听 7480 号端口

- 3、OSD 故障模拟与恢复

一、创建 CephFS 文件系统 MDS 接口

1)在管理节点创建 mds 服务

cd /etc/ceph

ceph-deploy mds create node01 node02 node03

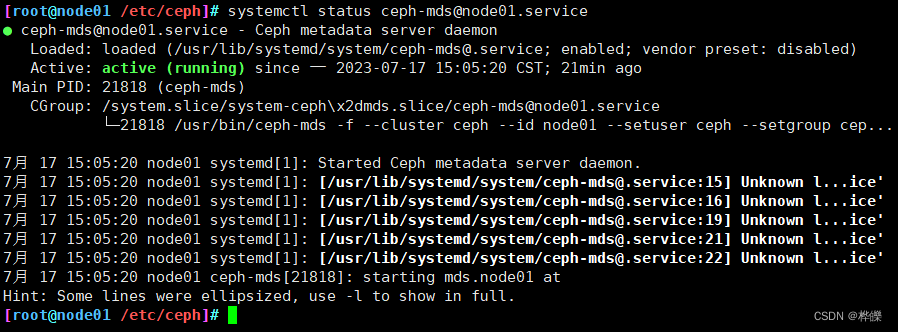

2)查看各个节点的 mds 服务

systemctl status ceph-mds@node01.service

systemctl status ceph-mds@node02.service

systemctl status ceph-mds@node03.service

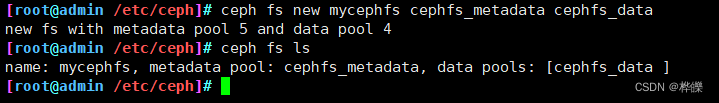

3)创建存储池,启用 ceph 文件系统

ceph 文件系统至少需要两个 rados 池,一个用于存储数据,一个用于存储元数据。此时数据池就类似于文件系统的共享目录。

ceph osd pool create cephfs_data 128 #创建数据Pool

ceph osd pool create cephfs_metadata 128 #创建元数据Pool

创建 cephfs,命令格式:ceph fs new <FS_NAME> <CEPHFS_METADATA_NAME> <CEPHFS_DATA_NAME>

ceph fs new mycephfs cephfs_metadata cephfs_data #启用ceph,元数据Pool在前,数据Pool在后

ceph fs ls #查看cephfs

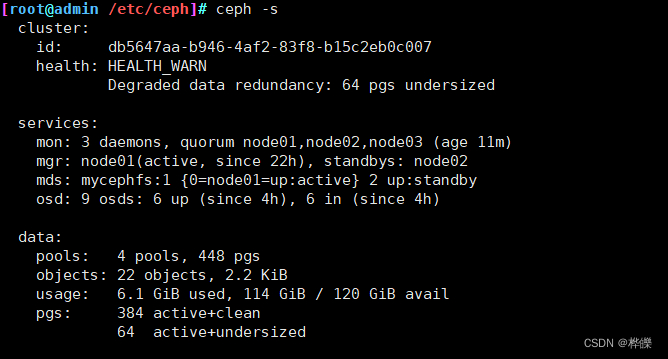

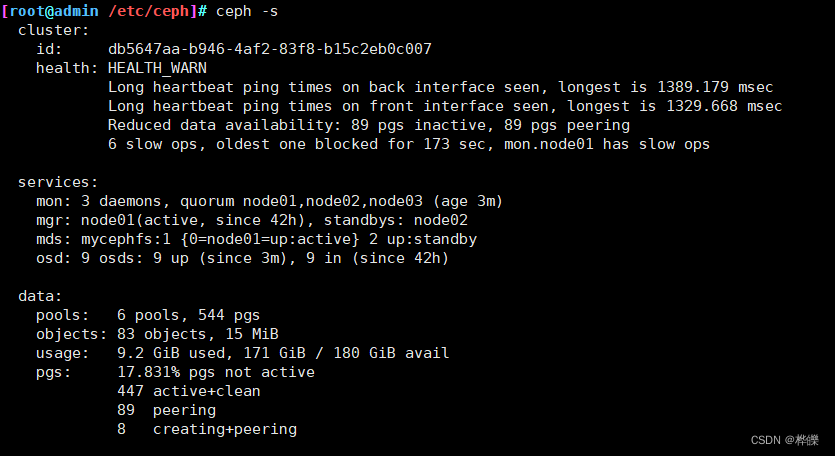

4)查看mds状态,一个up,其余两个待命,目前的工作的是node01上的mds服务

ceph -s

5)创建用户

语法格式:ceph fs authorize <fs_name> client.<client_id> <path-in-cephfs> rw

账户为 client.zhangsan,用户 name 为 zhangsan,zhangsan 对ceph文件系统的 / 根目录(注意不是操作系统的根目录)有读写权限

ceph fs authorize mycephfs client.zhangsan / rw | tee /etc/ceph/zhangsan.keyring

账户为 client.lisi,用户 name 为 lisi,lisi 对文件系统的 / 根目录只有读权限,对文件系统的根目录的子目录 /test 有读写权限

ceph fs authorize mycephfs client.lisi / r /test rw | tee /etc/ceph/lisi.keyring

二、客户端操作

1)客户端要在 public 网络内

2)在客户端创建工作目录

mkdir /etc/ceph

3)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.conf zhangsan.keyring lisi.keyring root@client:/etc/ceph

4)在客户端安装 ceph 软件包

cd /opt

wget https://download.ceph.com/rpm-nautilus/el7/noarch/ceph-release-1-1.el7.noarch.rpm --no-check-certificate

rpm -ivh ceph-release-1-1.el7.noarch.rpm

yum install -y ceph

5)在客户端制作秘钥文件

cd /etc/ceph

ceph-authtool -n client.zhangsan -p zhangsan.keyring > zhangsan.key #把 zhangsan 用户的秘钥导出到 zhangsan.keyl

ceph-authtool -n client.lisi -p lisi.keyring > lisi.key #把 lisi 用户的秘钥导出到 lisi.key

6)客户端挂载

●方式一:基于内核

语法格式:

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secret=<秘钥>

mount -t ceph node01:6789,node02:6789,node03:6789:/ <本地挂载点目录> -o name=<用户名>,secretfile=<秘钥文件>

示例一:

mkdir -p /data/zhangsan

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/zhangsan -o name=zhangsan,secretfile=/etc/ceph/zhangsan.key

示例二:

mkdir -p /data/lisi

mount -t ceph node01:6789,node02:6789,node03:6789:/ /data/lisi -o name=lisi,secretfile=/etc/ceph/lisi.key

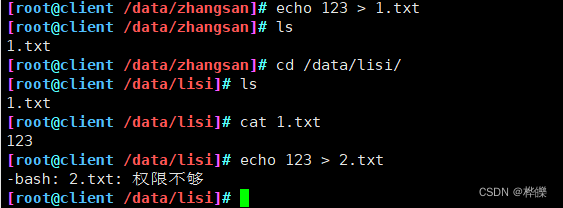

#验证用户权限

cd /data/lisi

echo 123 > 2.txt

-bash:2.txt:权限不够

echo 123 > test/2.txt

cat test/2.txt

123

示例三:

#停掉 node02 上的 mds 服务

ssh root@node02 "systemctl stop ceph-mds@node02"

ceph -s

#测试客户端的挂载点仍然是可以用的,如果停掉所有的 mds,客户端就不能用了

●方式二:基于 fuse 工具

1)在 ceph 的管理节点给客户端拷贝 ceph 的配置文件 ceph.conf 和账号的秘钥环文件 zhangsan.keyring、lisi.keyring

scp ceph.client.admin.keyring root@client:/etc/ceph

2)在客户端安装 ceph-fuse

yum install -y ceph-fuse

3)客户端挂载

cd /data/aa

ceph-fuse -m node01:6789,node02:6789,node03:6789 /data/aa [-o nonempty] #挂载时,如果挂载点不为空会挂载失败,指定 -o nonempty 可以忽略

三、创建 Ceph 块存储系统 RBD 接口

1、创建一个名为 rbd-demo 的专门用于 RBD 的存储池

ceph osd pool create rbd-demo 64 64

2、将存储池转换为 RBD 模式

ceph osd pool application enable rbd-demo rbd

3、初始化存储池

rbd pool init -p rbd-demo # -p 等同于 --pool

4、创建镜像

rbd create -p rbd-demo --image rbd-demo1.img --size 10G

5、镜像管理

1、查看存储池下存在哪些镜像

rbd ls -l -p rbd-demo

2、查看镜像的详细信息

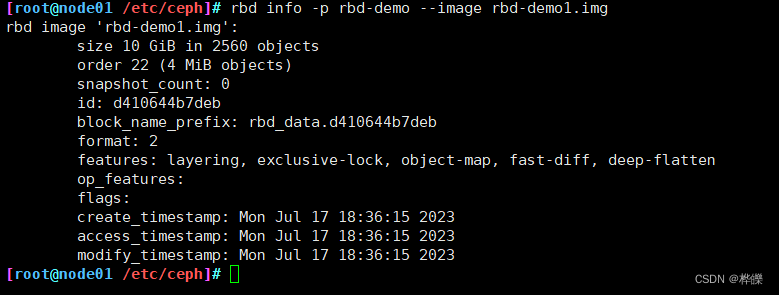

rbd info -p rbd-demo --image rbd-demo1.img

3、修改镜像大小

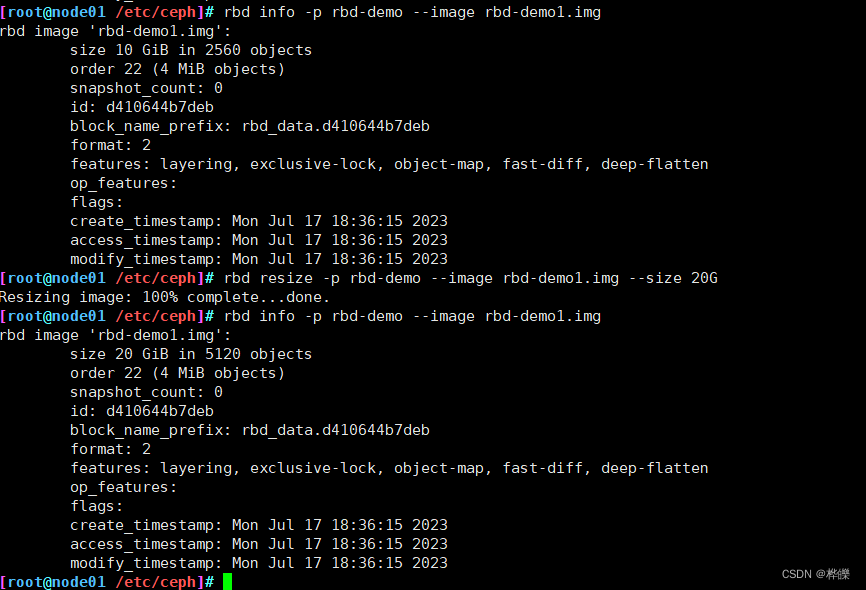

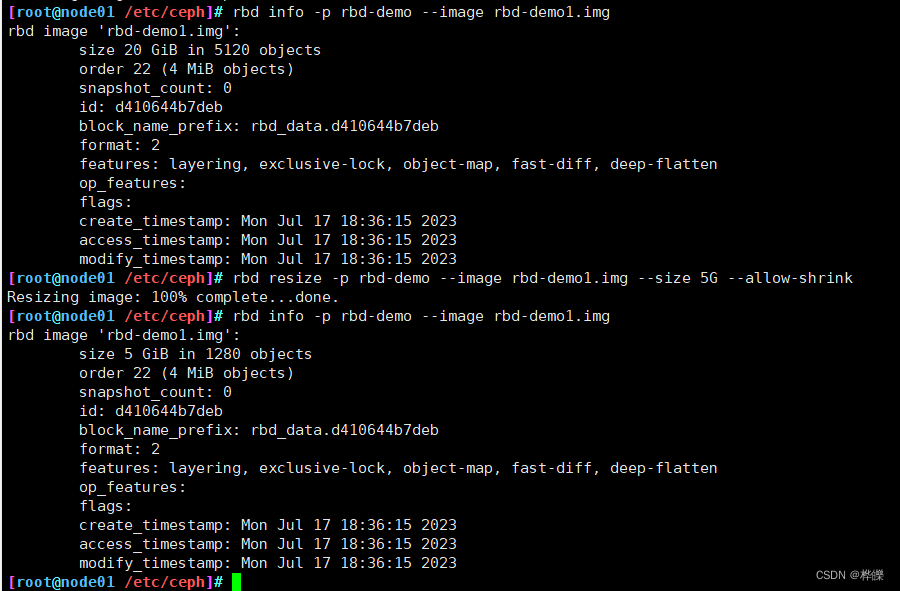

rbd resize -p rbd-demo --image rbd-demo1.img --size 20G

rbd info -p rbd-demo --image rbd-demo1.img

#使用 resize 调整镜像大小,一般建议只增不减,如果是减少的话需要加选项 --allow-shrink

rbd resize -p rbd-demo --image rbd-demo1.img --size 5G --allow-shrink

7、删除镜像

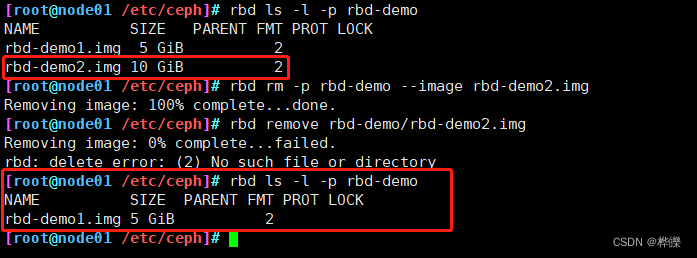

1、直接删除镜像

rbd rm -p rbd-demo --image rbd-demo2.img

#另一种方法

rbd remove rbd-demo/rbd-demo2.img

2、推荐使用 trash 命令,这个命令删除是将镜像移动至回收站,如果想找回还可以恢复

rbd trash move rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

rbd trash list -p rbd-demo

5fc98fe1f304 rbd-demo1.img

#还原镜像

rbd trash restore rbd-demo/5fc98fe1f304

rbd ls -l -p rbd-demo

8、Linux客户端使用

客户端使用 RBD 有两种方式

●通过内核模块KRBD将镜像映射为系统本地块设备,通常设置文件一般为:/dev/rbd*

●另一种是通过librbd接口,通常KVM虚拟机使用这种接口。

本例主要是使用Linux客户端挂载RBD镜像为本地磁盘使用。开始之前需要在所需要客户端节点上面安装ceph-common软件包,因为客户端需要调用rbd命令将RBD镜像映射到本地当作一块普通硬盘使用。并还需要把ceph.conf配置文件和授权keyring文件复制到对应的节点。

1、在管理节点创建并授权一个用户可访问指定的 RBD 存储池

#示例,指定用户标识为client.osd-mount,对另对OSD有所有的权限,对Mon有只读的权限

ceph auth get-or-create client.osd-mount osd "allow * pool=rbd-demo" mon "allow r" > /etc/ceph/ceph.client.osd-mount.keyring

2、修改RBD镜像特性,CentOS7默认情况下只支持layering和striping特性,需要将其它的特性关闭

rbd feature disable rbd-demo/rbd-demo1.img object-map,fast-diff,deep-flatten

3、将用户的keyring文件和ceph.conf文件发送到客户端的/etc/ceph目录下

cd /etc/ceph

scp ceph.client.osd-mount.keyring ceph.conf root@client:/etc/ceph

4、linux客户端操作

#安装 ceph-common 软件包

yum install -y ceph-common

5、执行客户端映射

cd /etc/ceph

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

6、查看映射

rbd showmapped

rbd device list

7、断开映射

rbd unmap rbd-demo/rbd-demo1.img

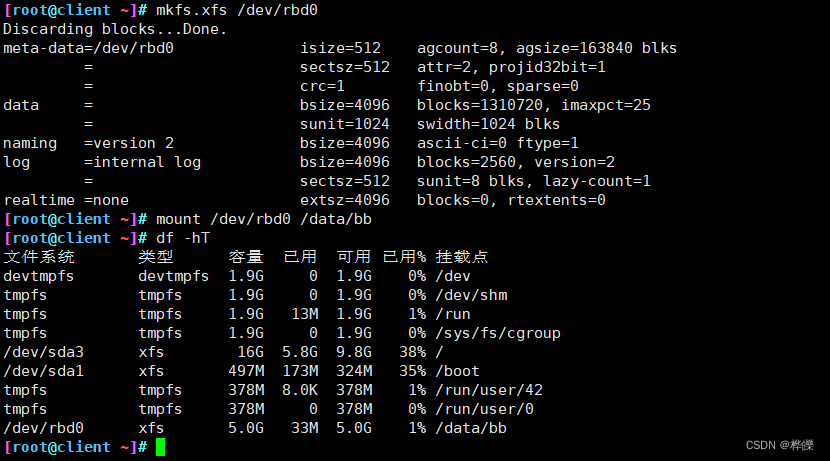

8、格式化并挂载

mkfs.xfs /dev/rbd0

mkdir -p /data/bb

mount /dev/rbd0 /data/bb

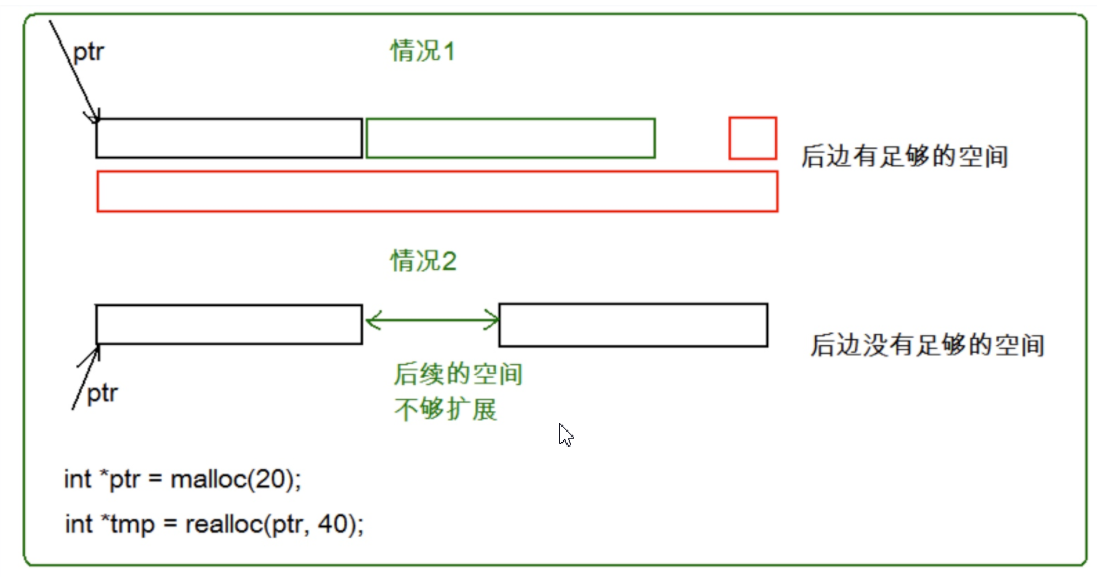

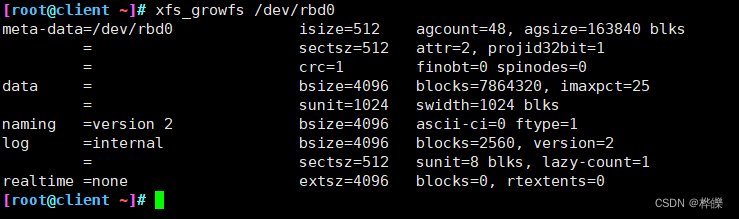

9、在线扩容

在管理节点调整镜像的大小

rbd resize rbd-demo/rbd-demo1.img --size 30G

在客户端刷新设备文件

xfs_growfs /dev/rbd0 #刷新xfs文件系统容量

resize2fs /dev/rbd0 #刷新ext4类型文件系统容量

9、快照管理

对 rbd 镜像进行快照,可以保留镜像的状态历史,另外还可以利用快照的分层技术,通过将快照克隆为新的镜像使用。

1、在客户端写入文件

echo 1111 > /data/bb/11.txt

echo 2222 > /data/bb/22.txt

echo 3333 > /data/bb/33.txt

2、在管理节点对镜像创建快照

rbd snap create --pool rbd-demo --image rbd-demo1.img --snap demo1_snap1

可简写为:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap1

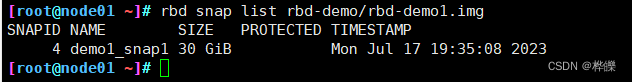

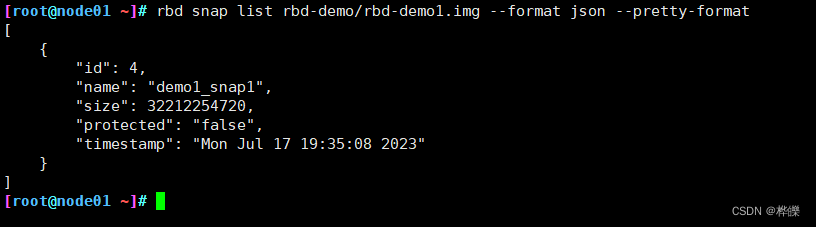

3、列出指定镜像所有快照

rbd snap list rbd-demo/rbd-demo1.img

用json格式输出:

用json格式输出:

4、回滚镜像到指定

在回滚快照之前,需要将镜像取消镜像的映射,然后再回滚。

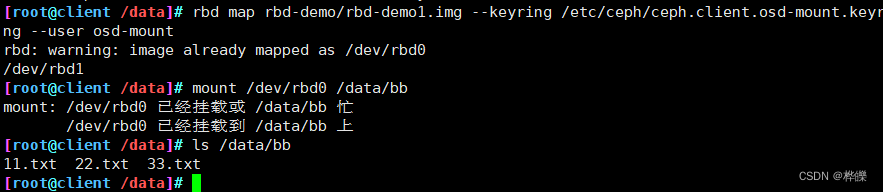

1、在客户端操作

rm -rf /data/bb/*

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

2、在管理节点操作

rbd snap rollback rbd-demo/rbd-demo1.img@demo1_snap1

3、在客户端重新映射并挂载

rbd map rbd-demo/rbd-demo1.img --keyring /etc/ceph/ceph.client.osd-mount.keyring --user osd-mount

mount /dev/rbd0 /data/bb

ls /data/bb #发现数据还原回来了

5、限制镜像可创建快照数

rbd snap limit set rbd-demo/rbd-demo1.img --limit 3

#解除限制:

rbd snap limit clear rbd-demo/rbd-demo1.img

//删除快照

#删除指定快照:

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap1

#删除所有快照:

rbd snap purge rbd-demo/rbd-demo1.img

6、快照分层

快照分层支持用快照的克隆生成新镜像,这种镜像与直接创建的镜像几乎完全一样,支持镜像的所有操作。唯一不同的是克隆镜像引用了一个只读的上游快照,而且此快照必须要设置保护模式。

1、快照克隆

1)将上游快照设置为保护模式:

rbd snap create rbd-demo/rbd-demo1.img@demo1_snap666

rbd snap protect rbd-demo/rbd-demo1.img@demo1_snap666

2)克隆快照为新的镜像

rbd clone rbd-demo/rbd-demo1.img@demo1_snap666 --dest rbd-demo/rbd-demo666.img

rbd ls -p rbd-demo

3)命令查看克隆完成后快照的子镜像

rbd children rbd-demo/rbd-demo1.img@demo1_snap666

7、快照展平

通常情况下通过快照克隆而得到的镜像会保留对父快照的引用,这时候不可以删除该父快照,否则会有影响。

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

#报错 snapshot 'demo1_snap666' is protected from removal.

如果要删除快照但想保留其子镜像,必须先展平其子镜像,展平的时间取决于镜像的大小

1) 展平子镜像

rbd flatten rbd-demo/rbd-demo666.img

2)取消快照保护

rbd snap unprotect rbd-demo/rbd-demo1.img@demo1_snap666

3)删除快照

rbd snap rm rbd-demo/rbd-demo1.img@demo1_snap666

rbd ls -l -p rbd-demo #在删除掉快照后,查看子镜像依然存在

10、镜像的导出导入

//导出镜像

rbd export rbd-demo/rbd-demo1.img /opt/rbd-demo1.img

//导入镜像

#卸载客户端挂载,并取消映射

umount /data/bb

rbd unmap rbd-demo/rbd-demo1.img

#清除镜像下的所有快照,并删除镜像

rbd snap purge rbd-demo/rbd-demo1.img

rbd rm rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

#导入镜像

rbd import /opt/rbd-demo1.img rbd-demo/rbd-demo1.img

rbd ls -l -p rbd-demo

四、创建 Ceph 对象存储系统 RGW 接口

1、对象存储概念

对象存储(object storage)是非结构数据的存储方法,对象存储中每一条数据都作为单独的对象存储,拥有唯一的地址来识别数据对象,通常用于云计算环境中。

不同于其他数据存储方法,基于对象的存储不使用目录树。

虽然在设计与实现上有所区别,但大多数对象存储系统对外呈现的核心资源类型大同小异。从客户端的角度来看,分为以下几个逻辑单位:

Amazon S3:

提供了

1、用户(User)

2、存储桶(Bucket)

3、对象(Object)

三者的关系是:

1、User将Object存储到系统上的Bucket

2、存储桶属于某个用户并可以容纳对象,一个存储桶用于存储多个对象

3、同一个用户可以拥有多个存储桶,不同用户允许使用相同名称的Bucket,因此User名称即可做为Bucket的名称空间

●OpenStack Swift:

提供了user、container和object分别对应于用户、存储桶和对象,不过它还额外为user提供了父级组件account,用于表示一个项目或用户,因此一个account中可以包含一到多个user,它们可共享使用同一组container,并为container提供名称空间

●RadosGW:

提供了user、subuser、bucket和object,其中的user对应于S3的user,而subuser则对应于Swift的user,不过user和subuser都不支持为bucket提供名称空间,因此不同用户的存储桶不允许同名;不过,自jewel版本起,RadosGW引入了tenant(租户)用于为user和bucket提供名称空间,但他是个可选组件

从上可以看出大多数对象存储的核心资源类型大同小异,如 Amazon S3、OpenStack Swift 与 RadosGw。其中 S3 与 Swift 互不兼容,RadosGw 为了兼容 S3 与 Swift, Ceph 在 RadosGW 集群的基础上提供了 RGW(RadosGateway)数据抽象层和管理层,它可以原生兼容 S3 和 Swift 的 API。

S3和Swift它们可基于http或https完成数据交换,由RadosGW内建的Civetweb提供服务,它还可以支持代理服务器包括nginx、haproxy等以代理的形式接收用户请求,再转发至RadosGW进程。

RGW 的功能依赖于对象网关守护进程实现,负责向客户端提供 REST API 接口。出于冗余负载均衡的需求,一个 Ceph 集群上通常不止一个 RadosGW 守护进程。

2、创建 RGW 接口

如果需要使用到类似 S3 或者 Swift 接口时候才需要部署/创建 RadosGW 接口,RadosGW 通常作为对象存储(Object Storage)使用,类于阿里云OSS。

cd /etc/ceph

ceph-deploy rgw create node015

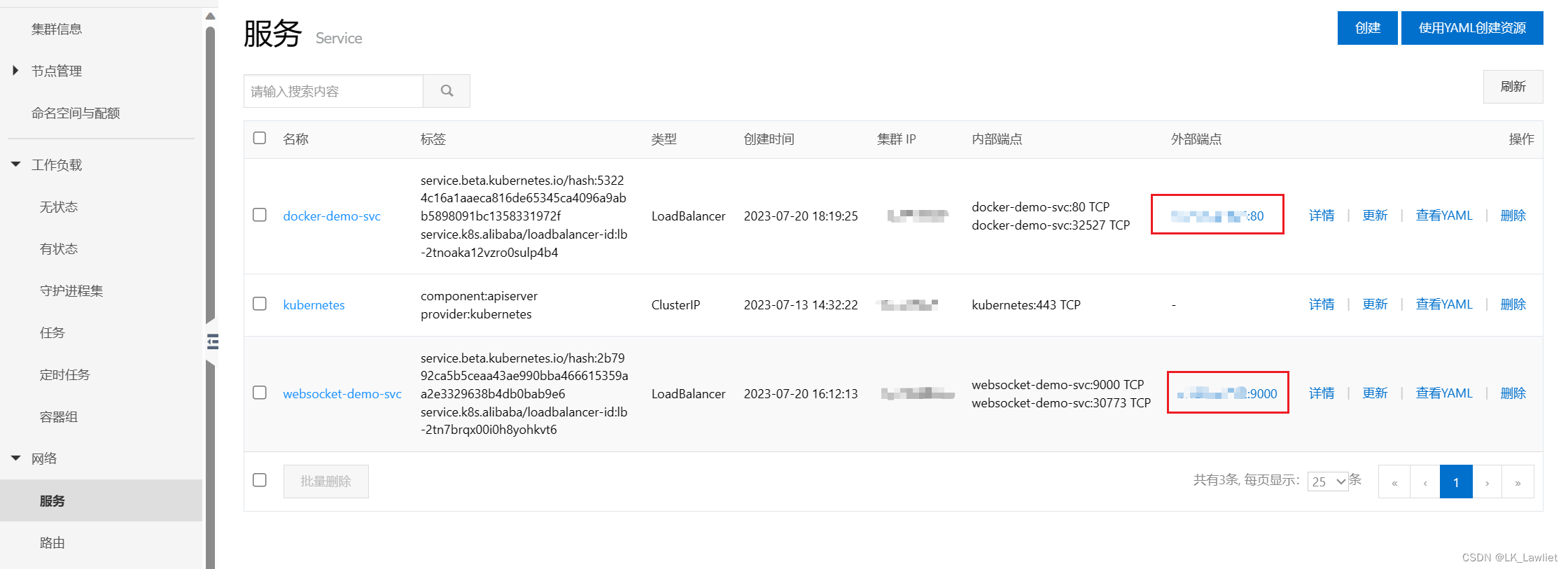

1、在管理节点创建一个 RGW 守护进程

cd /etc/ceph

ceph-deploy rgw create node01

ceph -s

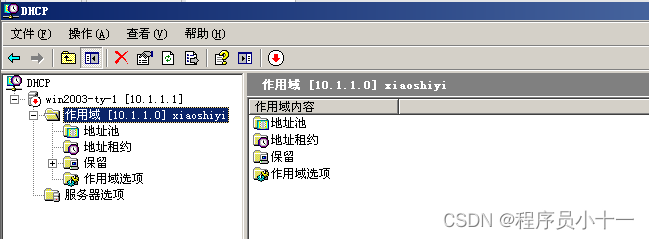

2、创建成功后默认情况下会自动创建一系列用于 RGW 的存储池

ceph osd pool ls

rgw.root

default.rgw.control #控制器信息

default.rgw.meta #记录元数据

default.rgw.log #日志信息

default.rgw.buckets.index #为 rgw 的 bucket 信息,写入数据后生成

default.rgw.buckets.data #是实际存储的数据信息,写入数据后生成

3、默认情况下 RGW 监听 7480 号端口

ssh root@node01 netstat -lntp | grep 7480

开启 http+https ,更改监听端口

RadosGW 守护进程内部由 Civetweb 实现,通过对 Civetweb 的配置可以完成对 RadosGW 的基本管理。

#要在 Civetweb 上启用SSL,首先需要一个证书,在 rgw 节点生成证书

1)生成CA证书私钥:

openssl genrsa -out civetweb.key 2048

2)生成CA证书公钥:

openssl req -new -x509 -key civetweb.key -out civetweb.crt -days 3650 -subj "/CN=192.168.80.11"

#3、将生成的证书合并为pem

cat civetweb.key civetweb.crt > /etc/ceph/civetweb.pem

#更改监听端口

Civetweb 默认监听在 7480 端口并提供 http 协议,如果需要修改配置需要在管理节点编辑 ceph.conf 配置文件

cd /etc/ceph

vim ceph.conf

......

[client.rgw.node01]

rgw_host = node01

rgw_frontends = "civetweb port=80+443s ssl_certificate=/etc/ceph/civetweb.pem num_threads=500 request_timeout_ms=60000"

------------------------------------------------------------

●rgw_host:对应的RadosGW名称或者IP地址

●rgw_frontends:这里配置监听的端口,是否使用https,以及一些常用配置:

•port:如果是https端口,需要在端口后面加一个s。

•ssl_certificate:指定证书的路径。

•num_threads:最大并发连接数,默认为50,根据需求调整,通常在生产集群环境中此值应该更大

•request_timeout_ms:发送与接收超时时长,以ms为单位,默认为30000

•access_log_file:访问日志路径,默认为空

•error_log_file:错误日志路径,默认为空

------------------------------------------------------------

#修改完 ceph.conf 配置文件后需要重启对应的 RadosGW 服务,再推送配置文件

ceph-deploy --overwrite-conf config push node0{1..3}

ssh root@node01 systemctl restart ceph-radosgw.target

#在 rgw 节点上查看端口

netstat -lntp | grep -w 80

netstat -lntp | grep 443

#在客户端访问验证

curl http://192.168.80.11:80

curl -k https://192.168.80.11:443

//创建 RadosGW 账户

在管理节点使用 radosgw-admin 命令创建 RadosGW 账户

radosgw-admin user create --uid="rgwuser" --display-name="rgw test user"

......

"keys": [

{

"user": "rgwuser",

"access_key": "ER0SCVRJWNRIKFGQD31H",

"secret_key": "YKYjk7L4FfAu8GHeQarIlXodjtj1BXVaxpKv2Nna"

}

],

#创建成功后将输出用户的基本信息,其中最重要的两项信息为 access_key 和 secret_key 。用户创建成后功,如果忘记用户信息可以使用下面的命令查看

radosgw-admin user info --uid="rgwuser"

//S3 接口访问测试

1)在客户端安装 python3、python3-pip

yum install -y python3 python3-pip

python3 -V

Python 3.6.8

pip3 -V

pip 9.0.3 from /usr/lib/python3.6/site-packages (python 3.6)

2)安装 boto 模块,用于测试连接 S3

pip3 install boto

3)测试访问 S3 接口

echo 123123 > /opt/123.txt

vim test.py

#coding:utf-8

import ssl

import boto.s3.connection

from boto.s3.key import Key

try:

_create_unverified_https_context = ssl._create_unverified_context

except AttributeError:

pass

else:

ssl._create_default_https_context = _create_unverified_https_context

#test用户的keys信息

access_key = "ER0SCVRJWNRIKFGQD31H" #输入 RadosGW 账户的 access_key

secret_key = "YKYjk7L4FfAu8GHeQarIlXodjtj1BXVaxpKv2Nna" #输入 RadosGW 账户的 secret_key

#rgw的ip与端口

host = "192.168.80.11" #输入 RGW 接口的 public 网络地址

#如果使用443端口,下述链接应设置is_secure=True

port = 443

#如果使用80端口,下述链接应设置is_secure=False

#port = 80

conn = boto.connect_s3(

aws_access_key_id=access_key,

aws_secret_access_key=secret_key,

host=host,

port=port,

is_secure=True,

validate_certs=False,

calling_format=boto.s3.connection.OrdinaryCallingFormat()

)

#一:创建存储桶

#conn.create_bucket(bucket_name='bucket01')

#conn.create_bucket(bucket_name='bucket02')

#二:判断是否存在,不存在返回None

exists = conn.lookup('bucket01')

print(exists)

#exists = conn.lookup('bucket02')

#print(exists)

#三:获得一个存储桶

#bucket1 = conn.get_bucket('bucket01')

#bucket2 = conn.get_bucket('bucket02')

#四:查看一个bucket下的文件

#print(list(bucket1.list()))

#print(list(bucket2.list()))

#五:向s3上存储数据,数据来源可以是file、stream、or string

#5.1、上传文件

#bucket1 = conn.get_bucket('bucket01')

# name的值是数据的key

#key = Key(bucket=bucket1, name='myfile')

#key.set_contents_from_filename('/opt/123.txt')

# 读取 s3 中文件的内容,返回 string 即文件 123.txt 的内容

#print(key.get_contents_as_string())

#5.2、上传字符串

#如果之前已经获取过对象,此处不需要重复获取

bucket2 = conn.get_bucket('bucket02')

key = Key(bucket=bucket2, name='mystr')

key.set_contents_from_string('hello world')

print(key.get_contents_as_string())

#六:删除一个存储桶,在删除存储桶本身时必须删除该存储桶内的所有key

bucket1 = conn.get_bucket('bucket01')

for key in bucket1:

key.delete()

bucket1.delete()

4)按照以上步骤执行 python 脚本测试

python3 test.py

3、OSD 故障模拟与恢复

1、模拟 OSD 故障

如果 ceph 集群有上千个 osd,每天坏 2~3 个太正常了,我们可以模拟 down 掉一个 osd

#如果 osd 守护进程正常运行,down 的 osd 会很快自恢复正常,所以需要先关闭守护进程

ssh root@node01 systemctl stop ceph-osd@0

#down 掉 osd

ceph osd down 0

ceph osd tree

2、将坏掉的 osd 踢出集群

//方法一:

#将 osd.0 移出集群,集群会开始自动同步数据

ceph osd out osd.0

#将 osd.0 移除 crushmap

ceph osd crush remove osd.0

#删除守护进程对应的账户信息

ceph auth rm osd.0

ceph auth list

#删掉 osd.0

ceph osd rm osd.0

ceph osd stat

ceph -s

//方法二:

ceph osd out osd.0

#使用综合步骤,删除配置文件中针对坏掉的 osd 的配置

ceph osd purge osd.0 --yes-i-really-mean-it

3、把原来坏掉的 osd 修复后重新加入集群

#在 osd 节点创建 osd,无需指定名,会按序号自动生成

cd /etc/ceph

ceph osd create

#创建账户

ceph-authtool --create-keyring /etc/ceph/ceph.osd.0.keyring --gen-key -n osd.0 --cap mon 'allow profile osd' --cap mgr 'allow profile osd' --cap osd 'allow *'

#导入新的账户秘钥

ceph auth import -i /etc/ceph/ceph.osd.0.keyring

ceph auth list

#更新对应的 osd 文件夹中的密钥环文件

ceph auth get-or-create osd.0 -o /var/lib/ceph/osd/ceph-0/keyring

#加入 crushmap

ceph osd crush add osd.0 1.000 host=node01 #1.000 代表权重

#加入集群

ceph osd in osd.0

ceph osd tree

#重启 osd 守护进程

systemctl restart ceph-osd@0

ceph osd tree #稍等片刻后 osd 状态为 up

//如果重启失败

报错:

Job for ceph-osd@0.service failed because start of the service was attempted too often. See "systemctl status ceph-osd@0.service" and "journalctl -xe" for details.

To force a start use "systemctl reset-failed ceph-osd@0.service" followed by "systemctl start ceph-osd@0.service" again.

#运行

systemctl reset-failed ceph-osd@0.service && systemctl restart ceph-osd@0.service