系列文章目录

虚拟机centos7配置Hadoop单节点伪分布配置教程

hbase进阶操作——读流程与写流程介绍

HBase进阶——文件的合并、 MemStore Flush、StoreFile Compaction、 Region Split、高可用与预分区介绍

centos7虚拟机下hbase的使用案例讲解

文章目录

前言

一、Hive 基本概念1.1 什么是Hive

1.2 Hive 的优缺点

1.3 Hive 架构原理

1.4 Hive 和数据库比较

二、Hive安装部署2.1 、安装 Hive

1 把 apache-hive-3.1.2-bin.tar.gz上传到 linux的 /opt/software目录下

编辑2 解压 apache-hive-3.1.2-bin.tar.gz到 /opt/module/目录下面

编辑3 修改 apache-hive-3.1.2-bin.tar.gz的名称为 hive

编辑4 修改 /etc/profile.d/my_env.sh 添加环境变量

5 添加内容

6 解决日志 Jar包冲突

7、初始化元数据库

2.2、启动并使用 Hive

1)启动 Hive

2)使用 Hive

3)在 CRT窗口 中开启另一个窗口开启 Hive,在 /tmp/atguigu目录下监控 hive.log文件

前言

本文主要介绍hive的基本概念以及hive客户端在centos7集群模式下的安装与部分出问题地方的解决方法。

一、Hive 基本概念

1.1 什么是Hive

1) hive 简介

Hive:由Facebook 开源用于解决海量结构化日志的数据统计工具。

Hive 是基于Hadoop 的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并

提供类SQL 查询功能。

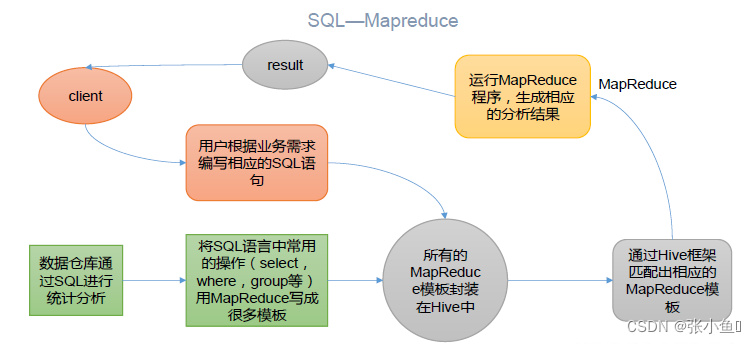

2) Hive 本质:将HQL 转化成MapReduce 程序

(1)Hive 处理的数据存储在HDFS

(2)Hive 分析数据底层的实现是MapReduce

(3)执行程序运行在Yarn 上

1.2 Hive 的优缺点

1.2.1 优点

(1)操作接口采用类SQL 语法,提供快速开发的能力(简单、容易上手)。

(2)避免了去写MapReduce,减少开发人员的学习成本。

(3)Hive 的执行延迟比较高,因此Hive 常用于数据分析,对实时性要求不高的场合。

(4)Hive 优势在于处理大数据,对于处理小数据没有优势,因为Hive 的执行延迟比较高。

(5)Hive 支持用户自定义函数,用户可以根据自己的需求来实现自己的函数。

1.2.2 缺点

1)Hive 的HQL 表达能力有限

(1)迭代式算法无法表达

(2)数据挖掘方面不擅长,由于MapReduce 数据处理流程的限制,效率更高的算法却

无法实现。

2)Hive 的效率比较低

(1)Hive 自动生成的MapReduce 作业,通常情况下不够智能化

(2)Hive 调优比较困难,粒度较粗

1.3 Hive 架构原理

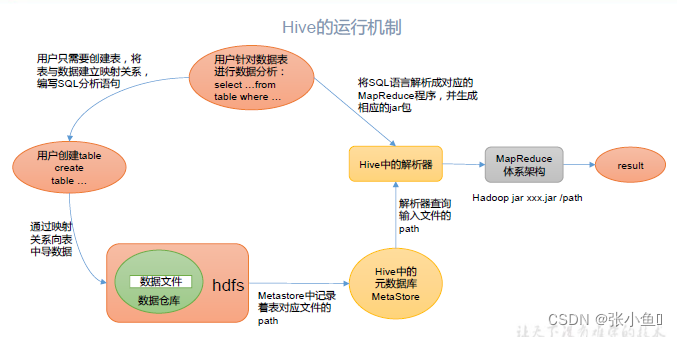

1)用户接口:Client

CLI(command-line interface)、JDBC/ODBC(jdbc 访问hive)、WEBUI(浏览器访问hive)

2)元数据:Metastore

元数据包括:表名、表所属的数据库(默认是default)、表的拥有者、列/分区字段、表的类型(是否是外部表)、表的数据所在目录等;默认存储在自带的derby 数据库中,推荐使用MySQL 存储Metastore

3)Hadoop

使用HDFS 进行存储,使用MapReduce 进行计算。

4)驱动器:Driver

(1)解析器(SQL Parser):将SQL 字符串转换成抽象语法树AST,这一步一般都用第三方工具库完成,比如antlr;对AST 进行语法分析,比如表是否存在、字段是否存在、SQL语义是否有误。

(2)编译器(Physical Plan):将AST 编译生成逻辑执行计划。

(3)优化器(Query Optimizer):对逻辑执行计划进行优化。

(4)执行器(Execution):把逻辑执行计划转换成可以运行的物理计划。对于Hive 来说,就是MR/Spark。

Hive 通过给用户提供的一系列交互接口,接收到用户的指令(SQL),使用自己的Driver,结合元数据(MetaStore),将这些指令翻译成MapReduce,提交到Hadoop 中执行,最后,将执行返回的结果输出到用户交互接口。

1.4 Hive 和数据库比较

由于 Hive 采用了类似SQL 的查询语言 HQL(Hive Query Language),因此很容易将 Hive 理解为数据库。其实从结构上来看,解为数据库。其实从结构上来看,HiveHive 和数据库除了拥有类似的查询语言,再无类似之处。和数据库除了拥有类似的查询语言,再无类似之处。本文将从多个方面来阐述本文将从多个方面来阐述 HiveHive 和数据库的差异。数据库可以用在和数据库的差异。数据库可以用在 OnlineOnline 的应用中,但是的应用中,但是HiveHive 是为数据仓库而设计的,清楚这一点,有助于从应用角度理解是为数据仓库而设计的,清楚这一点,有助于从应用角度理解 HiveHive 的特性。的特性。

1.4.1 查询语言查询语言 由于由于SQLSQL被广泛的应用在数据仓库中,因此,专门针对被广泛的应用在数据仓库中,因此,专门针对HiveHive的特性设计了类的特性设计了类SQLSQL的查的查询语言询语言HQLHQL。熟悉。熟悉SQLSQL开发的开发者可以很方便的使用开发的开发者可以很方便的使用HiveHive进行开发。进行开发。

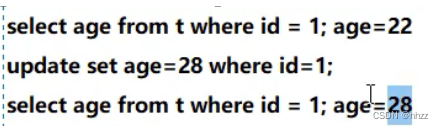

1.4.2 数据更新数据更新 由于由于HiveHive是针对数据仓库应用设计的,而是针对数据仓库应用设计的,而数据仓库数据仓库的内容是读多写少的。的内容是读多写少的。因此,因此,HiveHive中中不不建议建议对数据的改写,所有的数据都是在加载的时候确定好的。对数据的改写,所有的数据都是在加载的时候确定好的。而数据库中的数据通常是需而数据库中的数据通常是需要经常进行修改的,因此可以使用要经常进行修改的,因此可以使用 INSERTINSERT INTOINTO …… VALUESVALUES 添加数据,使用添加数据,使用 UPDATEUPDATE …… SETSET修修改数据。改数据。

1.4.3 执行延迟执行延迟 HiveHive 在查询数据的时候,由于没有索引,需要扫描整个表,因此延迟较高。另外一个导在查询数据的时候,由于没有索引,需要扫描整个表,因此延迟较高。另外一个导致致 HiveHive 执行延迟高的因素是执行延迟高的因素是 MapReduceMapeduce框架。由于框架。由于MapReduceMapReduce 本身具有较高的延迟,因此本身具有较高的延迟,因此在利用在利用MapReduceMapReduce 执行执行HiveHive查询时,也会有较高的查询时,也会有较高的延迟。相对的,数据库的执行延迟较低。延迟。相对的,数据库的执行延迟较低。当然,这个低是有条件的,即数据规模较小,当数据规模大到超过数据库的处理能力的时候,当然,这个低是有条件的,即数据规模较小,当数据规模大到超过数据库的处理能力的时候,HiveHive的并行计算显然能体现出优势。的并行计算显然能体现出优势。

1.4.4 数据规模数据规模由于由于HiveHive建立在集群上并可以利用建立在集群上并可以利用MapReduceMapReduce进行并行计算,因此可以支持很大规模进行并行计算,因此可以支持很大规模的数据;对应的,数据库可以支持的数据规模较小。的数据;对应的,数据库可以支持的数据规模较小。

二、Hive安装部署

2.1 、安装 Hive

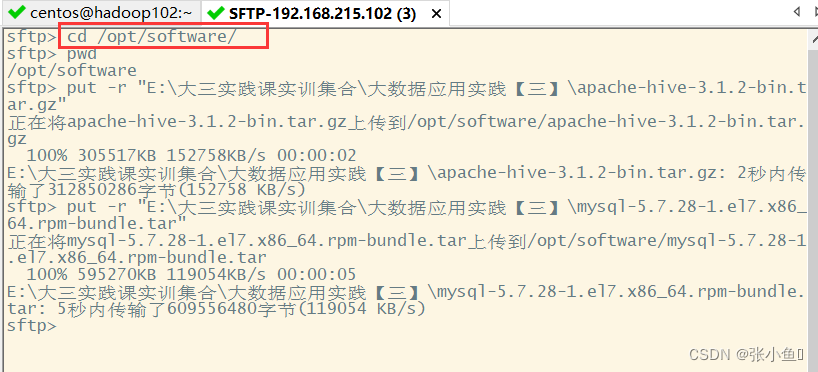

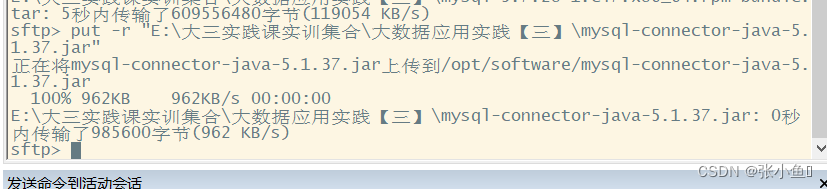

1 把 apache-hive-3.1.2-bin.tar.gz上传到 linux的 /opt/software目录下

ps:此处插入一个理解MySQL的jar包

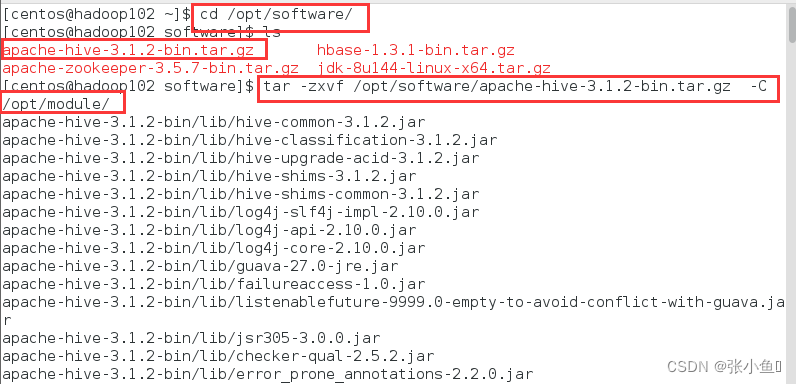

2 解压 apache-hive-3.1.2-bin.tar.gz到 /opt/module/目录下面

[atguigu@hadoop102 software]$ tar zxvf /opt/ apache hive 3.1.2bin.tar.gz C /opt/module/

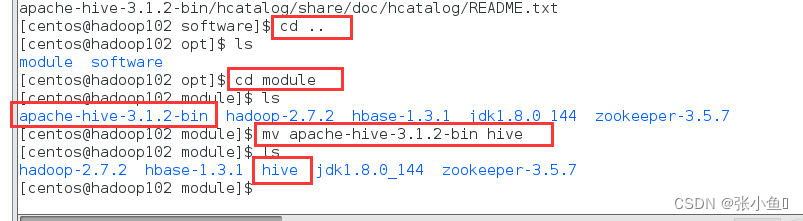

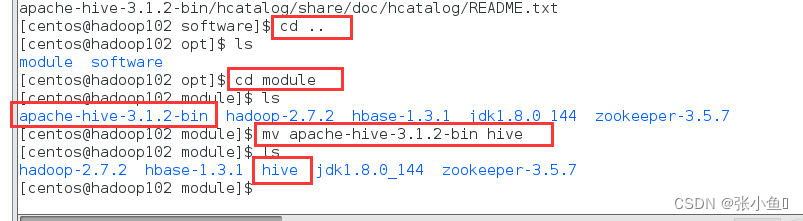

3 修改 apache-hive-3.1.2-bin.tar.gz的名称为 hive

[atguigu@hadoop102 software]$ mv /opt/module /apache hive 3.1.2 bin/ /opt/module /hive

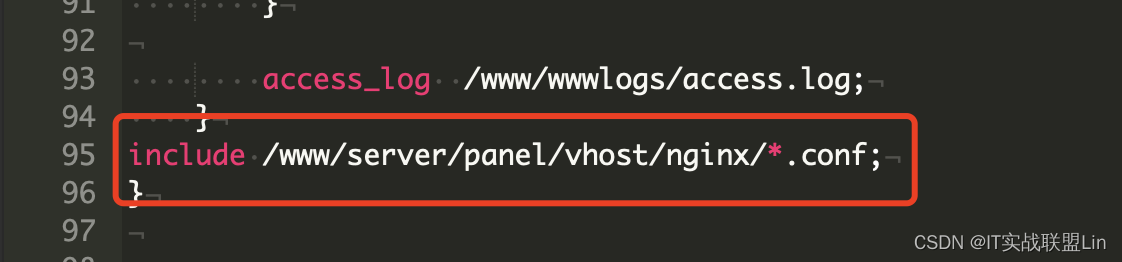

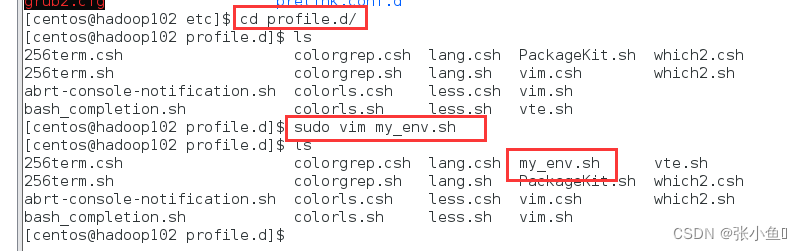

4 修改 /etc/profile.d/my_env.sh 添加环境变量

[atguigu@hadoop102 software]$ sudo vim etc/profile.d/my_env.sh

5 添加内容

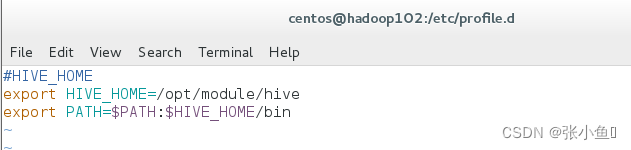

#H IVE_HOME

export HIVE_HOME=/opt/module/hive

ex port PATH=$PATH:$HIVE_HOME/bin

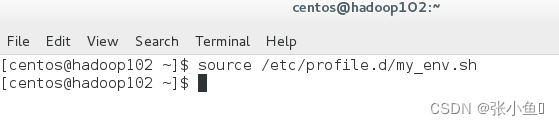

编辑完成之后记得source一下

6 解决日志 Jar包冲突

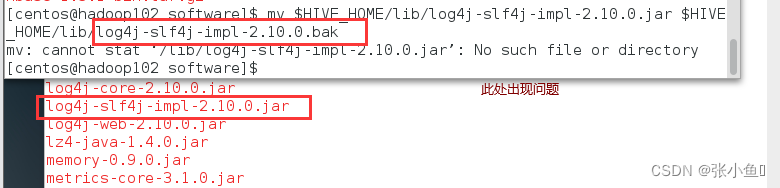

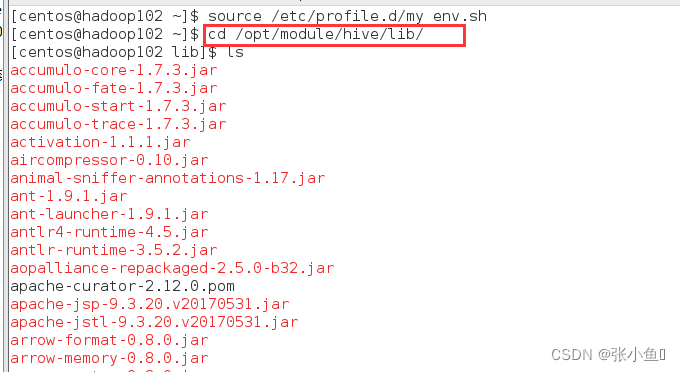

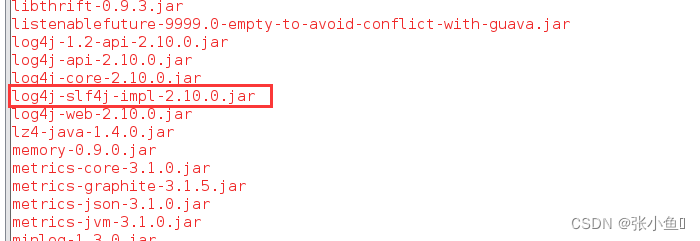

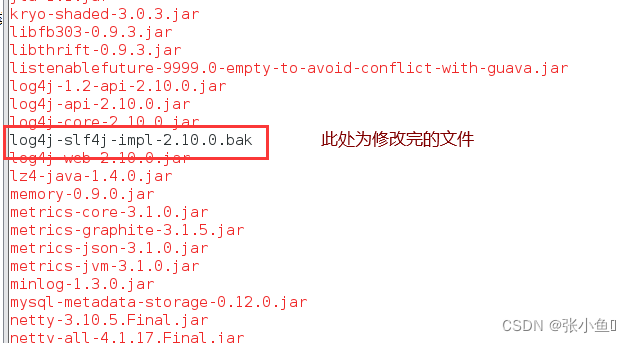

[atguigu@hadoop102 software]$ mv $HIVE_HOME/lib/log4j slf4j impl-2.10.0.jar $HIVE_HOME/lib/log4j slf4j impl-2.10.0.bak

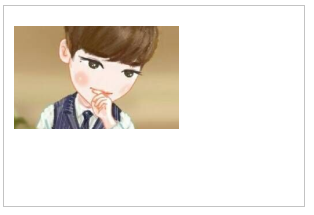

执行此步骤时出现问题,解决方法如下:

修改jar包名称为bak

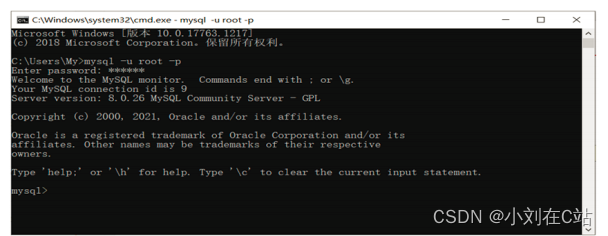

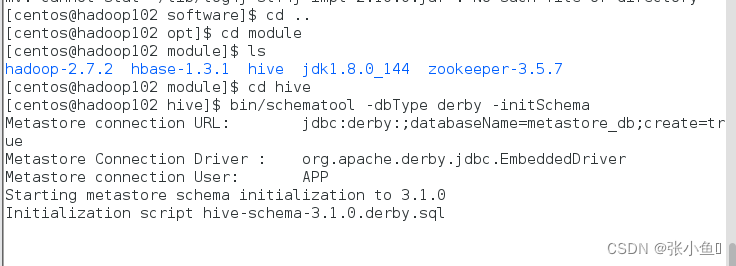

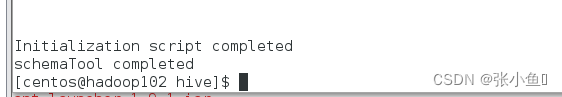

7、初始化元数据库

[atguigu@hadoop102 hive]$ bin/schematool dbType derby initSchema

2.2、启动并使用 Hive

1)启动 Hive

[atguigu@hadoop102 hive]$ bin/hive

此处插入一个提示信息:启动hive是需要先启动Hadoop集群

2)使用 Hive

hive> show databases;

hive> show tables;

hive> create table test (id

hive> insert into test values(1);

hive select * from test

3)在 CRT窗口 中开启另一个窗口开启 Hive,在 /tmp/atguigu目录下监控 hive.log文件

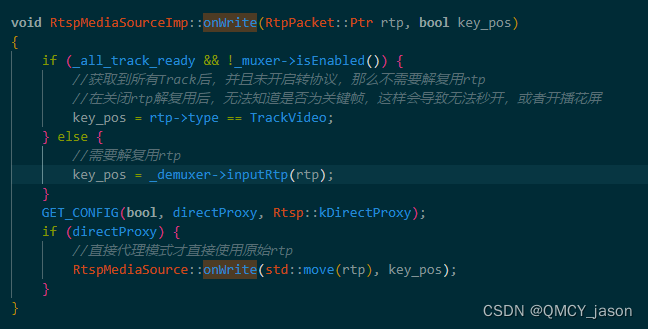

Caused by: ERROR XSDB6: Another instance of Derby may have already booted

the database /opt/module/hive/metastore_db.

at

org.apache.derby.iapi.error.StandardException.newException(Unknown

Source)

at

org.apache.derby.iapi.error.StandardException.newException(Unknown

Source)Source) at at org.apache.derby.impl.store.raw.data.BaseDataFileFactory.privGetJBMSLockOorg.apache.derby.impl.store.raw.data.BaseDataFileFactory.privGetJBMSLockOnDB(Unknown Source)nDB(Unknown Source) at at org.apache.derby.impl.store.raw.data.BaseDataFileFactory.run(Unknown org.apache.derby.impl.store.raw.data.BaseDataFileFactory.run(Unknown Source)Source) ......

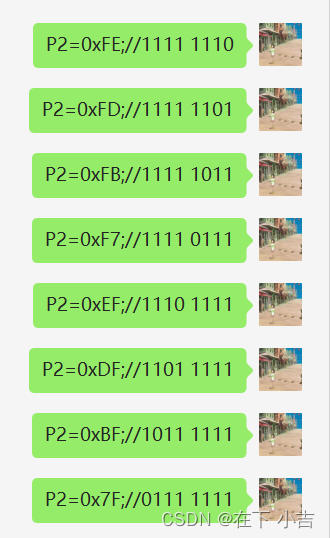

原因在于

原因在于HiveHive默认使用的元数据库为默认使用的元数据库为derbyderby,开启,开启HiveHive之后就会占用元数据库,之后就会占用元数据库,且且不与不与其他客户端共享数据其他客户端共享数据,,所以我们需要将所以我们需要将HiveHive的元数据地址改为的元数据地址改为MySQLMySQL。

总结

以上就是今天的内容,主要介绍Hive的基本概念与安装客户端的操作,也欢迎各位小伙伴留言交流奥~

最后欢迎大家点赞👍,收藏⭐,转发🚀,

如有问题、建议,请您在评论区留言💬哦。