1.1 群集的的定义及意义

群集的定义

Cluster,集群(也称群集)由多台主机构成,但对外只表现为一一个整体,只提供一-个访问入口(域名或IP地址), 相当于一台大型计算机。

群集的作用

对于企业服务的的性能提升一般会有两种方式:

纵向扩展 : 对服务器的CPU 内存 硬盘 等硬件进行升级或者扩容来实现的 性能上限会有瓶颈,成本昂贵,收效比不高等问题

横向扩展 : 通过增加服务器主机数量来应该高并发的场景

群集的目的

- 提高性能:计算密集应用。如天气预报,核试验模拟。

- 降低成本:相对百万美元的超级计算机,价格便宜。

- 提高可扩展性:只要增加集群节点即可。

- 增强可靠性:多个节点完成相同功能,避免单点失败

企业级群集的类型

负载均衡(LB):提高应用系统的响应效率,处理更多的访问请求,减少延迟,提高并发和负载能力。 同时也是如今企业运用最多的群集类型。

高可用(HA): 提高应用系统的可靠性,减少服务中断时间,确保服务的连续性

高性能运算(HPC):将多台主机的硬件计算资源整合到一起实现分布式运用,比如 云计算

2. LVS负载均衡群集运用理论

LVS的相关话术:

DS:Director Server。指的是前端负载均衡器。

RS:Real Server。节点服务器,后端真实的工作服务器。

VIP:向外部直接面向用户请求,作为用户请求的目标的IP地址。

DIP:Director Server IP,主要用于和内部主机通讯的IP地址。

RIP:Real Server IP,后端服务器的IP地址。

CIP:Client IP,访问客户端的IP地址。

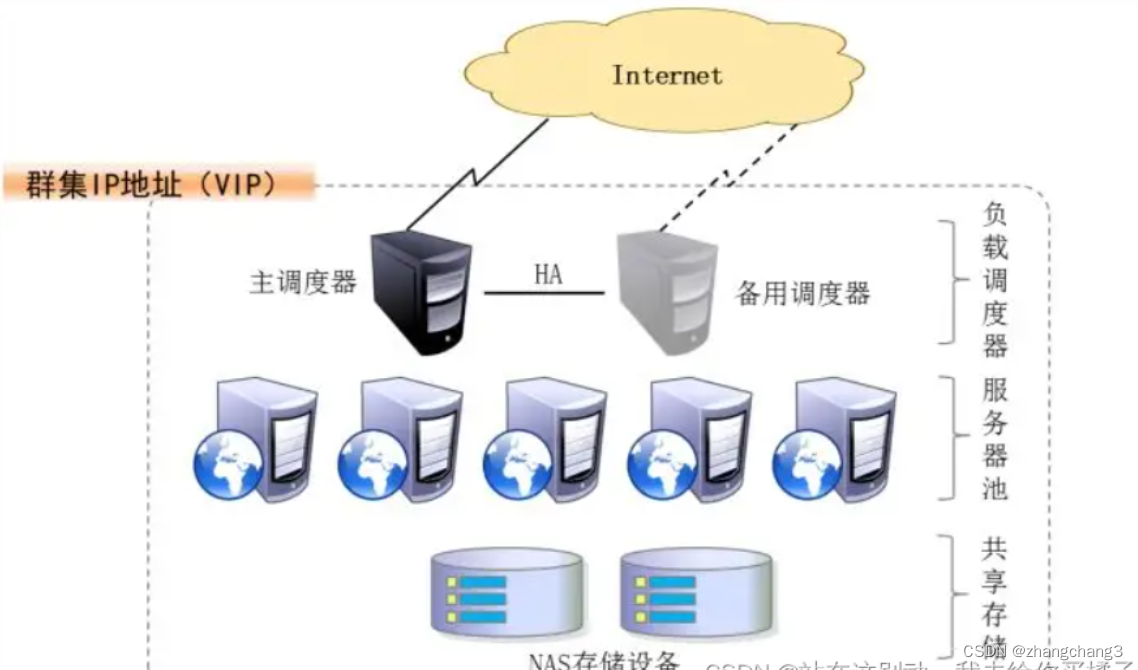

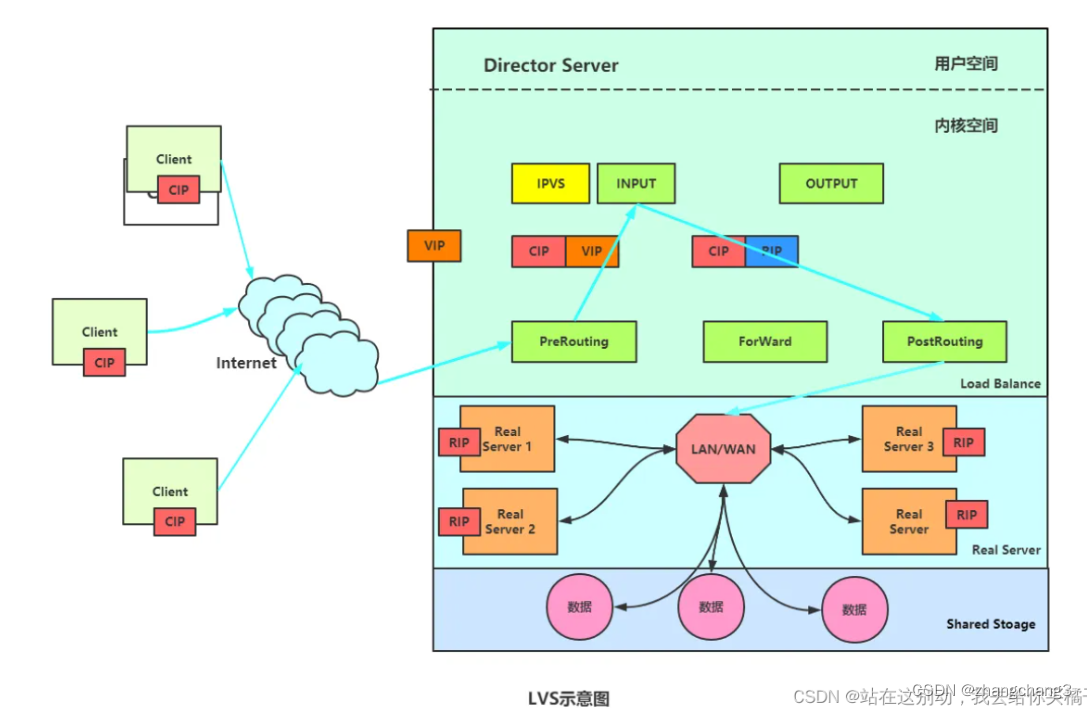

2.1 负载均衡群集架构

第一层:负载调度器 :通过VIP接收用户的请求,再通过调度算法确定要转发的节点服务器访问整个群集系统的唯一入口,对外使用所有服务器共有的VIP地址,也称为群集 IP地址。通常会配置主、备两台调度器实现热备份,当主调度器失效以后能够平滑 替换至备用调度器,确保高可用性。

第二层:服务器池中的节点服务器 : 通过RIP接收调度器转发来的请求,并处理请求进行响应群集所提供的应用服务、由服务器池承担,其中每个节点具有独立的RIP地址(真 实IP),只处理调度器分发过来的客户机请求。当某个节点暂时失效时,负载调度 器的容错机制会将其隔离,等待错误排除以后再重新纳入服务器池。

第三层:共享存储 :为各个节点服务器提供稳定、一致的文件存取服务,比如NAS+NFS,文件服务器+NFS,分布式对象存储等存储设备

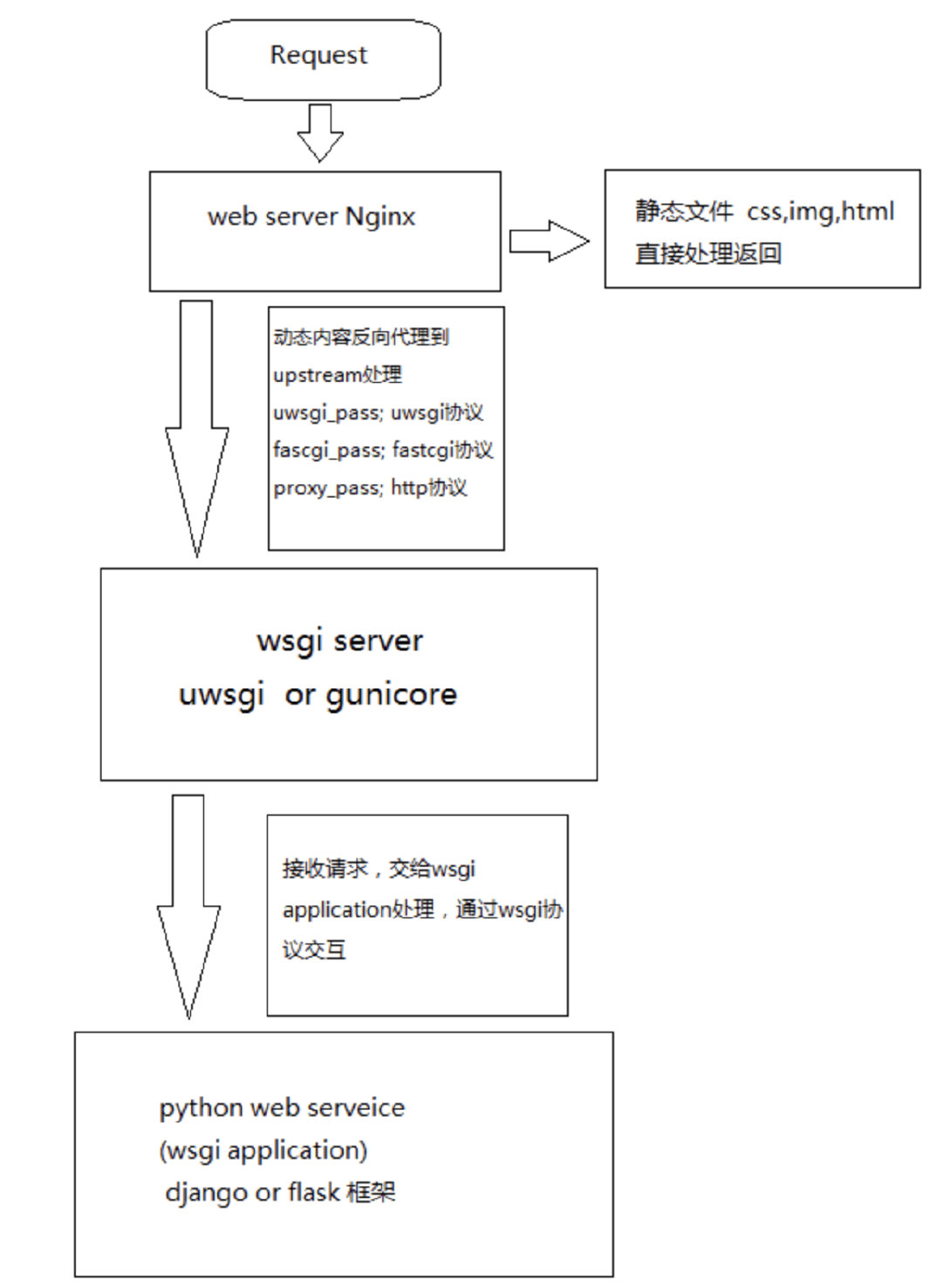

2.2 LVS的基本原理

1.当用户向负载均衡器(Director Server)发起请求,调度器将请求发送至内核空间。

2.Prerouting链首先会接收到用户请求,判断目标IP确定是本机IP,将数据包发送到INPUT链。

3.IPVS是工作在INPUT链上的,当用户请求到达INPUT时,IPVS会将用户请求和自己已经定义好的集群服务进行对比,如果用户请求的就是定义的集群服务,那么此时IPVS会强行修改数据包里的目标IP地址及端口,并将新的数据包发送到POSTROUTING链。

4.POSTROUTING链接收数据包后发现目标IP地址刚好是自己的后端服务器,那么此时通过选路,将数据包最终发送到后端的服务器。

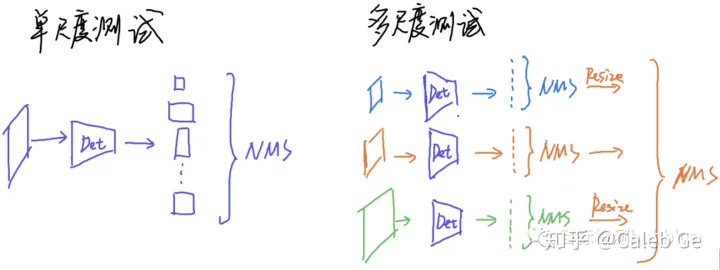

2.2 LVS负载均衡 的三种模式

群集的负载调度技术有三种工作模式:地址转换(NAT模式) ,直接路由(DR模式),IP隧道(IP-TUN)。对于商用来说,最常用是NAT模式和DR模式

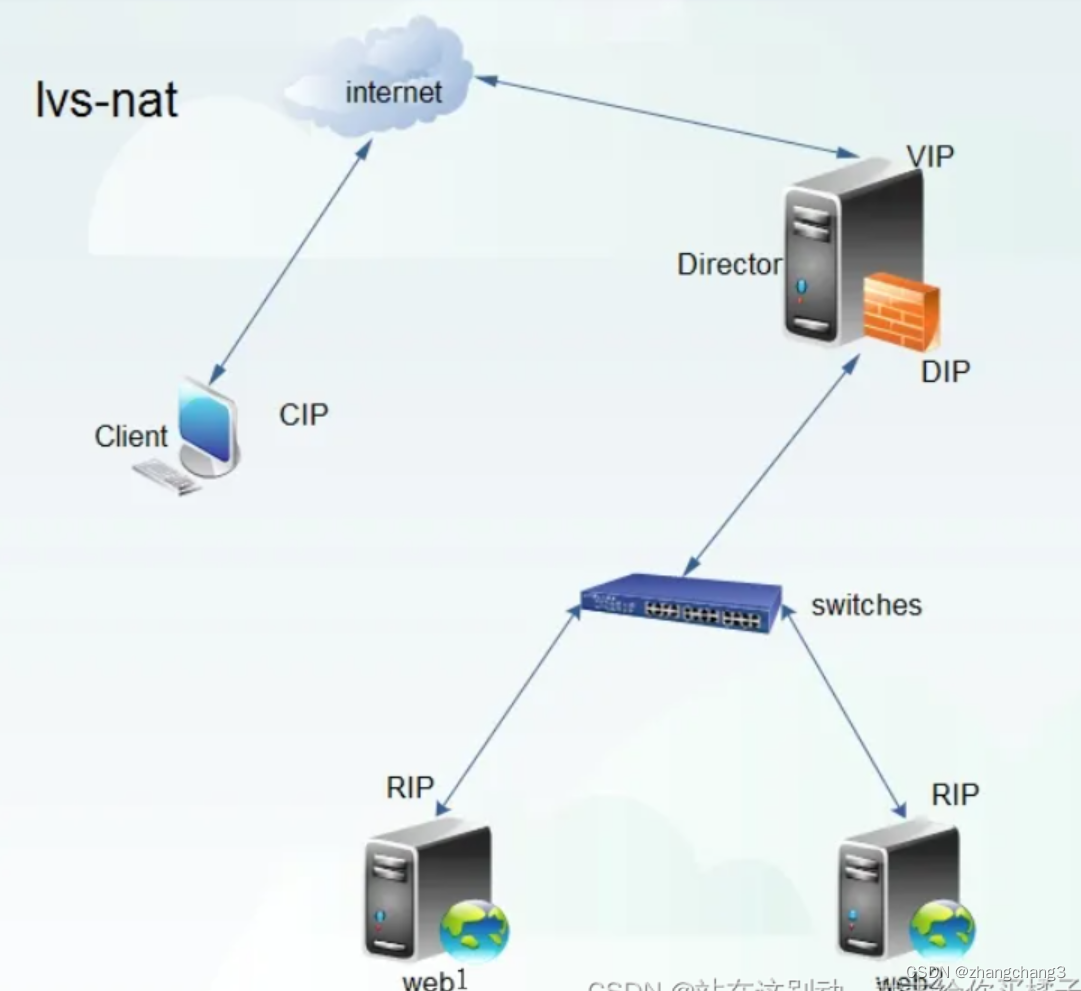

NAT(地址转换)

缺点:调度器作为所有节点服务器的网关,既作客户端的访问入口,也作节点服务器响应的访问出口,也就意味着调度器将成为整个集群系统的瓶颈。

优点:由于再转发过程中做了地址转发,对于节点服务器的安全性比其它模式较好。

调度器至少要有2个网卡,一个承载VIP用于接收客户端的请求,另一个用于使用私有IP在同一个局域网中与节点服务器相互通信。

工作原理:

(1)用户通过互联网DNS服务器解析到公司负载均衡设备上面的外网地址,相对于真实服务器而言,LVS外网IP又称VIP(Virtual IP Address),用户通过访问VIP,即可连接后端的真实服务器(Real Server),而这一切对用户而言都是透明的,用户以为自己访问的就是真实服务器,但他并不知道自己访问的VIP仅仅是一个调度器,也不清楚后端的真实服务器到底在哪里、有多少真实服务器。

(2)用户将请求发送至LVS负载均衡调度的器(同时也是网关服务器)的外网网卡上,此时LVS将根据预设的算法选择后端的一台真实服务器(内网中真实处理数据的web服务器),将数据请求包转发给真实服务器,并且在转发之前LVS会修改数据包中的目标地址以及目标端口,目标地址与目标端口将被修改为选出的真实服务器IP地址以及相应的端口。

(3)真实的服务器将响应数据包返回给LVS调度器,调度器在得到响应的数据包后会将源地址和源端口修改为VIP及调度器相应的端口,修改完成后,由调度器将响应数据包发送回终端用户,另外,由于LVS调度器有一个连接Hash表,该表中会记录连接请求及转发信息,当同一个连接的下一个数据包发送给调度器时,从该Hash表中可以直接找到之前的连接记录,并根据记录信息选出相同的真实服务器及端口信息。

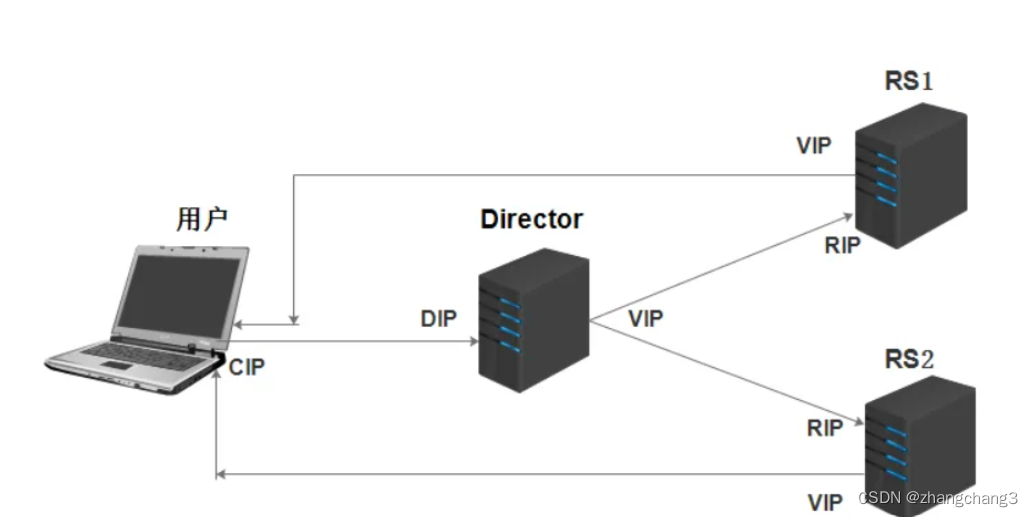

DR(直接路由)

特点: 调度器只负责接收客户端的请求,并根据调度算法转发给节点服务器;节点服务器在处理完请求后是直接响应返回给客户端,响应的数据包不经过调度器。DR模式要求调度器与后端服务器必须在同一个局域网内,VIP地址需要在调度器与后端所有的服务器间共享 。 性能比NAT模式高

调度器和节点服务器使用私有IP在同一个局域网中与节点服务器相互通信

工作原理:

(1)用户发送请求到Director Server(负载均衡器),请求的数据报文(源IP是CIP,目标IP是VIP)到达内核空间。

(2)由于Director Server和 Real Server 在同一个网络中,所以是通过二层数据链路层来传输。

内核空间判断数据包的目标IP是本机IP,此时IPVS比对数据包请求的服务是否为集群服务,若是,重新封装数据包,修改源MAC地址为DIP的MAC地址,目标MAC地址为RIP的MAC地址,源IP地址与目标IP地址没有改变,然后将数据包发送给Real Server.

(3)Real Server发现请求报文的MAC地址是自己的MAC地址,就接收此报文,重新封装报文(源IP地址为VIP,目标IP为CIP),将响应报文通过lo接口传送给物理网卡然后向外发出。

Real Server直接将响应报文传送到客户端。

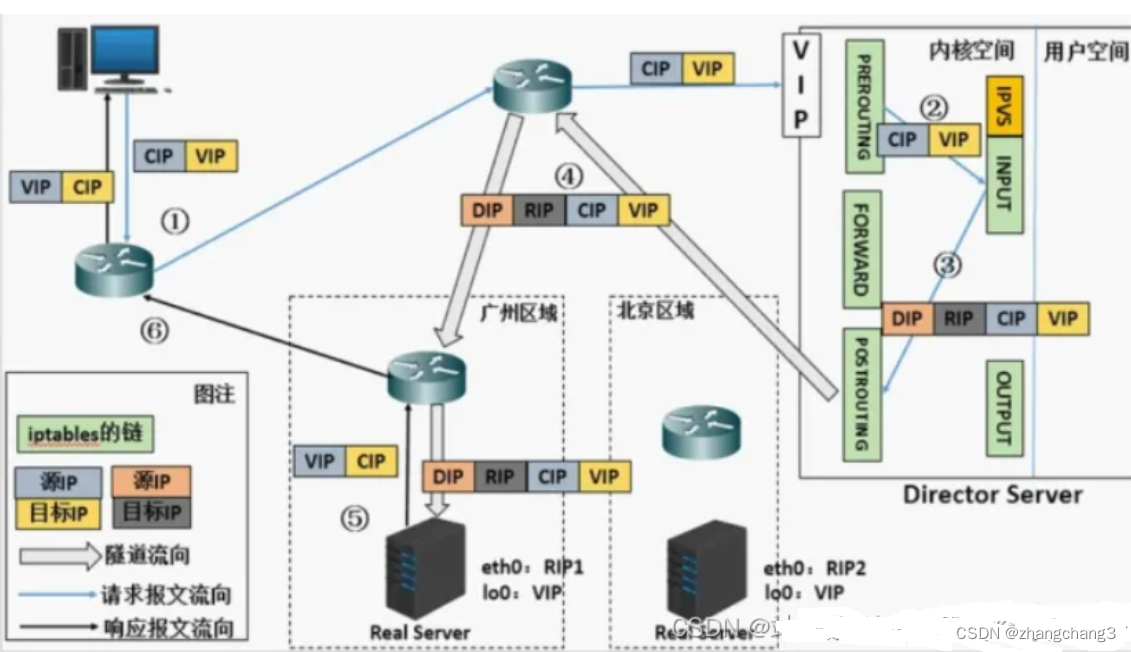

TUN(IP隧道)

架构与DR相类似,但是节点服务器分散在互联网各个位置,都具有独立的公网IP,通过专用IP隧道与调度器相互通信

采用开放式的网络结构,负载调度器仅作为客户机的访问入口,各节点通过各自的Internet连接直接回应客户机,而不再经过负载调度器。承载的压力比NAT小。

服务器节点分散在互联网中的不同位置,具有独立的公网IP地址,通过专用IP隧道与负载调度器相互通信。

缺点:成本很高。

这种模式一般应用于特殊场景,比如将节点服务器分布在全国各地,防止被物理攻击(如地震、战争等),做灾备。

(1)当用户请求到达Director Server,此时请求的数据报文会先到内核空间的PREROUTING链,此时的源IP为CIP,目标IP为VIP

(2)PREROUTING检查发现数据包的目标IP是本机,将数据包转发到INPUT链。

(3)IPVS对比数据包请求的服务是够为集群服务,若是,在请求报文的首部在封装一次IP报文,封装报文的源IP为DIP,目标IP为RIP。然后发送至POSTROUTING链。此时的源IP为DIP,目标IP为RIP

(4)POSTROUTING链根据最新封装的IP报文,将数据包发送至RS(因为在外层封装多了一层IP首部,所以可以理解为此时通过隧道传输)。此时源IP为DIP,目标IP为RIP

(5)RS接收到数据包后发现是自己的IP地址,进行解封装的操作,拆除掉最外层的IP后,会发现里面还有一层IP首部,而且目标是自己的lo接口VIP,那么此时RS处理此请求,处理完成后,通过lo接口送给eth0网卡,然后线外传递。此时的源IP地址为VIP,目标IP为CIP

(6)响应报文到达客户端

2.3 LVS虚拟机

Linux Virtual Server:针对Linux内核开发的负载均衡

1998年5月,由我国的章文嵩博士创建

官方网站:www.linuxvirtualserver.org/

LVS实际上相当于基于IP地址的虚拟化应用,为基于IP地址和内容请求分发的负载均衡提出来一种高效的解决方法

2.4 LVS的负载调度算法

2.4.1 固定调度算法:rr, wrr, dh,sh

rr:轮询算法(Round Robin)

将请求依次分配给不同的RS节点,即RS节点中均摊分配。适合于RS所有节点处理性能接近的情况。

将收到的访问请求安装顺序轮流分配给群集指定各节点(真实服务器),均等地对待每一台服务器,而不管服务器实际的连接数和系统负载。

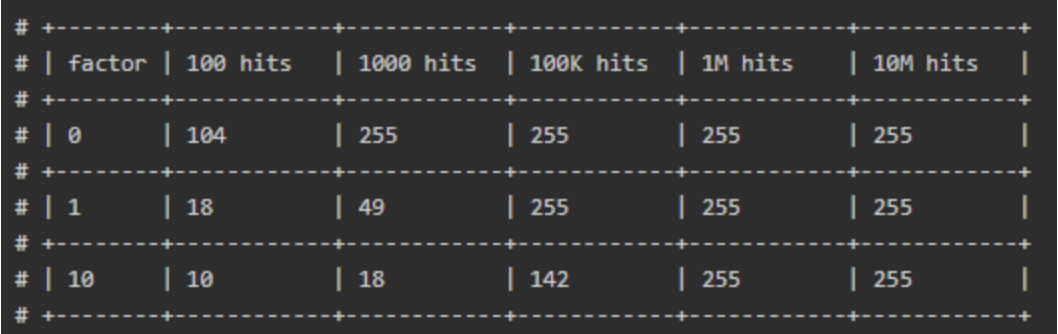

wrr:加权轮询调度(Weighted Round Robin)

依据不同RS的权重值分配任务。权重值较高的RS将优先获得任务,并且分配到的连接数将比权值低的RS更多。相同权值的RS得到相同数目的连接数。

保证性能强的服务器承担更多的访问流量。

dh:目的地址哈希调度(destination hashing)

以目的地址为关键字查找一个静态hash表来获得所需RS。

sh:源地址哈希调度(source hashing)

以源地址为关键字查找--个静态hash表来获得需要的RS。

2.4.2 动态调度算法: wlc,lc,lblc

lc:最小连接数调度( Least Connections)

ipvs表存储了所有活动的连接。LB会比较将连接请求发送到当前连接最少的RS。

根据真实服务器已建立的连接数进行分配,将收到的访问请求优先分配给连接数最少的节点。

wlc:加权最小连接数调度(Weighted Least Connections)

假设各台RS的权值依次为Wi,当前tcp连接数依次为Ti,依次取Ti/Wi为最小的RS作为下一个分配的RS。

在服务器节点的性能差异较大时,可以为真实服务器自动调整权重。

性能较高的节点将承担更大比例的活动连接负载。

lblc:基于地址的最小连接数调度(locality-based least-connection)

将来自同一个目的地址的请求分配给同一-台RS,此时这台服务器是尚未满负荷的。否则就将这个请求分配给连接数最小的RS,并以它作为下一次分配的首先考虑

3. LVS部署前的必备掌握

3.1 ipvsadm 工具选项说明

3.1 ipvsadm 工具选项说明

ipvsadm的选项 作用

-A 添加虚拟服务器

-D 删除整个虚拟服务器

-s 指定负载调度算法(轮询:rr、加权轮询:wrr、最少连接:lc、加权最少连接:wlc)

-a 表示添加真实服务器(节点服务器)

-d 删除某一个节点

-t 指定 VIP地址及 TCP端口

-r 指定 RIP地址及 TCP端口

-m 表示使用 NAT群集模式

-g 表示使用 DR模式

-i 表示使用 TUN模式

-w 设置权重(权重为 0 时表示暂停节点)

-p 60 表示保持长连接60秒(默认关闭连接保持)

-l 列表查看 LVS 虚拟服务器(默认为查看所有)

-n 以数字形式显示地址、端口等信息,常与“-l”选项组合使用。ipvsadm -ln

3.2 ip_vs通用模块

ls /usr/lib/modules/3.10.0-693.el7.x86_64/kernel/net/netfilter/ipvs

LVS现在已成为 Linux 内核的一部分,默认编译为 ip_vs 模块,必要时能够自动调动。

在CentOS 7 系统中,手动加载 ip_vs 模块的命令如下:

modprobe ip_vs //手动加载 ip_vs 模块

cat /proc/net/ip_vs //查看当前系统中ip_vs模块的版本信息

加载所有LVS调度算法的for循环方式:

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

LVS负载均衡-NAT模式的部署

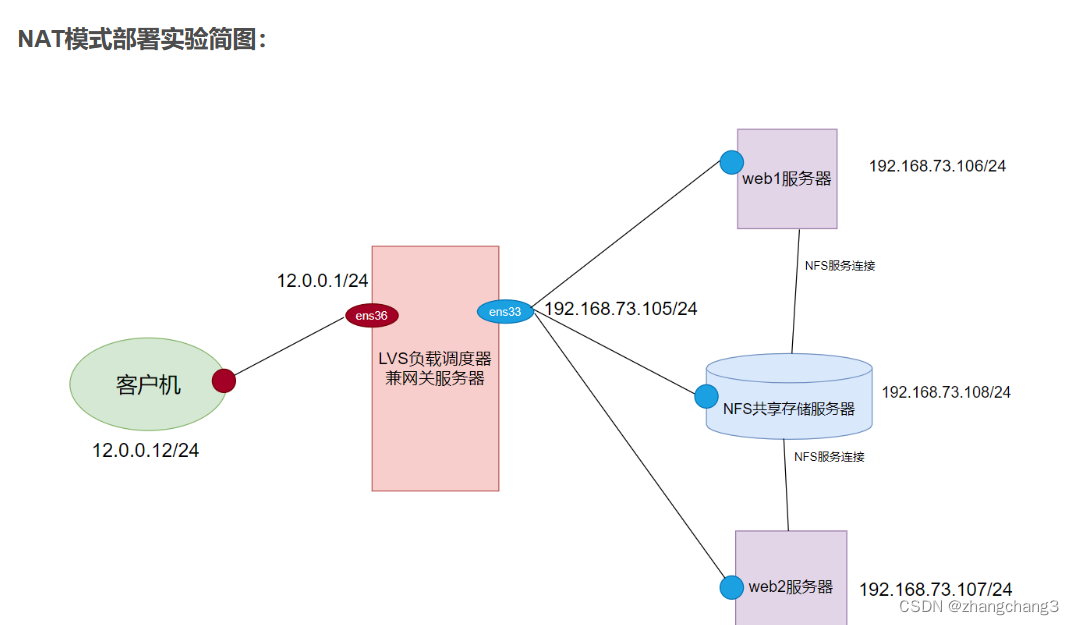

4.1 NAT模式实验部署操作前的准备设计以及需求构想

实验需求

通过NAT模式使外网客户机能够访问到相关的web服务,并且LVS调度器使内网中的web服务器达到负载均衡的效果。此外NFS共享存储为web服务提供更大的存储空间

实验设备准备

需要五台虚拟机(一台web1服务器,一台web2服务器,一台负载均衡调度器,一台NFS共享存储机,一台外网客户机做测试作用)

各设备的IP设置如下:

负载调度器:内网关 ens33:192.168.50.23,外网关 ens35:12.0.0.1

Web节点服务器1:192.168.50.21

Web节点服务器2:192.168.50.22

NFS服务器:192.168.50.20

客户端:12.0.0.12

六、LVS-NAT模式操作实例

LVS调度器作为Web服务器池的网关,LVS两块网卡,分别连接内外网,使用轮询(rr)调度算法。

实验环境:

一台NFS服务器: 192.168.50.20/24

两台WEB服务器: 192.168.50.21/24,192.168.50.22/24

一台LVS负载调度服务器(2块网卡): 内网192.168.50.23/24(ens33),外网12.0.0.254/24(ens35)

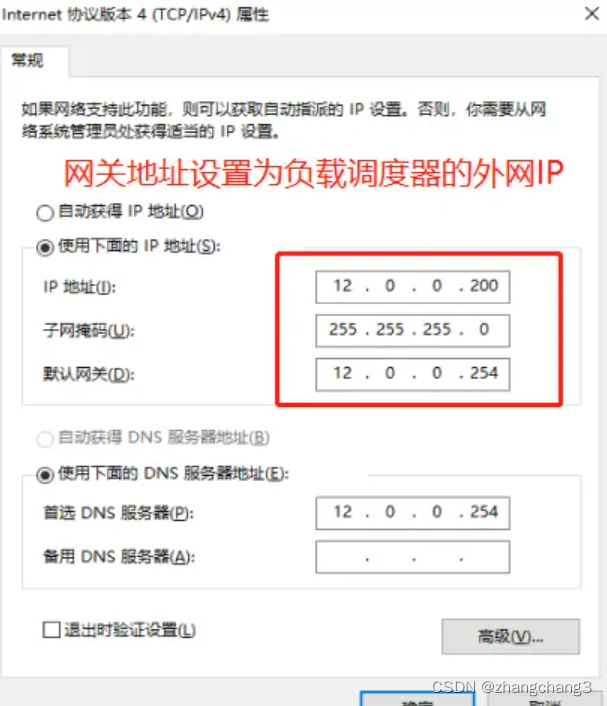

win10 客户机: 12.0.0.200/24

6.1 部署NFS共享存储服务(NFS服务器:192.168.50.20/24)

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

vim /etc/selinux/config

SELINUX=disabled

yum install nfs-utils rpcbind -y

systemctl start rpcbind.service

systemctl start nfs.service

systemctl enable nfs.service

systemctl enable rpcbind.service

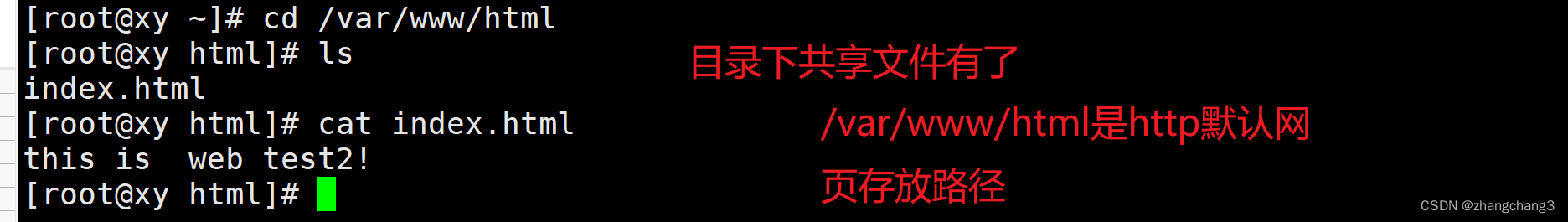

mkdir /opt/web1 /opt/web2

chmod 777 /opt/web1 /opt/web2

echo 'this is web test1 !' > /opt/web1/index.html

echo 'this is web test2!' > /opt/web2/index.html

vim /etc/exports

/usr/share *(ro,sync)

/opt/web1 192.168.50.0/24(rw,sync)

/opt/web2 192.168.50.0/24(rw,sync)

--发布共享---

exportfs -rv

6.2 部署两台WEB服务器(节点服务器)

(192.168.50.21/24 192.168.50.22/24)

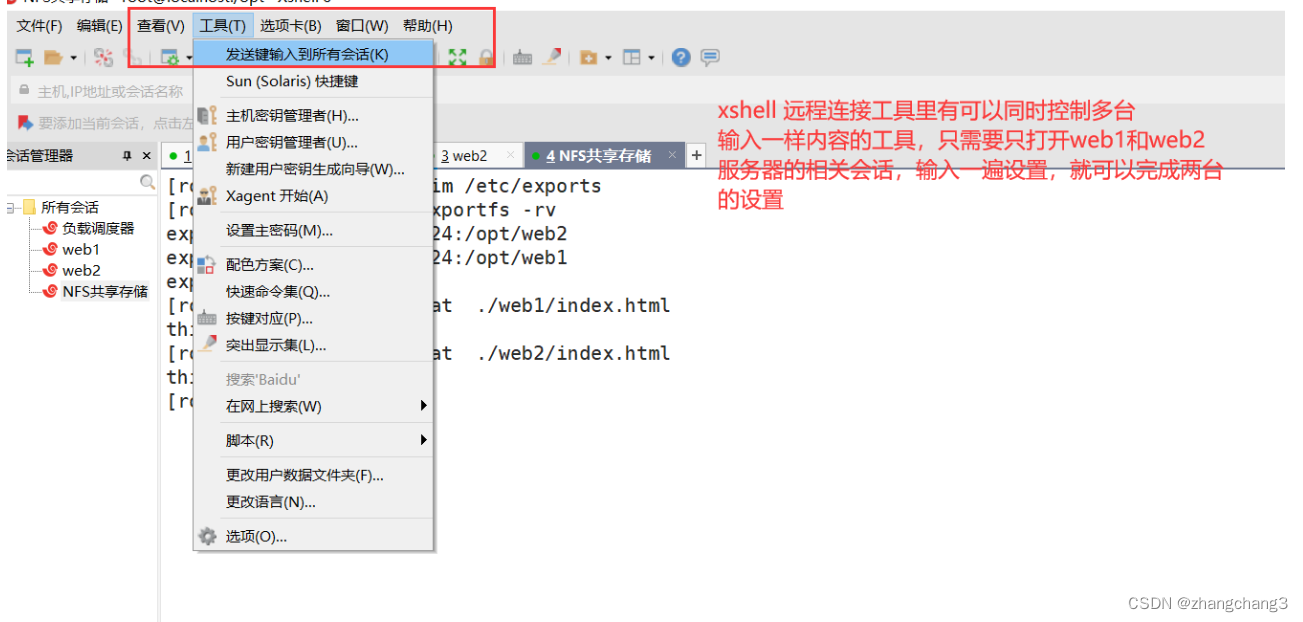

快捷工具使用:

两台web节点服务器相同的操作:

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

vim /etc/selinux/config

SELINUX=disabled

yum install httpd -y

systemctl start httpd.service

systemctl enable httpd.service

yum install nfs-utils rpcbind -y

showmount -e 192.168.50.20

systemctl start rpcbind

systemctl enable rpcbind

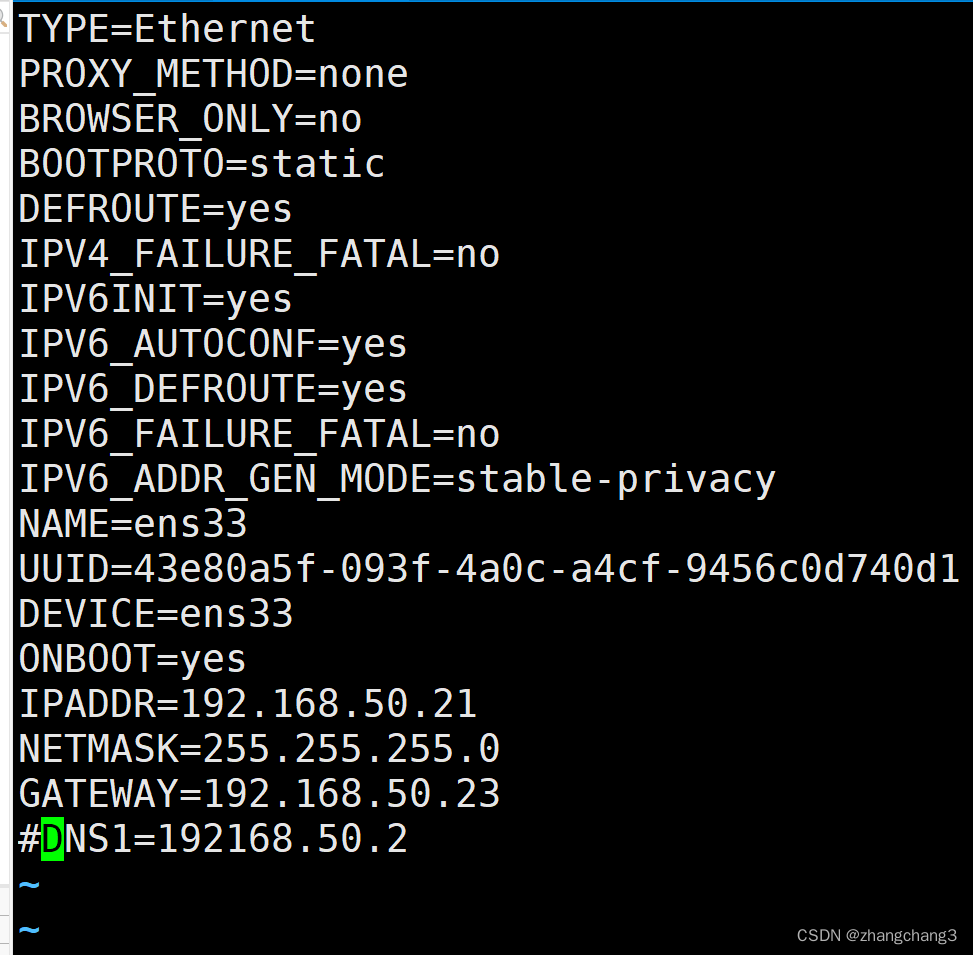

web1节点服务器的后续操作:

vim /etc/fstab

192.168.50.20:/opt/web1 /var/www/html nfs defaults,_netdev 0 0

mount -a网关地址要改写成调度器的地址

systemctl restart network 重启网络

web2节点服务器的后续操作:

vim /etc/fstab

192.168.50.20:/opt/web2 /var/www/html nfs defaults,_netdev 0 0

mount -a

网关也同样的设置

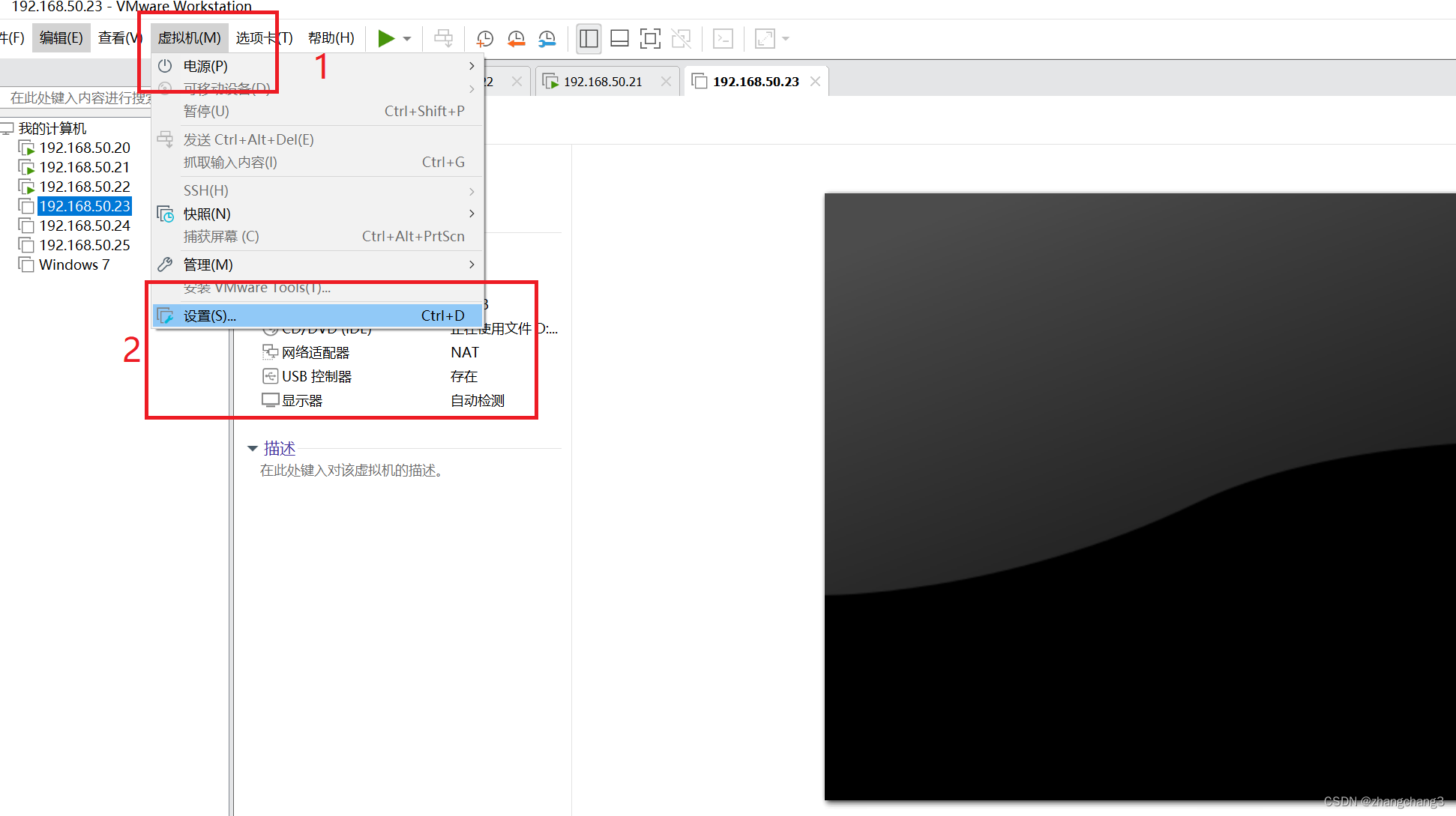

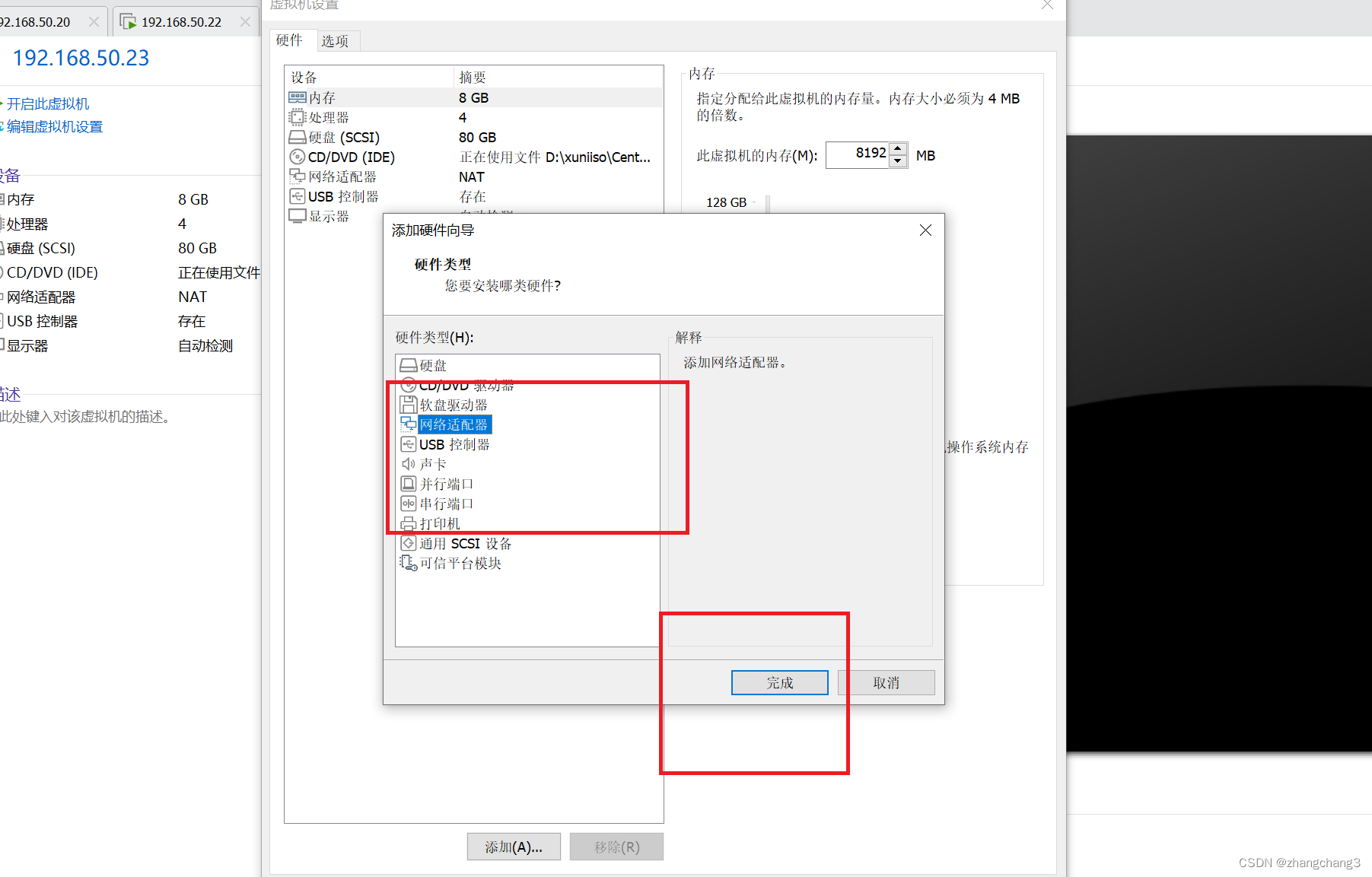

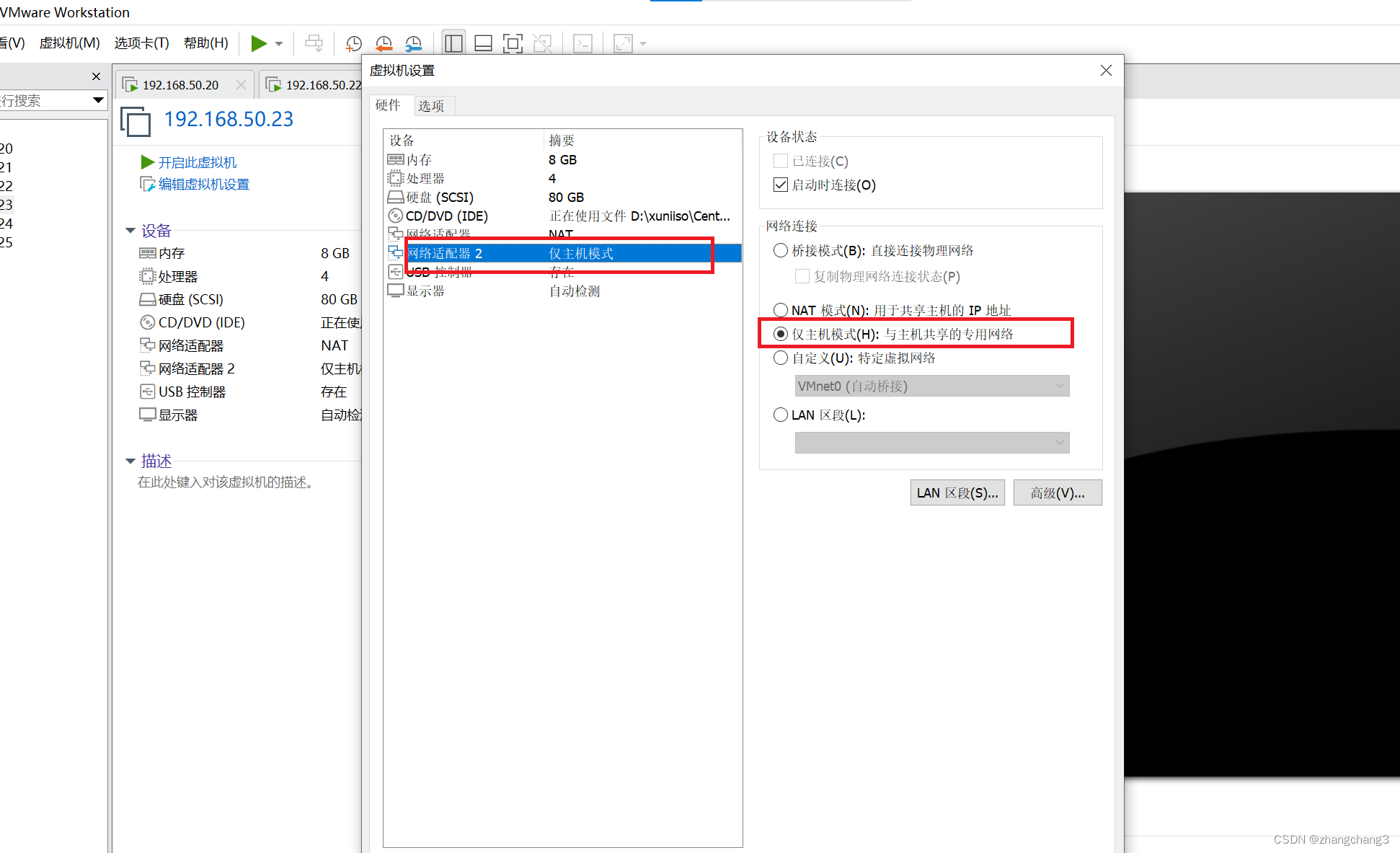

6.3 部署LVS负载调度服务器

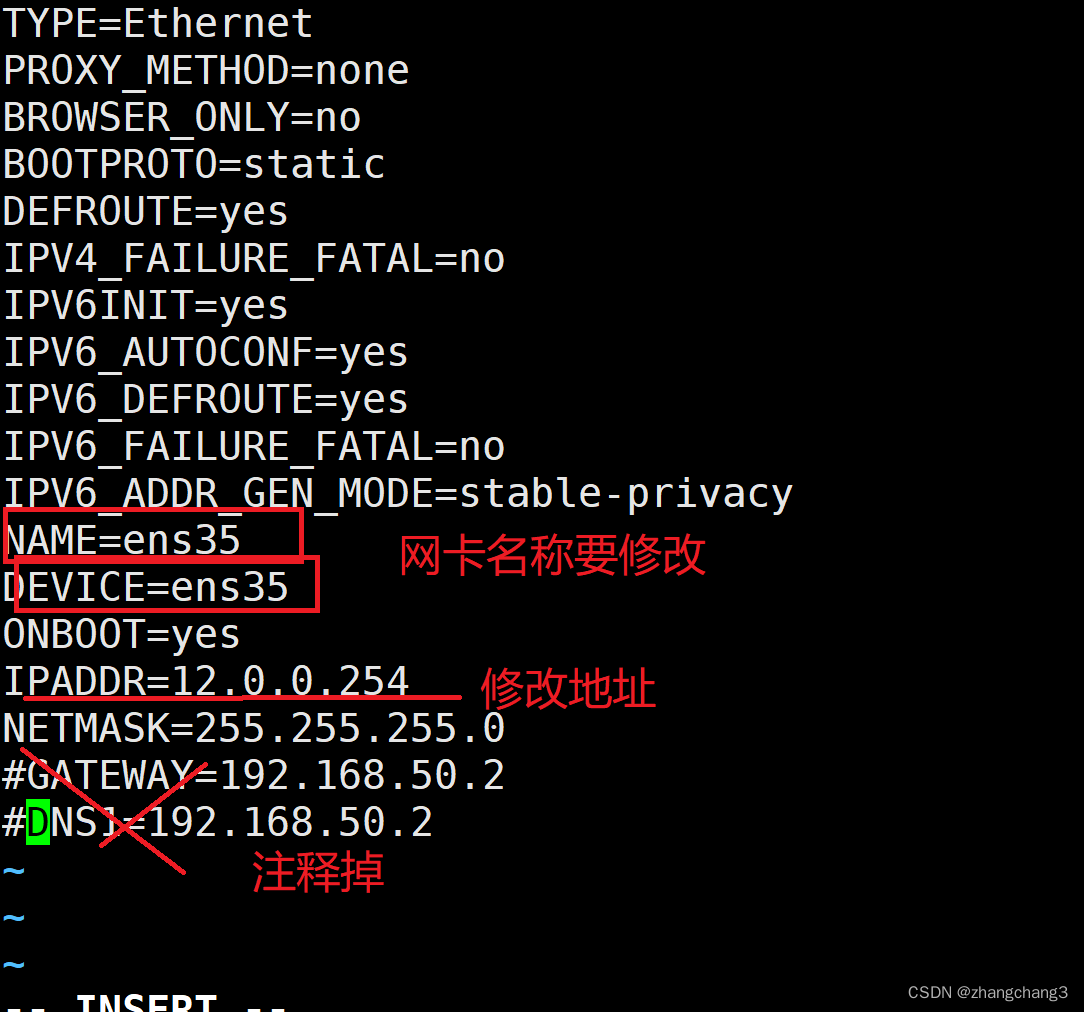

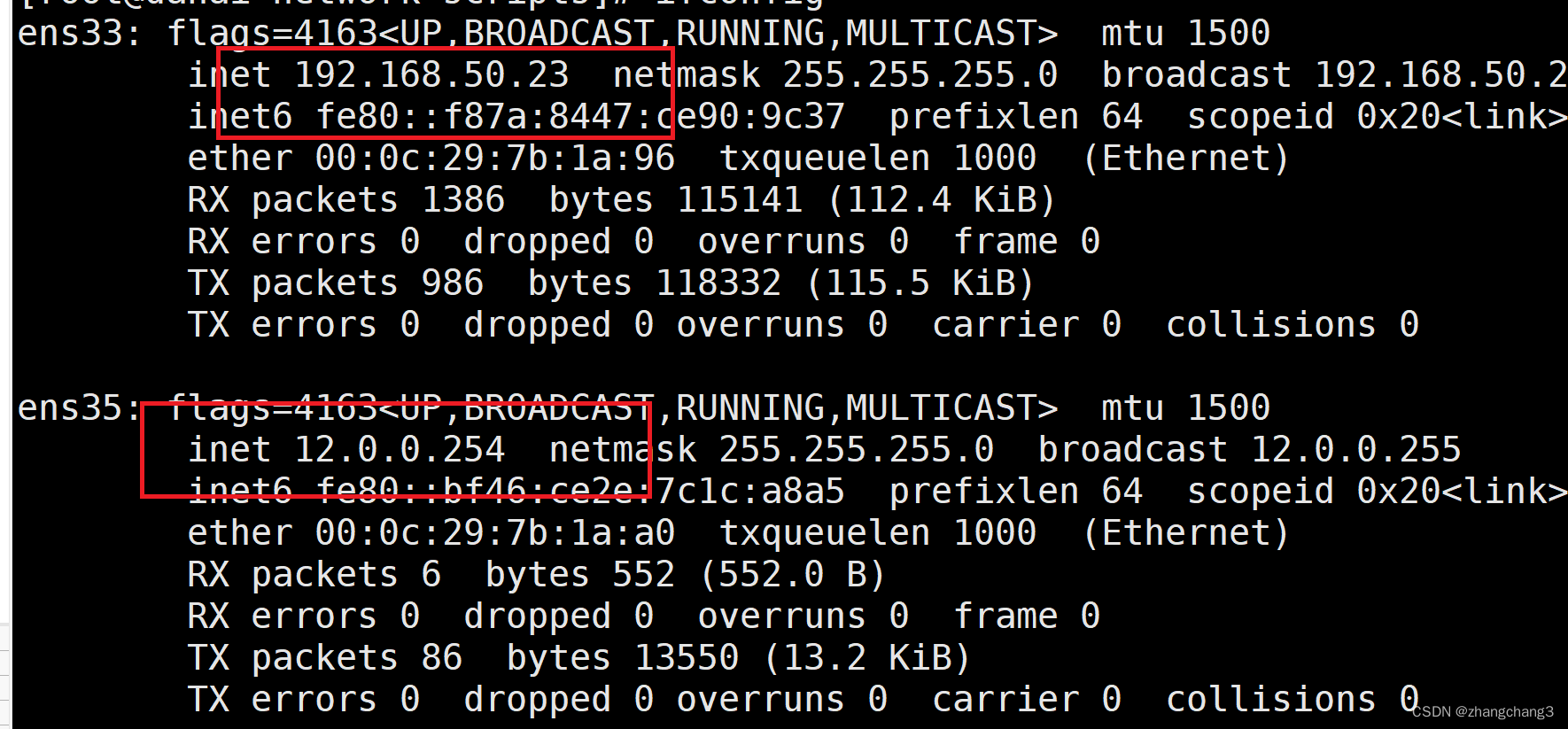

内网网卡:192.168.50.10(ens33) ,外网网卡:12.0.0.254(ens35)

首先要添加一张网卡(仅主机模式)

cd /etc/sysconfig/network-scripts/

vim ifcfg-ens33

#GATEWAY=192.168.72.2 //将网卡和DNS服务器地址注释掉

#DNS1=8.8.8.8

cp ifcfg-ens33 ifcfg-ens35 添加ens35的网卡配置文件

vim ifcfg-ens35

重启网络后,用ifconfig 查看网络

3、开启路由转发功能

[root@www ~]# vim /etc/sysctl.conf

net.ipv4.ip_forward = 1 //添加这一行

[root@www ~]# sysctl -p //读取修改后的配置

net.ipv4.ip_forward = 1

#4、配置SNAT策略(如果内网想主动连接外网的话,需要配置SNAT策略)

[root@www ~]# iptables -t nat -F

[root@www ~]# iptables -t nat -A POSTROUTING -s 192.168.50.0/24 -o ens36 -j SNAT --to 12.0.0.254

[root@www ~]# iptables -nL POSTROUTING -t nat

#5、加载LVS内核模块

[root@www ~]# modprobe ip_vs //加载ip_vs模块

[root@www ~]# cat /proc/net/ip_vs //查看ip_vs模块的版本

#加载LVS所有调度算法

[root@www ~]# for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

#6、安装ipvsadm管理工具,开启服务

[root@www ~]# mount /dev/sr0 /mnt

[root@www ~]# yum install -y ipvsadm

#开启服务前必须保存负载分配策略,生成/etc/sysconfig/ipvsadm文件。如果该文件不存在,服务无法启动。

[root@www ~]# ipvsadm-save >/etc/sysconfig/ipvsadm

[root@www ~]# systemctl start ipvsadm.service

#7、配置负载分配策略(NAT模式只需要在负载器上配置,节点服务器不需要特殊配置)

[root@www ~]# ipvsadm -C //清空原有规则

#指定指定VIP地址及TCP端口,-s rr 指定负载调度策略为轮询

[root@www ~]# ipvsadm -A -t 12.0.0.254:80 -s rr

#先指定虚拟服务器再添加真实服务器地址,-r指定真实服务器地址,-m指定nat模式。-w指定权重值,权重为1时可省略不写

[root@www ~]# ipvsadm -a -t 12.0.0.254:80 -r 192.168.50.21:80 -m -w 1

[root@www ~]# ipvsadm -a -t 12.0.0.254:80 -r 192.168.50.22:80 -m -w 1

[root@www ~]# ipvsadm //查看策略

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP localhost.localdomain:http rr

-> 192.168.72.30:http Masq 1 0 0

-> 192.168.72.40:http Masq 1 0 0

[root@www ~]# ipvsadm-save >/etc/sysconfig/ipvsadm //保存负载分配策略

[root@www ~]# ipvsadm -ln //以数字形式查看策略,Masq表示NAT模式

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 12.0.0.254:80 rr

-> 192.168.72.30:80 Masq 1 0 0

-> 192.168.72.40:80 Masq 1 0 0

6.4 win10客户机访问测试

win10客户机,网关地址设置为负载调度器的外网IP。

浏览器访问负载调度器的外网IP地址12.0.0.254。