答:不一定

概念

1、是否需要GPU与应用是否图形处理应用无关

2、文本内容智能体大多也需要GPU来提供更好的性能

3、DeepSeek模型在非图形智能体的应用中是否需要GPU取决于具体的模型版本和部署环境

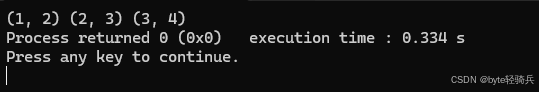

不需要GPU的模型版本

- DeepSeek-R1-1.5B: 这个模型对硬件要求较低,可以使用纯CPU进行推理,不需要GPU。它适用于资源有限的设备,如树莓派、旧款笔记本、嵌入式系统或物联网设备。

需要GPU的模型版本及其推荐显卡

- DeepSeek-R1-7B:推荐使用8GB及以上显存的显卡,如RTX 3070或4060,适用于中小型企业本地开发测试和中等复杂度的自然语言处理任务。

- DeepSeek-R1-8B:硬件需求与7B版本相近,推荐使用8GB及以上显存的显卡,适用于需要更高精度的轻量级任务。

- DeepSeek-R1-14B:需要16GB及以上显存的显卡,如RTX 4090或A5000,适用于企业级复杂任务。

- DeepSeek-R1-32B:需要24GB及以上显存的显卡,如A100 40GB或双卡RTX 3090,适用于高精度专业领域任务。

- DeepSeek-R1-70B:需要多卡并行,如2张A100 80GB或4张RTX 4090,适用于科研机构或大型企业的高复杂度生成任务。

GPU和CPU在深度学习中的作用

- CPU:主要负责处理一般的控制逻辑和低强度的计算任务。虽然现代CPU可以胜任一些小规模的深度学习任务,但在处理大规模深度学习模型时表现不如GPU。

- GPU:专门为处理大量并行计算任务设计,特别适合深度学习中的矩阵计算和浮点运算。GPU能够显著加速训练过程,尤其是在图像识别、自然语言处理等计算密集型任务中不可或缺。

应用实践

DeepSeek-R1-32B 的硬件要求需根据部署场景(本地/服务器)和任务类型(推理/训练)区分,核心配置集中在 GPU 显存、计算能力和系统资源。

关键硬件配置要求

-

GPU 显存与型号

- 最低要求:单卡显存 ≥24GB(如 RTX 4090),通过多卡并行(如 2 张 RTX 4090)满足总显存 ≥48GB 的半精度推理需求。

- 推荐配置:

- 推理场景:单卡显存 ≥48GB(如 NVIDIA L20 或 A100),支持全精度模型运行。

- 训练场景:需更高显存(如 A100/H100 80GB)及多卡并行(如 8 卡 A100),以满足吞吐量需求。

-

CPU 与内存

- CPU:推荐多核处理器(如 Intel i9-12900K 或 AMD Ryzen 9 5900X),主频 ≥3.5GHz,支持多线程计算。

- 内存:

- 推理场景:≥64GB DDR4,避免性能瓶颈。

- 训练场景:≥192GB,确保模型权重和中间结果缓存。

-

存储与电源

- 存储:推荐 2TB NVMe SSD(如三星 980 Pro),缩短模型加载时间。

- 电源:≥1000W 金牌电源,保障高性能硬件稳定运行。

-

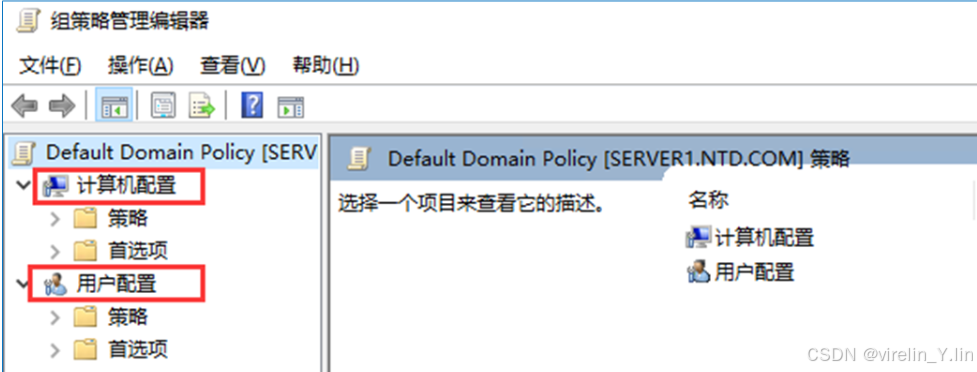

操作系统

- 优先选择 Ubuntu 22.04 LTS(深度学习生态完善),次选 Windows 11(兼容性较好)。

不同场景下的配置差异

- 本地部署(如个人工作站):

- 可选用 RTX 4090(24GB 显存)双卡组合,搭配 64GB 内存和高速 SSD,满足半精度推理需求。

- 服务器/云服务部署:

- 需单卡显存 ≥48GB(如 A100 80GB),支持全精度运行,并配备高带宽(≥10M)和 API 访问资源。

注意事项

- 若涉及合规性要求(如国产化),可选用 NVIDIA L20 等特定型号 GPU。

- 显存容量直接影响模型能否全量加载,需根据任务精度(FP16/FP8)灵活调整配置。

如需进一步优化性能,可探索NVIDIA A100、RTX 4090 或Ubuntu 22.04 LTS 的调参方案。

NVIDIA两款显卡介绍

NVIDIA A100 核心特性解析

当前(2025年04月)约合人民币:2.8W

一、硬件架构

- Ampere 架构:基于7nm制程工艺,采用第三代Tensor Core设计,支持FP64、TF32、BFLOAT16及INT8多种精度计算,混合精度性能相比前代V100提升达20倍。

- HBM2e显存:配备40GB显存和1.6TB/s带宽,可支持参数规模超过20亿的模型训练,并通过异步复制机制减少显存等待时间。

- 第三代NVLink:提供600GB/s双向带宽,显著提升多卡并行效率,适用于分布式训练场景。

二、核心技术

- 多实例GPU(MIG):将单卡物理资源划分为最多7个独立实例,每个实例具备完整运算能力,支持不同规模工作负载的物理隔离与性能保障。

- 动态稀疏加速:通过硬件级稀疏计算单元跳过零值计算,在自然语言处理等场景中额外获得2倍加速效果。

- 异步执行机制:允许计算与数据预取并行,实测在ResNet-50训练中减少约15%的显存等待时间。

三、性能表现

- 算力参数:

- FP16理论算力达19.5 TFLOPS,结合混合精度计算可实现624 TFLOPS的AI性能。

- 相比V100,能效提升3倍,训练任务耗时从数周缩短至数小时。

- 适用场景:覆盖AI训练/推理、高性能计算(HPC)、数据分析等,尤其擅长处理大规模科学计算和深度学习任务。

四、应用场景与部署

- 数据中心:作为弹性计算单元,支持AI工厂、云图形、数据孪生等新型数据中心需求。

- 工作组服务器:例如NVIDIA DGX Station A100,提供专用AI资源优化,满足数据科学团队对算力与安全性的需求。

- 跨平台兼容性:通过软件栈优化和集群配置方案,实现从单卡调试到大规模集群扩展的无缝衔接。

五、后续产品对比

- H100 GPU:基于Hopper架构,FP16算力提升至2000 TFLOPS(约为A100的6倍),但A100仍凭借成熟的MIG技术和性价比,在中小规模场景中保持竞争力。

NVIDIA L20 核心特性解析

当前(2025年04月)约合人民币:2.8W

一、硬件架构与基础参数

- Ada Lovelace 架构:基于5nm制程工艺,配备10240个CUDA核心和368个Tensor Core,支持FP32、FP16及FP8精度计算。

- 显存配置:搭载48GB显存(GDDR6或HBM3),带宽最高达1.9TB/s,显存位宽384位,支持大规模模型训练与多任务并行。

- 接口与功耗:采用PCIe 4.0 x16接口,功耗275W,兼容主流服务器部署方案。

二、性能表现

- 算力参数:

- FP32理论算力90 TFLOPS,FP16算力119.5 TFLOPS,FP8精度下性能与A800相当。

- 支持动态稀疏加速,在大语言模型(如Baichuan2-13B)和Stable Diffusion场景中实测性能显著优于消费级显卡。

- 能效优势:相比A800,FP16预训练性能达其65%,但FP8优化后性价比提升,功耗仅为同类SXM5系统的三分之一。

三、应用场景

- AI训练与推理:支持大模型预训练、微调及推理任务,实测LLaMA-Factory框架下性能为L40s的80%~86%。

- 云端与数据中心:适用于大规模AI推理、数据分析及图形渲染,满足云服务商对高并发、低延迟的需求。

- 多任务处理:48GB显存支持复杂模型并行计算,可处理图像识别、自然语言处理等混合负载。

四、对比分析

- 与A800对比:FP16性能约为A800的65%,但FP8优化后接近其水平,显存容量更大,适合长序列模型处理。

- 与RTX 4090对比:L20侧重云端推理与专业计算,显存容量和带宽优势明显;RTX 4090聚焦消费级图形渲染,性价比侧重不同领域。

五、部署方案

- 服务器配置示例:H3C R5300 G6平台支持8卡部署,搭配Intel Xeon 6430处理器、64GB DDR5内存及7.68TB NVMe SSD,适用于高密度AI集群。