【论文速递】WACV2022 - 基于小样本分割的多尺度Non-Novel片段消除方法

【论文原文】:Elimination of Non-Novel Segments at Multi-Scale for Few-Shot Segmentation

获取地址:https://openaccess.thecvf.com/content/WACV2023/papers/Kayabasi_Elimination_of_Non-Novel_Segments_at_Multi-Scale_for_Few-Shot_Segmentation_WACV_2023_paper.pdf

博主关键词: 小样本学习,语义分割,多尺度,类别纠缠

推荐相关论文:

【论文速递】CVPR2022 - 学习 什么不能分割:小样本分割的新视角

- https://blog.csdn.net/qq_36396104/article/details/128658168

【论文速递】TPAMI2022 - 小样本分割的整体原型激活

- https://blog.csdn.net/qq_36396104/article/details/128664715

摘要:

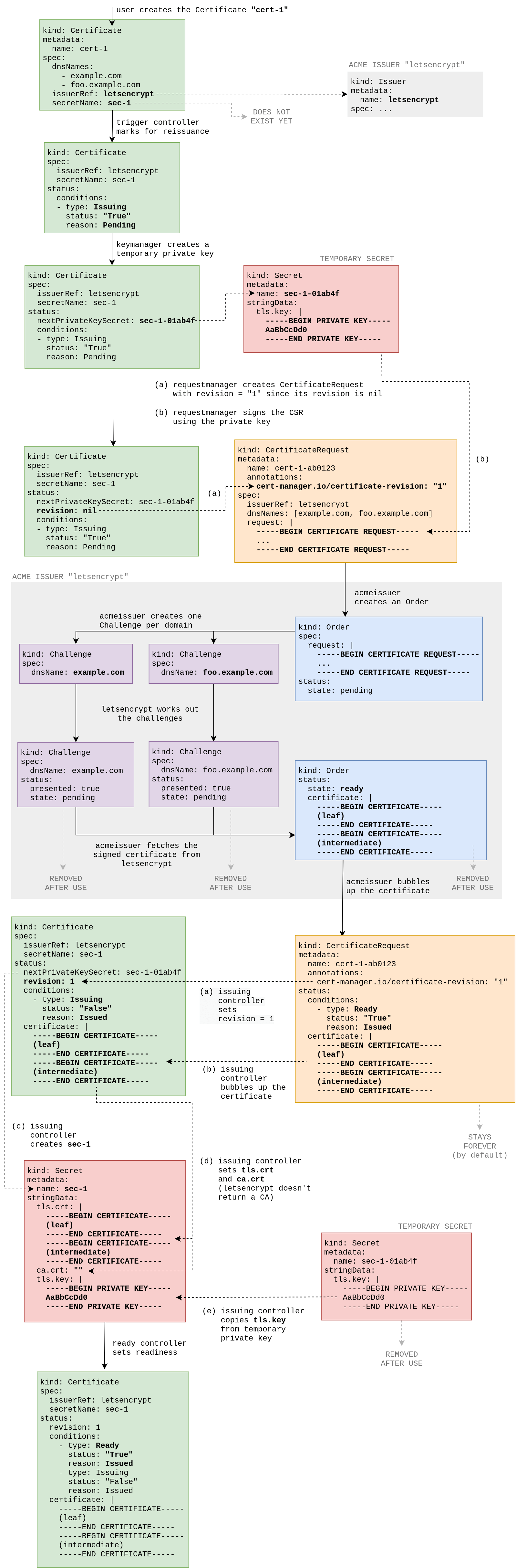

小样本分割的目的是设计一个泛化模型,在训练过程中,在少数支持图像的指导下,将查询图像从未见的类中分割出来,这些支持图像的类与查询的类一致。在以往的研究中,存在着两个领域特有的问题,即空间不一致性和对可见类的偏向。 考虑到前一个问题,我们的方法在多尺度上比较支持特征图和查询特征图,使其成为尺度不可知的。为了解决后一个问题,在可用的类上训练一个监督模型,称为基础学习器,以准确地识别属于所见类的像素。因此,后续元学习器有机会在集成学习模型的帮助下丢弃属于已见类的区域 ,该集成学习模型协调元学习器和基础学习器。我们首次同时解决了这两个关键问题,并在PASCAL-5i和COCO-20i数据集上实现了最先进的性能。

简介:

语义分割是一项至关重要的任务,它对图像的每个像素进行分类,以理解自动驾驶[5]和医学成像[19]等应用领域的场景。像计算机视觉的其他任务一样,深度学习渗透语义分割[2,15]。监督分割模型需要使用训练集中每个类的丰富的标注数据,因为标注数据稀缺会降低监督模型的泛化能力。因此,要使模型适应于不可见的类,就需要对来自新类的无数数据进行密集注释。Shaban et al.[20]首次提出了小样本分割(few-shot segmentation),以消除标记的工作量,增加模型在给定少量数据时的泛化能力。

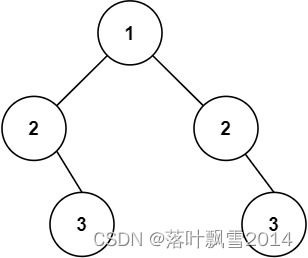

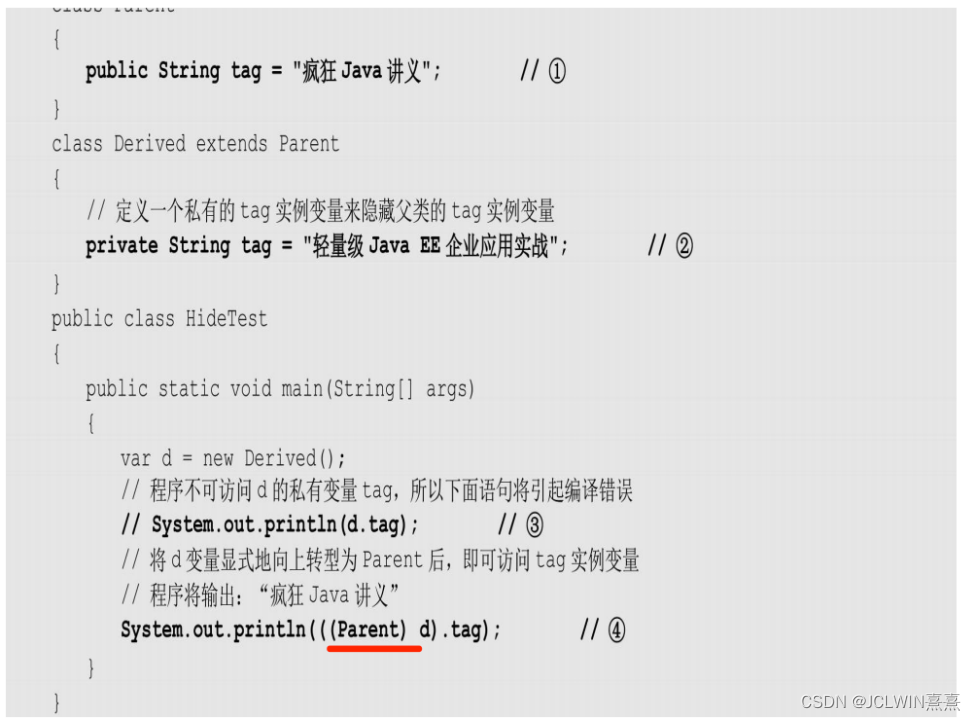

小样本分割解决了在同一类别的支持图像的指导下,从一个未见的类中对目标图像(称为查询)进行像素级预测的问题。受小样本分类任务[23]的启发,大多数方法都利用了情景训练策略,其中的梯度被平均为一个插曲。每一集都从一个数据集采样,该数据集的类与只有少量可用数据的测试用例分离。这些片段用于在训练期间模拟测试用例,以防止过拟合。尽管有这样的意图,但使用这种策略训练的模型往往会将来自已见训练类(称为基类)的片段误认为新类,因为在训练期间不断地经历相同的类集。因此,新类和基类在同一场景中同时出现会导致新类和基类像素的特征之间的纠缠。

为了防止这种纠缠,在基类上训练的监督模型的预测指导元学习器,元学习器负责检测新区域。元学习器被引导到基类未占用的区域,因此通过包含基预测和元预测的集成模型避免了基学习器和元学习器之间的矛盾[10]。 在元学习器方面,查询图像中的候选对象可能与支持图像中的候选对象覆盖的区域不同;因此,该模型需要在不同分辨率下比较支持特征图和查询特征图,以分离出新分割段[22]周围的相邻区域。 如图1所示,在没有改进解码器的情况下,基元学习器和元学习器的集成无法区分背景和前景,这是因为针对监督方案设计的naive解码器缺乏将不同分辨率的特征组合在一起以实现完整的查询预测。因此,我们将朴素解码器转换为一种改进的解码器,这样不仅可以在多分辨率下将支持图像与查询图像关联起来,而且还可以利用基学习器在多分辨率下的优点。在这方面,我们假设在某些情况下,单尺度基础学习器不鼓励元学习器来自基础区域是不够的。实验结果表明,改进后的多尺度预测集成解码器性能优于单尺度预测集成解码器。我们在本文中的贡献有两个方面:

- 在我们提出的解码器的帮助下,我们缓解了空间不一致和偏差问题,解码器寻求在多分辨率下消除偏差。

- 我们提出的方法在PASCAL-5i (mIoU @ 1-shot: 68.59%, mIoU @ 5-shot: 72.05%)和COCO-20i (mIoU @ 1-shot: 47.16%, mIoU @ 5-shot: 52.50%)数据集上实现了新的最先进的性能,用于小样本分割任务。

【社区访问】

【论文速递 | 精选】

【论文速递 | 精选】

阅读原文访问社区

阅读原文访问社区

https://bbs.csdn.net/forums/paper