背景

由于llama2模型的下载需要经过官方的授权,这就需要登陆hugging face的,对模型页面进行申请。等待审核通过后,才能够下载。如果在单纯用 git lfs 的方式进行下载,需要输入账号和密码。为了更快速地进行下载,既能够设置密码、也能够设置代理,采用脚本的方式会更加合适,不会因为随便改动代理而引发其他问题。

具体实现

使用huggingface_hub进行下载。首先安装huggingface_hub库:

pip install huggingface_hub

huggingface_hub提供了多种模型下载的方案:huggingface_hub 下载方法 感兴趣可以进一步阅读。

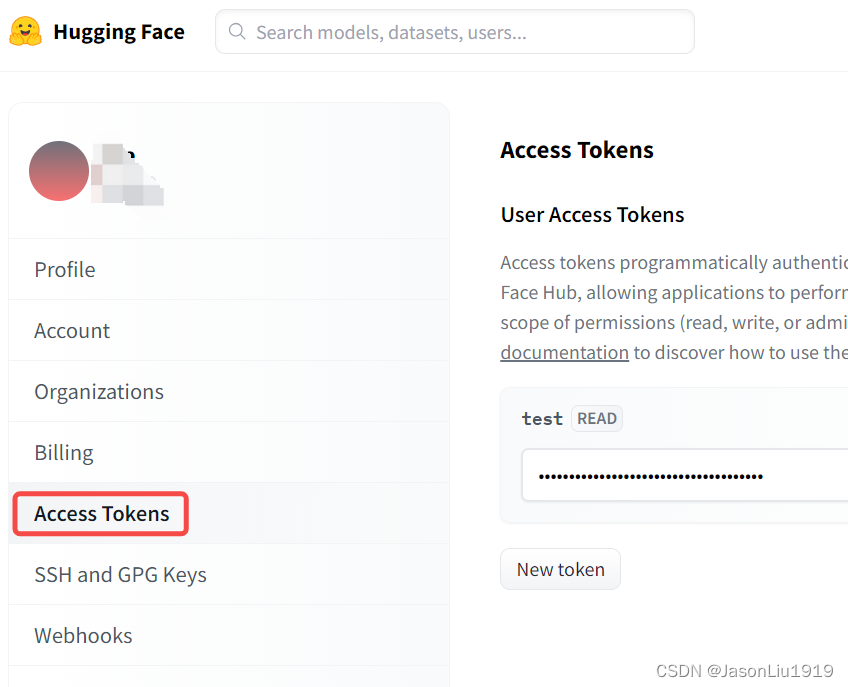

再在 hugging face官网生成自己账号的access token:

再在目标模型页面申请 llama2 的下载权限,这个需要等待一点儿时间,我这边大概10分钟左右就通过了。

下面实例是将Llama-2-7b-hf下载到本地指定目录。具体示例代码如下:

#!/usr/bin/env python

# -*- coding: utf-8 -*-

# @Time : 2023/7/25 14:29

# @Author : JasonLiu

# @File : download_hf.py

from huggingface_hub import snapshot_download

repo_id = "meta-llama/Llama-2-7b-hf" # 模型在huggingface上的名称

local_dir = "/home/model_zoo/LLM/llama2/Llama-2-7b-hf/" # 本地模型存储的地址

local_dir_use_symlinks = False # 本地模型使用文件保存,而非blob形式保存

token = "XXX" # 在hugging face上生成的 access token

# 如果需要代理的话

proxies = {

'http': 'XXXX',

'https': 'XXXX',

}

snapshot_download(

repo_id=repo_id,

local_dir=local_dir,

local_dir_use_symlinks=local_dir_use_symlinks,

token=token,

proxies=proxies

)

![[LitCTF 2023]作业管理系统](https://img-blog.csdnimg.cn/img_convert/d7b272a051cd43dab7aefabff39d81f8.png)