目录

一、介绍

二、三种架构学习

(1)boosting

(2)bagging

(3)stacking

一、介绍:

对于单个模型来说很难拟合复杂的数,模型的抗干扰能力较低,所以我们希望可以集成多个模型,结合多个模型的优缺点提高模型的泛化能力。

针对于集成学习方式:

第一种为Boosting架构,利用基学习器之间串行的方式进行构造强学习器。

第二种是Bagging架构,通过构造多个独立的模型,然后通过选举或者加权的方式构造强学习器。

第三种是Stacking架构,它结合了Boosting和Bagging两种集成方式,它是利用多个基学习器学习原数据,然后将这几个基学习学习到的数据交给第二层模型进行拟合。说白了就是将第一层模型的输出作为第二层模型的输入。

二、三种架构学习

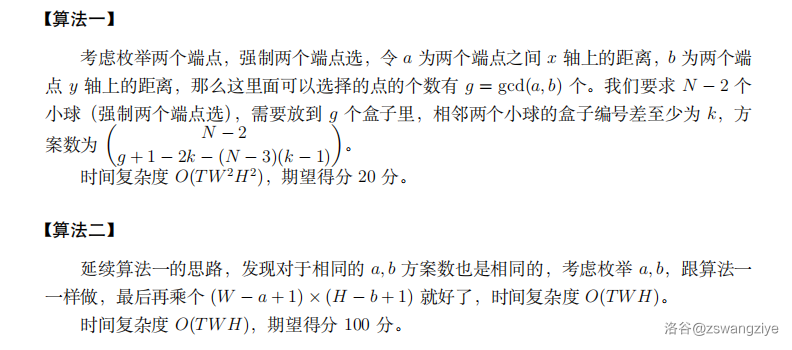

(1)boosting

训练过程为阶梯状,基模型按次序一一进行训练(实现上可以做到并行),基模型的训练集按照某种策略每次都进行一定的转化。对所有基模型预测的结果进行线性综合产生最终的预测结果

第一步:初始化训练数据的权重,w1=w2=...=wn=1/N,N为样本的数量。

第二步:训练第一个基模型,计算模型的错误率,计算模型的系数。

第三步:更新数据集的权重,误分类数据的权重调大,分类正确的数据权值调小。在训练一个基类模型。依次进行

第四步:每个模型对测试数据,进行预测。

第五部:对所有基模型的预测结果进行加权求和。准确率高的模型调大权值,准确率低的模型减小权值。

下图为架构图

【参考学习】:集成学习--Bagging、Boosting、Stacking、Blending - 知乎 (zhihu.com)

(2)bagging

从训练集从进行子抽样组成每个基模型所需要的子训练集,对所有基模型预测的结果进行综合产生最终的预测结果

下图为架构图

【参考学习】:集成学习--Bagging、Boosting、Stacking、Blending - 知乎 (zhihu.com)

(3)stacking

将训练好的所有基模型对训练基进行预测,第j个基模型对第i个训练样本的预测值将作为新的训练集中第i个样本的第j个特征值,最后基于新的训练集进行训练。同理,预测的过程也要先经过所有基模型的预测形成新的测试集,最后再对测试集进行预测。

第一步:使用训练数据,训练T个不同的模型,得到T个基模型。

第二步:使用T个基模型,分别对训练数据进行预测,与原始训练数据的标签一起组成新的训练数据。

第三步:使用T个基模型,分别对测试数据进行预测,生成新的测试数据。

第四步:使用新的训练数据,训练一个元模型。

第五部:使用元模型对测试数据进行预测,得到最终结果。

下图为架构图

【参考学习】:集成学习--Bagging、Boosting、Stacking、Blending - 知乎 (zhihu.com)

【参考学习】【机器学习】集成学习——Stacking模型融合(理论+图解)_stacking集成模型_༺࿈ 海洋༒之心 ࿈༻的博客-CSDN博客