文章目录

- 1. 持续学习和适应能力

- 原因

- 改善方法

- 2. 跨学科知识

- 原因

- 改善方法

- 3. 高效的计算资源利用

- 原因

- 改善方法

- 4. 模型解释性和可控性

- 原因

- 改善方法

- 5. 数据隐私和安全意识

- 原因

- 改善方法

在AI大模型的背景下,程序员要有什么职业素养,怎么改进,才能与时俱进:

- 持续学习和适应能力

- 跨学科知识

- 高效的计算资源利用

- 模型解释性和可控性

- 数据隐私和安全意识

1. 持续学习和适应能力

原因

AI和大模型领域的发展非常迅速,几乎每天都有新的技术、工具、算法和研究成果出现。工程师如果不持续学习,就会很快被淘汰。

改善方法

-

终身学习:

- 阅读论文: 定期阅读顶级AI会议和期刊上的最新论文,了解最新的研究进展和技术趋势。

- 技术博客和书籍: 关注知名技术博客(如CSDN)和书籍,获取实践经验和理论知识。

- 在线课程: 参加在线课程和培训,如CSDN等平台提供的机器学习和AI课程,获得认证和技能提升。

-

社区参与:

- 技术论坛: 参与CSDN、GitHub、Stack Overflow等技术社区,与同行交流,解决实际问题,分享经验。

- 会议和研讨会: 参加AI相关的技术会议、研讨会和其他相关活动,聆听专家讲座,结识业内人士。

-

实验和项目:

- 个人项目: 独立或团队进行AI项目开发,应用新学到的知识进行实践。

- 开源贡献: 参与开源项目,贡献代码和文档,学习他人项目的实现方法和代码风格。

2. 跨学科知识

原因

AI应用广泛,涉及多个学科的知识,包括统计学、数据科学、计算机科学、云计算等。缺乏跨学科知识会限制工程师在AI领域的应用和创新能力。

改善方法

-

跨学科学习:

- 统计学和数学: 学习统计学、线性代数、概率论等基础数学知识,这些是机器学习和数据分析的基础。

- 数据科学: 掌握数据清洗、数据分析和数据可视化的技能,熟悉常用的数据科学工具和库,如Pandas、NumPy、Matplotlib等。

-

跨学科项目:

- 多领域合作: 参与涉及多个学科的项目,如医疗AI、金融科技等,与其他领域的专家合作,获取跨学科的实践经验。

- 案例研究: 研究其他领域的成功案例,了解AI技术在不同领域的应用和挑战。

-

与专家合作:

- 多学科团队: 参与或组织多学科团队项目,学习不同领域的知识和方法。

- 专家指导: 寻求其他领域专家的指导和合作,通过实际项目提升跨学科知识。

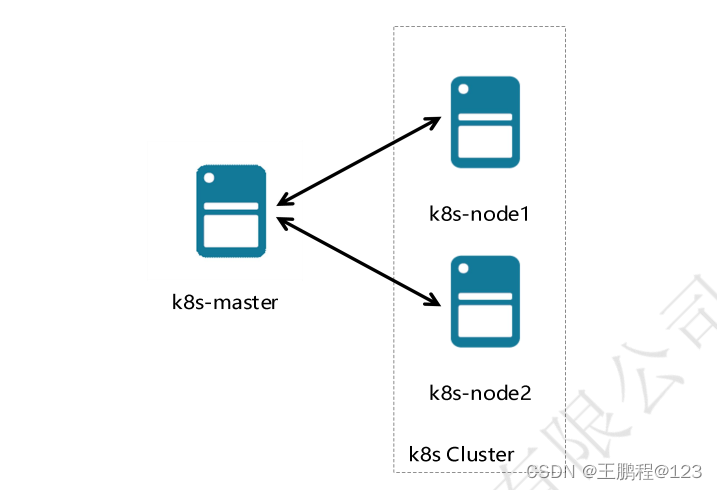

3. 高效的计算资源利用

原因

大模型的训练和推理需要大量的计算资源,如何高效利用计算资源以提高模型训练速度和降低成本,是工程师面临的重要挑战。

改善方法

-

云计算和分布式计算:

- 云平台使用: 学习如何使用AWS、Google Cloud、Azure等云计算平台,掌握如何在云上部署和管理AI模型。

- 分布式计算框架: 熟悉分布式计算框架,如Apache Spark、TensorFlow分布式训练,提升计算资源利用效率。

-

优化算法和模型:

- 模型剪枝和量化: 学习模型剪枝、模型量化等技术,减少模型参数数量,提高模型运行效率。

- 知识蒸馏: 掌握知识蒸馏技术,通过教师模型指导学生模型,提高学生模型的性能,同时减少计算资源需求。

-

异构计算:

- GPU和TPU: 学习如何在GPU和TPU上进行高效的模型训练和推理,了解其架构和编程方法。

- 其他专用硬件: 探索和使用其他专用硬件(如FPGA、ASIC)来加速AI计算。

4. 模型解释性和可控性

原因

大模型通常是“黑箱”,缺乏解释性和可控性,这对于实际应用、用户信任和合规性来说是一个重大问题。

改善方法

-

可解释AI技术:

- LIME和SHAP: 学习和应用LIME(Local Interpretable Model-agnostic Explanations)和SHAP(SHapley Additive exPlanations)等可解释AI技术,提高模型的透明度和可解释性。

- 模型可视化: 使用工具如TensorBoard、Netron等进行模型可视化,帮助理解模型内部结构和工作原理。

-

模型监控和调试:

- 监控工具: 使用如MLflow、TensorBoard等工具,实时监控模型的训练过程和性能表现。

- 调试技巧: 掌握模型调试技巧,能快速定位和解决模型训练中的问题。

-

合规性和伦理:

- 法律法规: 了解相关的法律法规,如GDPR、CCPA等,确保模型的开发和使用符合法律要求。

- 伦理准则: 遵循AI伦理准则,确保模型的公平性、透明性和责任性,避免偏见和歧视。

5. 数据隐私和安全意识

原因

AI模型依赖大量数据,如何在保证数据隐私和安全的前提下进行模型训练和推理,是一个重要挑战。数据泄露和隐私侵害不仅会带来法律风险,还会损害用户信任。

改善方法

-

隐私保护技术:

- 差分隐私: 学习差分隐私技术,确保在分析和处理数据时,不泄露个人隐私。

- 联邦学习: 了解联邦学习框架,使模型在不共享数据的情况下进行分布式训练,保护数据隐私。

-

安全开发实践:

- 数据加密: 采用数据加密技术,确保数据在传输和存储过程中的安全。

- 安全编码: 遵循安全编码实践,防止常见的安全漏洞,如SQL注入、XSS等。

-

合规培训:

- 法律法规: 学习并遵循相关的数据隐私法律法规,确保在处理和使用数据时符合法律要求。

- 安全意识培训: 定期参加安全意识培训,保持对最新安全威胁和防护措施的了解。

通过在以上几个方面进行提升,一个优秀软件开发工程师的职业素养在可以在AI大模型的背景下保持与时俱进,持续在技术前沿保持竞争力。

![nginx: [error] invalid PID number ““ in “/run/nginx.pid“](https://img-blog.csdnimg.cn/direct/02dfba3d2d7e4dd98597125d932765f9.png)