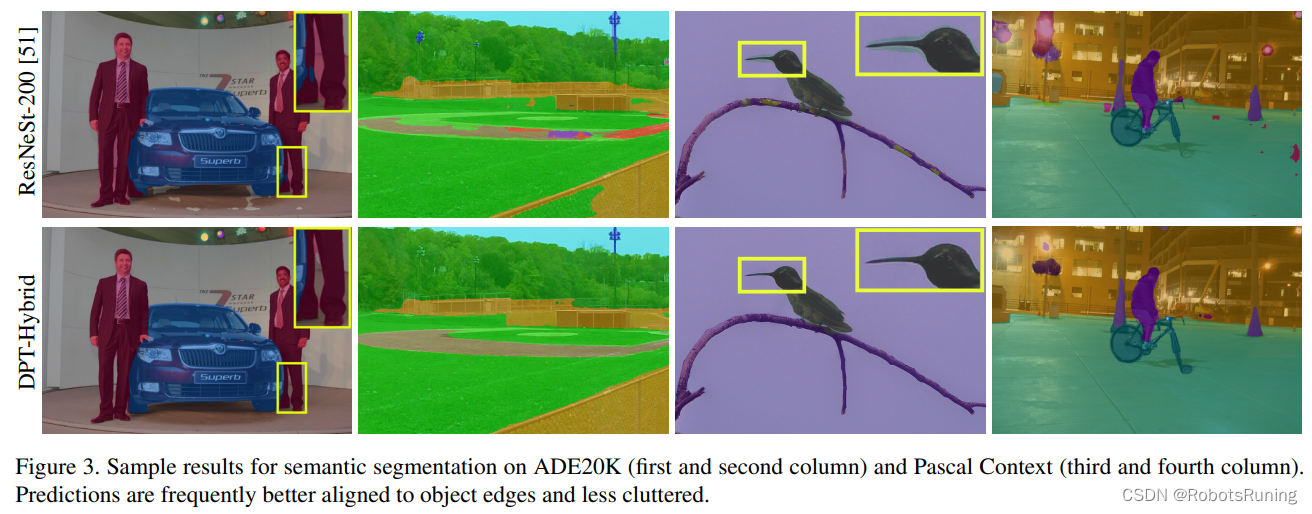

transformer中最麻烦的encoder模块其实张量和矩阵的变化维度比较复杂。我感觉这篇文章讲的特别详细Q、K、V 与 Multi-Head Attention 多头注意力机制 - 知乎

我总结一下文章几个很重要的点吧!算是我学的一点收获

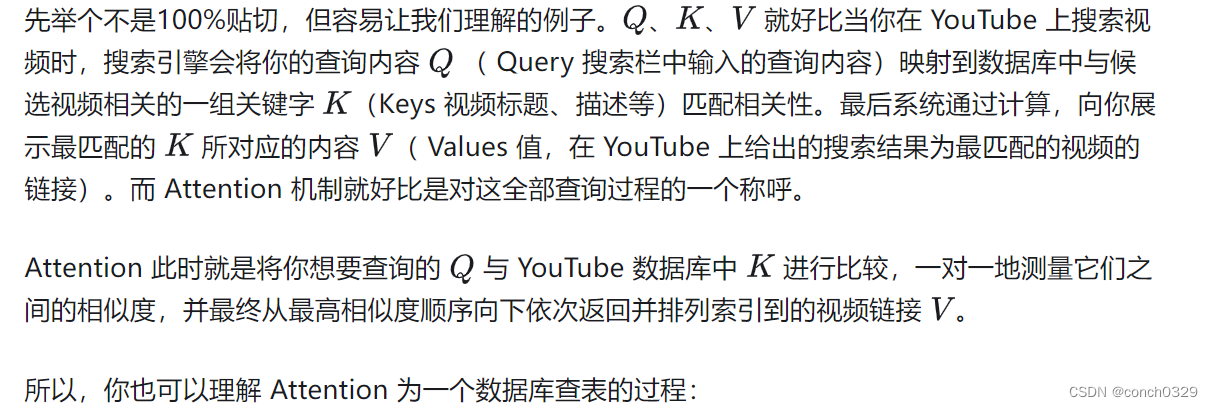

1.什么是QKV?

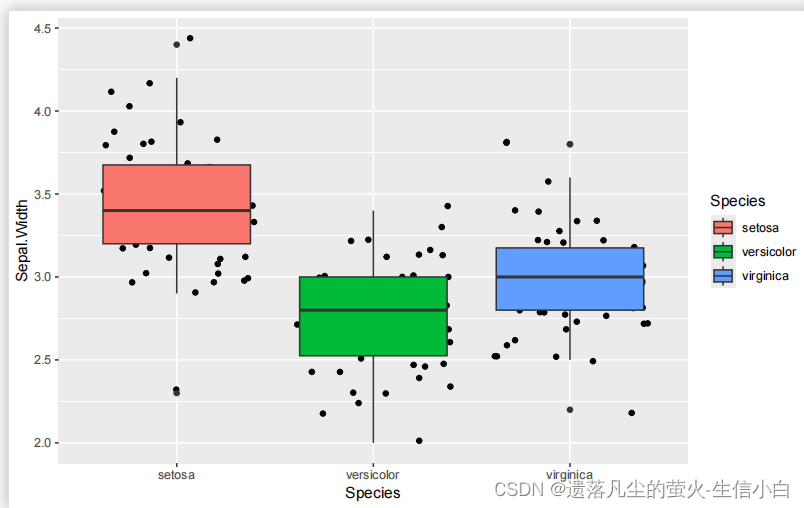

2.怎么理解多头?

多头本身可以理解成为哪吒的三头六臂,哪吒一个人打怪肯定没有三头六臂打怪来的战斗力猛,所以分身成三头六臂,也就是多头。但是不能总当怪物,天下三分,分久必合,所以打完之后要合成一个人。所以就把多头合在一块。

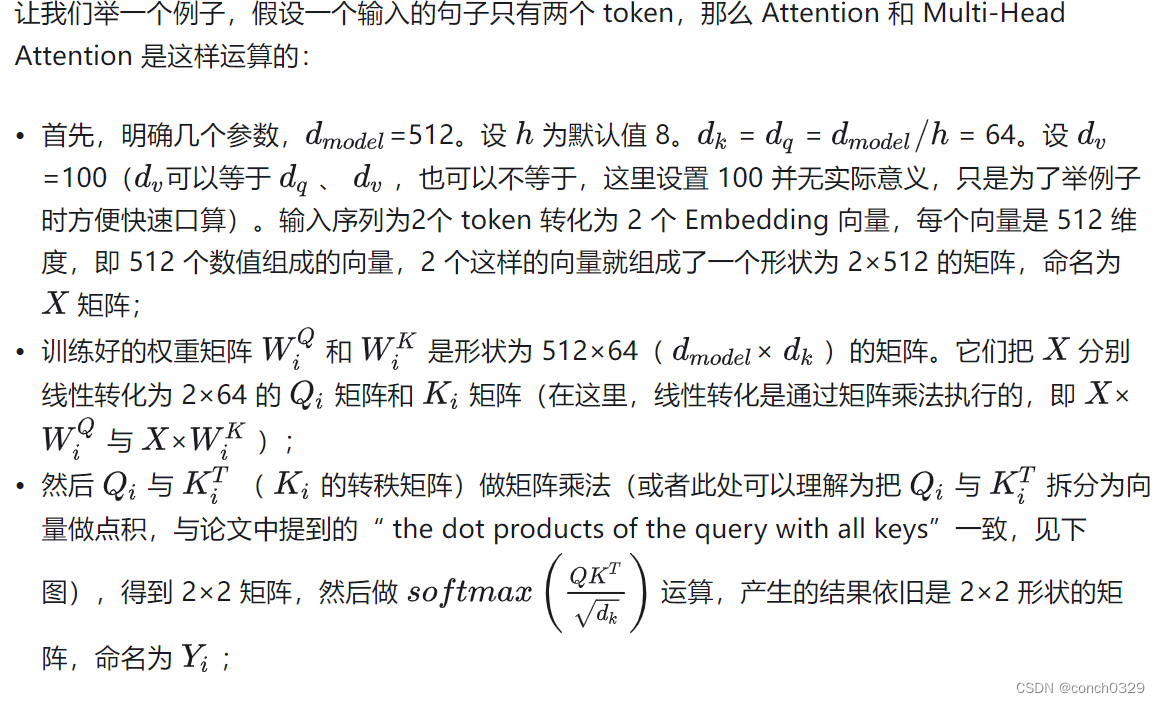

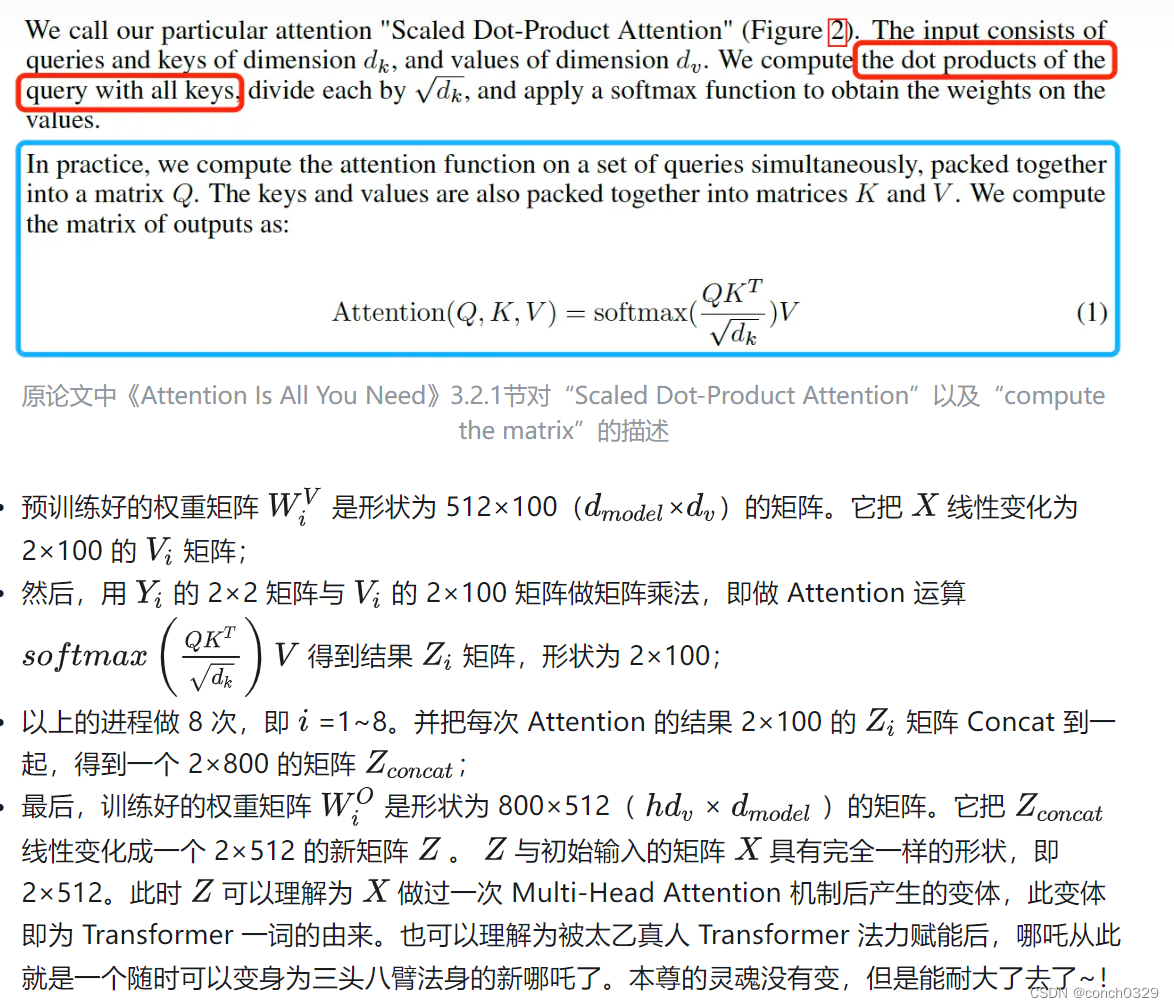

以下是作者给的一个例子:强烈建议大家去读原文,收获真的很多!