文章目录

- 前言

- 数据预处理

- 缺失值处理

- 数据缩放

- 特征选择

- 模型训练

- 参数调整

- 模型评估

- 总结

前言

经过了对Python和Scikit-learn的基础安装及简单应用,我们现在将更深入地探究Scikit-learn的实用技术,以进一步提升我们的数据科学技能。在本文中,我们将涵盖数据预处理、特征选择、模型训练、参数调整和模型评估等关键概念。

数据预处理

在机器学习中,数据质量直接影响模型的性能。Scikit-learn提供了许多用于数据预处理的方便工具,我们将重点介绍几个常用的方法。

缺失值处理

使用SimpleImputer类可以轻松处理缺失值:

from sklearn.impute import SimpleImputer

import numpy as np

# 假设我们有一些带有缺失值的数据

sample_data = [[1, 2, np.nan], [3, np.nan, 4], [5, 6, 7]]

# 创建一个用于填充缺失值的imputer对象

imputer = SimpleImputer(missing_values=np.nan, strategy='mean')

# 使用fit_transform方法来填充缺失值

processed_data = imputer.fit_transform(sample_data)

print(processed_data)

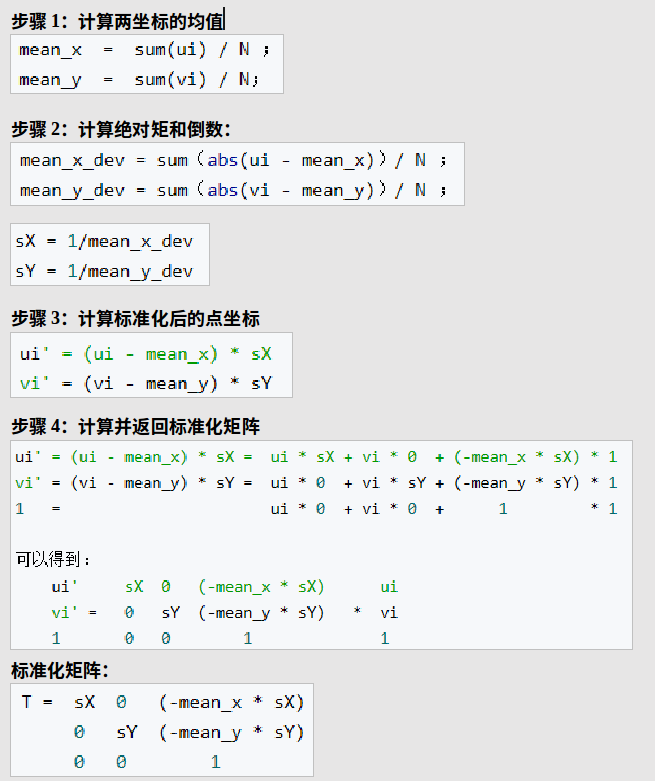

数据缩放

机器学习算法通常对数据的尺度敏感,因此数据缩放是一个不可或缺的步骤。StandardScaler是一个常用的缩放工具:

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

scaled_data = scaler.fit_transform(processed_data)

print(scaled_data)

特征选择

特征选择对于提升模型效率和性能至关重要。Scikit-learn提供了多种特征选择方法,我们来看一个例子。

from sklearn.feature_selection import SelectKBest, f_classif

# 假设X是特征矩阵,y是目标变量

# 使用SelectKBest来选择K个最佳特征

selector = SelectKBest(f_classif, k=2)

X_new = selector.fit_transform(X, y)

模型训练

现在您已经有了处理过的数据和选择好的特征,接下来就是选择和训练模型。Scikit-learn中有许多内置的模型可供选择,这里以决策树为例进行说明。

from sklearn.tree import DecisionTreeClassifier

# 创建决策树分类器实例

clf = DecisionTreeClassifier()

# 使用fit方法来训练模型

clf.fit(X_new, y)

参数调整

为了使模型达到最优表现,参数调整是一个必不可少的步骤。Scikit-learn的GridSearchCV提供了一个简单的API用于参数调整。

from sklearn.model_selection import GridSearchCV

# 定义参数范围

param_grid = {'max_depth': [3, 5, 7],

'min_samples_split': [2, 3, 4]}

# 创建GridSearchCV对象

grid_search = GridSearchCV(clf, param_grid, cv=5)

# 执行网格搜索

grid_search.fit(X_new, y)

# 输出最佳参数

print(grid_search.best_params_)

模型评估

最后,我们需要评估模型的性能。Scikit-learn提供了许多评估指标,比如准确率、召回率和F1分数等。

from sklearn.metrics import classification_report

# 假设X_test是测试集特征,y_test是测试集目标变量

y_pred = clf.predict(X_test)

# 输出分类报告

print(classification_report(y_test, y_pred))

总结

在本文中,我们详细探讨了使用Scikit-learn进行数据预处理、特征选择、模型训练、参数调整和模型评估的关键步骤。掌握这些技术将使您能够构建更为强大和精确的机器学习模型。记住,理论知识的实践应用是提高技能的最佳途径。动手尝试,不断探索,您将在数据科学之路上越走越远。