Sora的训练需要大量的计算资源,估计需要4211-10528个 Nvidia H100 GPUs运行一个月。

Sora的训练需要大量的计算资源,估计需要4211-10528个 Nvidia H100 GPUs运行一个月。

推理成本:一个Nvidia H100 GPU大约每小时能生成5分钟的视频。

初期的Sora成本将非常高,肯定是不适合普通人来使用,所以目前OpenAI都是先找一些艺术和电影工作室或者公司合作。

训练计算估算

- 从DiT到Sora的推算:Sora的详细信息虽然有限,但可以基于DiT(Diffusion Transformers)论文的数据,将Sora看作是DiT在视频生成方面的扩展。DiT-XL模型有675M参数,使用了大约1021 FLOPS的总计算量,相当于大约0.4 Nvidia H100s运行一个月。

- 计算乘数: 假设视频以24fps编码,1分钟的视频包含1440帧。考虑到Sora的空间和时间压缩,如果按DiT论文的8倍压缩率,我们得到180帧在潜在空间中的表示。因此,相较于DiT处理图像,处理视频的计算量至少增加了180倍。

- 模型大小和数据集: 估计Sora的模型参数数量远超675M。如果假设一个20B参数的模型,相对于DiT,计算需求增加了30倍。此外,Sora训练的数据集比DiT大很多倍,增加了数据集规模的乘数4-10倍。

- 将上述因素综合考虑,得出Sora训练所需的计算量约为4,211 - 10,528 Nvidia H100s运行一个月。

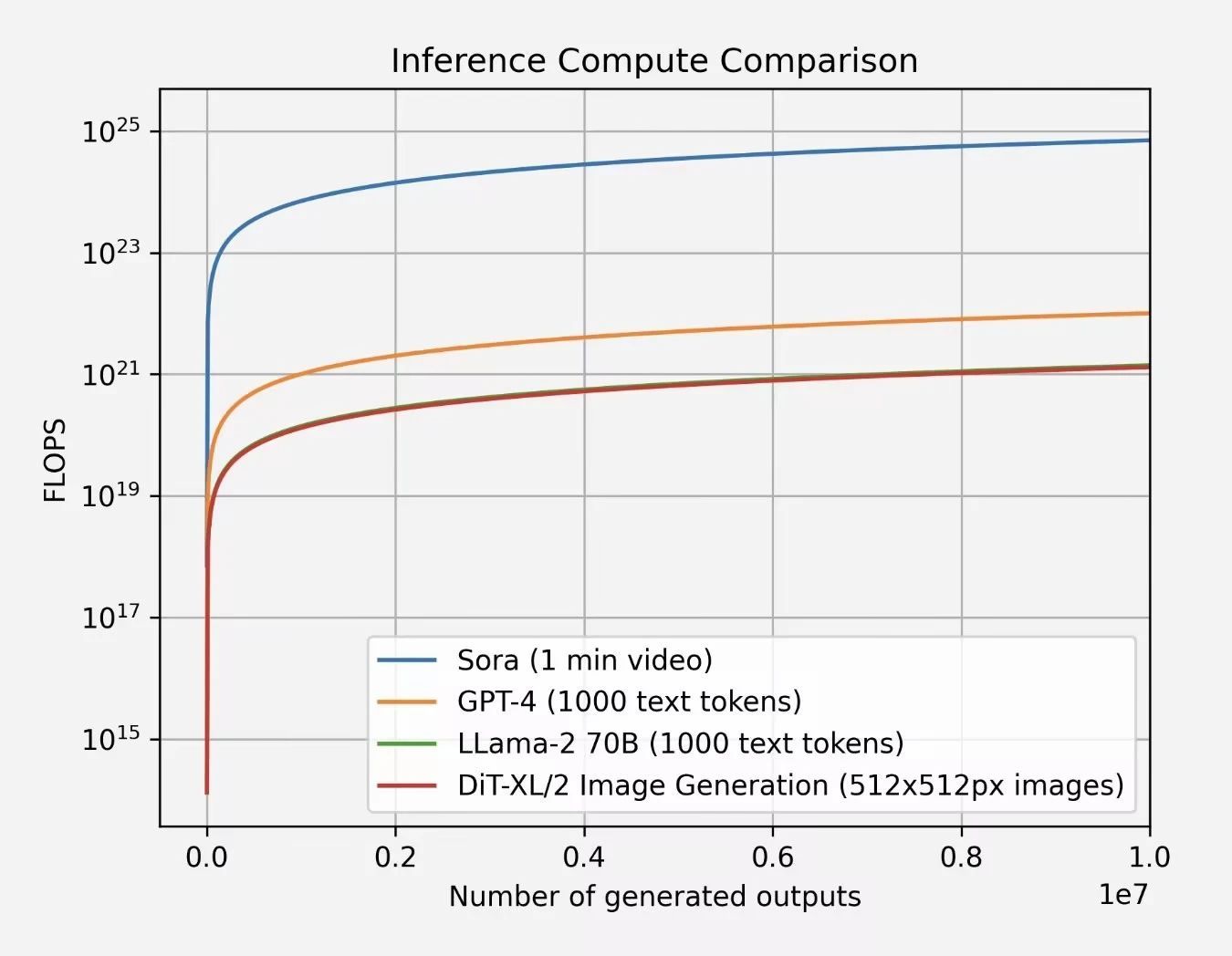

推理计算估算

- 推理与训练计算比较: 训练计算是一次性的大量计算,而推理计算虽然较小,但随着模型的广泛应用,会被频繁调用。

- 达到平衡点: 平衡点是指花费在推理上的计算量超过训练所需计算量的时刻。基于DiT到Sora的推算,Sora每生成一段视频的计算成本约为708×10^15 FLOPS,相当于每Nvidia H100 GPU大约能每小时生成5分钟视频。

- 平衡点达成: 在生成15.3M到38.1M分钟视频后,推理计算将超过训练计算。考虑到YouTube每天上传的视频量约为43M分钟,这个平衡点在实际应用中很快就会达到。