文章目录

- Preface

- Abstract

- Contributions

- Diagnostic Experiments

- Pipeline

- Revisiting Center Detection

- Training Samples

- IoU Oriented Optimization

- Experimental Results

Preface

[CVPR2021] Ma X, Zhang Y, Xu D. Delving into localization errors for monocular 3d object detection[C]. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2021: 4721-4730.

Paper

Code

单目3d目标检测-monodle解析

Abstract

通过密集的诊断实验(intensive diagnostic experiments),量化了单目3D目标检测中每一个子任务的影响,发现定位误差(localization error)是主要的限制因素。同时,本文还分析了定位误差背后的潜在原因以及带来的影响,并提出了三种策略:首先,重新审视了 2D 框中心与 3D 对象投影中心之间的偏差,这是一个导致定位准确性低的重要因素。其次,观察到使用现有技术准确定位远距离对象几乎是不可能的,而这些样本会误导学习网络。为此,建议从训练集中删除此类样本以提高检测器的整体性能。最后,还提出了一种面向 3D IoU 的损失,用于对象的大小估计,不受“定位误差”的影响

Contributions

- 首先,对单目 3D 检测进行了密集诊断实验。除了发现“定位错误”是限制单目 3D 检测的主要问题,此外,还量化了每个子任务的整体影响

- 其次,针对远距离目标提出了两种策略来提高整体检测性能,即

hard coding和soft coding - 最后,提出了一种面向 3D IoU 的损失,用于对象的大小估计,不受“定位误差”的影响

Diagnostic Experiments

为了定量地分析问题,本文进行了密集的诊断实验,通过逐步用真值替代baseline中的预测值的方法,提出了以下三个发现:

- 定位误差是限制单目 3D 检测的关键因素。此外,除了深度估计外,检测3D物体的投影中心在恢复物体的3D位置方面也起着重要作用。为此,回顾了2D框中心与3D对象的投影中心之间的偏差,证实了保持2D检测相关分支的必要性,通过这种方式,2D 检测被用作相关的辅助任务来帮助学习与 3D 检测共享的特征,这与SMOKE中丢弃 2D 检测的现有工作不同

- 观察到检测精度随着距离的增加而显著下降,认为由于不可避免的定位错误,几乎不可能使用现有技术准确地检测远距离对象,为此,提出了两种方案:从训练集中去除远距离样本,以及降低了这些样本的训练损失权重

- 观察到除了定位误差之外,像3D框的尺寸估计也是限制3D目标检测的重要因素,现有方法倾向于独立优化 3D 边界框的每个组件。然而,未能考虑每个损失项对最终度量(即3D IoU)的贡献可能会导致次优优化。为了缓解这个问题,提出了一种用于 3D 大小估计的 IoU 定向损失。新的面向 IoU 的损失根据其对 3D IoU 的贡献率动态调整样本级别每一方的损失权重

Pipeline

MonoDLE论文中没有给出网络的完整框架,而是基于baseline做的若干实验,其中baseline是基于centernet的非常经典的结构:

- Backbone:DLA34

- Neck:DLAUp

- 2D Detection:3个分支

- 第一个分支输出heatmap预测分类分数以及2D 框中心的粗坐标 c = ( u , v ) \mathbf{c}=(u,v) c=(u,v),注意,Baselibe的2D框中心粗坐标,用的是标签中2D框中心作为GT值来监督,在后文中坐着针对这一点有专门的讨论,选择了3D投影坐标作为粗坐标的监督

- 另一分支输出预测的2D粗坐标与真实坐标之间的偏移 o i = ( Δ u i , Δ v i ) \mathbf{o}^{\mathbf{i}}=\left(\Delta u^i, \Delta v^i\right) oi=(Δui,Δvi)

- 最后一个分支预测2D框的size

- 3D Detection:3个分支

- 第一个分支输出2D粗坐标与真实的3D投影坐标 c w = [ x w y w ] T = c + o w \mathbf{c}^\mathbf{w}=\left[x^w y^w\right]^T=\mathbf{c}+\mathbf{o}^{\mathbf{w}} cw=[xwyw]T=c+ow之间的偏移 o w = ( Δ u w , Δ v w ) \mathbf{o}^{\mathbf{w}}=\left(\Delta u^w, \Delta v^w\right) ow=(Δuw,Δvw)

- 第二个分支预测3D框的size

- 最后一个分支预测偏航角 γ \gamma γ

- Loss:分为7个部分

- 分类损失:Focal Loss

- 2D 中心点损失:L1 Loss

- 2D size损失:L1 Loss

- 3D 深度估计损失:

- 3D 中心点损失:L1 Loss

- 3D heading angle:multi-bin Loss

- 3D size:普通的L1 Loss & 本文提出的 IoU Loss

Revisiting Center Detection

这一部分就讨论了一件事:用于粗中心坐标 c = ( u , v ) \mathbf{c}=(u,v) c=(u,v)的监督应该是什么?本文的答案是3D投影中心坐标

- 使用3D投影的中心坐标,有助于估计粗略的中心感知 3D 几何信息,并与估计 3D 对象中心的任务更相关,这是定位问题的关键

- 上图展示了Center definition和Multi-task learning不同设置的效果,其中’PC’, ‘RF’和 ‘MT’ 分别表示’projected 3D center’, ‘refinement’(预测2D中心和3D中心之间的offsets), and ‘multi-task learning’(2D和3D检测联合进行)

- 从a到b说明了预测offsets有助于补偿2D中心和3D中心之间的偏差

- 从b到d说明了使用3D 投影中心作为粗坐标的监督可以进一步提升检测性能

- 从c到d说明了Multi-task learning有助于3D检测,同时d的2D检测的精度也优于c,说明由3D检测生成2D包围框可能会降低2D检测结果的质量

- 上图定性比较了,分别使用2D Center和3D 投影中心作为粗坐标监督的影响,可以看出使用3D 投影中心作为监督效果更好

- 第二行为2D Center监督下,网络输出粗坐标的特征可视化结果

- 第三行为3D 投影中心监督下,网络输出粗坐标的特征可视化结果

- 其中GT用circle显示,以区别网络输出的特征图

- 本文保留了2D检测分支,认为2D 检测可以作为辅助任务,有助于学习更好的 3D 感知特征

Training Samples

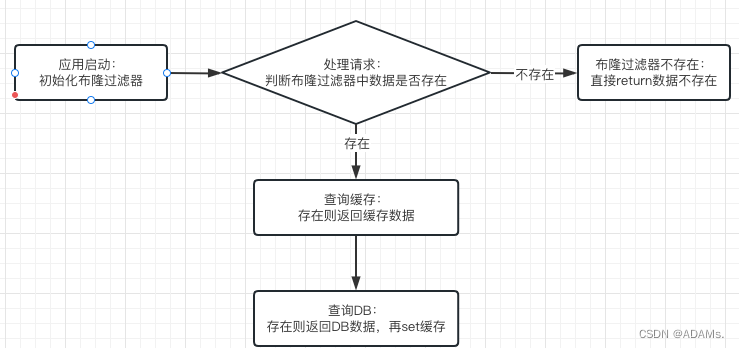

这一部分讨论了忽略远距离目标有助于提高3D目标检测的整体性能,为此提出了两个对应的方案:

- Hard coding:当样本的深度超过给定值,就直接舍弃,不会在训练阶段使用

w i = { 1 if d i ≤ s 0 if d i > s w_i= \begin{cases}1 & \text { if } d_i \leq s \\ 0 & \text { if } d_i>s\end{cases} wi={10 if di≤s if di>s - Soft coding:距离越远,样本的权重值越小,

c

c

c和

T

T

T分别为调整对称性和弯曲度中心的超参数,本文中默认为

c

=

60

,

T

=

1

c=60,T=1

c=60,T=1

w i = 1 1 + e ( d i − c ) / T , w_i=\frac{1}{1+e^{\left(d_i-c\right) / T}}, wi=1+e(di−c)/T1,

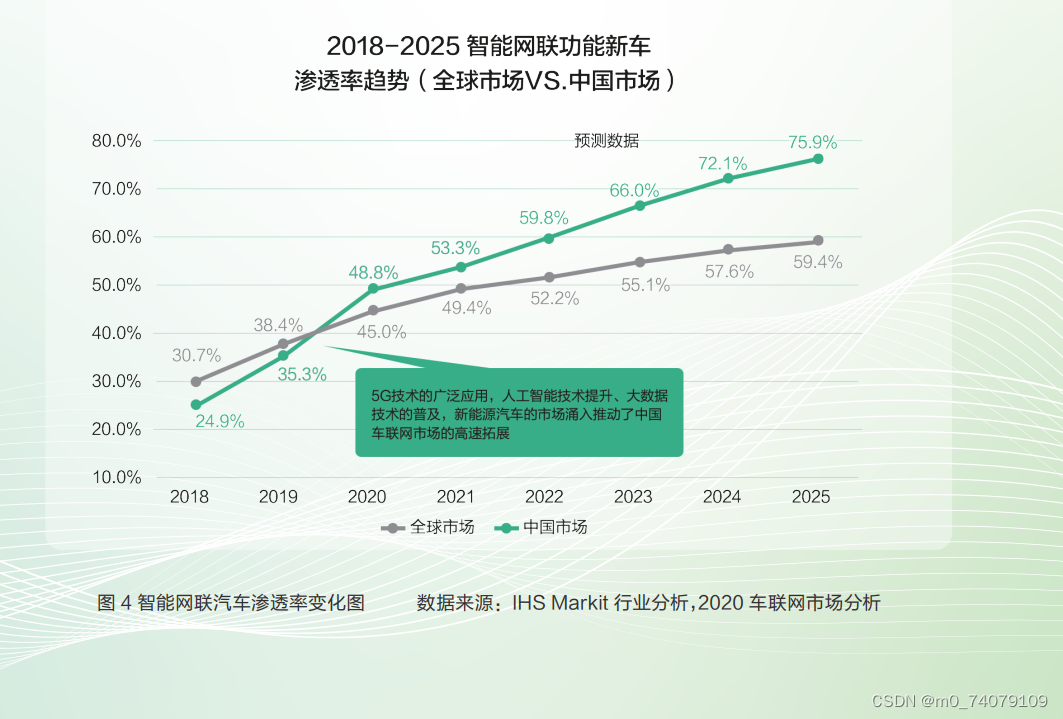

- 上图展示了Training Samples的定性分析结果,评价指标为Car类别的 A P 40 AP_{40} AP40

- 可以看到

hard encoding, s=60效果最好 - 值得注意的是,这些远距离样本占比非常少,在7481张图片的

trainval数据集中,超过60和65米的目标仅占比4.5%和2.7%

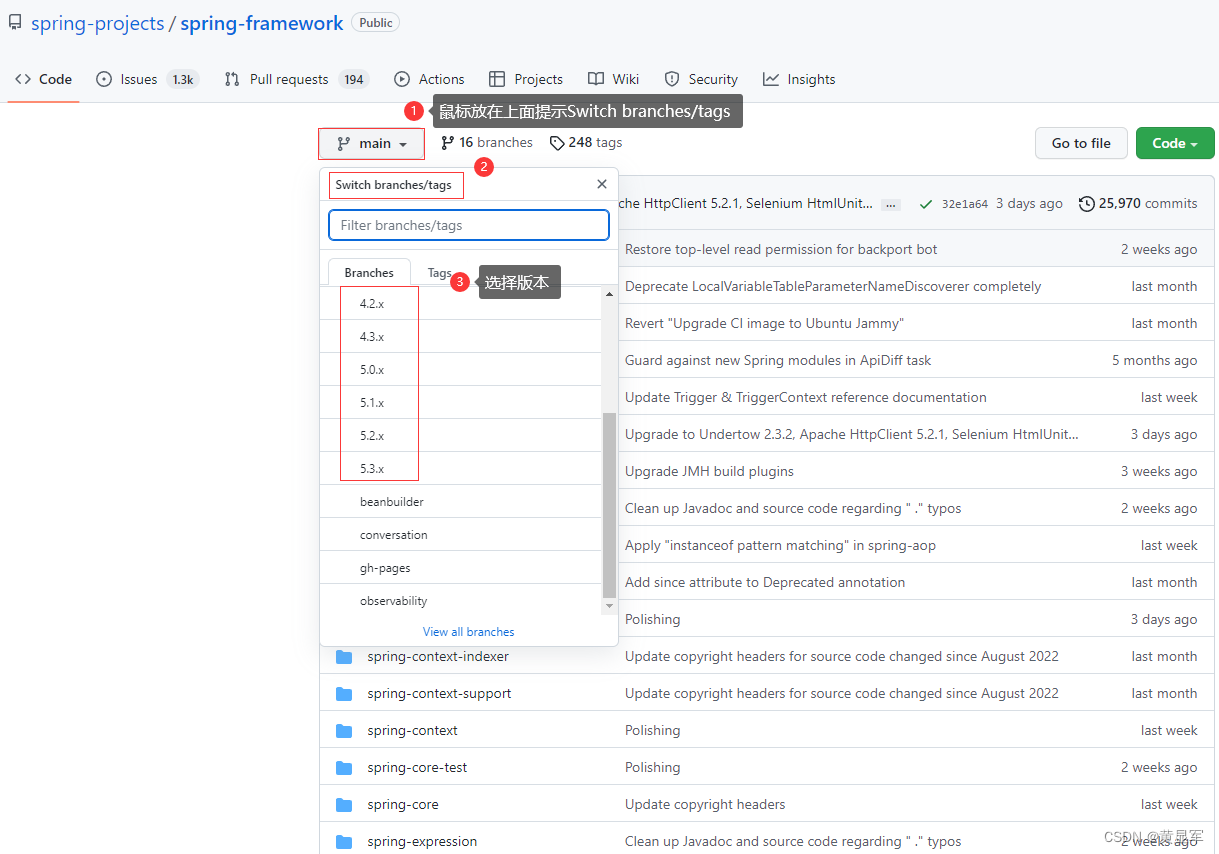

代码中对应实现如下lib\datasets\kitti\kitti_dataset.py:

object_num = len(objects) if len(objects) < self.max_objs else self.max_objs

for i in range(object_num):

...

# ignore the samples beyond the threshold [hard encoding]

threshold = 65

if objects[i].pos[-1] > threshold:

continue

...

- 目前我只在代码中找到

hard coding,并没有soft coding的处理 - 关于

Training Samples的Issue:https://github.com/xinzhuma/monodle/issues/9

IoU Oriented Optimization

这一部分讨论如果直接使用IoU loss,localization相关的子任务的loss(如depth估计)会压倒其他任务(如3D size预测),但是如果分开用多个loss来优化,又没有把每个组件和最终结果联系起来。本文提出对3D size估计的IoU oriented optimization,即对IoU贡献越大,给予的权重越大:

- 标准的3D size Loss为: L size ′ = ∥ s − s ∗ ∥ 1 \mathcal{L}_{\text {size }}^{\prime}=\left\|\mathbf{s}-\mathbf{s}^*\right\|_1 Lsize ′=∥s−s∗∥1

- 本文将其修改为: L size = ∥ ( s − s ∗ ) s ∥ 1 \mathcal{L}_{\text {size }}=\left\|\frac{\left(\mathbf{s}-\mathbf{s}^*\right)}{\mathbf{s}}\right\|_1 Lsize = s(s−s∗) 1

- 可以看到新的损失,幅度发生了变化(相当于进行了归一化)

- 为了进行补偿,本文首先动态生成补偿权重: w s = ∣ L size ′ / L size ∣ w_s=\left|\mathcal{L}_{\text {size }}^{\prime} / \mathcal{L}_{\text {size }}\right| ws=∣Lsize ′/Lsize ∣

- 然后计算最终的3D size的损失函数:

w

s

⋅

L

size

w_s \cdot \mathcal{L}_{\text {size }}

ws⋅Lsize ,其均值等于标准3D size损失函数的均值

代码中对应的实现如下lib\losses\dim_aware_loss.py:

def dim_aware_l1_loss(input, target, dimension):

dimension = dimension.clone().detach()

loss = torch.abs(input - target)

loss /= dimension

with torch.no_grad():

compensation_weight = F.l1_loss(input, target) / loss.mean()

loss *= compensation_weight

return loss.mean()

Experimental Results

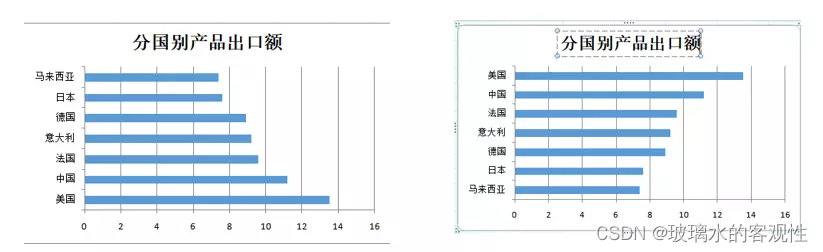

本文提出的三种改进策略的累计提升效果如下所示:

- 评价指标为Car类别的 A P 40 AP_{40} AP40(BEV/3D)

p:表示使用3D 投影中心作为粗中心坐标的监督I:表示使用对3D size估计的IOU oriented optimizations:表示忽略远距离目标