文章目录

- Docker操作二

- Docker网络

- 实现原理

- 端口映射

- 查看日志

- 网络模式

- host模式

- container模式

- none模式

- bridge模式

- 自定义网络

- Docker资源控制

- CPU资源控制

- 设置CPU使用率上限

- 设置CPU资源占用比(设置多个容器才有效)

- 设置容器绑定指定CPU

- 内存使用限制

- 设置磁盘IO配额控制

- 清理docker占用的磁盘空间(慎用)

- docker配置文件

Docker操作二

Docker网络

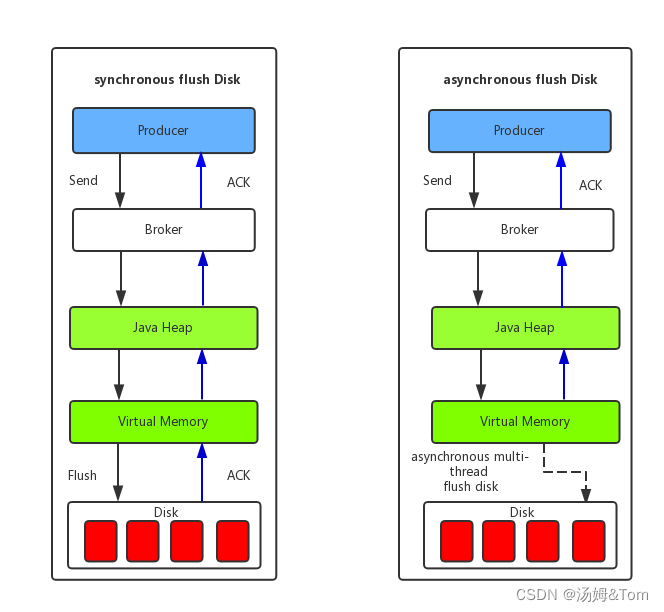

实现原理

- Docker使用Linux桥接,在宿主机虚拟一个Docker容器网桥(docker0),Docker启动一个容器时会根据Docker网桥的网段分配给容器一个IP地址,称为Container-IP,同时Docker网桥是每个容器的默认网关。

- 因为在同一宿主机内的容器都接入同一个网桥,这样容器之间就能够通过容器的 Container-IP 直接通信。

- Docker网桥是宿主机虚拟出来的,并不是真实存在的网络设备,外部网络是无法寻址到的,这也意味着外部网络无法直接通过 Container-IP 访问到容器。

- 如果容器希望外部访问能够访问到,可以通过映射容器端口到宿主主机(端口映射),即 docker run 创建容器时候通过 -p 或 -P 参数来启用,访问容器的时候就通过 [宿主机IP]:[容器端口] 访问容器

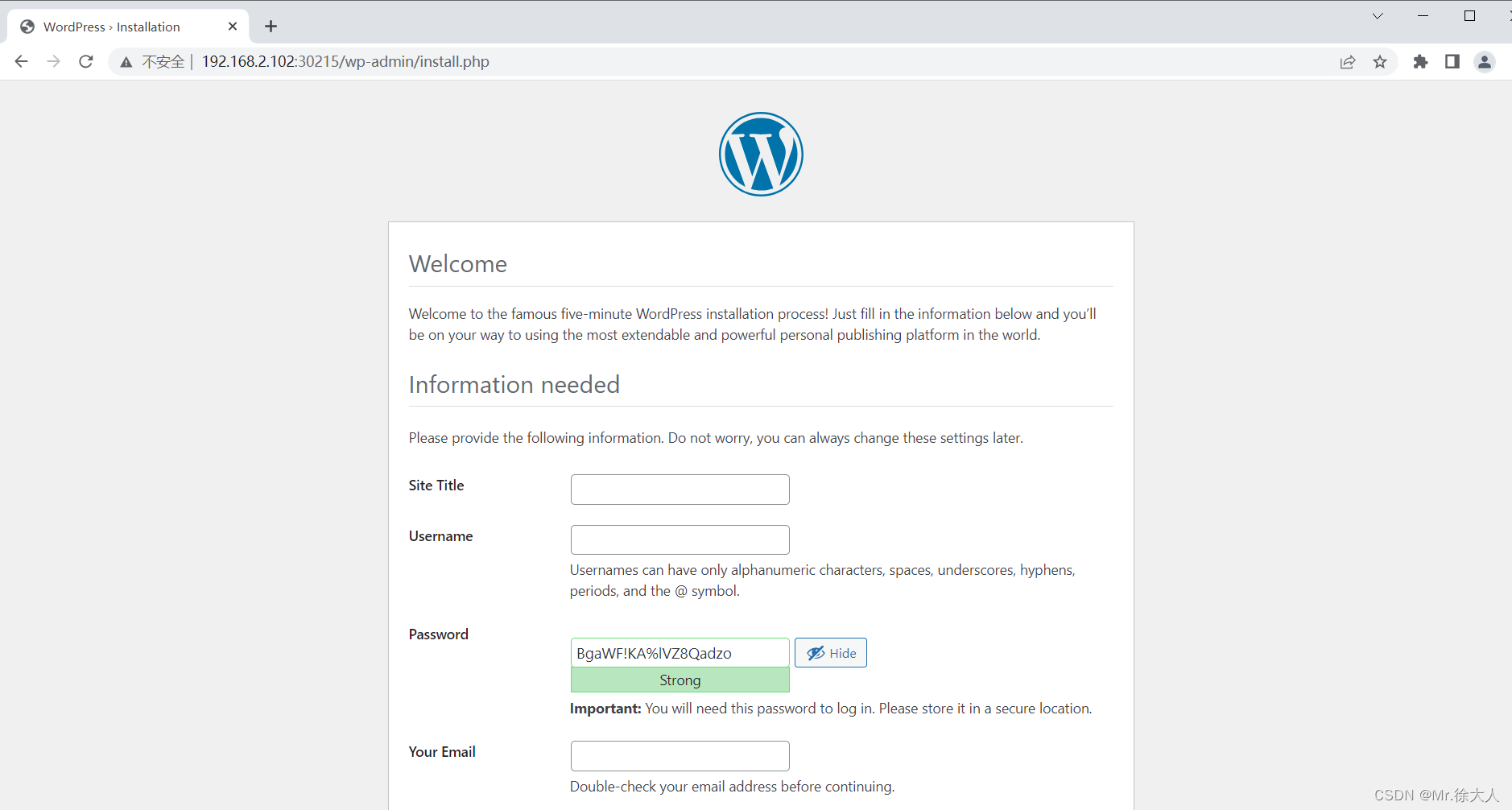

端口映射

-P : 端口随机映射 从 32768开始

-p : 指定映射端口

方法一:随机端口映射

###为容器做端口映射

docker run -d --name test01 -P nginx:latest

-P : 随机映射端口,从32768开始

###查看容器端口

docker ps -a

###验证

访问 : curl 192.168.242.66:32768

方法二:自定义端口映射

###自定义端口映射

docker run -d --name test02 -p 1314:80 nginx:latest

###查看容器端口

docker ps -a

###验证

访问 : curl 192.168.242.66:1314

注意:最好开启路由转发

###开启路由转发

vim /etc/sysctl.conf

net.ipv4.ip_forward = 1

###加载配置

sysctl -p

查看日志

##查看容器主进程的日志

docker logs 容器名称/容器ID

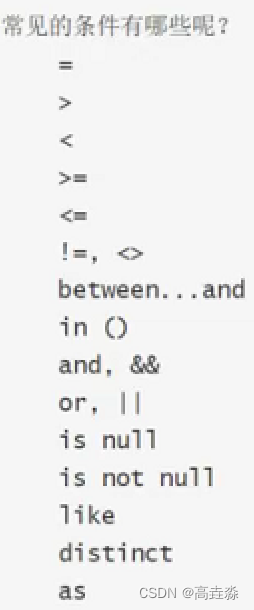

网络模式

- Host:容器将不会虚拟出自己的网卡,配置自己的IP等,而是使用宿主机的IP和端口。

- Container:创建的容器不会创建自己的网卡,配置自己的IP,而是和一个指定的容器共享IP、端口范围。

- None:该模式关闭了容器的网络功能。

- Bridge:默认为该模式,此模式会为每一个容器分配、设置IP等,并将容器连接到一个docker0虚拟网桥,通过docker0网桥以及iptables nat 表配置与宿主机通信。

- 自定义网络

安装Docker时,它会自动创建三个网络,bridge(创建容器默认连接到此网络)、 none 、host

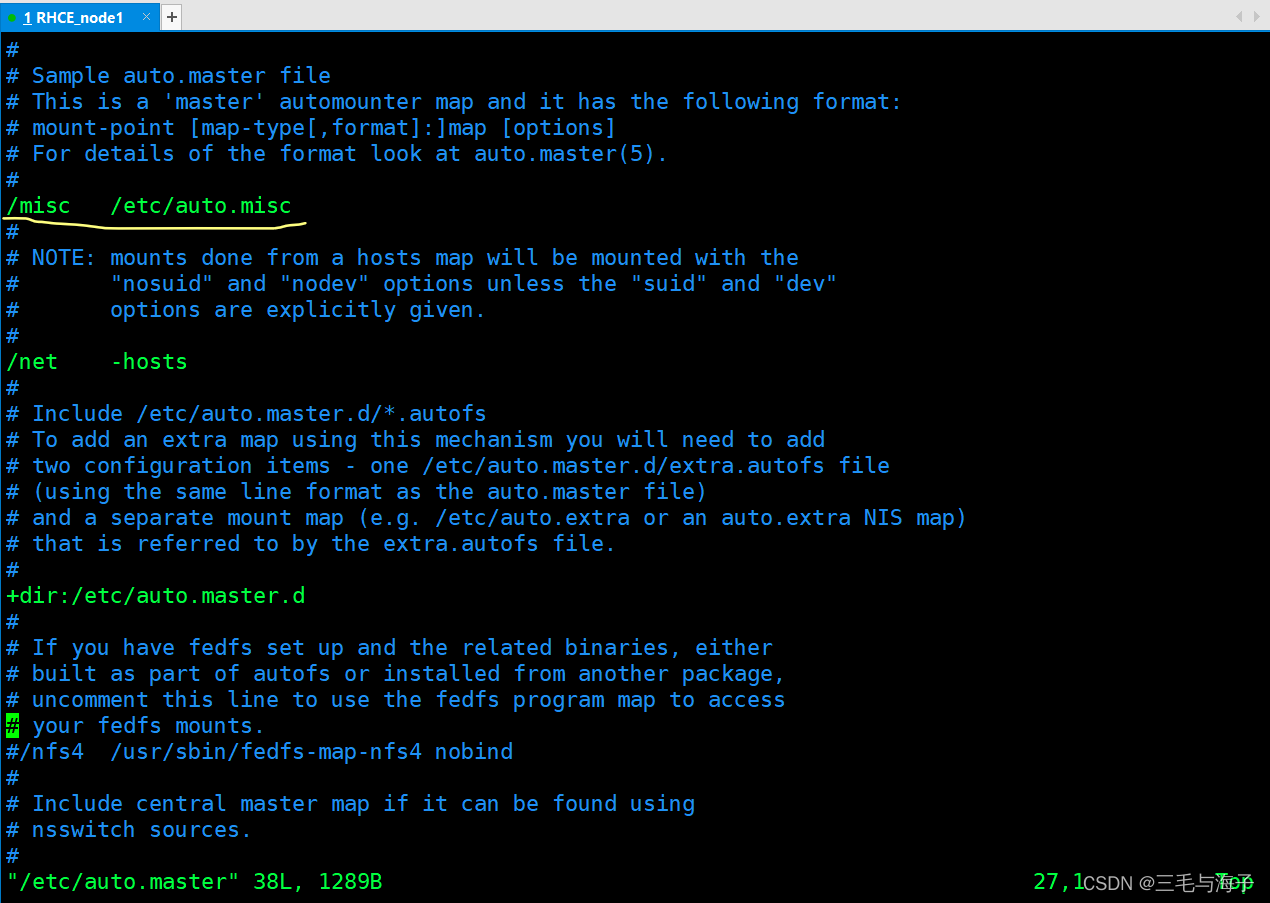

###查看docker网络列表

docker network ls

或者

docker network list

指定网络模式

使用docker run创建Docker容器时,可以用 --net 或 --network 选项指定容器的网络模式

host模式:使用 --net=host 指定。

none模式:使用 --net=none 指定。

container模式:使用 --net=container:容器名称/容器ID 指定。

bridge模式:使用 --net=bridge 指定,默认设置,可省略。

host模式

- 相当于Vmware中的桥接模式,与宿主机在同一个网络中,但没有独立IP地址。

- Docker使用了Linux的Namespaces技术来进行资源隔离,如PID Namespace隔离进程,Mount Namespace隔离文件系统,Network Namespace隔离网络等。

- 一个Network Namespace提供了一份独立的网络环境,包括网卡、路由、iptable规则等都与其他的Network Namespace隔离。

- 一个Docker容器一般会分配一个独立的Network Namespace。

- 但如果启动容器的时候使用host模式,那么这个容器将不会获得一个独立的Network Namespace, 而是和宿主机共用一个Network Namespace。

- 容器将不会虚拟出自己的网卡、配置自己的IP等,而是使用宿主机的IP和端口。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-aEy6aRFs-1689836663892)(E:\Typora\images\image-20230720094951896.png)]](https://img-blog.csdnimg.cn/54ca795da8fb4de8bf12e3a48fa7b492.png)

###创建nat模式的容器

docker run -itd --name test01 --net=host nginx:latest

docker ps -a

##查看容器信息

docker ps -a

##查看服务

netstat -lntp | grep nginx

container模式

- 这个模式指定新创建的容器和已经存在的一个容器共享一个Network Namespace,而不是和宿主机共享。

- 新创建的容器不会创建自己的网卡,配置自己的IP,而是和一个指定的容器共享IP、端口范围等。

- 同样,两个容器除了网络方面,其他的如文件系统、进程列表等还是隔离的。

- 两个容器的进程可以通过lo网卡设备通信。

##创建一个容器

docker run -itd --name test01 nginx:latest

##查看容器进程号

docker inspect -f '{{.State.Pid}}' 容器ID

##查看容器的进程、网络、文件系统等命名空间编号

ls -l /proc/容器ID/ns

##使用另外的镜像创建 container模式的容器

docker run -itd --name test02 --net=container:test01 centos:7 bash

##查看容器进程号

docker inspect -f '{{.State.Pid}}' 容器ID

##查看容器的进程、网络、文件系统等命名空间编号

ls -l /proc/容器ID/ns

###查看可以发现两个容器的 net namespace 编号相同

none模式

- 使用none模式,Docker容器拥有自己的Network Namespace,但是,并不为Docker容器进行任何网络配置。

- 也就是说,这个Docker容器没有网卡、IP、路由等信息。

- 这种网络模式下容器只有lo回环网络,没有其他网卡。这种类型的网络没有办法联网,封闭的网络能很好的保证容器的安全性。

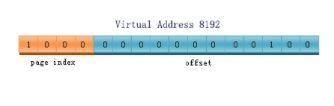

bridge模式

- bridge模式是docker的默认网络模式,不用–net参数,就是bridge模式。

- 相当于Vmware中的 nat 模式,容器使用独立network Namespace,并连接到docker0虚拟网卡。

- 通过docker0网桥以及iptables nat表配置与宿主机通信,此模式会为每一个容器分配Network Namespace、设置IP等,并将一个主机上的 Docker 容器连接到一个虚拟网桥上。

bridge模式工作过程

- 当Docker进程启动时,会在主机上创建一个名为docker0的虚拟网桥,此主机上启动的Docker容器会连接到这个虚拟网桥上。虚拟网桥的工作方式和物理交换机类似,这样主机上的所有容器就通过交换机连在了一个二层网络中。

- 从docker0子网中分配一个IP给容器使用,并设置docker0的IP地址为容器的默认网关。在主机上创建一对虚拟网卡veth pair设备。 veth设备总是成对出现的,它们组成了一个数据的通道,数据从一个设备进入,就会从另一个设备出来。因此,veth设备常用来连接两个网络设备。

- Docker将 veth pair 设备的一端放在新创建的容器中,并命名为 eth0(容器的网卡),另一端放在主机中, 以 veth* 这样类似的名字命名, 并将这个网络设备加入到 docker0 网桥中。可以通过 brctl show 命令查看。

- 使用 docker run -p 时,docker实际是在iptables做了DNAT规则,实现端口转发功能。可以使用iptables -t nat -vnL 查看。

###创建多个容器,查看IP地址

docker run -itd nginx:latest

###查看容器的IP地址

docker inspect 容器ID | grep -i ipaddress

for i in $(docker ps -a -q)

do

docker inspect $i | grep -i ipaddress

done

自定义网络

###创建自定义网络

#可以先自定义网络,再使用指定IP运行docker

docker network create --subnet=172.18.0.0/16 --opt "com.docker.network.bridge.name"="docker1" mynetwork

##docker1 为执行 ifconfig -a 命令时,显示的网卡名,如果不使用 --opt 参数指定此名称,

那你在使用 ifconfig -a 命令查看网络信息时,看到的是类似 br-110eb56a0b22 这样的名字,这显然不怎么好记。

#mynetwork 为执行 docker network list 命令时,显示的bridge网络模式名称。

##创建自定义网络的容器

docker run -itd --name test04 --net mynetwork --ip 172.18.0.10 centos:7 bash

Docker资源控制

- Docker 通过 Cgroup 来控制容器使用的资源配额,包括 CPU、内存、磁盘三大方面, 基本覆盖了常见的资源配额和使用量控制。

- Cgroup 是 ControlGroups 的缩写,是 Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源(如 CPU、内存、磁盘 IO 等等) 的机制,被 LXC、docker 等很多项目用于实现进程资源控制。

- Cgroup 本身是提供将进程进行分组化管理的功能和接口的基础结构,I/O 或内存的分配控制等具体的资源管理是通过该功能来实现的。

CPU资源控制

设置CPU使用率上限

- Linux通过CFS(Completely Fair Scheduler,完全公平调度器)来调度各个进程对CPU的使用。

- CFS默认的调度周期是100ms。

- 我们可以设置每个容器进程的调度周期,以及在这个周期内各个容器最多能使用多少 CPU 时间。

使用 --cpu-period 即可设置调度周期,

使用 --cpu-quota 即可设置在每个周期内容器能使用的CPU时间

两者可以配合使用。

CFS 周期的有效范围是 1ms~1s,

对应的 --cpu-period 的数值范围是 1000~1000000

而容器的 CPU 配额必须不小于 1ms

即 --cpu-quota 的值必须 >= 1000

###查看容器的CPU设置

cd /sys/fs/cgroup/cpu/docker/容器id

cat cpu.cfs_quota_us

-1

cat cpu.cfs_period_us ###单个CPU的分配周期

100000

------------------------

#cpu.cfs_period_us:cpu分配的周期(微秒,所以文件名中用 us 表示),默认为100000。

#cpu.cfs_quota_us:表示该cgroups限制占用的时间(微秒),默认为-1,表示不限制。 如果设为50000,表示占 用50000/100000=50%的CPU。

###docker压力测试

##进入docker容器,安装工具

docker exec -it 容器名 bash

yum -y install epel-release

yum -y install stress

###设置同时使用的CPU数

stress -c 1

###限制已有容器的CPU使用限制

vim cpu.cfs_quota_us

50000 ###50%的使用率

###查看CPU使用情况

top

修改文件适用于已有的容器,对于刚创建的容器,可以在创建命令中进行限制

###创建容器时设置CPU限制

docker run -it -d --name test03 --cpu-period 100000 --cpu-quota 50000 centos:7

#进行CPU压力测试

docker exec -it 容器ID /bin/bash

vim /cpu.sh

#!/bin/bash

i=0

while true

do

let i++

done

chmod +x /cpu.sh

./cpu.sh

设置CPU资源占用比(设置多个容器才有效)

- Docker 通过 --cpu-shares 指定 CPU 份额,默认值为1024,值为1024的倍数。

创建两个容器为 test01 和 test02,若只有这两个容器,设置容器的权重,使得test01和test02的CPU资源占比为1/3和2/3。

docker run -itd --name test01 --cpu-shares 1024 centos:7

docker run -itd --name test02 --cpu-shares 2048 centos:7

#分别进入容器,进行压力测试

yum install -y epel-release

yum install -y stress

stress -c 4 #产生四个进程,每个进程都反复不停的计算随机数的平方根

##查看容器运行状态(动态更新)

docker stats

- 可以看到在 CPU 进行时间片分配的时候,容器 c2 比容器 c1 多一倍的机会获得 CPU 的时间片。

- 但分配的结果取决于当时主机和其他容器的运行状态, 实际上也无法保证容器 c1 一定能获得 CPU 时间片。比如容器 c1 的进程一直是空闲的,那么容器 c2 是可以获取比容器 c1 更多的 CPU 时间片的。

- 极端情况下,例如主机上只运行了一个容器,即使它的 CPU 份额只有 50,它也可以独占整个主机的 CPU 资源。

- Cgroups 只在容器分配的资源紧缺时,即在需要对容器使用的资源进行限制时,才会生效。

- 因此,无法单纯根据某个容器的 CPU 份额来确定有多少 CPU 资源分配给它,资源分配结果取决于同时运行的其他容器的 CPU 分配和容器中进程运行情况。

###在创建一个容器

docker run -itd --name test03 --cpu-shares 1024 centos:7 bash

##查看容器运行状态(动态更新)

docker stats

###进入容器

docker exec -it test03 bash

yum install -y epel-release

yum install -y stress

stress -c 4 ##设置满负荷跑

###在资源不够用的情况下,容器的CPU占用会根据设置的配额进行分配

##查看容器运行状态(动态更新)

docker stats

设置容器绑定指定CPU

###先分配虚拟机2个CPU核数

docker run -itd --name test7 --cpuset-cpus 1 centos:7 /bin/bash

#进入容器,进行压力测试

yum install -y epel-release

yum install stress -y

stress -c 4

#退出容器,执行 top 命令再按 1 查看CPU使用情况。

内存使用限制

### -m(--memory=) 选项用于限制容器可以使用的最大内存

docker run -itd --name test01 -m 512m centos:7 /bin/bash

docker stats

###限制可用的 swap 大小, --memory-swap

强调一下,--memory-swap 是必须要与 --memory 一起使用的。

docker run -itd --name test01 -m 300m --memory-swap 1G centos:7 /bin/bash

docker stats

- 正常情况下,–memory-swap 的值包含容器可用内存和可用 swap。

- 所以 -m 300m --memory-swap=1g 的含义为:容器可以使用 300M 的物理内存,并且可以使用 700M(1G - 300)的 swap。

- 如果 --memory-swap 设置为 0 或者 不设置,则容器可以使用的 swap 大小为 -m 值的两倍。

- 如果 --memory-swap 的值和 -m 值相同,则容器不能使用 swap。

- 如果 --memory-swap 值为 -1,它表示容器程序使用的内存受限,而可以使用的 swap 空间使用不受限制(宿主机有多少 swap 容器就可以使用多少)。

设置磁盘IO配额控制

--device-read-bps:限制某个设备上的读速度bps(数据量),单位可以是kb、mb(M)或者gb。

例:docker run -itd --name test01 --device-read-bps /dev/sda:1M centos:7 /bin/bash

--device-write-bps : 限制某个设备上的写速度bps(数据量),单位可以是kb、mb(M)或者gb。

例:docker run -itd --name test02 --device-write-bps /dev/sda:1mb centos:7 /bin/bash

--device-read-iops :限制读某个设备的iops(次数)

--device-write-iops :限制写入某个设备的iops(次数)

#创建容器,并限制写速度

docker run -it --name test03 --device-write-bps /dev/sda:1mb centos:7 /bin/bash

#通过dd来验证写速度

docker exec -it test03 bash

dd if=/dev/zero of=test.out bs=1M count=10 oflag=direct

#添加oflag参数以规避掉文件系统cache

10+0 records in

10+0 records out

10485760 bytes (10 MB) copied, 10.0025 s, 1.0 MB/s

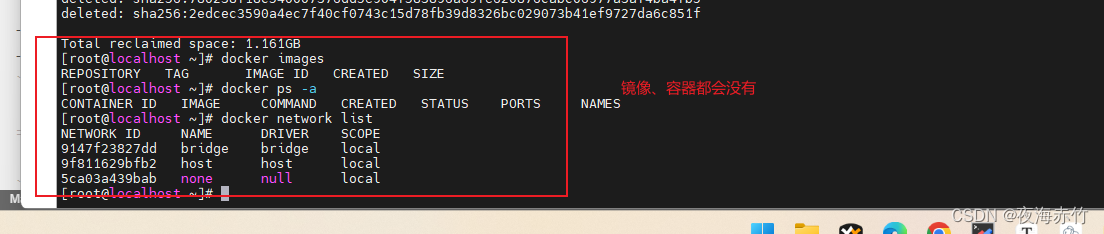

清理docker占用的磁盘空间(慎用)

#清理docker占用的磁盘空间

docker system prune -a

#可以用于清理磁盘,删除关闭的容器、无用的数据卷和网络

docker配置文件

###使用配置文件 /etc/docker/daemon.json(没有时新建该文件)

{

"graph": "/data/docker", #数据目录,此行可不加

"storage-driver": "overlay2", #存储引擎,此行可不加

"insecure-registries": ["registry.access.redhat.com","quary.io"], #私有仓库

"registry-mirrors": ["https://q"], #镜像加速,必加项

"bip": "172.7.5.1/24", #docker网络,必加项

"exec-opts": ["native.cgroupdriver=systemd"], #启动时候的额外参数(驱动),结合K8S使用

"live-restore": true

#当docker容器引擎挂掉的时候,使用docker跑起来的容器还能运行(分离) ,必加项

}

# 配置项注意点:

# graph: 该关键字未来将被弃用,可以采用 "data-root" 替代

# storage-driver: 存储驱动,即分层文件系统

# insecure-registries: 不安全的docker registries,即使用http协议推拉镜象

# registry-mirrors: 加速站点,一般可以使用阿里、网易云、docker中国(https://registry.docker-cn.com)的地址

# bip: 指定docker bridge地址(不能以.0结尾),生产中建议采用 172.xx.yy.1/24,其中xx.yy为宿主机ip后四位,方便定位问题

# 若启动失败,查看 /var/log/message 日志排错

exec-opts": ["native.cgroupdriver=systemd"] :

Kubernetes 推荐使用 systemd 来代替 cgroupfs

因为systemd是Kubernetes自带的cgroup管理器, 负责为每个进程分配cgroups,

但docker的cgroup driver默认是cgroupfs,这样就同时运行有两个cgroup控制管理器,

当资源有压力的情况时,有可能出现不稳定的情况

# live-restore 启用实时还原

默认情况下,当Docker守护程序终止时,它将关闭正在运行的容器。从Docker Engine 1.12开始,您可以配置守护程序,以便在守护程序不可用时容器仍在运行。此功能称为实时还原。实时还原选项有助于减少由于守护程序崩溃,计划内的停机或升级而导致的容器停机时间。

##将配置添加到守护程序配置文件。

在Linux上,默认为/etc/docker/daemon.json

##重新加载Docker守护程序

systemctl reload docker