在互联网领域,推荐系统(Recommendation Systems)的应用非常广泛。在音视频方面,如抖音、快手、哔哩等;在电商平台方面,如京东、淘宝、拼多多等。推荐有助于帮助用户快速发现潜在感兴趣的内容(音视频、商品、新闻等信息流),从而提升用户体验,同时有助于提升商业效率。

从本文开始,笔者将结合自身在信息流推荐领域的经验,通过系列文章对推荐系统展开介绍。

目录

1.什么是推荐?

1.1 首页推荐

2.为什么推荐?

3.基本术语

3.1 Item

3.2 Query

3.3 Embedding

3.4 推荐场景中哪些数据可以采用 Embedding 来构造特征呢?

3.4.1 User 数据

3.4.2 Item 数据

3.4.3 额外数据

4.推荐系统架构

4.1 候选 Item 池

4.2 打分

4.3 重排

5.候选 Item 池

5.1 嵌入空间

5.2 相似性计算

5.2.1 余弦

5.2.2 点积

5.2.3 欧氏距离

5.3 召回

6.参考文献

1.什么是推荐?

当你进入淘宝、京东等电商平台APP时,你可能会发现,展示的商品大都是自己感兴趣的。当你进入抖音、快手、哔哩等音视频APP时,你会发现很多音视频也是自己感兴趣的。不必惊讶,这其实就是推荐——更准确地说,是信息流推荐——即通过机器学习的推荐模型,从海量的商品、视频、新闻中寻找出用户潜在感兴趣的内容。 常用的推荐有两种:

- 首页推荐——home page recommendations

- 相关Item推荐——related item recommendations

注意:Item 一词直接翻译为“项目”并不合适,在信息流推荐领域,Item 指一条新闻、一则广告、一个商品、一首歌曲、一个权益等等。Item 可以理解为被一条被推荐的内容。

1.1 首页推荐

首页推荐是根据用户的已知兴趣向用户个性化推荐。每个用户都会看到不同的推荐——俗称“千人千面”。你可以尝试访问淘宝、京东等 APP,和身边的朋友对比一下,你会发现,你们看到的内容是不一样的。

1.2 相关 Item 推荐

顾名思义,相关 Item 推荐是指推荐与特定 Item 相似 Item。在 Google Play 应用程序示例中,查看数学应用程序页面的用户还可能会看到相关应用程序的面板,例如其他数学或科学应用程序。

2.为什么推荐?

推荐系统可以帮助用户在大型语料库中快速找到感性却的内容。例如,Google Play 商店提供数百万个应用程序,而 YouTube 提供数十亿个视频。每天都会新增更多应用程序和视频。用户如何找到新颖且感兴趣的内容呢?

一种朴素的观点,人们可以使用搜索来寻找、访问内容。然而,这并不高效,因为用户可能并不了解自己对哪些内容感兴趣,即便知道,也可能不清楚使用哪些关键词来搜索。相较之下,推荐引擎可以为用户推荐一些用户自身 “未曾想到但感兴趣” 的 Item。

你可知道?

- Google Play 上 40% 的应用安装来自推荐。

- YouTube 上 60% 的观看时间来自推荐。

3.基本术语

为了便于理解后面的系列文章,我们先 “统一语言”——即定义一些术语,基于这些术语交流,可以减少歧义:

3.1 Item

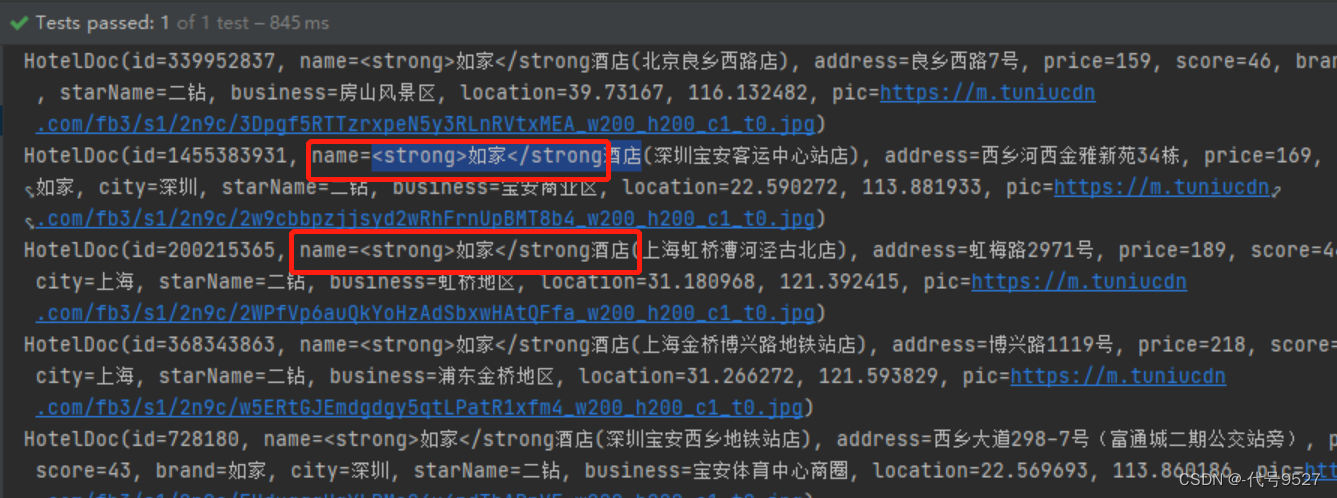

直译为:项目,内涵为系统推荐的实体(如视频、商品、新闻、酒店等等),也称为项目,在不同场景下,Item 的内涵也有差异。对于 Google Play 商店,Item 是要安装的应用程序;对于 YouTube,Item 是视频。

3.2 Query

也称为上下文-Context,推荐系统需要根据 Query 来计算并返回建议(推荐)的 Item。Query 可以是以下各项的组合:

- 用户信息

- 用户的 ID

- 用户之前交互过的 Item

- 用户的地理位置、年龄、学历、收入等

- 补充信息(也称为额外信息)

- 一天中的时间

- 用户的设备类型和 ID

3.3 Embedding

即嵌入,在《机器学习20:嵌入-Embeddings》一文中有详细的介绍。嵌入是指从离散集(在本例中为 Query 集或要推荐的 Item 集)到称为嵌入空间的向量空间的映射。许多推荐系统依赖于学习 Query 和 Item 的适当嵌入表示—— Query 和 Item 的合适嵌入,将有助于推荐。

在提到 Embedding 时,首先想到的是“向量化”,主要作用是将 高维稀疏向量 转化为 低维稠密向量,从而方便下游模型处理。换一种说法,Embedding 是用一个 低维稠密向量 来表示一个对象,使得这个向量能够表达相应对象的某些特征,同时向量之间的距离能反映对象之间的相似性。

还有一种定义:Embedding 是将一个实例(instance)从复杂的空间嵌入(投射)到相对简单的空间,以便对原始实例进行理解,或者在相对简单的空间中进行后续操作。

3.4 推荐场景中哪些数据可以采用 Embedding 来构造特征呢?

下面简单列了笔者在 游戏和信息流推荐 时主要采用 Embedding 技术来处理的数据。

3.4.1 User 数据

典型如:用户的基础属性数据,如性别、年龄、关系链、兴趣偏好等。

- 对于用户兴趣偏好,一般简单地采用文本 Embedding 方法来得到各标签的 Embedding 向量,然后根据用户对这个标签的偏好程度做向量加权;

- 对于关系链数据(如同玩好友、游戏中心相互关注等),构造用户关系图,然后采用基于图的 embedding 方法来得到用户的 Embedding 向量;

3.4.2 Item 数据

Item 基本信息数据,如标题、作者、游戏简介、标签等。

- 对于文本、简介和标签等可以采用基于文本的 Embedding 方法来在已有语料上预训练模型,然后得到对应的 Embedding 向量(如 word2vec 或者 BERT);

-

此外对于有明确关系的(如 item->文本->标签 or 关键词)可以采用对关键词/标签的向量均值来表示 item 的文本向量;

-

针对用户对 Item 的操作(如点击、互动、下载)构造:用户->item+Item 标签体系,构造用户-item-tag 的异构网络,然后可以采用 Metapath2vec 来得到各节点的 Embedding 向量;

-

通过记录用户在整个场景访问 item,构造 Item-Item 关系图,然后采用 DeepWalk 算法得到 item 的向量,用来挖掘 Item 间的关系特征;

3.4.3 额外数据

外部扩充数据,如用户游戏行为、用户微信其他场景活跃等。

- 标签型,主要是用户在各场景的兴趣偏好;

- 关系链型(如游戏中心好友、游戏内好友、开黑好友)可以采用用户关系构造用户关系图,采用 Graph Embedding 方法(如 GraphSAGE)来表示用户抽象特征。

4.推荐系统架构

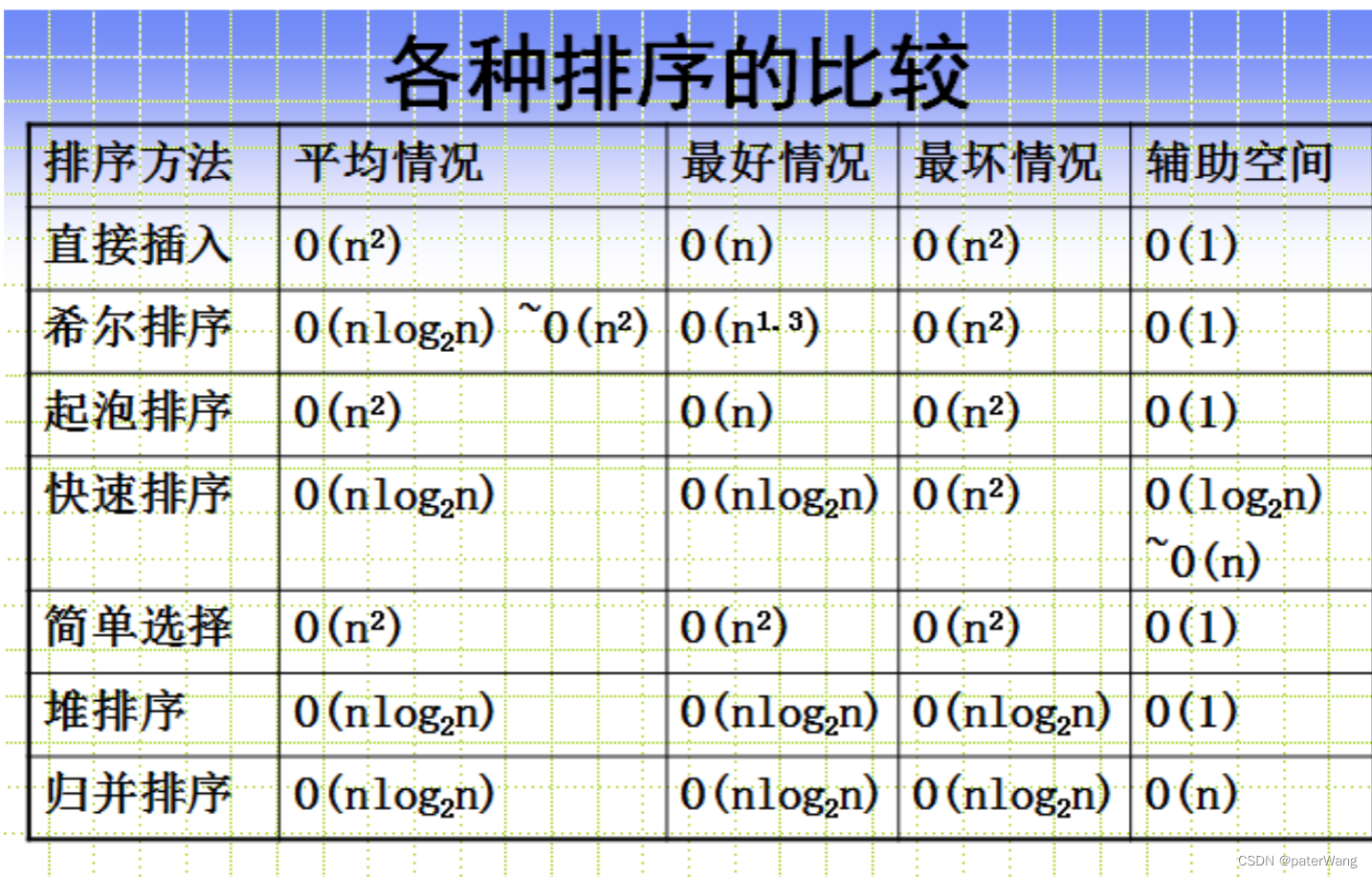

推荐系统的常见架构如下图所示,包括四个组件(复杂的推荐系统包括召回、粗排、精排、重排,会更加复杂)。

- 物料库:包括所有 Item 和 User 的特征数据

- 召回:即采用简单模型从海量物料库中选择部分用户可能感兴趣的 Item

- 精排:即通过复杂模型对 Item 进行打分,进而排序

- 重排:给用户推荐的 Item 也不能完全是用户潜在感兴趣的,需要考虑多样性、时效性等

4.1 候选 Item 池

在第一阶段,系统从一个潜在的巨大物料库开始,通过【召回】生成一个小得多的候选子集。例如,YouTube 中的候选生成器将数十亿个视频减少到数百或数千个。鉴于语料库规模巨大,该模型需要快速评估查询。给定的模型可以提供多个候选生成器,每个生成器指定不同的候选子集。

4.2 打分

在复杂的推荐系统中,打分通常包括两个部分:【粗排打分】+【精排打分】。本质上都是通过模型对候选 Item 进行评分和排序,以便选择要向用户展示的 Item 集(信息流推荐大多数是分页的,每页大约 10 个,因此每次打分后,取 TOP N 即可)。由于该模型评估相对较小的 Item 子集,因此系统可以使用依赖于附加查询的更精确的模型。

4.3 重排

最后,系统必须考虑最终排名的附加约束。例如,系统删除用户明确不喜欢的项目或提高较新鲜内容的分数。重新排名还有助于确保多样性、新鲜度和公平性。

5.候选 Item 池

如何获取候选 Item 池呢?作为推荐的第一阶段,本质是一个【召回】过程。给定一个 Query,系统会生成一组相关的候选 Item。如下表所示,为两种常见的候选池生成方法。

| 类型 | 定义 | 例子 |

|---|---|---|

| 基于内容的过滤 | 利用 Item 之间的相似性,来推荐与用户喜欢的 Item 相似的 Item | 如果用户 A 观看了两个可爱的猫咪视频,那么系统可以向该用户推荐可爱的动物视频。 |

| 协同过滤 | 同时使用 Query 和 Item 之间的相似性来提供建议。 | 如果用户A与用户B相似,并且用户B喜欢视频1,则系统可以向用户A推荐视频1(即使用户A没有看过任何与视频1类似的视频)。 |

5.1 嵌入空间

基于内容的过滤和协作过滤都将每个 Item 和每个 Query(或上下文)映射到公共嵌入空间中的嵌入向量 。通常,嵌入空间是低维的(即

比物料库的大小小得多),并捕获 Item 或 Query 集的一些潜在结构。类似的 Item(例如由同一用户观看的 YouTube 视频)最终会在嵌入空间中紧密结合在一起。“接近度” 的概念是通过相似性度量来定义的。

额外资源: projector.tensorflow.org是一个用于可视化嵌入的交互式工具。

5.2 相似性计算

相似性度量是一个函数 它接受一对嵌入并返回一个测量它们相似度的标量。嵌入可用于候选池生成(即召回,也称为【向量召回】)。如下所示:给定查询嵌入:

,系统寻找那些接近于

的 Item 的嵌入

,即相似度高的嵌入

。

为了计算相似度,大多数推荐系统依赖于以下一项或多项:

- 余弦

- 点积

- 欧氏距离

5.2.1 余弦

即计算两个向量之间角度的余弦,,两个向量越接近,余弦值越大,夹角为 90 度(垂直),则结果为 0,即可认为相似度最低。

5.2.2 点积

两个向量的点积为 。也可用

(角度的余弦乘以范数的乘积)。因此,如果嵌入被规范化(归一化),则点积和余弦重合。

5.2.3 欧氏距离

欧几里得空间中的距离。距离越小意味着相似度越高。请注意,当嵌入规范化(归一化)时,平方欧几里德距离与点积(和余弦)一致,直到达到一个常数,因为在这种情况下。

5.3 召回

基于 Embedding 和相似度计算,我们就可以从海量的物料库中寻找到那些用户可能感兴趣的 Item,即基于相似度计算结果取出 TOP N。这一过程,在很多推荐场景中被称为【召回】。

6.参考文献

1-https://developers.google.cn/machine-learning/recommendation/overview

2-https://www.163.com/dy/article/FROC0ILQ0518R7MO.html