什么是Stable Diffusion

Stable Diffusion是一种潜在扩散模型(Latent Diffusion Model),能够从文本描述中生成详细的图像。它还可以用于图像修复、图像绘制、文本到图像和图像到图像等任务。简单地说,我们只要给出想要的图片的文字描述在提Stable Diffusion就能生成符合你要求的逼真的图像!

Stable Diffusion将“图像生成”过程转换为逐渐去除噪声的“扩散”过程,整个过程从随机高斯噪声开始,经过训练逐步去除噪声,直到不再有噪声,最终输出更贴近文本描述的图像。这个过程的缺点是去噪过程的时间和内存消耗都非常大,尤其是在生成高分辨率图像时。Stable Diffusion引入潜在扩散来解决这个问题。潜在扩散通过在较低维度的潜在空间上应用扩散过程而不是使用实际像素空间来减少内存和计算成本。

快速体验Stable Diffusion

官方网络应用程序 https://beta.dreamstudio.ai/generate

整合包安装

知乎教程

| 提示区 | 对于图像进行描述 |

|---|---|

| prompt | 告诉模型我想要什么样的风格或元素 |

| Negative prompt | 告诉模型我不想要什么样的风格或元素 |

| 参数调节区 | 用于控制和优化生成过程 |

|---|---|

| Sampling method | 扩散去噪算法的采样模式,不同采样模式会带来不一样的效果 |

| Sampling steps | 模型生成图片的迭代步数,每多一次迭代都会给 AI 更多的机会去对比 prompt 和 当前结果,从而进一步调整图片。更高的步数需要花费更多的计算时间,但却不一定意味着会有更好的结果。当然迭代步数不足肯定会降低输出的图像质量; |

| Width、Height | 输出图像宽高,图片尺寸越大越消耗资源,显存小的要特别注意。一般不建议设置的太大,因为生成后可以通过 Extras 进行放大; |

| Batch count、 Batch size | 控制生成几张图,前者计算时间长,后者需要显存大 |

| CFG Scale | 分类器自由引导尺度,用于控制图像与提示的一致程度,值越低产生的内容越有创意; |

| Seed | 随机种子,只要种子一样,参数和模型不变,生成的图像主体就不会剧烈变化,适用于对生成图像进行微调; |

| Restore faces | 优化面部,当对生成的面部不满意时可以勾选该选项; |

| Tiling | 生成一张可以平铺的图像; |

| Highres. fix | 使用两个步骤的过程进行生成,以较小的分辨率创建图像,然后在不改变构图的情况下改进其中的细节,选中该选项会有一系列新的参数,其中重要的是: |

| Upscaler | 缩放算法; |

| Upscale by | 放大倍数; |

Stable Disffusion 采样器

1、Euler a

Euler a,属于超快采样模式,采样10次,即可完成基本画面。但是继续提高采样步数,就基本脱离了提示词。是个插画,tag利用率仅次与DPM2和DPM2 a,环境光效菜,构图有时很奇葩 。

2、Euler

Euler,同属于超快采样模式,采样10次,即可完成基本画面,继续提高采样步数,会略微调整一下衣物的细节。柔和,也适合插画,环境细节与渲染好,背景模糊较深。

3、LMS

LMS,可能不太适合拟真画面,采样30次,仍然不能完成基本画面。

质感OA,饱和度与对比度偏低,更倾向于动画的风格

4、Heun

Heun,采样20次后,可以完成基本画面,继续提高采样步数,会略微调整一下衣物与背景的细节。单次出图平均质量比Euler和Euler a高,但速度最慢,高step表现好。

5、DPM2

DPM2,采样20次后,可以完成基本画面,继续提高采样步数,会改变背景的细节。

6、DPM2 a

DPM2 a,采样20次后,可以完成基本画面,继续提高采样步数,会脱离提示词。

7、DPM++ 2S a

DPM++ 2S a,也属于超快采样,采样10次即可完成基本画面,采样20次会形成新风格,继续提高采样步数,则会脱离提示词。

8、DPM++ 2M

DPM++ 2M,采样20次后,可以完成基本画面,继续提高采样步数,会完善人物衣物的细节,整体变化不大。

9、DMP++ SDE

DPM++ SDE,基本是脱离提示词的状态,但用于生成人物特写似乎特别高效,采样5次即可生成较好的人物画面。

10、DPM fast

DPM fast,不太适合拟真画面,采样30次也是脱离提示词的状态。

11、DPM adaptive

DPM adaptive,和 DPM++ SDE 差不多基本都是脱离提示词的状态,但用于生成人物特写似乎特别高效,采样5次即可生成较好的人物画面,与 DPM++ SDE 不同的是人物特征比较固化。

12、LMS Karras

LMS Karras,采样色彩较好,采样10次后,可以完成基本画面,随着采样步数的增加,会进一步完善人物与背景的细节。会大改成油画的风格,写实不佳。

13、DPM2 Karras

DPM2 Karras,采样10次后,可以完成基本画面,随着采样步数的增加,会进一步完善背景的细节,人物变化不大。

14、DPM2 a Karras

DPM2 a Karras,不太适合拟真画面,完全脱离提示词,随着采样步数的增加,人物与背景的变化都很大,但细节比较多,适合随机绘画。几乎与DPM2相同,对人物可能会有特写

15、DPM++ 2S a Karras

DPM++ 2S a Karras,也属于超快采样,采样5次即可完成基本画面,采样10次就会有较好的表现,但采样步数增多,反而会脱离提示词。

16、DPM++ 2M Karras

DPM++ 2M Karras,采样色彩较佳,随着采样次数的增加,人物及背景的细节都会得到相应的增强。看来大部分人使用它,都是为了获得更好的色彩和采样宽容性。

17、DPM++ SDE Karras

DPM++ SDE Karras,完全脱离了提示词,随着采样次数的增加,人物变化不大,背景变化较大,适合人物随机特写。

18、DDIM

DDIM,严格遵循提示词,采样10次可以完成基本画面,只是效果一般,采样20次会有较好的表现,采样30次达到稳定画面。适合宽画,速度偏低,高step表现好,负面tag不够时发挥随意,环境光线与水汽效果好,写实不佳。

19、PLMS

PLMS,不太适合拟真画面,采样30次还不能完成基本画面,人物出现动漫画的特征。单次出图质量仅次于Heun。

20、UniPC

UniPC,采样20次可以完成基本画面,线条感较强,采样30次之后,开始向拟真人物发展。

大部分AI绘画研究者都选择使用 DPM++ 2M Karras,确实是因为这种采样模式在适配提示词、画面色彩及采样宽容性上的表现最好。

Stable Diffusion资源列表

好的生成质量离不开好的模型, 除了标准模型外,Stable Diffusion还有其他几种类型的模型,models目录下每一个子目录就是一种类型的模型,其中用的最多的是LoRA模型。

1、Hugging Face是一个专注于构建、训练和部署先进开源机器学习模型的网站,目前平台上有270多个与Stable Diffusion相关的模型,用"Stable Diffusion"作为关键字就能搜到。

2、C 站: https://civitai.com/

下载一个模型放在这个文件夹下:

[stable-diffusion-webui安装目录]\models\Stable-diffusion

##模型介绍

1、Dreamlike Photoreal 2.0这个模型,这是一个由Dreamlike.art制作的基于Stable Diffusion v1.5的真实感模型,生成效果非常接近真实照片。

2、LoRA(Low-Rank Adaptation)模型是小型稳定扩散模型,可对标准模型进行微调。它通常比标准模型小10-100倍,这使得LoRA模型在文件大小和训练效果之间取得了很好平衡。LoRA无法单独使用,需要跟标准模型配合使用,这种组合使用方式也为Stable Diffusion带来了强大的灵活性。

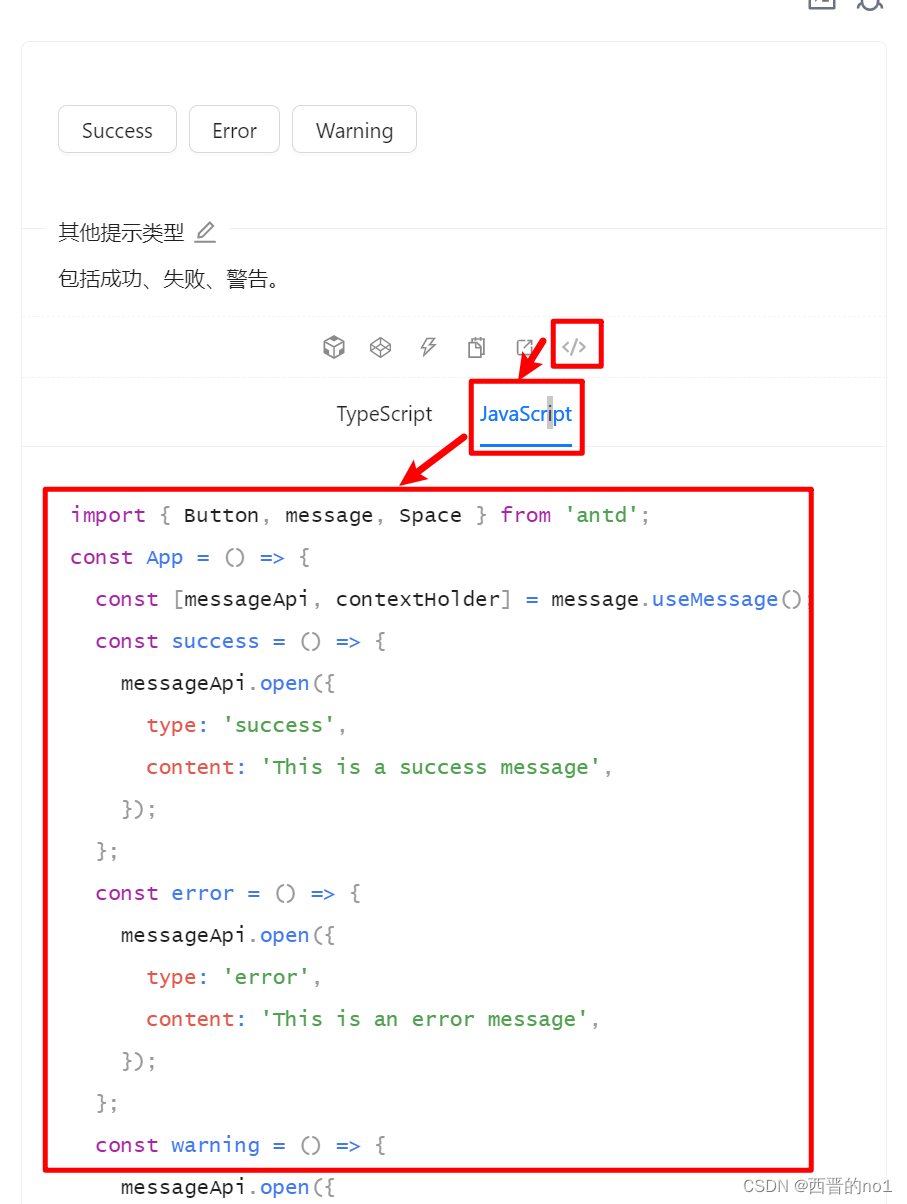

LoRA模型下载后需要放到Lora目录中,使用时在提示中加入LoRA语法,语法格式如下:

<lora:filename:multiplier>

filename是LoRA模型的文件名(不带文件后缀)

multiplier 是LoRA 模型的权重,默认值为1,将其设置为 0 将禁用该模型。

DollLikeness 模型

中日韩超火AI绘画模型KoreanDollLikeness+JapaneseDollLikeness+Taiwan更新

koreanDollLikeness_v15.safetensors - Google 云端硬盘

taiwanDollLikeness_v10.safetensors - Google 云端硬盘

japaneseDollLikeness_v10.safetensors - Google 云端硬盘

把下载的 ChilloutMix-NI模型放到 novelai-webui-aki-v2\models\Stable-diffusion内。下载的Doll Likeness模型放到 novelai-webui-aki-v2\models\Lora内 模型就准备完成

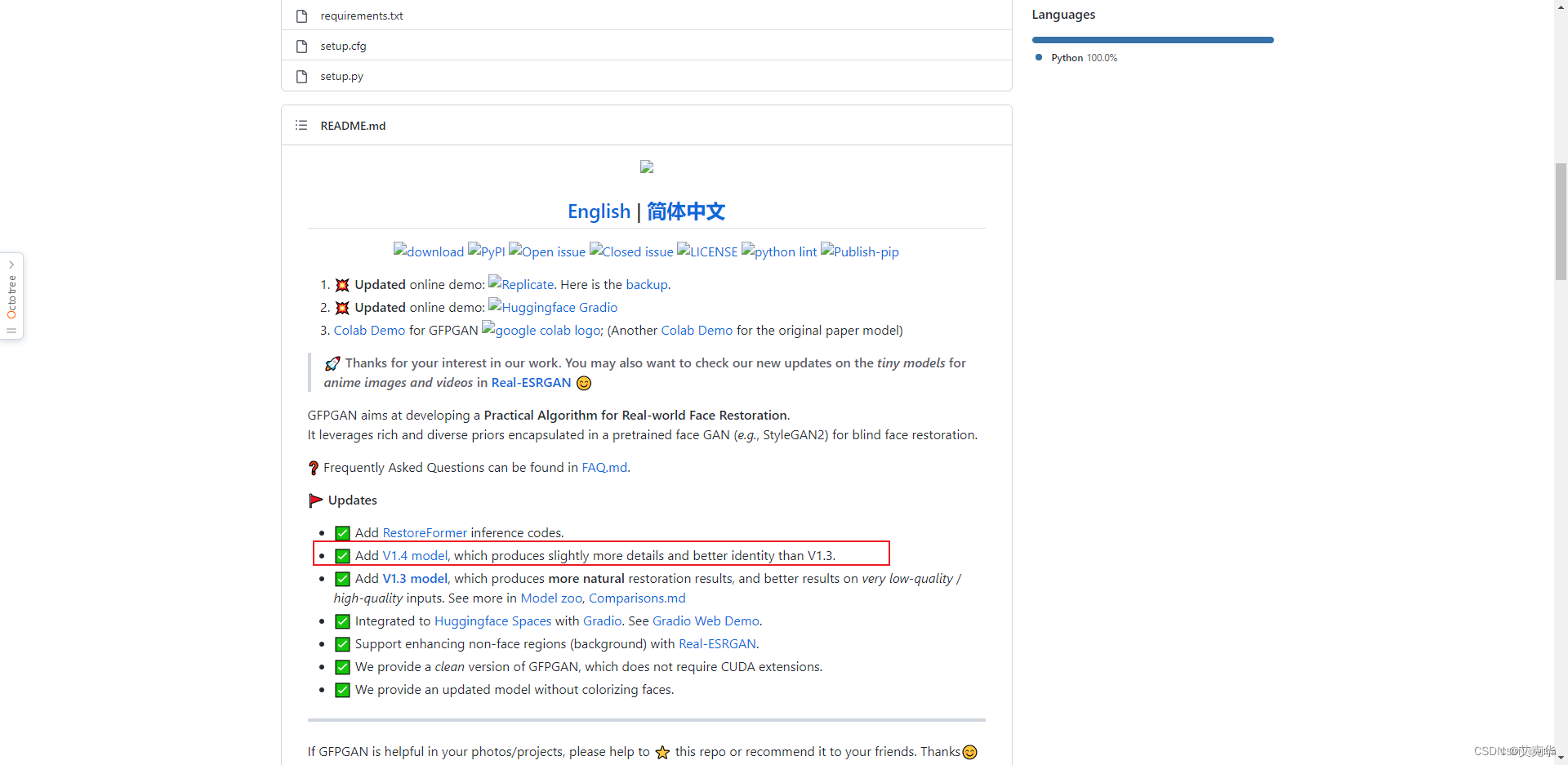

3、GFPGAN

这是腾讯旗下的一个开源项目,可以用于修复和绘制人脸,减少stable diffusion人脸的绘制扭曲变形问题

地址:https://github.com/TencentARC/GFPGAN

点击蓝色的1.4就可以下载。

下载好之后,放在sd-webui项目的根目录下面即可,比如我的根目录是D:\stable-diffusion-webui

![[架构之路-204]- 常见的需求分析技术:结构化分析与面向对象分析](https://img-blog.csdnimg.cn/9355ae02c9ff42418f8d5f87968c690d.png)