😄 使用LLM来搭建一个定制的聊天机器人,只需要很少的工作量。

⭐ 本文将讲解如何利用聊天格式与个性化或专门针对特兹那个任务或行为的聊天机器人进行多伦对话。

文章目录

- 1、提供对话的早期部分,引导模型继续聊天

- 2、示例:构建一个“订餐机器人”

⭐ 下面以openai的chatgpt为例讲解,通过openai的接口调用自己的chatgpt账号

import openai

openai.api_key = 'sk-xxxxx' # 填自己的api key

接下来,我们将定义两个辅助函数。第一个是单轮的,我们将prompt放入看起来像是某种用户消息的东西中。另一个则传入一个消息列表。这些消息可以来自不同的角色,我们会描述一下这些角色。

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 控制模型输出的随机程度

)

return response.choices[0].message["content"]

def get_completion_from_messages(messages, model="gpt-3.5-turbo", temperature=0):

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=temperature, # 控制模型输出的随机程度

)

return response.choices[0].message["content"]

1、提供对话的早期部分,引导模型继续聊天

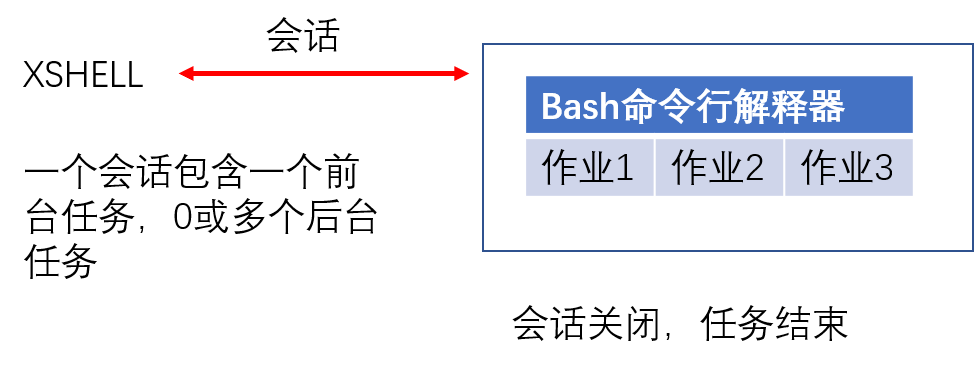

每次与语言模型的交互都是一个独立的交互,这意味着我们必须提供所有相关的消息,以便模型在当前对话中进行引用。如果想让模型引用或 “记住” 对话的早期部分,则必须在模型的输入中提供早期的交流。我们将其称为上下文,如下所示,我们给模型输入了早期的对话内容,并考查他是否记住,模型也正确的做出了回应。

- 第一条消息是一个系统消息,它提供了一个总体的指示,然后在这个消息之后,我们有用户和助手之间的交替。如果你曾经使用过 ChatGPT 网页界面,那么你的消息是用户消息,而 ChatGPT 的消息是助手消息。系统消息则有助于设置助手的行为和角色,并作为对话的高级指示。你可以想象它在助手的耳边低语,引导它的回应,而用户不会注意到系统消息。

因此,作为用户,如果你曾经使用过 ChatGPT,你可能不知道 ChatGPT 的系统消息是什么,这是有意为之的。系统消息的好处是为开发者提供了一种方法,在不让请求本身成为对话的一部分的情况下,引导助手并指导其回应。

messages = [

{'role':'system', 'content':'你是个友好的聊天机器人。'},

{'role':'user', 'content':'Hi, 我是Isa'},

{'role':'assistant', 'content': "Hi Isa! 很高兴认识你。今天有什么可以帮到你的吗?"},

{'role':'user', 'content':'是的,你可以提醒我, 我的名字是什么?'} ]

response = get_completion_from_messages(messages, temperature=1)

print(response)

输出:

当然可以!您的名字是Isa。

类似地,在chatgpt中我们可以这样问:

2、示例:构建一个“订餐机器人”

任务:我们需要它自动收集用户信息,接受比萨饼店的订单。

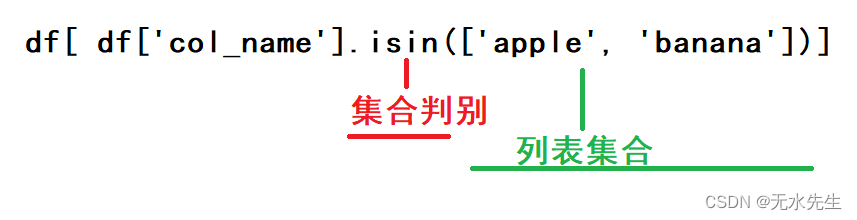

因为是聊天机器人,所以需要保存每次的聊天记录(上下文),方便以后再次聊天时回顾之前的记录来继续聊天。下面我们用列表context来记录每次的聊天内容,新的聊天内容会不断append到context中。上下文逐渐变长。这样,模型就有了需要的信息来确定下一步要做什么。

初始的上下文包含了包含菜单的系统消息。请注意,上下文会随着时间的推移而不断增长。

context = [{'role':'system', 'content':"""

你是订餐机器人,为披萨餐厅自动收集订单信息。

你要首先问候顾客。然后等待用户回复收集订单信息。收集完信息需确认顾客是否还需要添加其他内容。

最后需要询问是否自取或外送,如果是外送,你要询问地址。

最后告诉顾客订单总金额,并送上祝福。

请确保明确所有选项、附加项和尺寸,以便从菜单中识别出该项唯一的内容。

你的回应应该以简短、非常随意和友好的风格呈现。

菜单包括:

菜品:

意式辣香肠披萨(大、中、小) 12.95、10.00、7.00

芝士披萨(大、中、小) 10.95、9.25、6.50

茄子披萨(大、中、小) 11.95、9.75、6.75

薯条(大、小) 4.50、3.50

希腊沙拉 7.25

配料:

奶酪 2.00

蘑菇 1.50

香肠 3.00

加拿大熏肉 3.50

AI酱 1.50

辣椒 1.00

饮料:

可乐(大、中、小) 3.00、2.00、1.00

雪碧(大、中、小) 3.00、2.00、1.00

瓶装水 5.00

"""} ] # accumulate messages

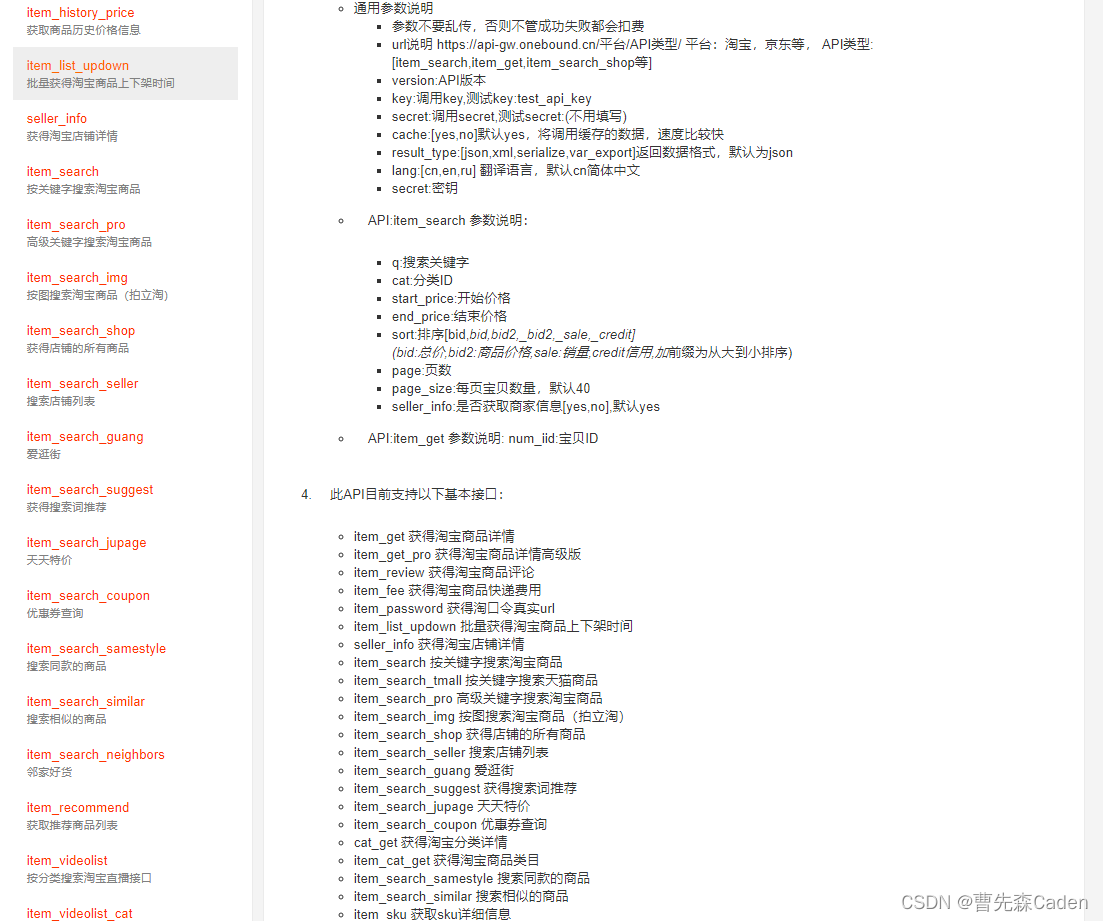

现在我们可以要求模型创建一个 JSON 摘要发送给订单系统。

所以我们追加另一个系统消息,它是另一条prompt,我们说创建一个刚刚订单的 JSON 摘要,列出每个项目的价格,字段应包括1)披萨,包括尺寸,2)配料列表,3)饮料列表,4)辅菜列表,包括尺寸,最后是总价格。也可以在这里使用用户消息,不一定是系统消息。

请注意,这里我们使用了一个较低的temperature,因为对于这些类型的任务,我们希望输出相对可预测。

messages.append(

{'role':'system', 'content':'创建上一个食品订单的 json 摘要。\

逐项列出每件商品的价格,字段应该是 1) 披萨,包括大小 2) 配料列表 3) 饮料列表,包括大小 4) 配菜列表包括大小 5) 总价'},

)

输出:

response = get_completion_from_messages(messages, temperature=0)

print(response)

以下是上一个食品订单的 JSON 摘要:

```

{

"order": {

"pizza": {

"type": "芝士披萨",

"size": "大",

"price": 10.95

},

"toppings": [

{

"name": "蘑菇",

"price": 1.5

}

],

"drinks": [

{

"name": "雪碧",

"size": "大",

"price": 3

},

{

"name": "雪碧",

"size": "大",

"price": 3

}

],

.........

}

}

```

以上,便建立了自己的订餐聊天机器人(你也可以加个界面封装一下,这样看起来像是背后一个专人在服务你哈哈哈)。请随意自定义并修改系统消息,以更改聊天机器人的行为,并使其扮演不同的角色和拥有不同的知识。

参考链接:

[1] OpenAI

[2] 吴恩达老师的:DeepLearning.AI

[3] DataWhale

[4] https://learn.deeplearning.ai/