文章目录

- 一、资源清单

- 二、系统初始化

- 2.1 所有服务器配置

- 2.2 master节点配置

- 三、nginx+keepalived

- 3.1 主备机器上进行

- 3.2 配置主节点

- 3.3 配置备节点

- 3.4 启动服务

- 四、部署etcd集群

- 4.1 资源清单

- 4.2 生成Etcd证书

- 4.3 部署Etcd集群

- 五、安装Docker/kubeadm/kubelet

- 5.1 安装docker

- 5.2 安装cri-dockerd

- 六、部署Kubernetes Master

- 6.1 初始化Master1

- 6.2 初始化Master2

- 6.3 加入node节点

- 6.4 测试VIP

- 七、部署网络组件

- 八、部署 Dashboard

- 九、访问web

一、资源清单

| 角色 | IP | 配置 | 安装服务 | 操作系统 |

|---|---|---|---|---|

| k8s-master1 | 192.168.130.145 | 2核2G50G | docker、etcd、nginx、keepalived | CentOS 7.5.1804 (mini) |

| k8s-master2 | 192.168.130.146 | 2核2G50G | docker、etcd、nginx、keepalived | CentOS 7.5.1804 (mini) |

| k8s-node1 | 192.168.130.147 | 2核2G50G | docker、etcd | CentOS 7.5.1804 (mini) |

二、系统初始化

2.1 所有服务器配置

##关闭防火墙。

systemctl stop firewalld

systemctl disable firewalld

##关闭selinux

sed -i 's/enforcing/disabled/' /etc/selinux/config ##永久关闭。

setenforce 0 ##临时关闭。

##关闭swap

swapoff -a ##临时关闭

sed -ri 's/.*swap.*/#&/' /etc/fstab ##永久关闭

##根据规划设置主机名

hostnamectl set-hostname k8s-master1

hostnamectl set-hostname k8s-master2

hostnamectl set-hostname k8s-node1

##将桥接的IPv4流量传递到iptables的链

cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

sysctl --system ##重新读取生效

##时间同步

yum install ntpdate -y

ntpdate time.windows.com

2.2 master节点配置

##在所有master添加hosts

cat >> /etc/hosts << EOF

192.168.130.145 k8s-master1

192.168.130.146 k8s-master2

192.168.140.147 k8s-node1

EOF

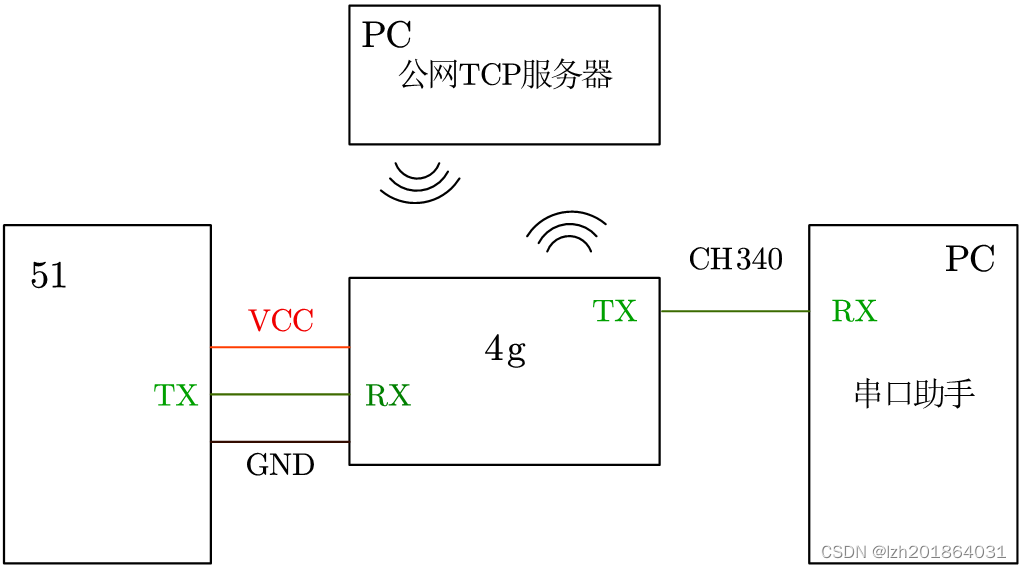

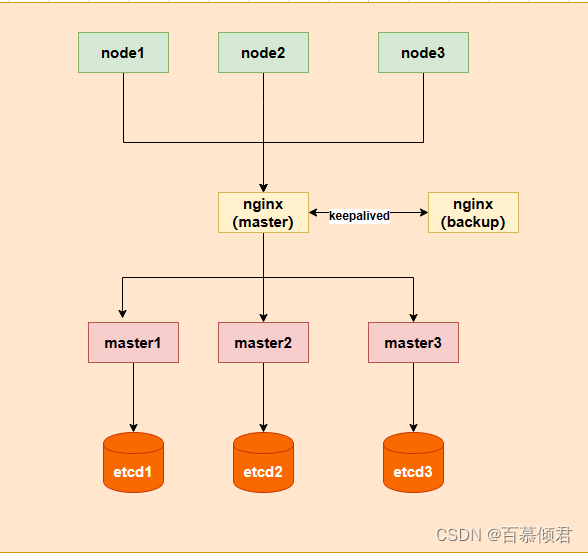

三、nginx+keepalived

基本了解:

- K8s作为容器集群系统,通过健康检查+重启策略实现了Pod故障自我修复能力,通过调度算法实现将Pod分布式部署,并保持预期副本数,根据Node失效状态自动在其他Node拉起Pod,实现了应用层的高可用性。

- 针对K8s集群,高可用性还应包含以下两个层面的考虑:Etcd数据库的高可用性和Kubernetes Master组件的高可用性。 而kubeadm搭建的K8s集群,Etcd只起了一个,存在单点,所以我们这里会独立搭建一个Etcd集群。

- Master节点扮演着总控中心的角色,通过不断与工作节点上的Kubelet和kube-proxy进行通信来维护整个集群的健康工作状态。如果Master节点故障,将无法使用kubectl工具或者API做任何集群管理。

- Master节点主要有三个服务kube-apiserver、kube-controller-manager和kube-scheduler,其中kube-controller-manager和kube-scheduler组件自身通过选举机制已经实现了高可用,所以Master高可用主要针对kube-apiserver组件,而该组件是以HTTP API提供服务,因此对他高可用与Web服务器类似,增加负载均衡器对其负载均衡即可,并且可水平扩容。

服务作用:

- Nginx是一个主流Web服务和反向代理服务器,这里用四层实现对apiserver实现负载均衡。

- Keepalived是一个主流高可用软件,基于VIP绑定实现服务器双机热备,Keepalived主要根据Nginx运行状态判断是否需要故障转移(偏移VIP)。当Nginx主节点挂掉,VIP会自动绑定在Nginx备节点,从而保证VIP一直可用,实现Nginx高可用。

注意事项:

- 为了节省机器,这里与K8s master节点机器复用。也可以独立于k8s集群之外部署,只要nginx与apiserver能通信就行。

3.1 主备机器上进行

##安装服务。

yum install epel-release -y

yum install nginx keepalived -y

##修改nginx配置文件。

cat > /etc/nginx/nginx.conf << "EOF"

user nginx;

worker_processes auto;

error_log /var/log/nginx/error.log;

pid /run/nginx.pid;

include /usr/share/nginx/modules/*.conf;

events {

worker_connections 1024;

}

# 四层负载均衡,为两台Master apiserver组件提供负载均衡。

stream {

log_format main '$remote_addr $upstream_addr - [$time_local] $status $upstream_bytes_sent';

access_log /var/log/nginx/k8s-access.log main;

upstream k8s-apiserver {

server 192.168.130.145:6443; # Master1 APISERVER IP:PORT

server 192.168.130.146:6443; # Master2 APISERVER IP:PORT

}

server {

listen 16443; # 由于nginx与master节点复用,这个监听端口不能是6443,否则会冲突

proxy_pass k8s-apiserver;

}

}

http {

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

tcp_nopush on;

tcp_nodelay on;

keepalive_timeout 65;

types_hash_max_size 2048;

include /etc/nginx/mime.types;

default_type application/octet-stream;

}

EOF

3.2 配置主节点

- vrrp_script:指定检查nginx工作状态脚本(根据nginx状态判断是否故障转移).

- virtual_ipaddress:虚拟IP(VIP)

##修改配置文件。

cat > /etc/keepalived/keepalived.conf << EOF

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 127.0.0.1

smtp_connect_timeout 30

router_id NGINX_MASTER

}

vrrp_script check_nginx {

script "/etc/keepalived/check_nginx.sh" # 判断返回状态码

}

vrrp_instance VI_1 {

state MASTER

interface ens33 # 修改为实际网卡名

virtual_router_id 51 # VRRP 路由 ID实例,每个实例是唯一的

priority 100 # 优先级,备服务器设置 90

advert_int 1 # 指定VRRP 心跳包通告间隔时间,默认1秒

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.130.151/24 #VIP

}

track_script {

check_nginx

}

}

EOF

##生成检查nginx运行状态的脚本。

cat > /etc/keepalived/check_nginx.sh << "EOF"

#!/bin/bash

code=$(curl -k https://127.0.0.1:16443/version -s -o /dev/null -w %{http_code})

if [ "$code" -ne 200 ];then

exit 1

else

exit 0

fi

EOF

##添加执行权限。

chmod +x /etc/keepalived/check_nginx.sh

3.3 配置备节点

##修改配置文件。

cat > /etc/keepalived/keepalived.conf << EOF

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 127.0.0.1

smtp_connect_timeout 30

router_id NGINX_BACKUP

}

vrrp_script check_nginx {

script "/etc/keepalived/check_nginx.sh"

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

virtual_router_id 51 # VRRP 路由 ID实例,每个实例是唯一的

priority 90

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.130.151/24 #VIP。

}

track_script {

check_nginx

}

}

EOF

##生成检查nginx运行状态的脚本。

cat > /etc/keepalived/check_nginx.sh << "EOF"

#!/bin/bash

code=$(curl -k https://127.0.0.1:16443/version -s -o /dev/null -w %{http_code})

if [ "$code" -ne 200 ];then

exit 1

else

exit 0

fi

EOF

##添加执行权限。

chmod +x /etc/keepalived/check_nginx.sh

3.4 启动服务

- 主备节点都进行。

##重新读取。

systemctl daemon-reload

##启动nginx服务。

yum -y install nginx-mod-stream

systemctl start nginx

systemctl enable nginx

##启动keepalived服务。

systemctl start keepalived

systemctl enable keepalived

四、部署etcd集群

- Etcd 是一个分布式键值存储系统,Kubernetes使用Etcd进行数据存储,kubeadm搭建默认情况下只启动一个Etcd Pod,存在单点故障,生产环境强烈不建议,所以我们这里使用3台服务器组建集群,可容忍1台机器故障,当然,你也可以使用5台组建集群,可容忍2台机器故障。

4.1 资源清单

- 为了节省机器,这里与K8s节点机器复用。也可以独立于k8s集群之外部署,只要apiserver能连接到就行。

| 节点名称 | IP |

|---|---|

| etcd-1 | 192.168.130.145 |

| etcd-2 | 192.168.130.146 |

| etcd-3 | 192.168.130.147 |

4.2 生成Etcd证书

1.准备cfssl证书生成工具。

- cfssl是一个开源的证书管理工具,使用json文件生成证书,相比openssl更方便使用。

- 找任意一台服务器操作,这里用Master节点。

wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64

wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64

wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64

chmod +x cfssl_linux-amd64 cfssljson_linux-amd64 cfssl-certinfo_linux-amd64

mv cfssl_linux-amd64 /usr/local/bin/cfssl

mv cfssljson_linux-amd64 /usr/local/bin/cfssljson

mv cfssl-certinfo_linux-amd64 /usr/bin/cfssl-certinfo

2.自签证书颁发机构(CA),创建工作目录。

mkdir -p ~/etcd_tls

cd ~/etcd_tls

#自签CA:

cat > ca-config.json << EOF

{

"signing": {

"default": {

"expiry": "87600h"

},

"profiles": {

"www": {

"expiry": "87600h",

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

]

}

}

}

}

EOF

cat > ca-csr.json << EOF

{

"CN": "etcd CA",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "Beijing",

"ST": "Beijing"

}

]

}

EOF

3.生成证书。会生成ca.pem和ca-key.pem文件。

cfssl gencert -initca ca-csr.json | cfssljson -bare ca -

4.使用自签CA签发Etcd HTTPS证书,创建证书申请文件。

- 上述文件hosts字段中IP为所有etcd节点的集群内部通信IP,一个都不能少!

- 为了方便后期扩容可以多写几个预留的IP。

cat > server-csr.json << EOF

{

"CN": "etcd",

"hosts": [

"192.168.130.145",

"192.168.130.146",

"192.168.130.147"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing"

}

]

}

EOF

5.生成证书,会生成server.pem和server-key.pem文件。

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=www server-csr.json | cfssljson -bare server

4.3 部署Etcd集群

1.下载二进制文件,下载地址

2.在k8s-master1上操作,创建工作目录并解压二进制包。

mkdir /opt/etcd/{bin,cfg,ssl} -p

tar zxvf etcd-v3.4.9-linux-amd64.tar.gz

mv etcd-v3.4.9-linux-amd64/{etcd,etcdctl} /opt/etcd/bin/

3.在k8s-master1上操作,创建etcd配置文件。

参数说明:

- ETCD_NAME:节点名称,集群中唯一。

- ETCD_DATA_DIR:数据目录

- ETCD_LISTEN_PEER_URLS:集群通信监听地址

- ETCD_LISTEN_CLIENT_URLS:客户端访问监听地址

- ETCD_INITIAL_ADVERTISEPEERURLS:集群通告地址

- ETCD_ADVERTISE_CLIENT_URLS:客户端通告地址

- ETCD_INITIAL_CLUSTER:集群节点地址

- ETCD_INITIAL_CLUSTER_TOKEN:集群Token

- ETCD_INITIAL_CLUSTER_STATE:加入集群的当前状态,new是新集群,existing表示加入已有集群

cat > /opt/etcd/cfg/etcd.conf << EOF

#[Member]

ETCD_NAME="etcd-1"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.130.145:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.130.145:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.130.145:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.130.145:2379"

ETCD_INITIAL_CLUSTER="etcd-1=https://192.168.130.145:2380,etcd-2=https://192.168.130.146:2380,etcd-3=https://192.168.130.147:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

EOF

4.k8s-master1上操作,设置成系统服务。

cat > /usr/lib/systemd/system/etcd.service << EOF

[Unit]

Description=Etcd Server

After=network.target

After=network-online.target

Wants=network-online.target

[Service]

Type=notify

EnvironmentFile=/opt/etcd/cfg/etcd.conf

ExecStart=/opt/etcd/bin/etcd \

--cert-file=/opt/etcd/ssl/server.pem \

--key-file=/opt/etcd/ssl/server-key.pem \

--trusted-ca-file=/opt/etcd/ssl/ca.pem \

--peer-cert-file=/opt/etcd/ssl/server.pem \

--peer-key-file=/opt/etcd/ssl/server-key.pem \

--peer-trusted-ca-file=/opt/etcd/ssl/ca.pem \

--logger=zap

Restart=on-failure

LimitNOFILE=65536

[Install]

WantedBy=multi-user.target

EOF

5.k8s-master1上操作,拷贝刚才生成的证书,把刚才生成的证书拷贝到配置文件中的路径。

cp ~/etcd_tls/ca*pem ~/etcd_tls/server*pem /opt/etcd/ssl/

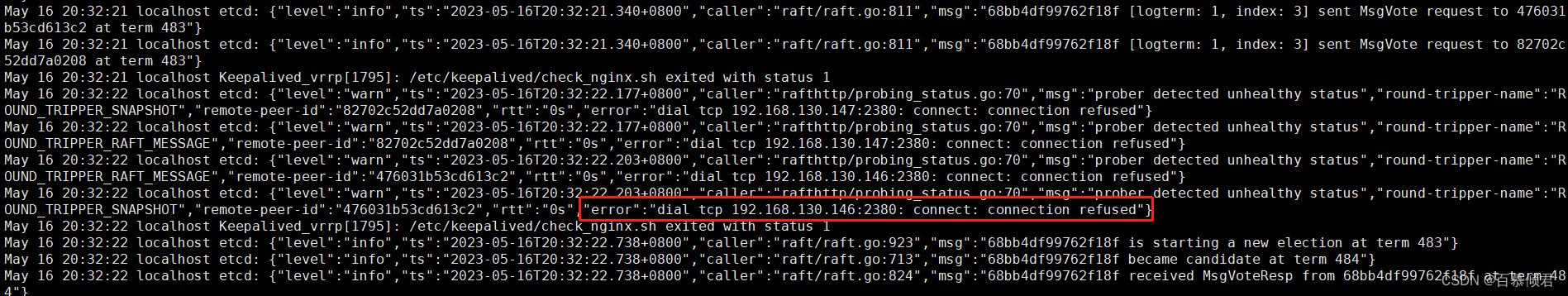

6.k8s-master1上操作,启动并设置开机启动。若启动一场可以查看日志,原因是连不上其他节点的etcd,可以先把其他节点的etcd部署上来再回过来启动该节点的。

systemctl daemon-reload

systemctl start etcd

systemctl enable etcd

7.k8s-master1上操作,将上面节点1所有生成的文件拷贝到节点2和节点3。

scp -r /opt/etcd/ root@192.168.130.146:/opt/

scp /usr/lib/systemd/system/etcd.service root@192.168.130.146:/usr/lib/systemd/system/

scp -r /opt/etcd/ root@192.168.130.147:/opt/

scp /usr/lib/systemd/system/etcd.service root@192.168.130.147:/usr/lib/systemd/system/

8.修改节点2上的etcd.conf配置文件,包括节点名称、当前服务器IP。

##修改节点2。

[root@k8s-master2 ~]# cat /opt/etcd/cfg/etcd.conf

#[Member]

ETCD_NAME="etcd-2"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.130.146:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.130.146:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.130.146:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.130.146:2379"

ETCD_INITIAL_CLUSTER="etcd-1=https://192.168.130.145:2380,etcd-2=https://192.168.130.146:2380,etcd-3=https://192.168.130.147:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

#启动并设置开机自启。

systemctl daemon-reload

systemctl start etcd

systemctl enable etcd

9.修改节点3上的etcd.conf配置文件,包括节点名称、当前服务器IP。

##修改节点3。

[root@k8s-node1 ~]# cat /opt/etcd/cfg/etcd.conf

#[Member]

ETCD_NAME="etcd-3"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.130.147:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.130.147:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.130.147:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.130.147:2379"

ETCD_INITIAL_CLUSTER="etcd-1=https://192.168.130.145:2380,etcd-2=https://192.168.130.146:2380,etcd-3=https://192.168.130.147:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

#启动并设置开机自启。

systemctl daemon-reload

systemctl start etcd

systemctl enable etcd

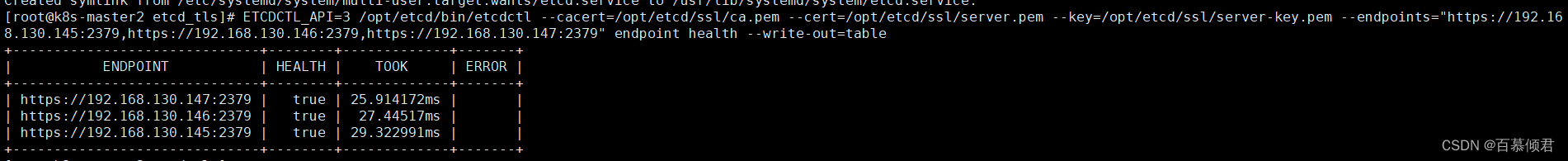

10.查看etcd集群状态。

- 若输出信息信息为True,就说明etcd集群部署成功。

- 若部署过程中有问题,则第一步先看日志/var/log/message 或 journalctl -u etcd

ETCDCTL_API=3 /opt/etcd/bin/etcdctl --cacert=/opt/etcd/ssl/ca.pem --cert=/opt/etcd/ssl/server.pem --key=/opt/etcd/ssl/server-key.pem --endpoints="https://192.168.130.145:2379,https://192.168.130.146:2379,https://192.168.130.147:2379" endpoint health --write-out=table

五、安装Docker/kubeadm/kubelet

- 以下操作所有节点进行。

- 这里使用Docker作为容器引擎,也可以换成别的,例如containerd

5.1 安装docker

1.下载安装包,启动。

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

yum -y install docker-ce

systemctl enable docker && systemctl start docker

2.配置镜像下载加速器:

cat > /etc/docker/daemon.json << EOF

{

"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

EOF

systemctl restart docker

docker info

5.2 安装cri-dockerd

- 以下操作所有节点进行。

1.下载安装。

wget https://github.com/Mirantis/cri-dockerd/releases/download/v0.3.1/cri-dockerd-0.3.1-3.el7.x86_64.rpm

rpm -ivh cri-dockerd-0.3.1-3.el7.x86_64.rpm

2.指定依赖镜像地址后重启。

vi /usr/lib/systemd/system/cri-docker.service

ExecStart=/usr/bin/cri-dockerd --container-runtime-endpoint fd:// --pod-infra-container-image=registry.aliyuncs.com/google_containers/pause:3.7

systemctl daemon-reload

systemctl enable cri-docker && systemctl start cri-docker

3.添加阿里云YUM软件源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

4.安装kubeadm,kubelet和kubectl

yum install -y kubelet-1.25.0 kubeadm-1.25.0 kubectl-1.25.0

systemctl enable kubelet

六、部署Kubernetes Master

6.1 初始化Master1

1.生成初始化配置文件。

cat > kubeadm-config.yaml << EOF

apiVersion: kubeadm.k8s.io/v1beta2

bootstrapTokens:

- groups:

- system:bootstrappers:kubeadm:default-node-token

token: 9037x2.tcaqnpaqkra9vsbw

ttl: 24h0m0s

usages:

- signing

- authentication

kind: InitConfiguration

localAPIEndpoint:

advertiseAddress: 192.168.130.145

bindPort: 6443

nodeRegistration:

criSocket: /var/run/cri-dockerd.sock

name: k8s-master1

taints:

- effect: NoSchedule

key: node-role.kubernetes.io/master

---

apiServer:

certSANs: ##包含所有Master/LB/VIP IP,一个都不能少!为了方便后期扩容可以多写几个预留的IP。

- k8s-master1

- k8s-master2

- 192.168.130.145

- 192.168.130.146

- 192.168.130.147

- 192.168.130.151

- 127.0.0.1

extraArgs:

authorization-mode: Node,RBAC

timeoutForControlPlane: 4m0s

apiVersion: kubeadm.k8s.io/v1beta2

certificatesDir: /etc/kubernetes/pki

clusterName: kubernetes

controlPlaneEndpoint: 192.168.130.151:16443 # 负载均衡虚拟IP(VIP)和端口

controllerManager: {}

dns:

type: CoreDNS

etcd:

external: # 使用外部etcd

endpoints:

- https://192.168.130.145:2379 # etcd集群3个节点

- https://192.168.130.146:2379

- https://192.168.130.147:2379

caFile: /opt/etcd/ssl/ca.pem # 连接etcd所需证书

certFile: /opt/etcd/ssl/server.pem

keyFile: /opt/etcd/ssl/server-key.pem

imageRepository: registry.aliyuncs.com/google_containers # 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址

kind: ClusterConfiguration

kubernetesVersion: v1.25.0 # K8s版本,与上面安装的一致

networking:

dnsDomain: cluster.local

podSubnet: 10.244.0.0/16 # Pod网络,与下面部署的CNI网络组件yaml中保持一致

serviceSubnet: 10.96.0.0/12 # 集群内部虚拟网络,Pod统一访问入口

scheduler: {}

EOF

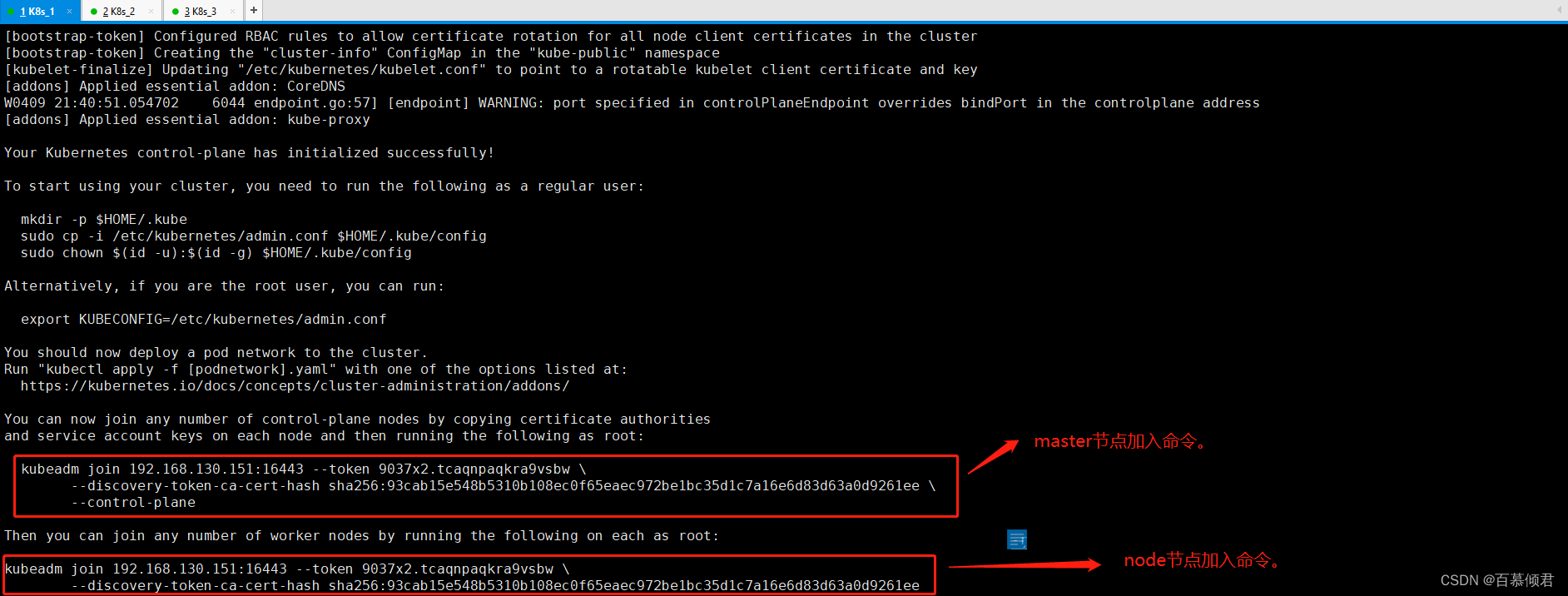

2.开始初始化。初始化完成后,会有两个join的命令,带有 --control-plane 是用于加入组建多master集群的,不带的是加入节点的。

kubeadm init --config kubeadm-config.yaml

3.拷贝kubectl使用的连接k8s认证文件到默认路径。

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

4.将Master1节点生成的证书拷贝到Master2。

scp -r /etc/kubernetes/pki/ 192.168.130.146:/etc/kubernetes/

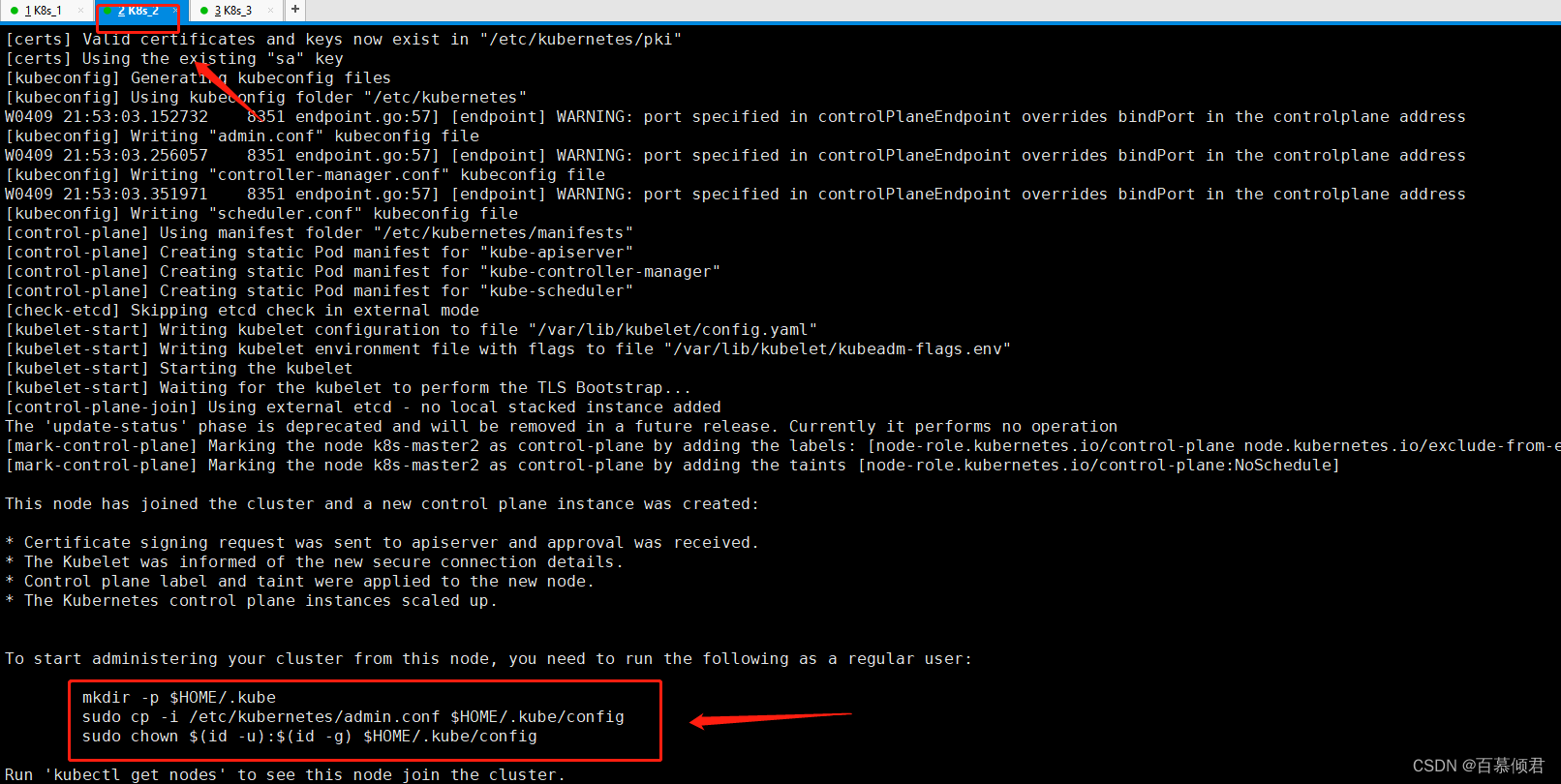

6.2 初始化Master2

1.复制刚刚在master1生成的master join命令在master2执行。

kubeadm join 192.168.130.151:16443 --token 9037x2.tcaqnpaqkra9vsbw --discovery-token-ca-cert-hash sha256:93cab15e548b5310b108ec0f65eaec972be1bc35d1c7a16e6d83d63a0d9261ee --control-plane --cri-socket=unix:///var/run/cri-dockerd.sock

2.在master2上初始化完成后也会有一串命令,拷贝kubectl使用的连接k8s认证文件到默认路径。

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

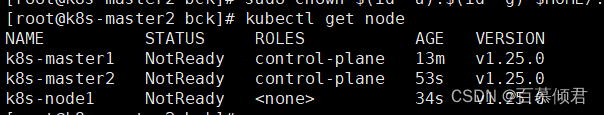

6.3 加入node节点

- 默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,可以直接使用命令快捷生成:kubeadm token create --print-join-command

1.在node节点上执行,加入节点,后续其他node节点也是这样加入

kubeadm join 192.168.130.151:16443 --token 9037x2.tcaqnpaqkra9vsbw --discovery-token-ca-cert-hash sha256:93cab15e548b5310b108ec0f65eaec972be1bc35d1c7a16e6d83d63a0d9261ee --cri-socket=unix:///var/run/cri-dockerd.sock

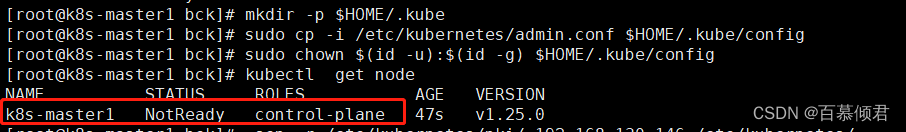

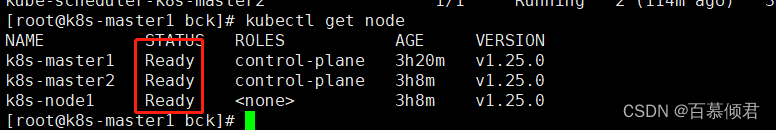

2.在master节点上查看。由于网络插件还没有部署,还没有准备就绪 NotReady

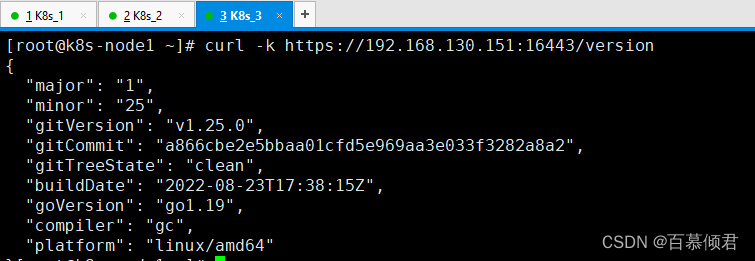

6.4 测试VIP

1.在k8s任何一个节点上执行。可以正确获取到K8s版本信息,说明负载均衡器搭建正常。

- 该请求数据流程:curl -> vip(nginx) -> apiserver

[root@k8s-node1 ~]# curl -k https://192.168.130.151:16443/version

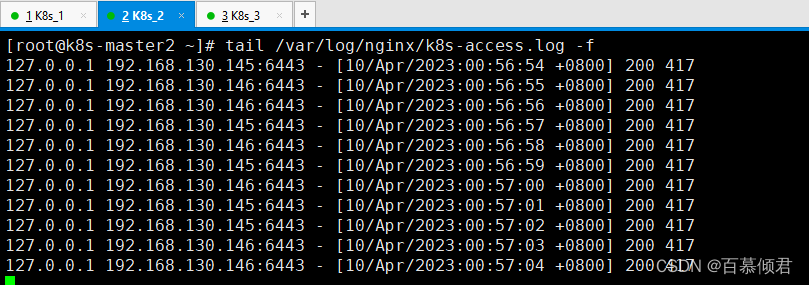

2.通过查看Nginx日志也可以看到转发apiserver IP

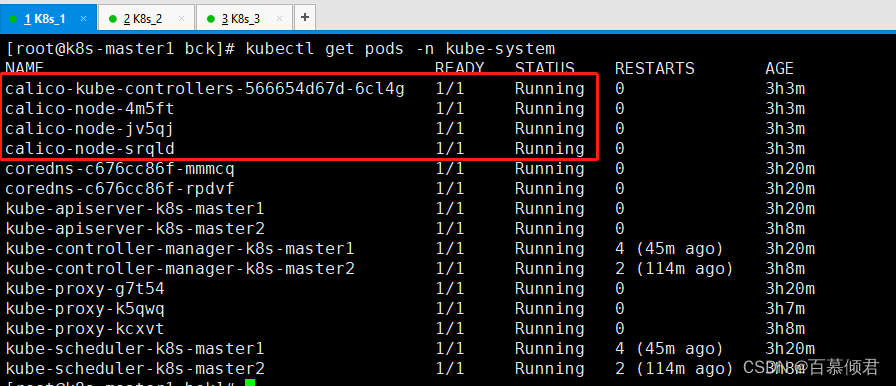

七、部署网络组件

- 官网下载calico.yaml,并修改其中的网络地址,和搭建单节点时一样。

1.部署部署Calico。

kubectl apply -f calico.yaml

kubectl get pods -n kube-system

2.等Calico Pod都Running,节点也会准备就绪。

八、部署 Dashboard

- Dashboard是官方提供的一个UI,可用于基本管理K8s资源。

- kubernetes-dashboard.yaml文件联系博主获取。

1.导入yaml文件。

kubectl apply -f kubernetes-dashboard.yaml

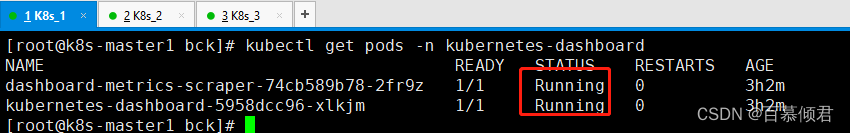

2.查看部署

kubectl get pods -n kubernetes-dashboard

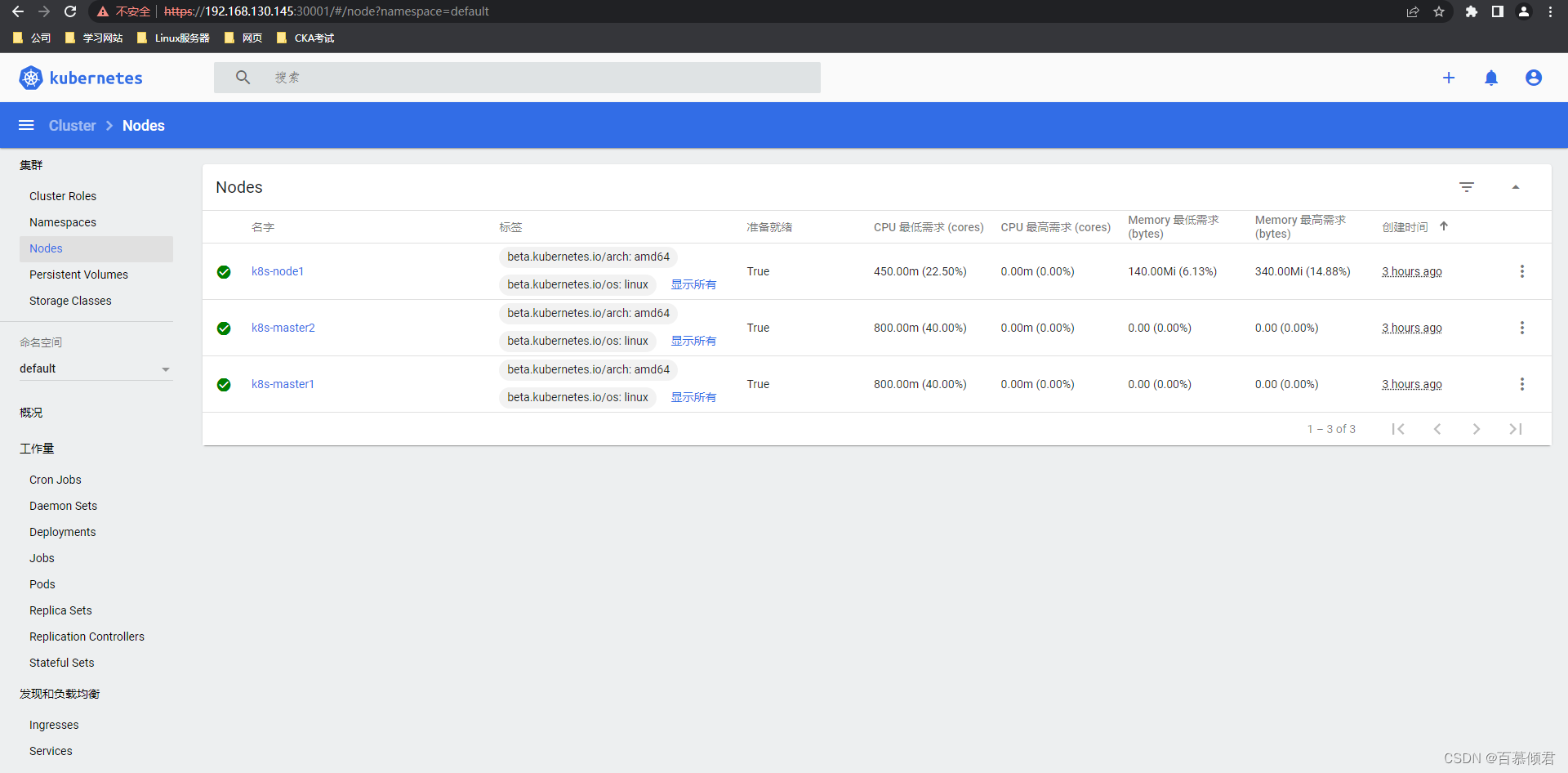

九、访问web

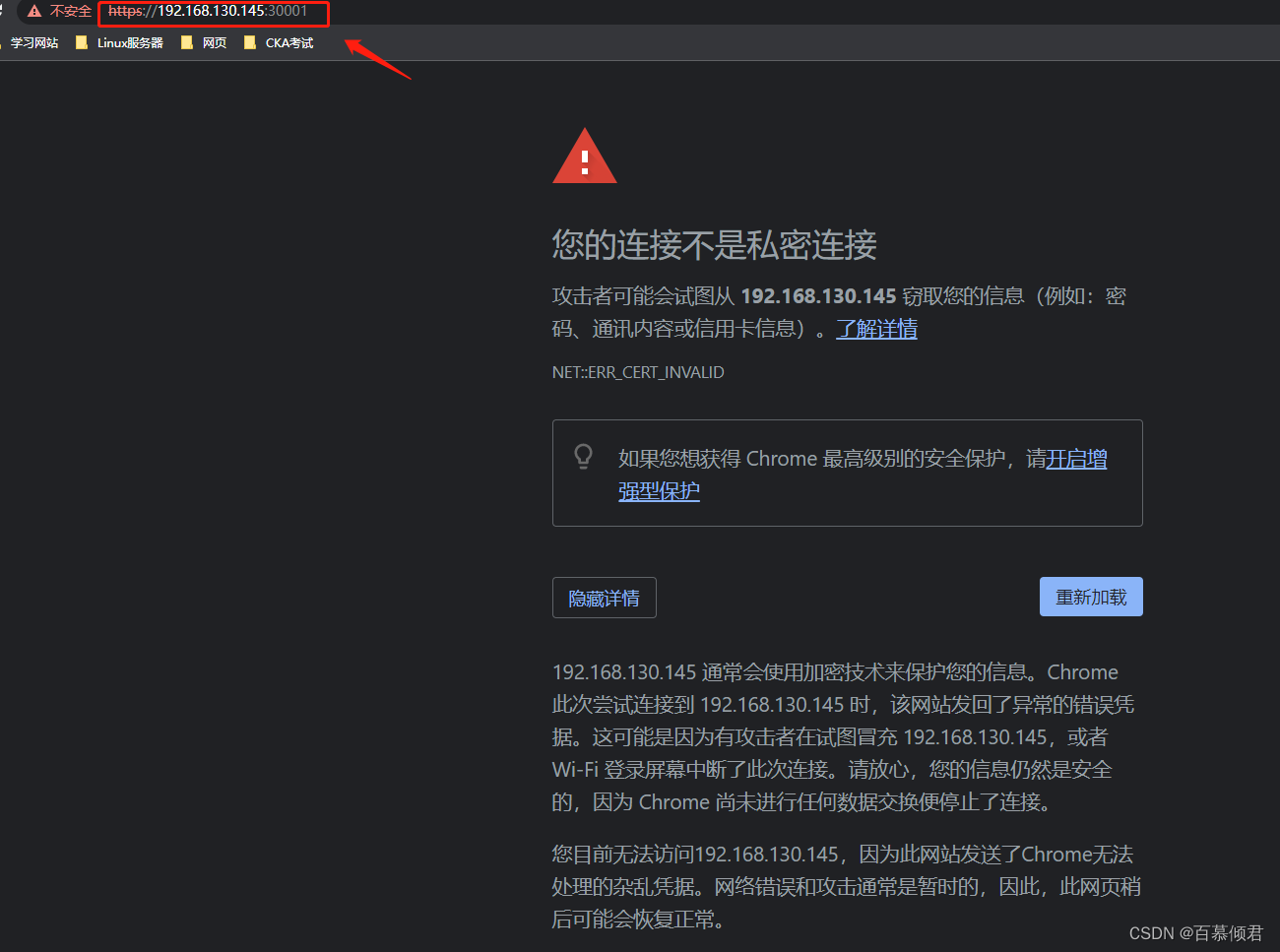

- 访问地址:https://NodeIP:30001

1.访问浏览器发现跳转不进去是因为安全设置太高。

- 原理是chrome认为这个网站是不安全的,不让你访问。而你输入了这句话,就类似于签了生死状,了解了风险。chrome就放你进去,但那之后再出问题也就没有责任了。

2.在当前页面点击任意空白处,直接键盘输入“thisisunsafe”即可解决。输入回车后进入登陆页面。

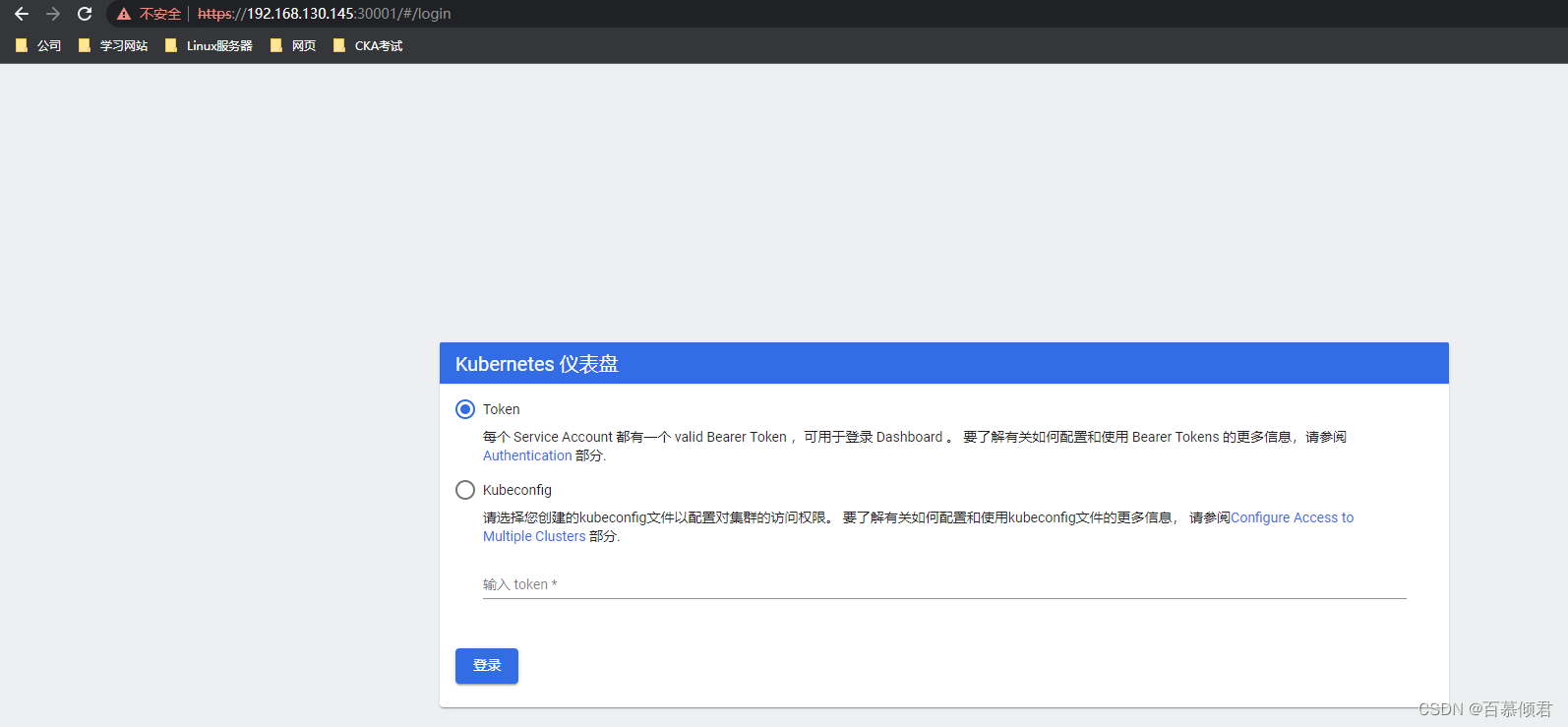

3.创建service account并绑定默认cluster-admin管理员集群角色。

# 创建用户

kubectl create serviceaccount dashboard-admin -n kubernetes-dashboard

# 用户授权

kubectl create clusterrolebinding dashboard-admin --clusterrole=cluster-admin --serviceaccount=kubernetes-dashboard:dashboard-admin

# 获取用户Token

kubectl create token dashboard-admin -n kubernetes-dashboard

4.使用输出的token登录Dashboard。