以实际代码出发,逐行讲解。

完整代码:

import numpy as np

import torch

import matplotlib.pyplot as plt

# load data

xy = np.loadtxt('C:\\Users\\14185\\Desktop\\diabetes.csv', delimiter=',', dtype=np.float32)

x_data = torch.from_numpy(xy[:, :-1])

y_data = torch.from_numpy(xy[:, [-1]])

# define model

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.sigmoid = torch.nn.Sigmoid()

def forward(self, x):

x = self.sigmoid(self.linear1(x))

x = self.sigmoid(self.linear2(x))

x = self.sigmoid(self.linear3(x))

return x

model = Model()

# define loss function and optimizer

criterion = torch.nn.BCELoss(size_average=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.1)

# define list to store losses

losses = []

# train model

for epoch in range(10000):

# Forward

y_pred = model(x_data) # 注意这里没有使用小批量数据集,在后面的课程会讲解如何加载数据集

loss = criterion(y_pred, y_data)

losses.append(loss.item())

# Backward

optimizer.zero_grad()

loss.backward()

# Update

optimizer.step()

# plot losses

plt.plot(range(len(losses)), losses)

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.show()

首先准备数据集

将 CSV 文件中的数据加载到 PyTorch 张量中,以便进行深度学习模型的训练和评估。

xy = np.loadtxt('diabetes.csv', delimiter=',', dtype=np.float32) # 一般GPU只支持32位浮点数

x_data = torch.from_numpy(xy[:,:-1])

y_data = torch.from_numpy(xy[:, [-1]])-

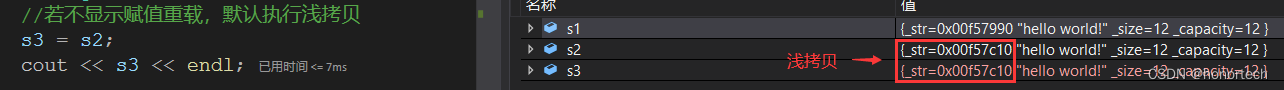

x_data = torch.from_numpy(xy[:, :-1])这一行代码将 NumPy 数组xy的所有行和除最后一列之外的所有列转换为 PyTorch 张量x_data。这个张量包含了输入特征的数据。 -

y_data = torch.from_numpy(xy[:, [-1]])这一行代码将 NumPy 数组xy的所有行和最后一列转换为 PyTorch 张量y_data。这个张量包含了输出标签的数据。

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.sigmoid = torch.nn.Sigmoid()

def forward(self, x):

x = self.sigmoid(self.linear1(x))

x = self.sigmoid(self.linear2(x))

x = self.sigmoid(self.linear3(x))

return x

model = Model()-

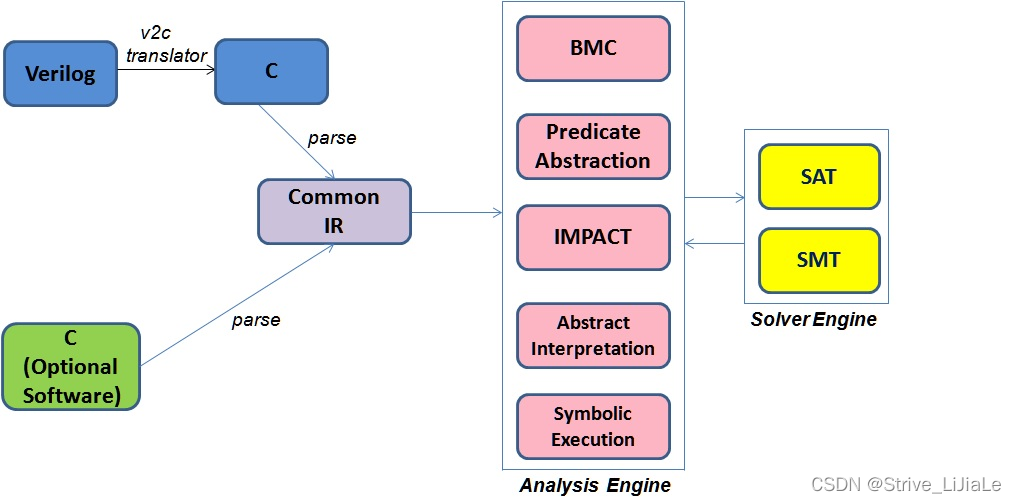

self.linear1 = torch.nn.Linear(8, 6): 这一行代码定义了一个全连接层(也称为线性层),该层有 8 个输入节点和 6 个输出节点。这个层将数据从输入层传递到隐藏层。 -

self.linear2 = torch.nn.Linear(6, 4): 这一行代码定义了第二个全连接层,该层有 6 个输入节点和 4 个输出节点。这个层将数据从第一个隐藏层传递到第二个隐藏层。 -

self.linear3 = torch.nn.Linear(4, 1): 这一行代码定义了第三个全连接层,该层有 4 个输入节点和 1 个输出节点。这个层将数据从第二个隐藏层传递到输出层。 -

self.sigmoid = torch.nn.Sigmoid(): 这一行代码定义了一个 Sigmoid 激活函数,将在模型的前向传播中使用。 -

def forward(self, x):: 这一行代码定义了模型的前向传播函数。这个函数将输入数据x作为参数,将数据从输入层传递到输出层。 -

x = self.sigmoid(self.linear1(x)): 这一行代码将输入数据x传递到第一个全连接层,并将其输出通过 Sigmoid 激活函数进行处理。 -

x = self.sigmoid(self.linear2(x)): 这一行代码将第一个全连接层的输出传递到第二个全连接层,并将其输出通过 Sigmoid 激活函数进行处理。 -

x = self.sigmoid(self.linear3(x)): 这一行代码将第二个全连接层的输出传递到输出层,并将其输出通过 Sigmoid 激活函数进行处理。

为什么对每层都应用一个sigmoid?

criterion = torch.nn.BCELoss(size_average=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.1)-

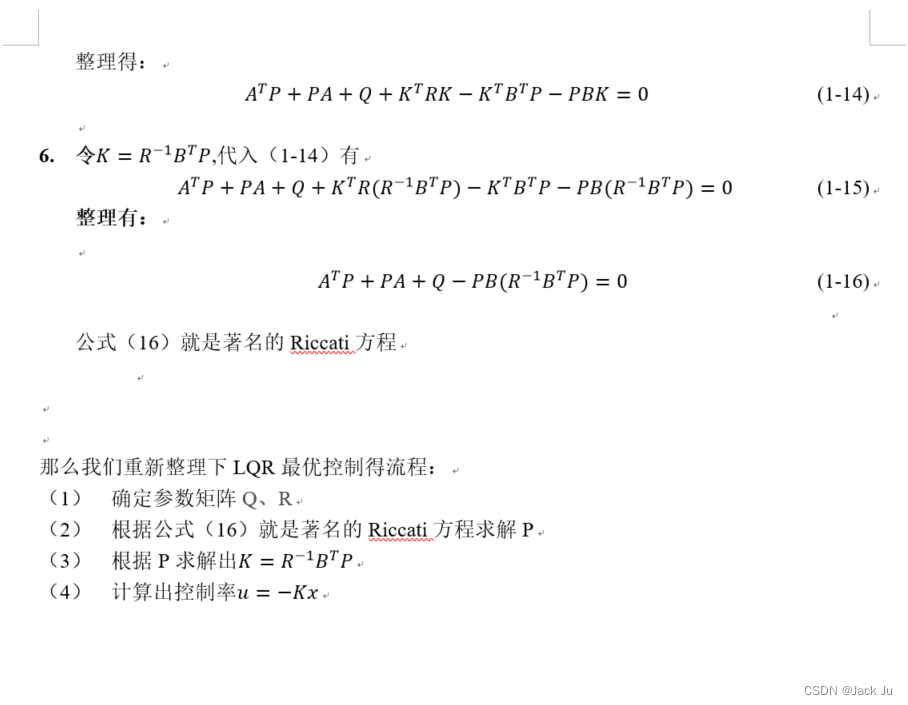

criterion = torch.nn.BCELoss(size_average=True): 创建二元交叉熵损失函数。该损失函数通常用于二元分类问题,计算模型预测值与真实标签之间的差异,可以用于指导模型参数的更新。size_average=True意味着对每个样本的损失值取平均值,并将其用于计算模型的总体损失值。 -

optimizer = torch.optim.SGD(model.parameters(), lr=0.1): 创建随机梯度下降(SGD)优化器。该优化器通常用于训练神经网络,根据损失函数计算的梯度更新网络中的参数。model.parameters()是将所有神经网络中可训练的参数(权重和偏置)作为输入传递给优化器,以便更新它们。lr=0.1表示优化器的学习率为 0.1,它控制了每次更新参数的步长,也影响了模型的训练速度和性能。

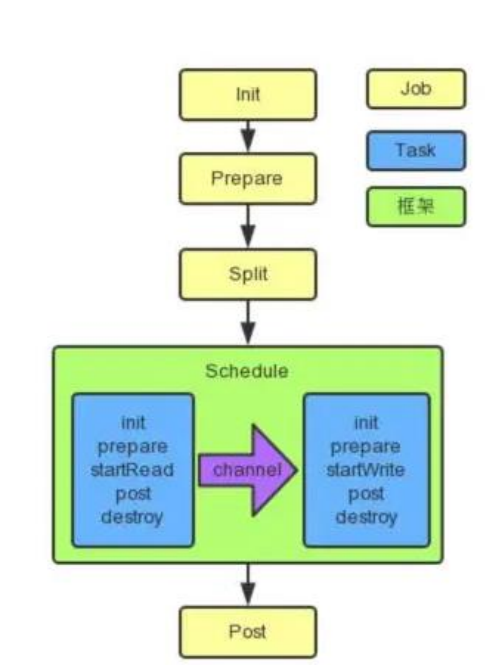

逻辑斯蒂模型的变化

预测目标使用的 含多维特征的数据集——糖尿病数据集(sklearn中 其实也有类似的糖尿病数据集):每个样本/记录(sample/record)有8个维度的信息(feature),并以此进行二分类。Y表示一年后 糖尿病 病情是否加重。