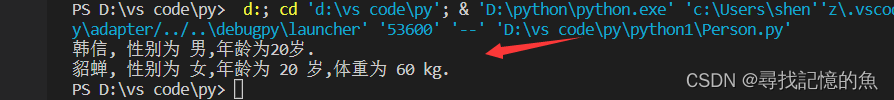

在2001年,微软研究院一位工程师Gordon Bell开始了一段长时间的“生活记录”(Lifelogging)之旅,他会在胸前、头顶或是眼镜腿处佩戴相机,每30秒自动拍摄一张照片,以捕捉自己生命中的瞬间,记录下他发表的文章、演讲,以及家庭活动、即时通讯、电话、备忘录等内容。

也许是受到Bell的启发,市面也陆续出现了各种穿戴式相机方案,比如Google Clips、Narrative Clip 2,或是拍照眼镜Spectacles、Ray-Ban Stories等等。

Narritive Clip 2

时至今日,人们依然在探索可穿戴的相机,不同的是,一些方案选择与AR交互界面结合。比如近期,Humane联合创始人Imran Chaudhri公布了一款轻便的穿戴式AR投影仪,特点是搭载了AI驱动的相机和3D深度传感器,可智能感知周围环境,并显示AR界面,支持用空中手势操控。

不同于AR眼镜,穿戴式AR投影仪可将信息直接投影在手掌等任何表面,好处是可减少面部负担,实现一种裸眼AR效果。Humane还支持计算机视觉、AI助手等功能,可通过摄像头识别真实的物体,并与之产生互动。比如在菜单上显示评价、分析食品是否健康等等。交互方式上,除了手势敲击外,还可以通过语音、设备触控等其他方式操控UI。有趣的是,你可以单手操作界面,比如在手掌上用单手指快速播放音乐。

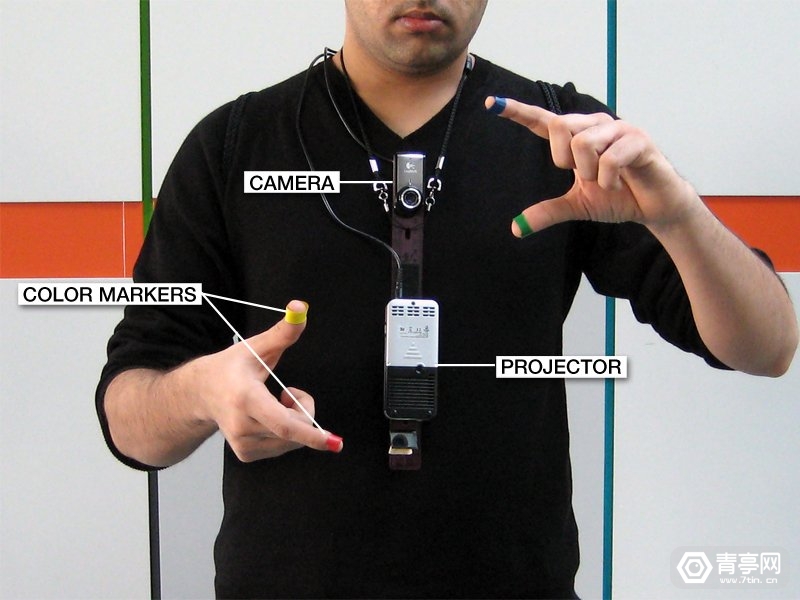

SixthSense

实际上,MIT Media Lab在2009年时就曾提出类似的概念设计:SixthSense,这是一个可穿戴AR手势交互界面,特点是将摄像头与投影仪结合,将AR投影在真实的物体上,并通过手势追踪(SixthSense用标记追踪手势)来实现与AR的交互。SixthSense方案依赖额外的计算模块(比如手机),相比之下Humane为一体式设计,体积可能更小。

接下来我们将详细讲解一下,Humane是一家什么样的公司,它又开发了怎样的产品。

01. 关于Humane

2018年时,前苹果设计总监Imran Chaudhri和软件工程总监Bethany Bongiorno成立了一家创新计算公司Humane,该公司宣称将通过创新计算方式,来探索更理想的人机交互体验,并暗示在开发某种穿戴式AR设备。

Humane创始人

Chaudhri此前曾为iPhone、Mac、Watch、AirPods等产品设计过交互界面。他表示:我们花费了大量时间来重新构想和设计计算机交互,尝试了复杂的语音命令和手势交互,以寻找更自然的人机交互方式。结合AI和AR投影,你可以将周围的环境变成操作系统,不需要再掏手机查询信息。

因此,Humane的宗旨是打造“隐形”的人机界面,只需要将小巧的计算模块戴在胸前,不需要戴眼镜或头显,也能直观、智能的增强人们的日常生活。Chaudhri表示:AI和环境计算可以让这成为现实。Humane不看好AR眼镜,因为AR眼镜具有侵入性,它将屏幕放在离人眼更近的地方,而且外观看起来并不自然,甚至可能干扰人和人面对面互动。相反,其认为应该减少屏幕的干扰,用环境计算来让人与世界更自然的交互。

在今年3月,该公司完成1亿美元C轮融资,本轮融资由Kindred Ventures领投,微软、OpenAI创始人Sam Altman、沃尔沃、LG Technology Ventures、高通、老虎全球管理等参投。截至目前,该公司已累计融资超2.3亿美元。

Humane提出优质AI的指导原则(似乎也暗示了产品将深度绑定用户的生活隐私数据)

Humane还与多家公司达成合作,比如利用微软的云计算服务,并在设备中引入OpenAI技术。随着ChatGPT等技术大受欢迎,未来基于OpenAI技术的穿戴式AR相机也有望受到关注。除此之外,也在和LG、沃尔沃合作,探索AR相机与智能家居、汽车产品的结合。还与韩国SK Networks合作,对产品进行分销。

另有消息表示,苹果公司将不会和Humane展开合作,原因之一是Bongiorno和Chaudhri离开苹果时关系闹的很僵,其中Chaudhri将团队工作成果归功到自己身上。当然,这一消息仍不确定真假。

02. 穿戴式AR投影仪

在早前申请的专利中,Humane已经描述了某种基于安卓系统的可穿戴AR设备,它的特点是通过基于激光投影,可在任何表面上显示AR图像。还搭载3D摄像头和深度传感器(LiDAR、ToF),可识别空中手势、3D场景。

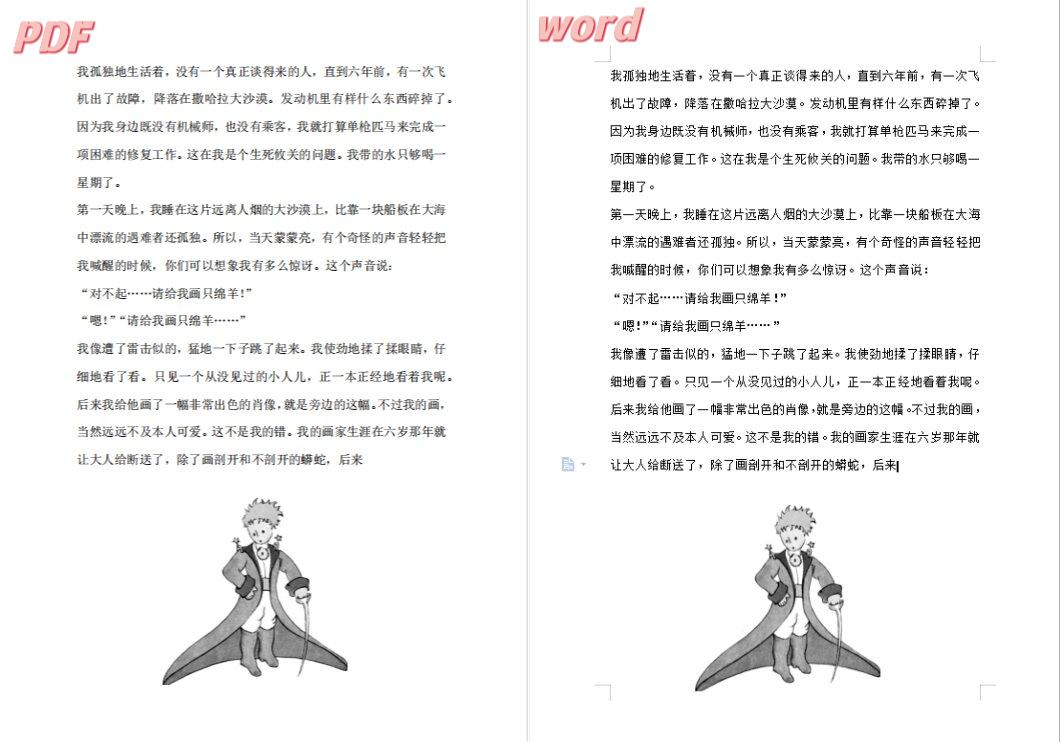

目前,Humane还未公开首款设备的参数,不过从专利来看,或采用自带光学图像稳定器的180°FOV广角摄像头,生活片段可上云AI实时处理,支持生活记录直播,或者生活片段(记忆)搜索,具有上下文感知能力,看上去像是一个让AI记忆你的生活的设备,兼具直播、实时监测、回忆事件等模式。

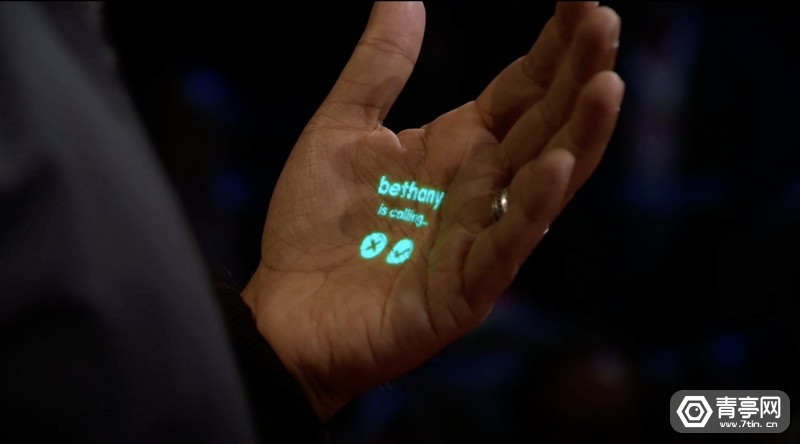

该方案可以将AR界面投影到你的手掌上,显示时间/日期、数字键盘、导航、温度/恒温器UI等信息,在你不需要时则停止投影。除此之外,也可以将AR投影到你工作的台面上,协助烹饪、汽车修理等任务,比如标记对象、并提供与对象相关的文本或指令。

简单来讲,可以将它看作是一种全新的可穿戴设备和平台,完全基于AI构建,可模拟人与世界互动的方式,无需再依赖传统屏幕。Chaudhri表示:我们的首台设备将充分利用AI,并将这项技术用于任何场景。

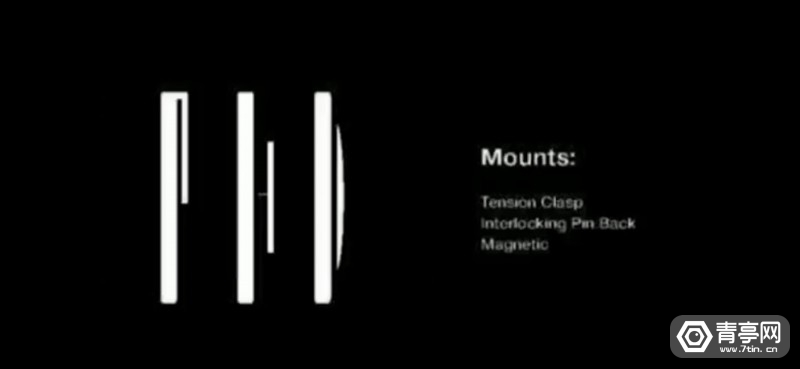

它可以独立运行,无需和智能手机等其他设备配对。考虑到高通为Humane投资方和合作伙伴,其AR设备可能也基于高通芯片。你可以将Humane AR模块别在外套或衬衫上,高度刚好适合将AR显示在你眼前位置。它有有三种固定方式,可根据不同材质的服装采用夹子、胸针或磁吸设计。

专利中还涉及到云计算的用法,比如相机捕捉到的多媒体数据可上传至云端,并通过AI来分析上下文,转化为各种格式,比如图像、视频剪辑、音频剪辑、多媒体演示、图片库等等,并在可穿戴设备上下载和重放。

Humame在专利中指出,尽管移动设备自带摄像头很方便,但它通常不能很快的抓拍精彩瞬间,因为拿出手机打开相机还需要一个过程。相比之下,穿戴式相机可能只需要一个手势就能快速抓拍。不过缺点是,你不能灵敏的控制拍摄角度,这也是此前Google Clips存在的一个问题。

Humane在专利中指出,使用专业摄影图像数据来训练机器学习模型,可以更好的裁剪和编辑照片(还能自动匹配滤镜),从而优化拍摄效果。

据了解,Google Clips也是类似的穿戴式相机,卖点是可以自动选择场景,帮你按快门,Humane的区别是结合了AR显示。不过这样的穿戴式相机可能会被认为是侵犯隐私。而且训练AI算法也需要大量数据。

03. 应用场景

Humane可以像手机一样支持多种功能,区别是它将屏幕显示改为AR投影,省去了屏幕意味着整机尺寸更小。此外,Humane结合AI来优化UI,可以更智能的根据上下文调用不同的功能,比如在公交卡上显示余额等。在专利中,Humane还设想用AR将数字键投影在手掌上,并用另一只手触摸拨号的场景。

在近期举行的TEDTalk2023演讲中,Chaudhri展示了Humane AR模块在接打电话、信息提示、实时翻译、会议记录、备忘录、日历、导航等场景的应用,都是一些比较实用的场景。

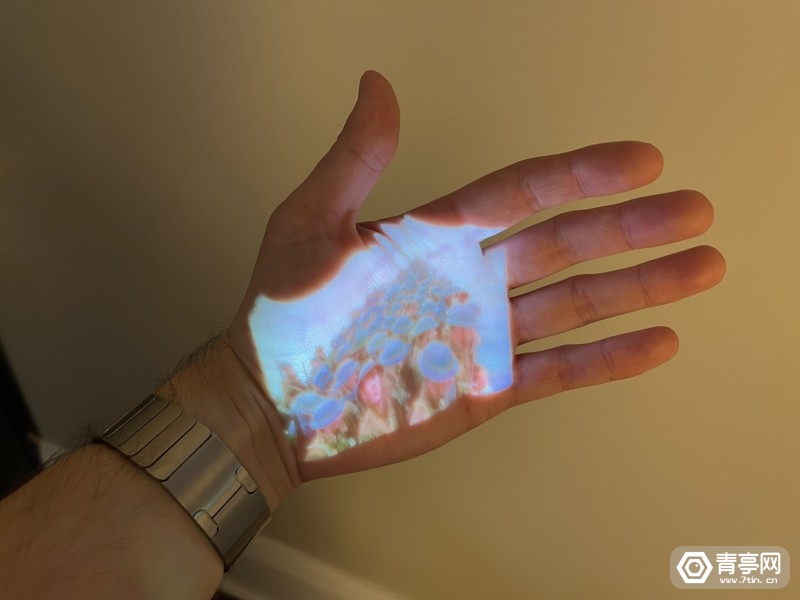

理论上,Humane的AR投影方案还可以用来看电影,不过现阶段在清晰度、色彩、图像扭曲等方面依然有局限,虽然可以将电影投影在手掌上观看,但效果显然不如手机理想。

在生活记录方面,Humane可结合AI来剪辑成不同的风格(纪录片、生活方式、抓拍、新闻摄影、体育、街头),或是用于直播、远程监控等等。

Humane表示:将AR和AI应用于生活,用来增强人类,在AI、ML和CV推动下,带领人类走进计算的下一个阶段。更重要的是,通过这种方式让计算界面变得“不可见”,更融入周围的环境,不干扰人与自然的互动,“让科技回归幕后”,让人类找回原本的生活方式。

接下来,Humane计划在今年发布首款产品,Chaudhri承诺会在未来几个月内公布更多细节。

参考:TheVerge,VRScout,xrgoespop,daringfireball