ChatGPT的出现,让人工智能再次站在了聚光灯下,引发持续性的热议和关注。GPT模型作为重要的支撑,国内外近段时间密集性地发布了众多的大语言模型,OpenAI推出GPT-4、谷歌推出LaMDA和PaLM等大模型、Meta推出开源大模型LLaMA,而国内众多大厂也紧追其后,百度推出“文心一言”,阿里推出“同义千问”,华为推出“盘古大模型”,腾讯推出“混元大模型”,京东推出“ChatJD”,商汤也于近日推出了“日日新SenseNova”,而科大讯飞、旷视、快手等也有大模型方面的布局。而随着越来越多的厂商及个人开始接入GPT应用,AI生态体系以及场景化布局越来越完善,如雨后春笋不断出现的各类GPT工具,也正式标志着我们进入了真正意义的人工智能时代。

OpenAI近日发布的一份研究报告,在预测最有可能被颠覆的职业类别中,便有会计师与审计师,自然无形中便给我们增加了很多危机感与恐慌。

GPT会取代审计人员吗

这个话题一直都在讨论中,GPT模型发展的三大核心要素是数据、算法、算力,数据每天都在持续不断地产生,算法也在一次又一次的反馈中自我迭代,算力也随着应用量在不断地提升,仿佛人工智能终究能够实现取代我们。我们知道GPT作为一个学习模型,其实某种程度上是作为人的意志以及思维表达,严格意义上说,至少在目前阶段,人工智能的自我意识还无法觉醒,虽然据国外最新研究,人工智能意识已经慢慢有了“自主”痕迹,因而马斯克为首的一众大佬却开始联名紧急叫停“GPT-5”的研发。

持“GPT不会取代审计”观点的核心理由是“AI不会背锅”,其实关于这点,核心是究竟将AI定义为一款工具,还是某种意识主体,甚至是法律层面能够界定,很明显现阶段人工智能的确无法独立于人的主体意识存在,因为审计在对应的关系中的主体身份以及关系是无法取代。其次在探讨对于审计的取代程度和速度中,还存在另外一个主线对象,也就是基于财务数字化建立起来的一系列模型,以及在实践中运行的有效性,很明显,光靠“机器”暂时也是无法处理这种复杂场景。

另外一部分人的观点则是觉得GPT将取代审计人员的工作,其核心的理由在于,单靠人在具体的审计项目中的所有行为模式可以在持续的算法迭代中进行优化,而GPT自身的理解与处理,学习能力在很大程度上都是远远超过人类的,当GPT输出的所有结果能够与某个特定的主体身份进行绑定的时候,并且最大程度上保障对应的独立性与专业性,并且保障底层的安全性、可靠性、适应性等,至少在这个基础上,“GPT+人”的模式的确会取代单纯人的模式。

所以此时这个问题的核心其实是讨论GPT取代哪部分人,以及GPT以怎样的形式融入到审计工作中。

GPT在审计中的应用

1、GPT应用逻辑框架

来自上海国家会计学院审计系李颖琦主任在提及ChatGPT的审计工作引入时着重强调了引入程度的审慎以及方式的恰当,对于各项自动生成的报告必须有人工的审核和校对,以确保相关结果的准确性和完整性。华东政法大学会计法律研究所主任陈秧秧也认为应当关注因ChatGPT运行中数据及语义理解的偏差可能带来的风险。那么构建怎么样的应用架构体系,才能更好地将GPT类工具的价值以合理的方式进行引入,以下是来自某咨询公司关于如何将ChatGPT等人工智能工具与我们的服务场景进行结合,以下是根据Ai技术的应用架构进行的分类:

- 产品 将Ai作为某种能力或者模块,嵌入到我们的产品或者服务中,赋能或者增强终端客户的体验。

- 流程 人工智能技术能够极大程度地对日常工作流程和操作进行结构层面的优化,将原本操作层面升级到策略层面,能够实现底层自动化操作,从而提高生产力。而自动化可以以两种形式进行表现,可以直接降低人力,以及提升人力工作维度。

- 洞察 人工智能可以辅助做出更明智的战略决策,基于底层更强大的数据收集与处理能力,不断优化的智能决策模型,从而为公司提供更智能化、更有针对性、建设性的建议。

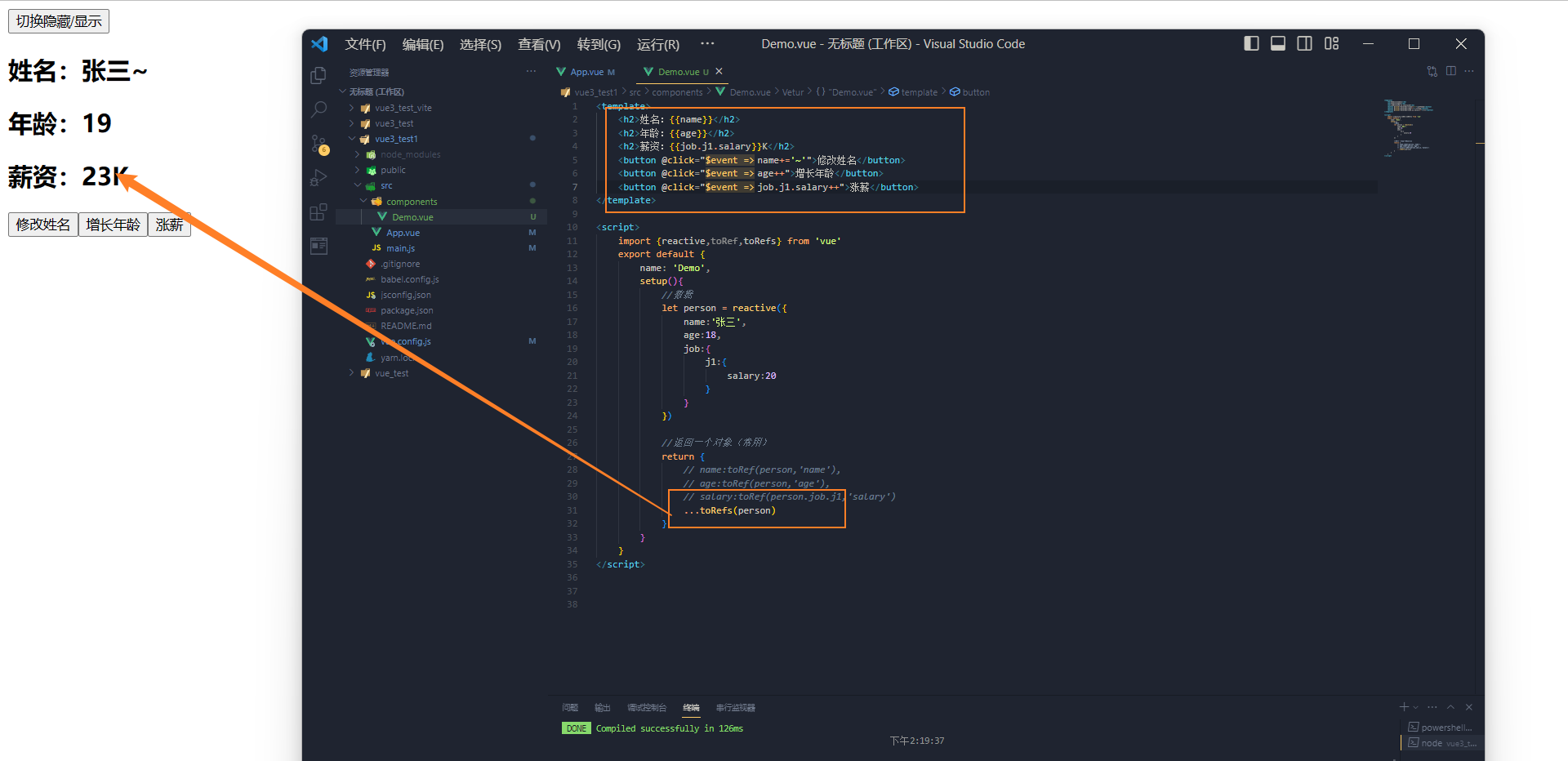

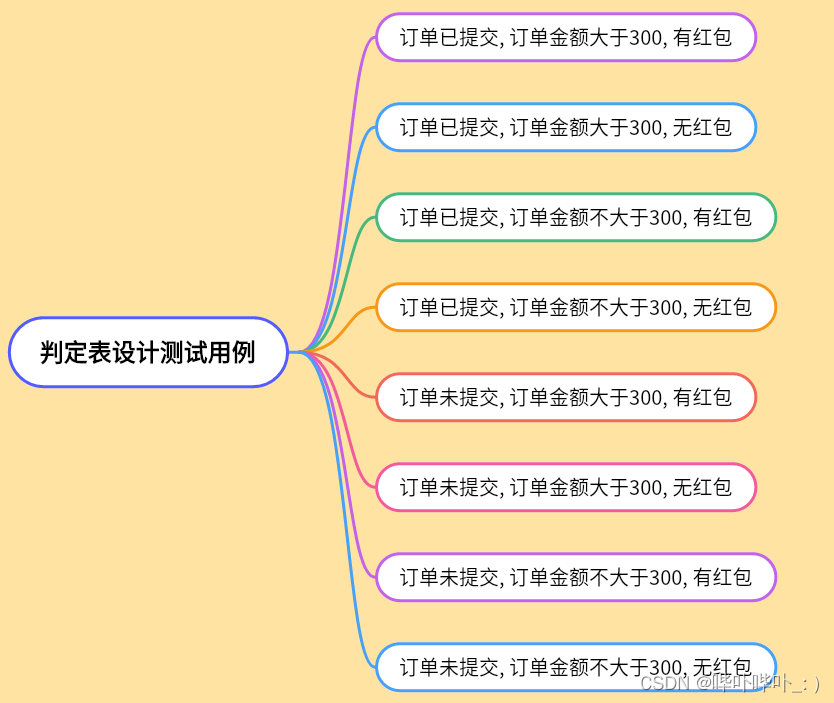

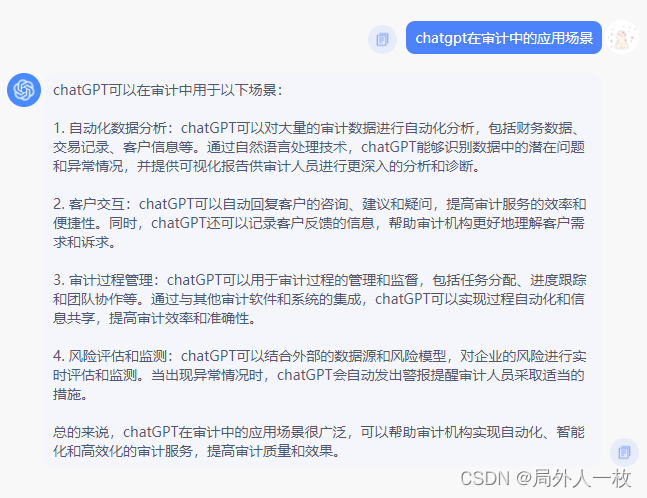

2、GPT审计中应用场景

我们将“ChatGPT在审计工作中的应用场景”这个问题再次提出,得到的回复如下:

3、GPT审计中应用实例及工具推荐

-

ChatExcel

官方体验地址:http://chatexcel.com/

审计工作中,很多底层的事项都是围绕excel表展开的,为了提升效率,曾经学习了很多的编程以及表格公式,而随着ChatExcel的到来,你会惊奇地发现所有的表格处理操作都可以像对话一般简单,你想要实现的任何操作都能够准确、高效的完成一整个的表格处理流程。当然我们也可以随时利用ChatGPT生成我们需要的vba代码或者python代码,其次也可以自动实现对应的一些财务分析模型的计算处理。 -

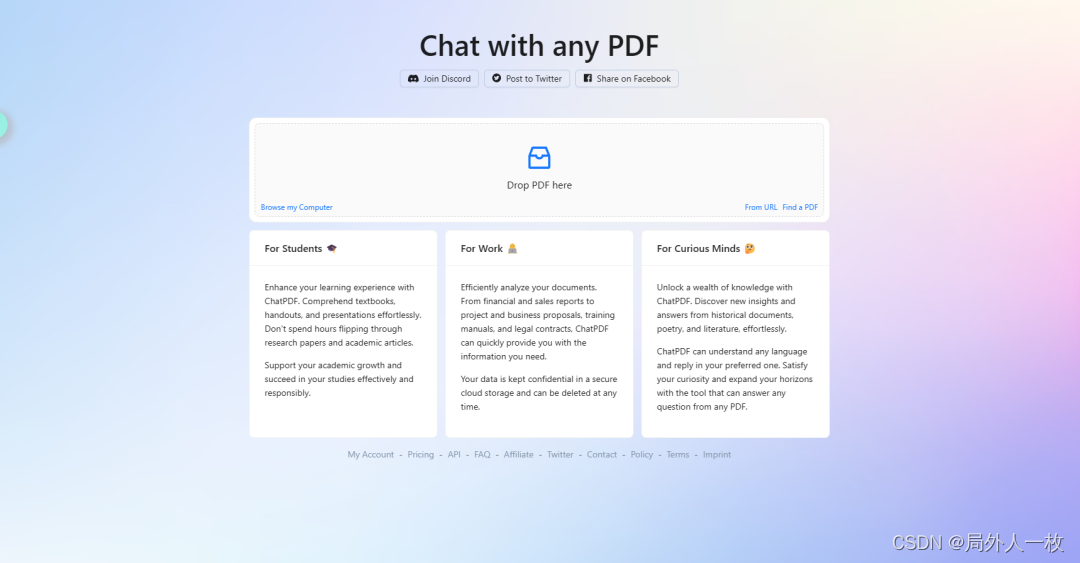

ChatPDF

官方地址:https://www.chatpdf.com/

ChatPDF 是一个能够从 PDF 文件中快速提取有用信息,并通过 ChatGPT 来解读这些信息的 AI 工具。审计工作中,我们往往需要快速分析和理解大量的审计文本,例如财务报表,业务合同,管理制度、法律法规等,有了ChatPDF之后,我们可以快速地将对应的内容以PDF文件格式的方式上传,然后可以进行自由地提问,能够最快速地在您指定的范围内得到解答。

GPT在审计中应用风险

虽然GPT在实际的审计工作中的确会给我们带来一些效率上的巨大改变,但是我也务必清晰地认知到至少在目前的应用中存在很多的风险性因素。

- 数据隐私及信息安全

当我们利用GPT工具辅助审计的时候,首先要进行的就是数据上传,而对应的数据往往作为企业方重要的财务数据,不管是受到法律层面的行为限制,还是这部分数据的保密要求等,我们在利用此类的工具的时候,无法保障这些工具提供了能够满足我们对于数据隐私及信息安全的基础要求,前段时间的三星泄密事件便是很好地佐证。

- 无法保障有效的独立性及专业性

此时底层首先涉及到的是算法模型的有效性取决于数据量的大小,模型的参数,训练量的大小,以及实践中的反馈,事实上当我们在使用的时候是无法保障整体体系,尤其是GPT的学习能力是否符合我们的要求,也就是能够正确理解我们想要表达的含义,以及思维模式,那么在一个较长期的过程中,肯定是较为低效以及“愚笨”。

- 人工智能无法处理审计人员的复杂体系

现阶段GPT工具相对来说还是定义为工具属性,但是由于有“自主”意识的存在,从而会存在“自我欺骗”的情况,而如果过度依赖GPT工具,而审计人员丧失了自主分析的能力,甚至是底层的岗位能力,那么就会大大降低人在处理复杂场景的灵活属性。

- 监管及合规体系无法突破GPT黑盒

GPT智能应用的存在已经超越了之前人为中心的工作体系的构建,而GPT内部往往存在黑盒的属性,无法精准了解到数据的处理以及算法的逻辑,即使全程都是在人的控制下,因而无法保障内部体系的合规。

变革一定会存在风险,正因为风险的存在,也限制了GPT工具目前在审计中还是局部的尝试使用,甚至很多时候任何结论也无法真正与审计工作进行有效结合。而在GPT类工具百花齐放,如火如荼地时刻,4月11日,国家互联网信息办公室起草了《生成式人工智能服务管理办法(征求意见稿)》,现向社会公开征求意见。大家可以更多地建言献策。