摘要——我们研究一种基本的联合通信与感知设置,其中发射机希望向接收机传输一条消息,并同时通过广义反馈估计其信道状态。我们假设感知目标是获得状态的软估计(即概率分布),而非通常假设的点估计;并且我们使用对数损失失真作为保真度度量。聚焦于具有独立同分布(i.i.d.)状态的无记忆设置,我们描述了通信率与感知失真之间的最优权衡。在此过程中,我们阐明了所谓感知互信息效用函数的操作意义。

I. 引言

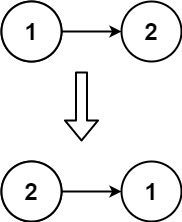

我们考虑一个双终端联合通信与感知(JCAS)设置,包含一个发射机和一个接收机。发射机希望通过状态依赖的离散无记忆信道(DMC) 向接收机传输一条消息,其中

是发射机发送的输入,

是接收机观测到的输出,

是信道状态。同时,发射机希望通过广义反馈信道

估计信道状态,输出为

。显然,信道输入

在此扮演双重角色:编码消息以实现通信,探测信道以实现感知。自然地,这两个目标之间存在权衡,因为对第一个目的的最优输入通常对第二个目的并不是最优的。

Kobayashi等人[1]引入了上述基本模型并建立了可靠通信率(按Shannon定义)与状态估计保真度(用可分离失真度量表示)之间的权衡。这引发了一系列进一步的研究和扩展,包括多终端设置[2]-[4]、保密约束设置[5]、[6]和多天线高斯设置[7]等。所有这些工作都遵循相同的建模思路,允许状态以i.i.d.方式从一个信道使用变化到另一个(或更一般地,从一个区块到另一个,如[7]中)。另一种极端情况,即状态在整个传输过程中保持固定,已在[8]-[12]中考虑,假设状态取多个(通常是二进制)值。在当前工作中,我们专注于Kobayashi等人的原始设置,即具有i.i.d.状态。我们的目标是通过关注特定的保真度标准,进一步阐明通信与感知之间的权衡。

建立通信与感知之间基本权衡的一个挑战是选择感知保真度标准,即感知失真度量。一方面,人们理解失真的选择应该是应用特定的;但另一方面,不同的失真度量由不同的估计器最小化,并且常常导致不同的性能权衡。因此,建立一个"通用"的通信与感知权衡,超越特定失真度量选择的依赖,是很有意义的。

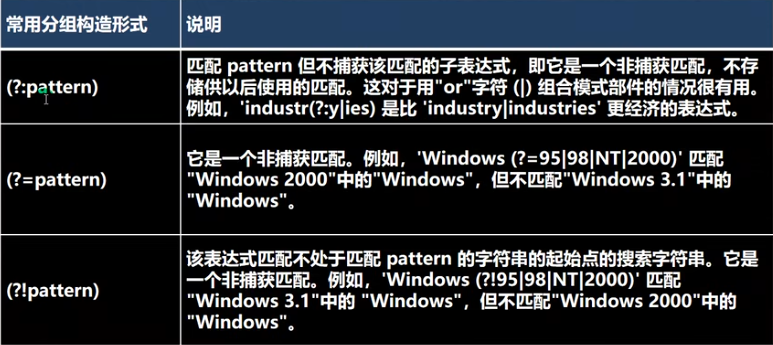

一种直观的通信与感知权衡,似乎不依赖于失真选择,可以用条件互信息术语描述为满足以下条件的所有非负元组(R, Γ):

R < I(X;Y|S) 和

对于某些可容许的输入,其分布为

。在上式中,R是通信率,Γ是感知效用,通常被称为"感知率"或"感知互信息"[13]、[14]。将互信息用作感知效用函数相对较新,可以追溯到Bell关于雷达波形设计的工作[15](更近期的工作包括[16]-[18])。与通信率不同,感知率没有明确的操作意义。我们将稍后回到这个重要点,但在此之前,值得强调使上述特征化特别有趣的几个方面。

除了(1)中的特征化不依赖于特定的失真度量选择(至少在表面上看是如此)外,它还在和

的角色中展示了令人愉悦的对偶性。假设接收机知道信道状态S并希望恢复输入X,I(X;Y|S)捕获了观测Y中关于X给定S的信息量。对于发射机,X和S的角色相反,I(S;Z|X)捕获了Z中关于S给定X的信息量。此外,注意对于固定的

和

,

在输入分布

上是凹的,而对于固定的

和

,

在

上是线性的。区域边界上的点可通过求解以下问题确定:

对于某个,这是控制权衡的权重。这是一个凸优化问题,可以高效求解,前提是输入字母表的大小是可管理的。

我们现在回到互信息的操作意义。对于通信,这已通过香农编码定理得到充分确立:我们知道存在可靠的编码方案¹,可实现高达互信息的所有速率,当在输入分布上最大化时,得到信道容量。而感知互信息,另一方面,经常被用作效用函数,但没有提供具体的操作解释。[13]中最近报告了一种可能的解释,将感知失真函数通过率-失真理论和数据处理不等式连接到感知互信息。然而,这种连接通常只在一些规范的特殊情况下才紧密成立。此外,这种连接隐含地要求使用率-失真编码来描述信道状态,这在大多数感知应用中可能是不必要的迂回,因为目标是直接估计状态。

在本文中,为了给(1)中的权衡提供具体解释,我们考虑Kobayashi等人[1]的基本设置,但采用不太常规的状态估计框架和失真度量。特别地,我们考虑获取状态的软估计,即概率分布(或信念),而非JCAS文献中更常见的点估计。软估计的保真度通过对数损失(log-loss)来衡量,这在预测和学习理论[19]-[21]以及数据压缩[22]-[24]中被广泛使用。我们描述了通信率与感知失真之间的基本权衡,并证明它可以通过互信息项和条件熵项来表示。这种权衡在某种意义上等同于(1)中的权衡。

II. 系统模型

我们考虑一个状态依赖的DMC,输入为X,输出为Y和Z,状态为S。接收机通过观察Y,而发射机通过广义反馈获得Z,即通过

。该信道使用n次,发射机希望通过传输输入序列

向接收机发送消息,并同时通过广义反馈信号

估计状态序列

。

编码:发射机有一个消息W,从中均匀随机抽取。每比特信道的速率定义为:

发射机希望将W发送给接收机,并同时通过广义反馈信道估计状态序列。为此,发射机发送输入序列

,其中第

个符号

根据消息

和发射机在当时可获得的先前信道观测

选择。因此,编码器是一系列函数

,其中

产生第

个输入符号

。

我们假设输入序列受到成本约束,通常代表实践中的功率约束。令为成本函数,

为每个输入符号的成本预算。则平均约束:

必须对每个和

成立。

解码:接收并知道

后,接收机将消息解码为

,其中

是解码器。最大解码错误概率为:

为方便起见,通常使用平均解码错误概率。在操作上,控制最大错误概率更有意义,因为没有消息应该比其他消息有优先权。然而,就渐近可达率而言,通过排除[25]可以证明对最大错误的结果也适用于平均错误。

估计:接收并知道

后,发射机为状态序列

产生软估计。与硬估计(即点估计)不同,软估计是

上的概率分布(即pmf)。软估计器是一个函数

,其中

是

上的概率单纯形。给定

和

,对

的软估计记为

,其中

。注意,如果

有单点质量,则软估计简化为点估计。

软估计的保真度通过对数损失失真来衡量。状态序列与软估计

之间的对数损失定义为:

对数损失,也称为自信息损失,可理解为给定软估计后关于

的剩余不确定性[22], [23]。例如,当且仅当

在

处有单点质量(即精确点估计)时,

为零;当

在

下概率为零时,则为无穷大。

给定发送消息w,预期的对数损失失真为:

其中除以n是为了方便渐近分析。类似于最大解码错误概率,我们的失真度量定义为针对消息指标取最大值:

备注1. 也可以通过取消息的平均值来定义失真度量:

这在JCAS的大多数工作[1]-[7]中是常见做法,即各种失真度量通过取消息的平均值而非最大值来定义。我们认为这主要是出于技术便利,但从操作角度看不太合适。给定的感知性能应该无论通信什么消息都能保证,因此最大值似乎更合适。

率-失真区域:如果对于任何,存在一个编码

,使得在足够大的

下,

,

,

且

,则编码器-解码器-估计器三元组

被称为可达的。率-失真区域是所有可达

元组的闭包。

III. 主要结果

定理1. 是可达的当且仅当:

对于某个输入随机变量X,其pmf 满足

。上述区域中涉及的随机变量满足

。

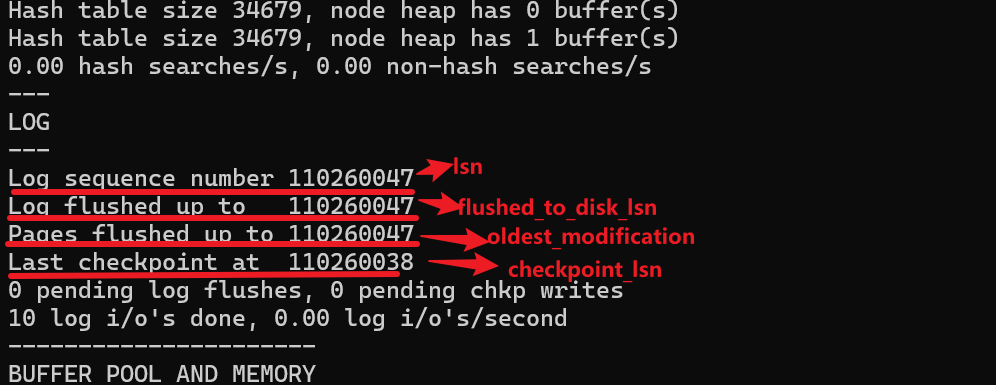

我们将在下一节证明上述定理,但在此之前,先讨论(10)与(1)中率区域的等价性,并给出一个简单例子。

1) 感知率和等效率区域:我们将在下一节看到,最小化预期对数损失的最优软估计是状态序列的后验分布。在传输前,最小化预期对数损失的软估计是状态序列的先验分布,相应的预期对数损失是每符号。我们将率

定义为先验和后验预期对数损失之间的差值。使用这个定义,(10)中的率权衡转换为(1)中的率权衡。

2) 例子:

其中是状态,

和

是噪声项,都是伯努利分布,相互独立且独立于X。注意,

是相应的伯努利参数,

表示模2和。可以证明,在这种情况下,率区域由所有非负值

给出,满足:

对于某个参数 ,表示输入

的伯努利参数,其中

是二进制熵函数,

。上述权衡生动地捕捉了

和

所扮演的双重角色。

IV. 定理1的证明

A. 对数损失下的状态感知

现在,我们暂时搁置通信部分,仅关注问题的感知部分。为此,固定一个消息 和一个编码器

,并回顾输入序列完全由

和

确定,即

。给定

通过广义反馈被观察到,令人惊讶的是,

的最小化预期对数损失的软估计是后验分布

,如下所示。

引理1. 给定和固定编码器

,预期对数损失的下界为:

当且仅当软估计 取为后验分布

时等式成立。

证明. 条件于 和

,预期对数损失的下界为:

其中 P 用作后验分布 的简写符号。(16)中的不等式源于相对熵(Kullback-Leibler散度)的非负性,当且仅当

时等式成立。通过对给定

的

取期望,可得(13)。□

类似引理1的结果先前已在源编码[22], [23]和预测[21, Ch. 3.6]的背景下出现。引理1是这些结果对本文感知设置的适应,如下所示,它在定理1的可达性和逆定理证明中都起着核心作用。

B. 逆定理

假设率-失真元组 在成本预算

下可达。为了证明逆定理,我们可以处理平均(而非最大消息)错误概率和对数损失失真,因为

和

分别意味着

和

。

从Fano不等式开始,通过标准步骤(见[26, Ch. 3.1.5]),通信率的上界为:

其中可以通过增加

变得任意小。注意,(21)来自

和数据处理不等式。定义一个输入随机变量

,其分布

定义为:

,对所有

可以证明,上述定义的随机变量 X满足预期成本约束 (见附录)。利用互信息在输入分布上的凹性和Jensen不等式,我们得到:

现在转向对数损失。我们写道:

其中(27)来自引理1并对 W取期望,而(28)成立是因为 。对于接下来的步骤,我们发现处理感知率

更为方便。我们按如下方式进行:

(32)来自 ,而(34)成立是因为

形成马尔可夫链,因此

。

从(34)继续,我们写道:

其中我们使用了(23)中定义的输入分布。

通过足够增大n,我们可以使(24)和(38)中的和

变得任意小。令

且

,由此可得

且

(或等价地,

),对于某些满足

的

成立,这就证明了逆定理。

C. 可达性

对于可达性部分,只需证明定理1中区域的边界曲线是可达的。该边界曲线由形如(R^*(∆,B),∆)的对组成,其中:

考虑边界曲线上的任意一点,令

为满足

,

且

的输入分布。如我们将看到的,使用非反馈码和非自适应编码器就足够了。这并不奇怪,因为信道和状态序列都是无记忆的(参见[1]、[3])。

固定和

。每个消息索引

映射到一个码字

,所有码字共同组成一个码本

。状态序列

的后验概率分布分解为:

以(40)中的后验分布作为软估计可得:

显然,对于每个,如果所有码本

中的码字都从集合

中选择,则保证实现

的同时满足

,其中:

接下来需要证明存在这样一个码本,其速率且错误概率

。

为此,我们引用一个被称为Feinstein引理的信道编码定理(见[27, 定理18.7])。在该引理的表述中,是从多字母输入分布

中抽取的随机输入序列,该分布在集合

上有支撑,且

是条件于状态序列的信息密度。

引理2. 固定阈值参数。存在一个码本

,大小为

,且最大解码错误概率

满足:

接下来,我们通过适当选择多字母输入分布和阈值参数

来证明可实现期望的速率。特别地,我们设:

其中是来自

(在可达性开始时定义)的

重乘积分布,且

。此外,我们设置

使得

。有了这些选择,(43)中的项

随着n趋于无穷而趋于零,如下所示:

其中且

是相应的接收机输出。根据大数定律,

且

,随着

。

此外,通过选择使得

,(43)中的项

也趋于零,因为

趋于无穷。因此,对于足够大的

,保证了

,这就完成了证明。

备注2. 引理2是一个使用Feinstein最大编码和次优阈值解码证明的民间编码定理变体。一个类似但略微较弱的界限也适用于平均编码错误概率,且可以使用Shannon的随机编码与阈值解码来证明。这两种界限都适用于我们证明渐近结果的目的。我们建议读者参考[27, Ch. 18]获取关于这些界限的全面现代处理,它们有时被称为信息谱界限或单次界限³。此外,Feinstein引理的成本约束版本在[27, 定理20.7]中给出,服务于相同目的。

备注3. 定理1的可达性也可以使用更常见的联合典型性方法来证明。为此,使用鲁棒典型性(在El-Gamal和Kim[26]中广泛使用)并调用典型平均引理来处理(42)中的输入成本和感知约束可能最为方便。这基本上是[1]中采用的方法,但使用平均(而非最大)失真度量,相对于最大值略微容易处理。我们选择了通过Feinstein引理使用信息谱单次方法,它具有一些优势。首先,它直接扩展到具有连续字母表的信道(如高斯信道),无需离散化(这是扩展基于鲁棒典型性的证明所需的)。此外,上述可达性结果可通过正态近似(参见[27, 定理19.11])得到有限块长特征化。最后,尽管不是本文的重点,基于Feinstein引理的可达性适用于一般的信道,例如有记忆或非平稳或非遍历[28]的信道。

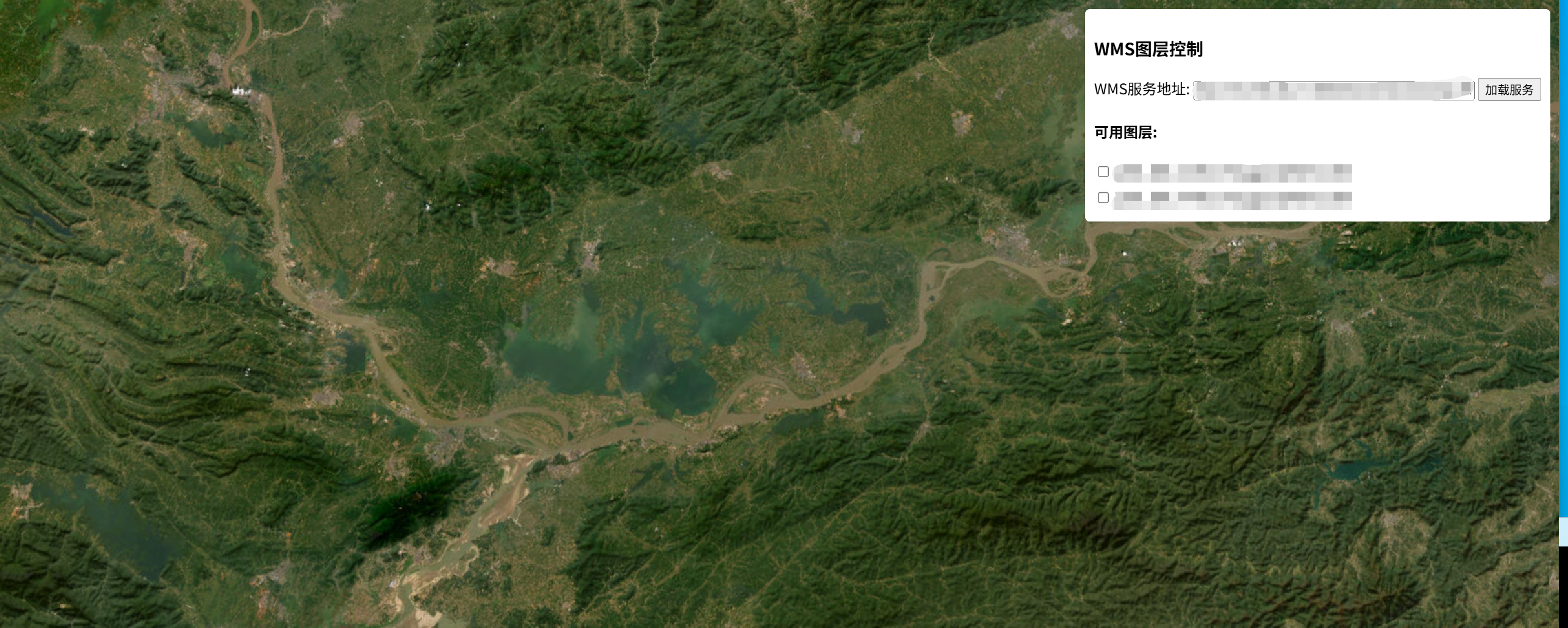

V. 高斯信道

到目前为止,我们一直考虑具有离散字母表的信道,但这些结果也适用于具有连续字母表的信道,前提是$S$具有有界微分熵的先验和后验概率密度(即)。高斯信道满足此要求,其输出为:

其中表示状态,

和

是噪声项,都相互独立且独立于

。输入受到平均功率(即平方成本)约束,预算为

。

根据定理1,可以证明,率-失真权衡由所有满足以下条件的对给出:

和

对于某些满足的

。注意,在这种情况下,失真(即预期对数损失)可以是负的。等价地,率区域由所有满足以下条件的对

给出:

为了比较,我们呈现[1]中在平方损失失真度量下的结果。在这种情况下,率-失真区域由所有满足以下条件的对组成:

和

根据Jensen不等式,对数损失和平方损失失真都由满足的输入最小化。因此,在最小失真下,二进制相移键控(BPSK)在两种情况下都实现最佳速率。

然而一般来说,(47)和(49)中的权衡并不必然等价。为了理解这一点,令:

为给定条件下从

估计

的最小均方误差(MMSE)。在速率约束

下,通过解决以下问题来最小化平方损失失真:

,满足

在对数损失失真下的相应问题是

其中对目标函数进行指数化处理并忽略常数不会改变问题。注意,(51) 是 MMSE 的算术平均值的最小化问题,作为输入 X的函数,而 (52) 是其几何平均值的最小化问题。这两种情况可能导致不同的最优输入分布。研究这两种情况下最优输入分布的结构是未来工作的内容。

VI. 讨论

通过将 [1] 中的一般速率-失真权衡专门化为对数损失失真,可以得到类似定理 1 的结果 [1,定理 1]。然而,严格来说,这种专门化并不严谨,因为 [1] 中的证明适用于离散重构字母表和可分离失真度量(即单字母失真的归一化和)。软估计不是离散的(即使状态字母表是),且第 II 节中定义的对数损失不是可分离的。后一个问题可以通过将软估计的集合限制为乘积分布来规避,这在我们特定情况下由于独立同分布状态而不是一个主要限制。尽管如此,我们在此提出的问题表述和我们采用的证明技术更为通用,为处理具有记忆的信道铺平了道路。

对状态感知互信息的另一种有效解释是通过列表解码 [29]。然而,这种解释适用于具有离散字母表的信道,对于具有连续字母表的信道似乎不成立。此外,如 [23] 在源编码背景下所示,软估计下的对数损失与一般的LIST大小不完全等价,但在离散字母表下两者在某种程度上是等价的。