引言

在机器学习中,尤其是深度学习领域,注意力机制(Attention Mechanism)已经成为处理序列数据(如自然语言处理、图像识别等)的一种重要技术。可视化注意力可以帮助我们理解模型是如何关注输入数据的特定部分,并做出决策

文章目录

- 引言

- 一、可视化注意力的基本概念

- 1.1 定义

- 1.2 功能

- 1.2.1 提高模型性能

- 1.2.2 增强模型解释性

- 1.2.3 辅助模型调试

- 1.2.4. 提升用户体验

- 1.3 特点

- 1.3.1 动态性

- 1.3.2 上下文依赖性

- 1.3.3 多维度

- 1.4使用方法

- 1.4.1 数据准备

- 1.4.2 注意力权重收集

- 1.4.3 可视化工具选择

- 1.4.4 创建可视化

- 1.5 优点

- 1.5.1 提高透明度

- 1.5.2 辅助调试

- 1.5.3 增强信任

- 1.6 缺点

- 1.6.1 计算开销

- 1.6.2 复杂性

- 1.6.2 误导性

- 1.7 实际应用示例

- 1.7.1 自然语言处理

- 1.7.2 图像识别

- 1.7.3 语音识别

- 1.8 结论

- 二、几种常见的注意力可视化方法

- 2.1 文本注意力可视化

- 2.2 图像注意力可视化

- 2.3 工具和技术

- 2.3 示例代码

- 2.4 结论

一、可视化注意力的基本概念

1.1 定义

在机器学习中,注意力机制是一种模拟人脑注意力聚焦能力的技术,它允许模型在处理数据时集中于某些关键部分。可视化注意力则是指将这种注意力分配的过程以图形化的方式呈现出来,使得研究人员和用户能够直观地看到模型在处理数据时关注了哪些部分。这种可视化技术不仅适用于文本数据,也适用于图像、音频等其他类型的数据

1.2 功能

1.2.1 提高模型性能

注意力机制通过赋予不同数据点不同的权重,帮助模型更加精确地捕捉到关键信息,从而提高模型在各类任务中的性能。例如,在机器翻译任务中,注意力机制能够帮助模型更好地理解源语言句子与目标语言句子之间的对应关系

1.2.2 增强模型解释性

可视化注意力为模型提供了一种解释其决策过程的方式。通过观察注意力分布,我们可以理解模型是如何从输入数据中提取有用信息的

1.2.3 辅助模型调试

在模型训练过程中,可视化注意力可以帮助研究人员发现模型存在的问题,如是否关注了不相关的信息,或者是否忽略了某些重要信息

1.2.4. 提升用户体验

对于需要与用户交互的应用,可视化注意力可以增强用户的信任感,因为它提供了一种直观的方式来展示模型是如何工作的

1.3 特点

1.3.1 动态性

注意力机制的权重分配是动态的,这意味着模型在处理不同数据时,其关注的焦点会发生变化

1.3.2 上下文依赖性

注意力的分配依赖于当前的处理上下文。例如,在处理文本时,模型可能会根据已翻译的部分来调整对源语言句子的关注点

1.3.3 多维度

注意力可以在多个维度上进行,如文本中的单词、图像中的像素或区域、音频中的频率等

1.4使用方法

1.4.1 数据准备

首先,需要确保模型已经集成了注意力机制,并且在训练或推理过程中能够输出注意力权重

1.4.2 注意力权重收集

在模型处理输入数据时,记录下每个时间步或每个处理单元的注意力权重

1.4.3 可视化工具选择

根据数据的类型选择合适的可视化工具。对于文本,可以使用条形图或热力图;对于图像,可以使用叠加在原始图像上的热力图或遮罩

1.4.4 创建可视化

使用图形库(如Matplotlib、Seaborn)或专门的可视化工具(如TensorBoard)来创建可视化图形

1.5 优点

1.5.1 提高透明度

可视化注意力使得模型的决策过程更加透明,用户可以直观地看到模型在处理数据时的关注点

1.5.2 辅助调试

通过观察注意力分布,研究人员可以更容易地发现模型可能存在的问题,如注意力偏差或错误

1.5.3 增强信任

对于需要用户信任的应用,可视化注意力可以增强用户对模型的信任感

1.6 缺点

1.6.1 计算开销

记录和可视化注意力权重可能会增加额外的计算开销,尤其是在处理大量数据时

1.6.2 复杂性

理解和解释注意力权重有时可能很复杂,尤其是当模型包含多个注意力层或注意力头时

1.6.2 误导性

在某些情况下,模型可能学会了错误的注意力模式,这可能会误导用户对模型性能的理解

1.7 实际应用示例

1.7.1 自然语言处理

在机器翻译任务中,可视化注意力可以展示模型在翻译每个单词时是如何关注源语言中的相应部分的。这有助于理解模型是如何处理语言中的长距离依赖关系的

1.7.2 图像识别

在图像分类任务中,可视化注意力可以展示模型在做出分类决策时关注了图像的哪些区域。这对于理解模型是如何识别图像中的关键特征非常有用

1.7.3 语音识别

在语音识别任务中,可视化注意力可以展示模型在处理音频信号时关注了哪些频率范围。这对于理解模型是如何从复杂的音频信号中提取有用信息非常有帮助

1.8 结论

可视化注意力是机器学习领域中的一项重要技术,它不仅提高了模型的性能和解释性,还增强了用户对模型的信任。通过可视化注意力,研究人员和用户可以更好地理解模型的决策过程,从而为模型的改进和优化提供了有力的支持。随着机器学习技术的不断发展,可视化注意力将在更多的应用场景中发挥重要作用

二、几种常见的注意力可视化方法

2.1 文本注意力可视化

在自然语言处理(NLP)任务中,如机器翻译、文本摘要或问答系统,注意力机制可以帮助模型集中在输入文本的重要部分。以下是如何可视化文本注意力的步骤:

- 步骤一:获取注意力权重:在模型训练过程中,注意力模块会为输入序列的每个元素分配一个权重,表示其在当前输出中的重要性。

- 步骤二:可视化:可以使用热力图(heatmap)或颜色编码来可视化这些权重

以下是一些可视化技术:- 条形图:为每个单词分配一个条形,条形的高度表示注意力权重的大小

- 重叠文本:将输入文本与注意力权重叠加,使用颜色强度表示权重的大小

2.2 图像注意力可视化

在图像识别任务中,注意力机制可以帮助模型聚焦于图像的特定区域。以下是图像注意力可视化的方法:

- 步骤一:获取注意力权重:与文本类似,图像注意力模型会为图像的每个区域分配权重

- 步骤二:可视化:

- 热力图:在原始图像上叠加一个热力图,其中不同的颜色表示不同的注意力权重

- 遮罩:创建一个遮罩层,只显示模型关注的部分,遮蔽其他区域

2.3 工具和技术

- Matplotlib和Seaborn:这些Python库可以用来创建热力图和条形图

- TensorBoard:TensorFlow的可视化工具,可以用来监控训练过程,并可视化注意力权重

- HTML/CSS:对于Web应用,可以使用HTML和CSS来创建交互式的注意力可视化

2.3 示例代码

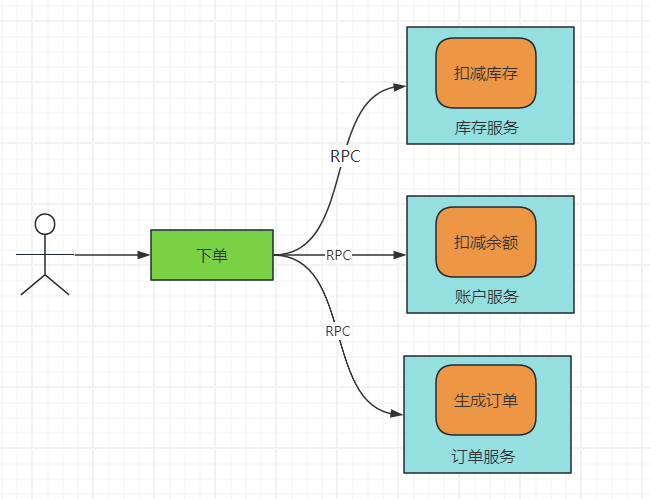

以下是一个简单的Python代码示例,使用Matplotlib绘制文本注意力的热力图:

import matplotlib.pyplot as plt

import seaborn as sns

# 假设我们有一些注意力权重

attention_weights = [0.2, 0.5, 0.1, 0.7, 0.3]

# 输入文本

input_text = "The quick brown fox jumps over the lazy dog"

# 创建一个热力图

plt.figure(figsize=(10, 1))

sns.heatmap([attention_weights], annot=True, cmap="YlGnBu", cbar=False)

plt.yticks([])

plt.xticks(range(len(input_text.split())), input_text.split(), rotation=45, ha="right")

plt.show()

输出结果:

2.4 结论

可视化注意力不仅可以帮助研究人员和开发者理解模型的决策过程,还可以用于解释模型的行为,提高模型的透明度和可信度。通过可视化,我们可以直观地看到模型在处理数据时关注了哪些部分,这对于调试模型和改进模型性能非常有用

![[陇剑杯 2021]wifi WP](https://i-blog.csdnimg.cn/direct/f0a94071ecf64ec1b22d84c0b926484d.png)