第二章 目标说话人提取之《Speech Enhancement and Dereverberation with Diffusion-based Generative Models》

文章目录

- 前言

- 一、任务

- 二、动机

- 三、挑战

- 四、方法

- 1.方法:基于分数的语音增强生成模型(sgmse)

- 2.网络结构

- 五、实验评价

- 1.数据集

- 2.采样器设置和评价指标

- 3.基线模型

- 4.评价

- 六、结论

- 七、知识小结

前言

语音新手入门,学习读懂论文。

发表于《关于音频、语音和语言处理的 IEEE/ACM 事务》

本文作者

一、任务

作者在之前的基于短时傅立叶变换(STFT)域中扩散过程的基础上,使用基于扩散的生成模型进行语音增强。作者在随机微分方程中引入了漂移项,以实现重建问题所需的任务适应,并进一步将扩散过程和分数匹配目标应用于复杂的数据表示。

二、动机

关于扩散模型在语音增强中的应用,目前存在两种方法,它们在如何使用扩散过程方面存在概念上的差异。

一种方法是基于语音再生,即使用基于扩散的声码器网络通过无条件先验采样合成干净语音,而调节网络将有噪声的语音作为输入,通过向声码器网络提供增强的语音表示来完成去噪的核心部分。为调理网络引入辅助损失,以促进其估计干净语音表示的能力。

第二种方法不需要任何辅助损失,直接在正向扩散过程中模拟环境背景噪声或混响对干净语音的破坏,因此逆转这一过程将最终产生干净语音。这被认为是时域语音信号的离散扩散过程,以及复杂谱图域中基于sde的连续扩散过程。

三、挑战

在现实条件下,环境噪声或混响可能不符合平稳高斯白噪声的假设。因此,有人提出在扩散过程中包括真实的噪声记录,要么在过程中对干净的语音和有噪声的语音进行线性插值,要么在SDE的漂移项中定义这样的变换。

四、方法

1.方法:基于分数的语音增强生成模型(sgmse)

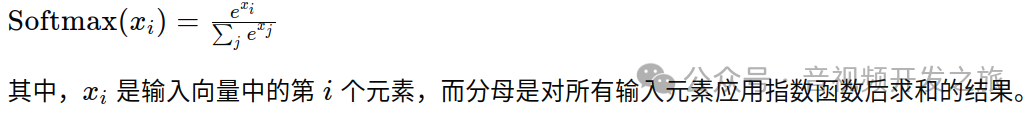

∠(·)表示复数的角度,α∈(0,1)是一个压缩指数,它可以产生能量较低的频率成分(例如未发音语音的摩擦音)[34],β∈R+是一个简单的比例因子,可以将振幅大致归一化到[0,1]以内。

作者设计了一个随机扩散过程,将其建模为一般形式的线性SDE的解。

xt为当前过程状态,t∈[0,t]为描述过程进程的连续时间步长变量,y为噪声或混响语音,w为标准维纳过程。向量值函数f(xt, y)称为漂移系数,g(t)称为扩散系数,控制每个时间步注入高斯白噪声的量。

其中γ是一个常数,称为刚度,控制从x0到y的转变。

σmin和σmax是定义维纳过程噪声调度的参数。

分数∇xt log pt(xt|y)是要由DNN近似的项,因此称为分数模型。我们将分数模型表示为sθ(xt, y, t),该模型由一组参数θ参数化,并接收当前过程状态xt、带噪声语音y和当前时间步长t作为输入。

xt的初始条件

接下来,我们推导出用于训练分数模型sθ的目标函数。

当过程状态xt的初始条件已知时,可以推导出过程状态xt的均值和方差[41]。这允许在给定x0和y的任意时间步长t上直接采样xt,通过使用所谓的扰动核,NC为圆对称复正态分布,I为单位矩阵

σ(t) ,它在t = 0附近具有非常小的数值(包括0)。为了避免未定义值和数值不稳定,我们因此引入了一个最小过程时间tε。

在每个训练步骤中,过程可以描述如下:1)从数据集中随机抽取t ~ U[tε, t], 2)从数据集中抽取样本(x0, y), 3)样本z ~ NC(z;0, I),和4)通过有效计算14得到xt

最终损失为模型输出与扰动核分数之间的未加权L2损失。将Eq.(14)代入Eq.(13),则整体训练目标为:

其中期望通过在每个训练步骤中对所有随机变量进行采样来近似,如上所述。注意,由于消去了µ(x0, y, t),损失函数没有显式地涉及y,只是作为分数模型的输入。这意味着分数模型的任务不是直接估计环境噪声的任何部分。最后,采用随机梯度下降法对参数θ进行优化,达到最小值。

2.网络结构

使用具有3x3内核和步幅1的Conv2D层作为输入和输出层,并使用1x1 Conv2D层从我们稍后描述的渐进增长路径中聚合信息。残差块由与上述配置相同的Conv2D层、群归一化、有限脉冲响应(FIR)滤波器的上采样或下采样和Swish激活函数组成。每个上采样层由三个残差块组成,每个下采样层由两个残差块组成,最后一个块进行上采样或下采样。全局注意力机制16×16的分辨率。为了使模型与时间相关,有关扩散过程的当前进展的信息被输入到网络结构中。一种常见的做法是,将标量时间坐标t映射到m维向量temb的学习投影,该向量temb被集成到每个残差块中。

五、实验评价

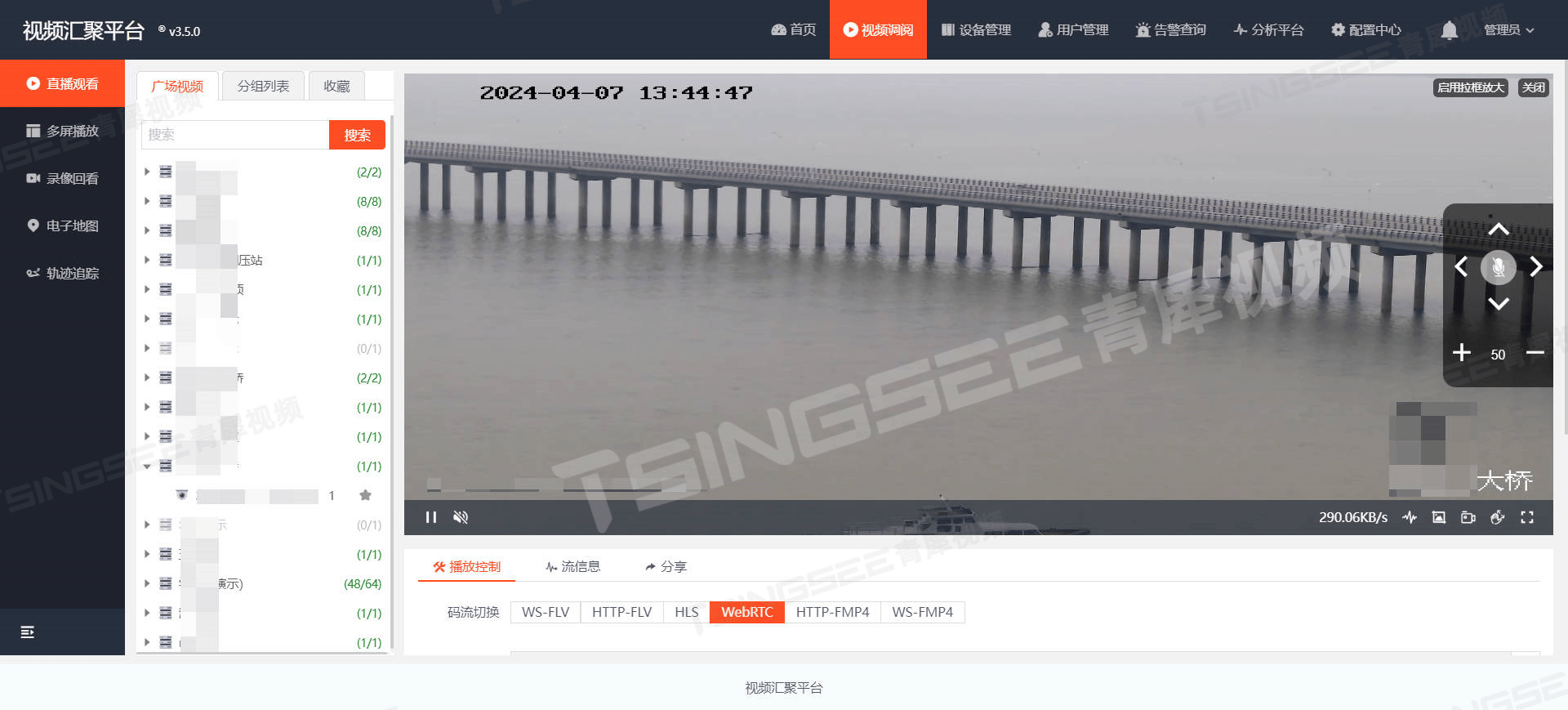

1.数据集

WSJ0-CHiME3数据集和VB-DMD数据集,WSJ0- reverb数据集。使用WSJ0数据集中的干净语音数据,并将每个话语与模拟的房间脉冲响应(RIR)进行卷积。

2.采样器设置和评价指标

POLQA:感知客观听力质量分析(POLQA)是一项ITU-T标准,其中包括用于预测语音质量的感知模型。

PESQ:语音质量感知评估(PESQ)用于客观语音质量测试。

ESTOI:扩展的短时客观可解度(ESTOI)是预测语音可解度遭受各种退化的工具测量。

SI-SDR、SI-SIR、SI-SAR:尺度不变(SI-)信失真比(SDR)、信干扰比(SIR)和信伪比(SAR)是单通道语音增强和语音分离的标准评价指标。

DNSMOS:深度噪声抑制MOS (Deep Noise Suppression MOS, DNSMOS)是一种评估感知语音质量的无参考指标。

提供了三个MOS分数:语音质量(SIG),背景噪声质量(BAK)和音频的整体质量(OVRL)。

WVMOS: wave -to- vec MOS (WVMOS)是一种使用经过微调的wav2vec2.0模型进行语音质量评估的MOS预测方法。

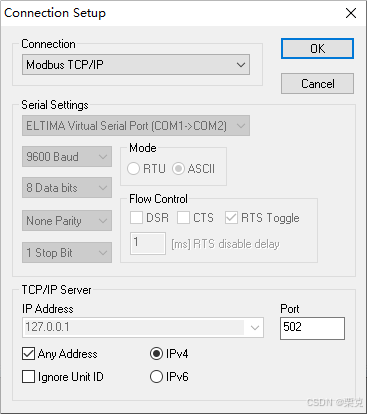

我们研究哪种采样器选择产生最佳的语音增强性能,比较具有不同校正步骤数的PC采样器和第3节中描述的普通ODE采样器。在(预测校正)PC采样器中使用一个校正步骤似乎是有利的,但使用两个步骤并不会导致性能的进一步提高。因此,我们决定使用带有一个校正步骤的PC采样器进行评估。

使用一个校正步骤会使采样器的函数评估次数(NFE)加倍。函数是昂贵的分数模型,这导致平均实时因子(RTF)为1.77,即1秒的音频需要1.77秒的处理

反向步骤数N可用于设置计算工作量和模型性能之间的平衡。选择N = 30的值,在这个值下,两个指标都没有显示性能的进一步提高。

改变校正器中的步长r。

3.基线模型

a) STCN:一种基于生成式vae的语音增强方法,该方法使用随机时间卷积网络(STCN)[72],允许潜在变量同时具有层次依赖性和时间依赖性。利用蒙特卡罗期望最大化算法对噪声模型的参数和潜在变量进行估计。

b) DVAE:基于无监督动态VAE (DVAE)的生成式语音增强方法[73],该方法对连续可观察变量和潜在变量之间的时间依赖性进行建模。在测试时使用变分期望最大化(VEM)方法更新参数,其中编码器使用随机梯度上升进行微调。

c) CDiffuSE:与我们提出的方法最相关的是CDiffuSE,这是一种基于时域中定义的条件扩散过程的生成语音增强方法。

d) SGMSE:基于分数的语音增强生成模型(SGMSE)是作者之前的出版物,所提出的方法是基于该出版物。主要区别在于它使用了深度复杂的U-Net[74]而不是ncsn++架构作为分数模型。

e) MetricGAN+:一种判别性语音增强方法,该方法使用生成器网络对基于掩码的干净语音进行预测,并引入经过训练的判别器网络来近似PESQ分数。

f) convt - tasnet:一种端到端神经网络,用于估计用于过滤噪声混合物的学习表示的掩模。过滤后的表示通过学习解码器转换回时域。

g) GaGNet:该神经网络在单通道去噪的复杂域和幅度域混合回归目标上进行训练。它使用所谓的“glance”和“gaze”(GaG)模块,分别对幅度进行粗略估计,并在复域中使用相位估计对其进行细化。

h) TCN+SA+S:这种单通道去噪方法使用自关注模块从输入幅度中提取特征。然后,该表示被一个时间卷积网络使用,随后是一个单层卷积平滑器,输出一个幅度估计,作为训练目标。Griffin-Lim迭代用于重构相位。

4.评价

我们看到SGMSE+在所有指标上都优于所有其他生成方法。将SGMSE+与我们之前的模型SGMSE进行比较,我们发现了显着的改进,特别是在感知度量方面。

对于每种方法,匹配和不匹配条件的分布都是并排绘制的,因此可以从两个分布之间的水平对齐推断出泛化的能力。可以看出,SGMSE+的两个分布是相对相似的。

用箱线图报告了MUSHRA聆听实验的结果。

WSJ0-REVERB测试集的单通道去噪结果。

我们评估了在真实噪声记录下的语音增强性能。对于真实世界的嘈杂录音,不存在干净的语音参考。为了进行评估,我们使用了来自深度噪声抑制(DNS)挑战2020测试集的300个文件。结果表明,我们提出的方法在所有非侵入性度量中都比所有其他方法表现得更好,证明了它对现实世界噪声示例的鲁棒性。

六、结论

作者在现有工作的基础上,使用一种新的随机扩散过程来设计复杂STFT域中语音增强的生成模型。作者通过使用新的网络体系结构,与之前的模型相比,显著提高了性能。作者在语音去噪任务上对所提出的方法进行了训练和评估,结果表明,与判别基线方法相比,该方法的性能明显优于判别基线方法。作者探索了不同的采样策略来解决测试时的反向过程,使我们能够平衡所提出的方法的性能和计算速度。未来的工作可能包括其他采样技术,以进一步减少扩散步骤的数量,从而降低计算复杂度。