1、概述

K N N ( K − N e a r e s t N e i g h b o r ) KNN \left( K-Nearest Neighbor \right) KNN(K−NearestNeighbor)是机器学习中最基础的算法之一。既可以用于分类也可以用于回归, K N N KNN KNN通过测量不同特征值之间的距离来进行分类。

2、实例理解

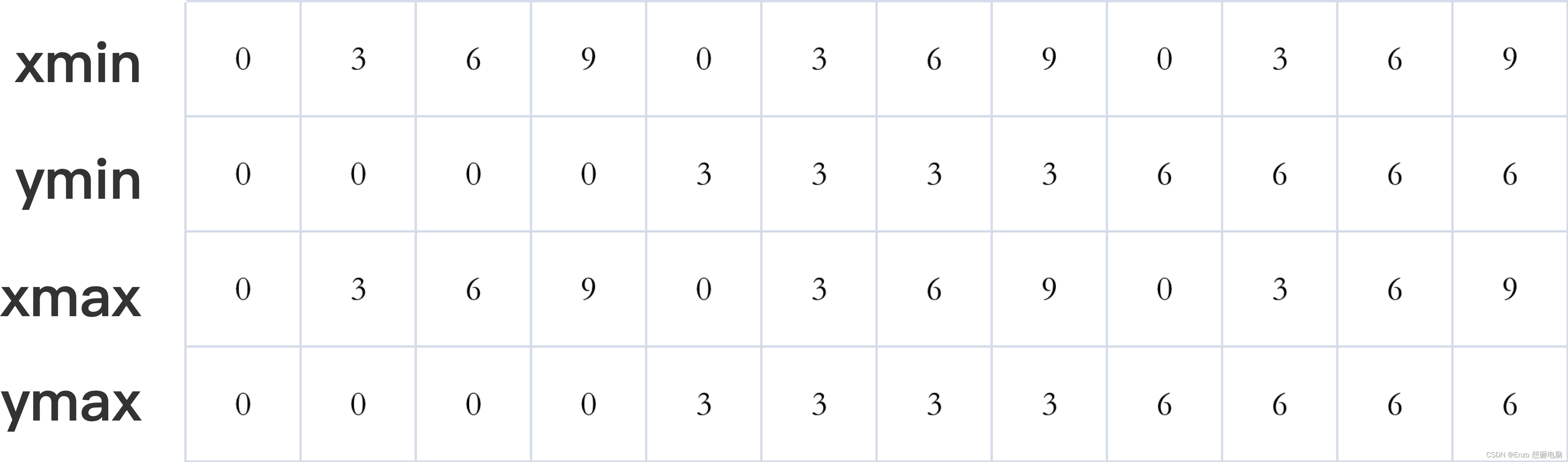

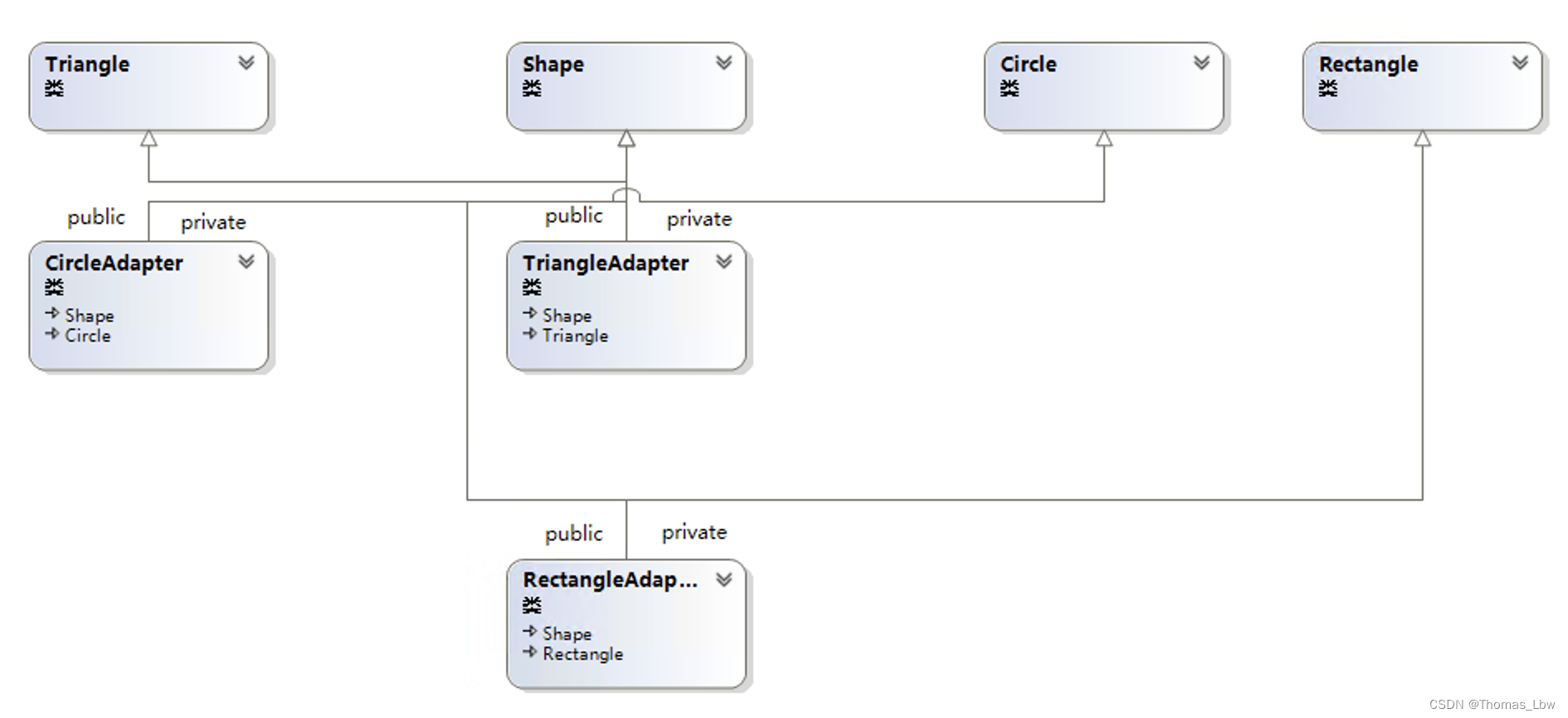

- 如果 k = 3 k = 3 k=3,绿色圆点的最近 3 3 3个邻居是 2 2 2个红色三角形和 1 1 1个蓝色正方形,少数服从多数,基于统计的方法,判定绿色的待分类点属于红色的三角形一类。

- 如果 k = 5 k = 5 k=5,绿色圆点的最近 5 5 5个邻居是 2 2 2个红色三角形和 3 3 3个蓝色正方形,少数服从多数,基于统计的方法,判定绿色的待分类点属于蓝色正方形一类。

从上面的例子可以看出 k k k值是离当前待分类的点最近的 k k k个点, k k k的大小不同会影响最后的结果。

3、计算流程

对于未知类别属性数据集中的点:

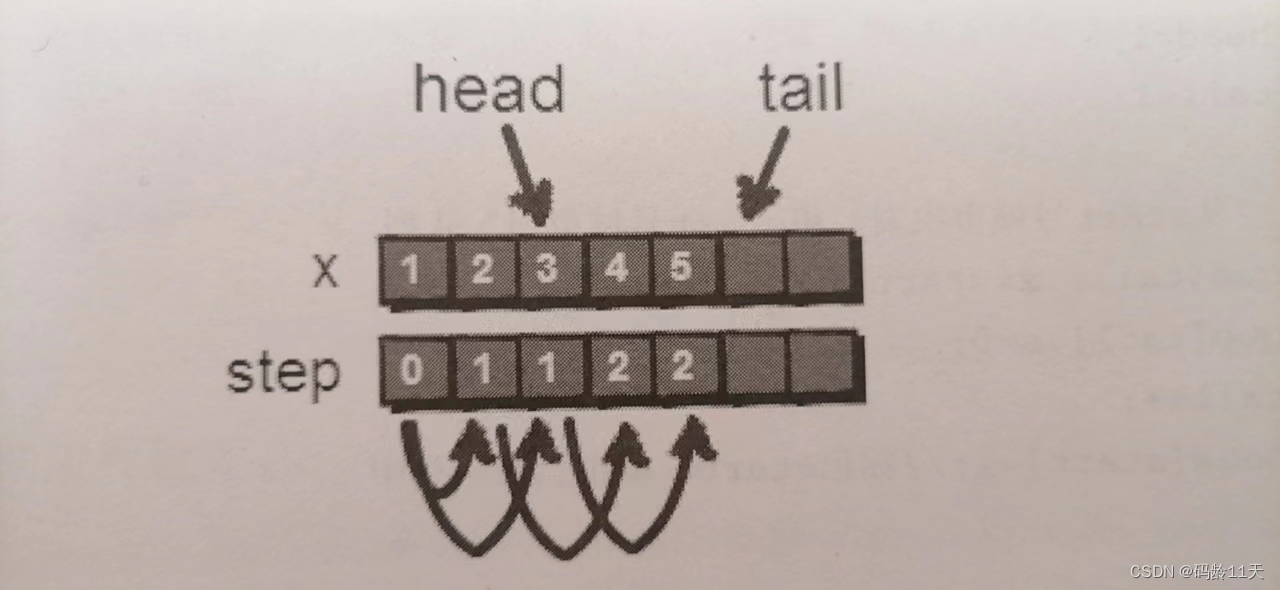

1.计算已知类别数据集中的点与当前点的距离

2.按照距离依次排序

3.选取与当前点距离最小的K个点

4.确定前K个点所在类别的出现概率

5.返回前K个点出现频率最高的类别作为当前点预测分类。

K K K值的选择,距离度量和分类决策规则是该算法的三个基本要素

(1) K K K值的选择

K K K值太大太小都不好,在实际工程实践中,我们一般采用交叉验证的方式选取 K K K值。一般 K K K值选得比较小,我们会在较小范围内选取 K K K值,同时把测试集上准确率最高的那个确定为最终的算法超参数 K K K。

(2)距离度量

样本空间内的两个点之间的距离量度表示两个样本点之间的相似程度:距离越短,表示相似程度越高;反之,相似程度越低。

常用的距离量度方式包括:

- 闵可夫斯基距离

- 欧氏距离

- 曼哈顿距离

- 切比雪夫距离

- 余弦距离

距离部分具体可以参考:https://zhuanlan.zhihu.com/p/405934860

(3)分类决策规则

K N N KNN KNN中的决策规则通常就是“投票选举”——少数服从多数的方式。

4、优缺点

4.1 优点

- K N N KNN KNN 算法本身简单有效,它是一种 l a z y − l e a r n i n g lazy-learning lazy−learning 算法。

- 分类器不需要使用训练集进行训练,训练时间复杂度为 0 0 0。

- K N N KNN KNN 分类的计算复杂度和训练集中的文档数目成正比,也就是说,如果训练集中文档总数为 n n n,那么 K N N KNN KNN 的分类时间复杂度为 O ( n ) O(n) O(n)。

4.2 缺点

该算法在分类时有个主要的不足是,当样本不平衡时,如一个类的样本容量很大,而其他类样本容量很小时,有可能导致当输入一个新样本时,该样本的 K K K个邻居中大容量类的样本占多数。

解决:不同的样本给予不同权重项

参考文章

https://zhuanlan.zhihu.com/p/405934860

https://zhuanlan.zhihu.com/p/45453761

https://zhuanlan.zhihu.com/p/77430477