昇思25天学习打卡营第8天|模型训练

- 前言

- 模型训练

- 构建数据集

- 定义神经网络模型

- 定义超参、损失函数和优化器

- 超参

- 损失函数

- 优化器

- 训练与评估

- 个人任务打卡(读者请忽略)

- 个人理解与总结

前言

非常感谢华为昇思大模型平台和CSDN邀请体验昇思大模型!从今天起,笔者将以打卡的方式,将原文搬运和个人思考结合,分享25天的学习内容与成果。为了提升文章质量和阅读体验,笔者会将思考部分放在最后,供大家探索讨论。同时也欢迎各位领取算力,免费体验昇思大模型!

模型训练

模型训练一般分为四个步骤:

- 构建数据集。

- 定义神经网络模型。

- 定义超参、损失函数及优化器。

- 输入数据集进行训练与评估。

现在我们有了数据集和模型后,可以进行模型的训练与评估。

构建数据集

首先从数据集 Dataset加载代码,构建数据集。

%%capture captured_output

# 实验环境已经预装了mindspore==2.3.0rc1,如需更换mindspore版本,可更改下面mindspore的版本号

!pip uninstall mindspore -y

!pip install -i https://pypi.mirrors.ustc.edu.cn/simple mindspore==2.3.0rc1

import mindspore

from mindspore import nn

from mindspore.dataset import vision, transforms

from mindspore.dataset import MnistDataset

# Download data from open datasets

from download import download

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)#从URL下载MNIST数据集用于模型训练

def datapipe(path, batch_size):

image_transforms = [

vision.Rescale(1.0 / 255.0, 0), #将图像中的矩阵单元转为float32类型

vision.Normalize(mean=(0.1307,), std=(0.3081,)), #设置均值和标准差将图像矩阵元素归一化

vision.HWC2CHW() #将图像的shape从[H, W, C]转为[C, H, W]

]

label_transform = transforms.TypeCast(mindspore.int32) #图像的label转为int32类型

dataset = MnistDataset(path)

dataset = dataset.map(image_transforms, 'image')

dataset = dataset.map(label_transform, 'label')

dataset = dataset.batch(batch_size)

return dataset

train_dataset = datapipe('MNIST_Data/train', batch_size=64) #训练集设置路径,batch_size=64

test_dataset = datapipe('MNIST_Data/test', batch_size=64) #测试集设置路径,batch_size=64

定义神经网络模型

从网络构建中加载代码,构建一个神经网络模型。

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell( #网络依序搭建

nn.Dense(28*28, 512), #全连接层,输入通道数为28*28,输出通道数为512

nn.ReLU(), #ReLU激活函数

nn.Dense(512, 512), #全连接层,输入通道数为512,输出通道数为512

nn.ReLU(), #ReLU激活函数

nn.Dense(512, 10) #全连接层,输入通道数为512,输出通道数为10,对应0-9十种情况

)

def construct(self, x):

x = self.flatten(x) #将输入图像展平为一维序列

logits = self.dense_relu_sequential(x) #将一维序列输入神经网络获得结果

return logits

model = Network() #神经网络实例化为model

定义超参、损失函数和优化器

超参

超参(Hyperparameters)是可以调整的参数,可以控制模型训练优化的过程,不同的超参数值可能会影响模型训练和收敛速度。目前深度学习模型多采用批量随机梯度下降算法进行优化,随机梯度下降算法的原理如下:

w t + 1 = w t − η 1 n ∑ x ∈ B ∇ l ( x , w t ) w_{t+1}=w_{t}-\eta \frac{1}{n} \sum_{x \in \mathcal{B}} \nabla l\left(x, w_{t}\right) wt+1=wt−ηn1x∈B∑∇l(x,wt)

公式中, n n n是批量大小(batch size), η η η是学习率(learning rate)。另外, w t w_{t} wt为训练轮次 t t t中的权重参数, ∇ l \nabla l ∇l为损失函数的导数。除了梯度本身,这两个因子直接决定了模型的权重更新,从优化本身来看,它们是影响模型性能收敛最重要的参数。一般会定义以下超参用于训练:

-

训练轮次(epoch):训练时遍历数据集的次数。

-

批次大小(batch size):数据集进行分批读取训练,设定每个批次数据的大小。batch size过小,花费时间多,同时梯度震荡严重,不利于收敛;batch size过大,不同batch的梯度方向没有任何变化,容易陷入局部极小值,因此需要选择合适的batch size,可以有效提高模型精度、全局收敛。

-

学习率(learning rate):如果学习率偏小,会导致收敛的速度变慢,如果学习率偏大,则可能会导致训练不收敛等不可预测的结果。梯度下降法被广泛应用在最小化模型误差的参数优化算法上。梯度下降法通过多次迭代,并在每一步中最小化损失函数来预估模型的参数。学习率就是在迭代过程中,会控制模型的学习进度。

epochs = 3

batch_size = 64

learning_rate = 1e-2

损失函数

损失函数(loss function)用于评估模型的预测值(logits)和目标值(targets)之间的误差。训练模型时,随机初始化的神经网络模型开始时会预测出错误的结果。损失函数会评估预测结果与目标值的相异程度,模型训练的目标即为降低损失函数求得的误差。

常见的损失函数包括用于回归任务的nn.MSELoss(均方误差)和用于分类的nn.NLLLoss(负对数似然)等。 nn.CrossEntropyLoss 结合了nn.LogSoftmax和nn.NLLLoss,可以对logits 进行归一化并计算预测误差。

loss_fn = nn.CrossEntropyLoss() #使用交叉熵计算损失

优化器

模型优化(Optimization)是在每个训练步骤中调整模型参数以减少模型误差的过程。MindSpore提供多种优化算法的实现,称之为优化器(Optimizer)。优化器内部定义了模型的参数优化过程(即梯度如何更新至模型参数),所有优化逻辑都封装在优化器对象中。在这里,我们使用SGD(Stochastic Gradient Descent)优化器。

我们通过model.trainable_params()方法获得模型的可训练参数,并传入学习率超参来初始化优化器。

optimizer = nn.SGD(model.trainable_params(), learning_rate=learning_rate) #使用SGD优化器,对初始学习率和训练参数进行优化

在训练过程中,通过微分函数可计算获得参数对应的梯度,将其传入优化器中即可实现参数优化,具体形态如下:

grads = grad_fn(inputs)

optimizer(grads)

训练与评估

设置了超参、损失函数和优化器后,我们就可以循环输入数据来训练模型。一次数据集的完整迭代循环称为一轮(epoch)。每轮执行训练时包括两个步骤:

- 训练:迭代训练数据集,并尝试收敛到最佳参数。

- 验证/测试:迭代测试数据集,以检查模型性能是否提升。

接下来我们定义用于训练的train_loop函数和用于测试的test_loop函数。

使用函数式自动微分,需先定义正向函数forward_fn,使用value_and_grad获得微分函数grad_fn。然后,我们将微分函数和优化器的执行封装为train_step函数,接下来循环迭代数据集进行训练即可。

# Define forward function

def forward_fn(data, label): #定义前向函数

logits = model(data)

loss = loss_fn(logits, label) #损失为训练结果与真实值(标签)的差距

return loss, logits

# Get gradient function

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)#梯度函数

# Define function of one-step training

def train_step(data, label):

(loss, _), grads = grad_fn(data, label)

optimizer(grads) #优化梯度

return loss

def train_loop(model, dataset): #模型训练

size = dataset.get_dataset_size()

model.set_train()

for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):

loss = train_step(data, label)

if batch % 100 == 0: #当batch为100的整数倍时,输出loss

loss, current = loss.asnumpy(), batch

print(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")

test_loop函数同样需循环遍历数据集,调用模型计算loss和Accuray并返回最终结果。

def test_loop(model, dataset, loss_fn): #模型测试

num_batches = dataset.get_dataset_size()

model.set_train(False) #设置模型为非训练模式

total, test_loss, correct = 0, 0, 0

for data, label in dataset.create_tuple_iterator(): #计算准确率和测试损失

pred = model(data)

total += len(data)

test_loss += loss_fn(pred, label).asnumpy()

correct += (pred.argmax(1) == label).asnumpy().sum()

test_loss /= num_batches

correct /= total

print(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

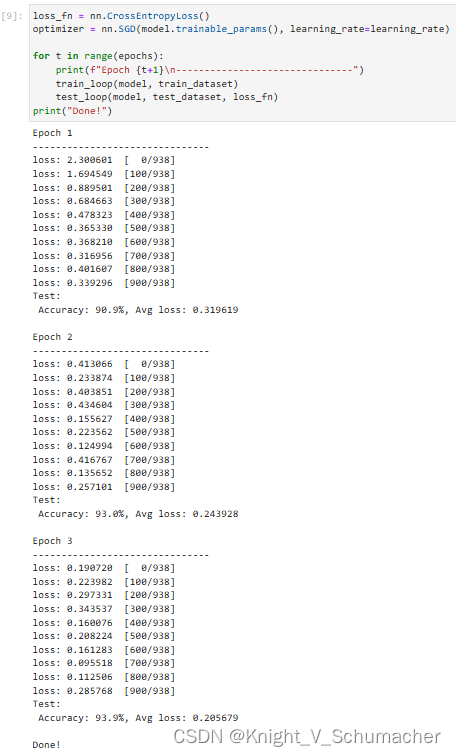

我们将实例化的损失函数和优化器传入train_loop和test_loop中。训练3轮并输出loss和Accuracy,查看性能变化。

loss_fn = nn.CrossEntropyLoss()

optimizer = nn.SGD(model.trainable_params(), learning_rate=learning_rate)

for t in range(epochs):

print(f"Epoch {t+1}\n-------------------------------")

train_loop(model, train_dataset)

test_loop(model, test_dataset, loss_fn)

print("Done!")

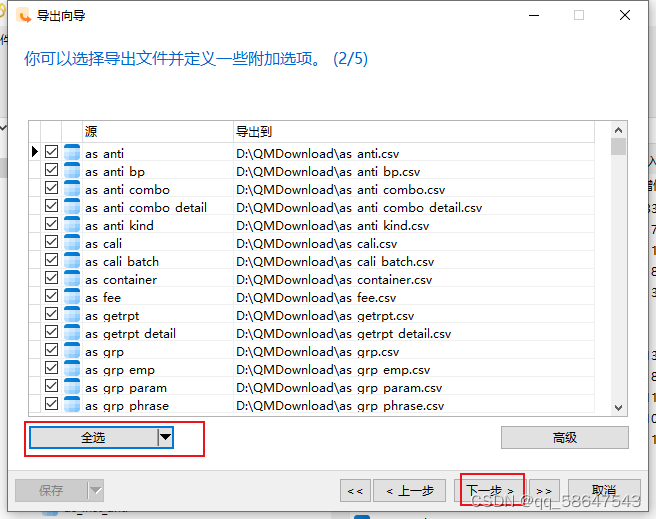

个人任务打卡(读者请忽略)

个人理解与总结

本章节主要描述了昇思大模型模型训练的主要功能,从训练模型的最基础的构建数据集开始,先后完成了定义神经网络模型、定义超参、损失函数和优化器以及最终的训练预评估四部分。通过搭建简单的全连接图像分类网络完成手写体识别任务。网络首先通过下载和设置数据集,完成数据集搭建,为后续的深度神经网络训练打下基础;然后定义神经网络,搭建输入-隐藏-输出三层全连接神经网络以完成图像分类任务;定义超参数、损失函数和优化器保证深度神经网络在训练过程中的正向优化;最后经train_loop和test_loop完成深度神经网络的训练与测试,并输出每100个iteration的损失及每代的测试准确率和测试损失。综上所述,昇思大模型为深度神经网络的搭建提供了系统性参照,为深度更深、结构更复杂的模型提供了搭建基础。