主成分分析(PCA)是一种旋转数据集的方法,旋转后的数特征在统计上不相关。在做完这种旋转之后,通常是根据新特征对解释数据的重要性来选择它的一个子集。

举例:

import mglearn.plots

import matplotlib.pyplot as plt

mglearn.plots.plot_pca_illustration()

plt.show()

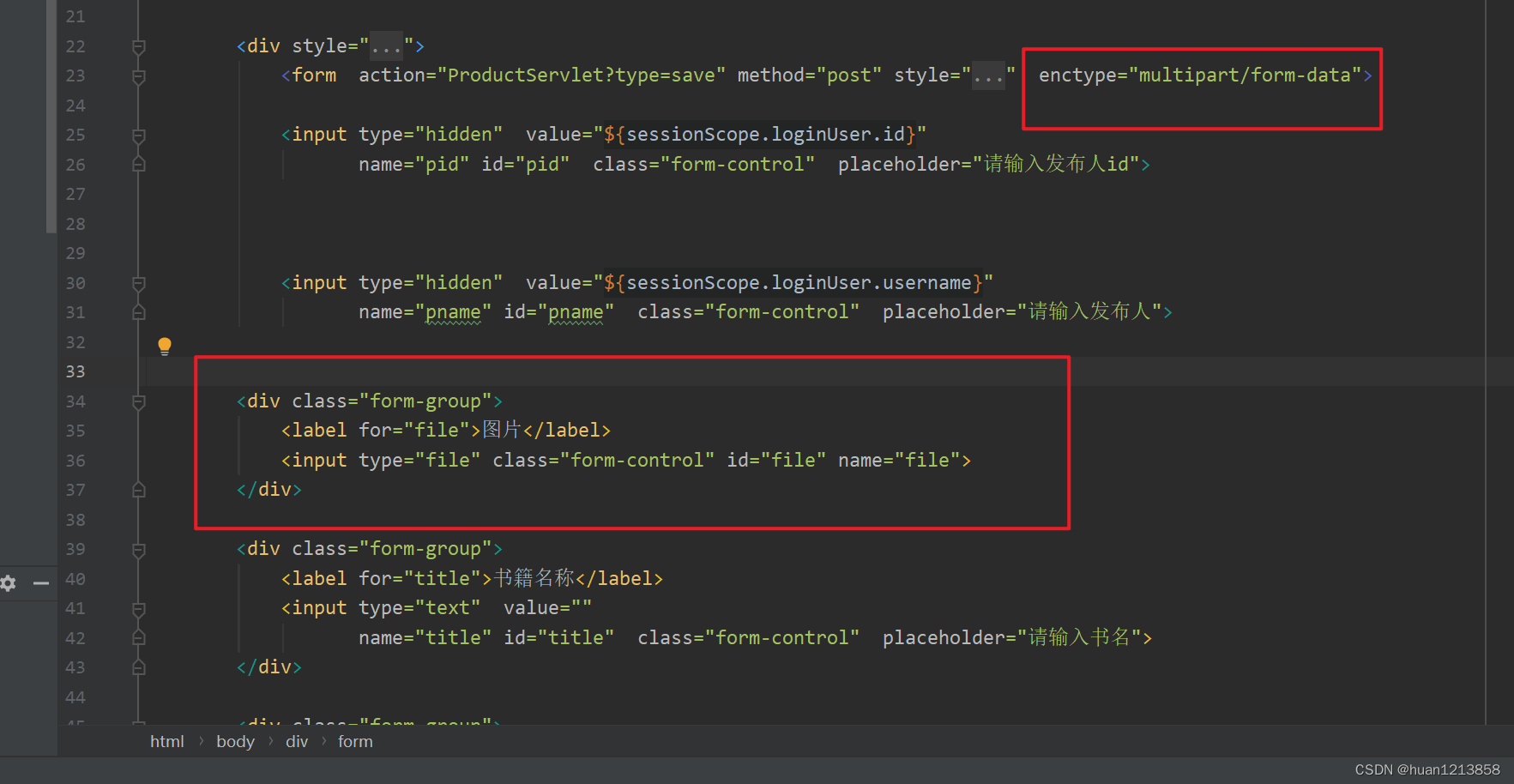

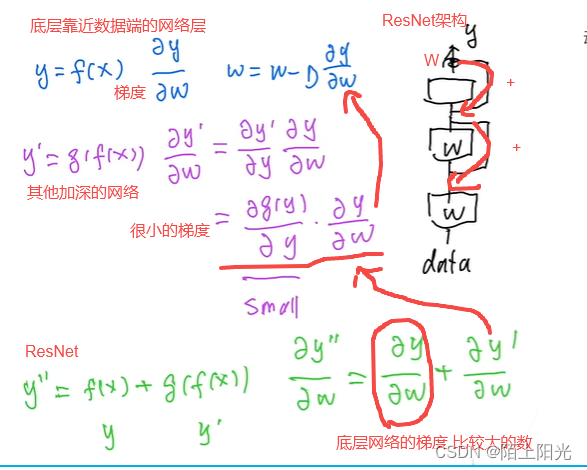

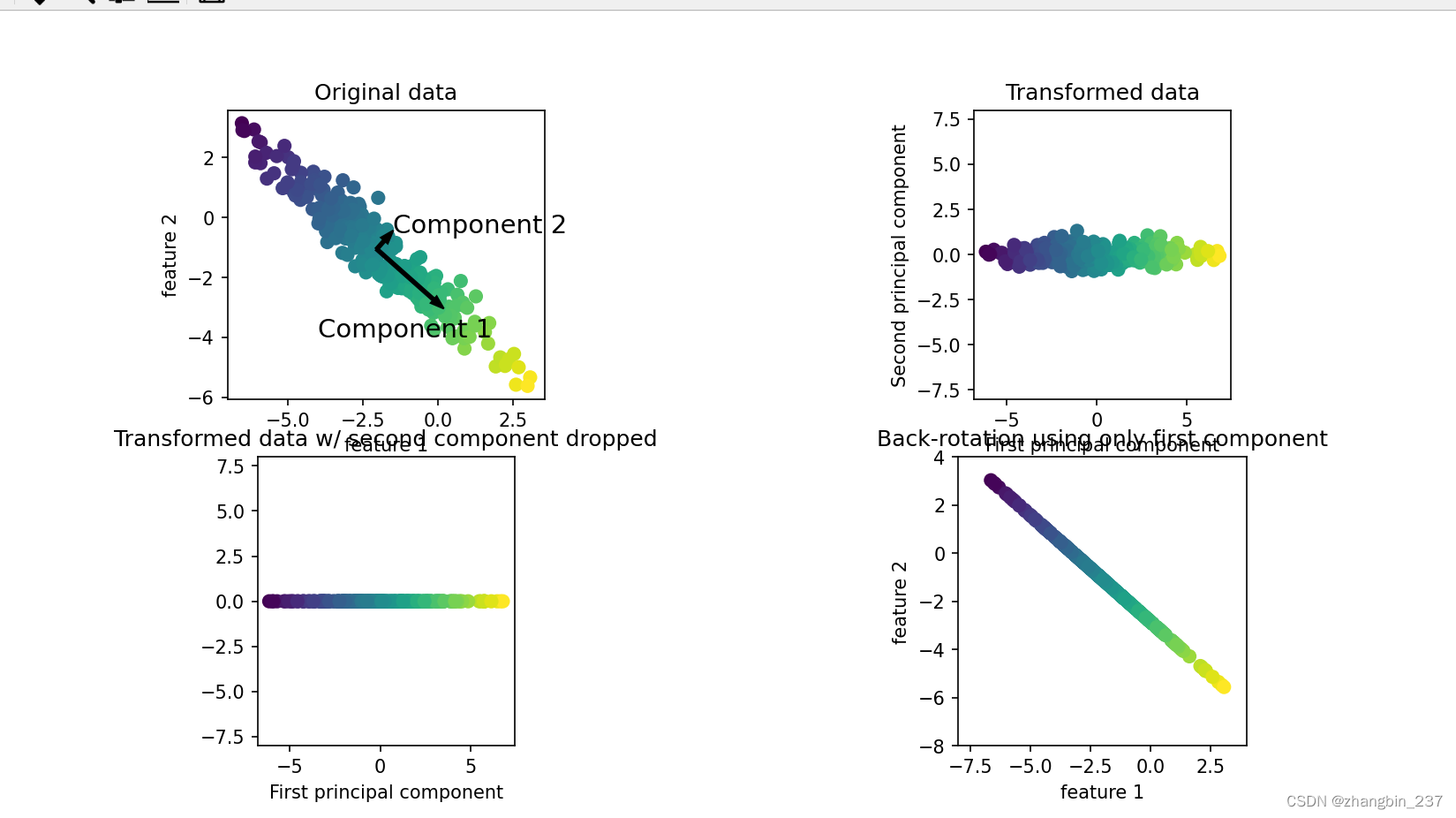

第一张图(左上)显示的是原始数据点。用不同颜色区分。算法首先是方差最大的方向,将其标记成(component 1)。这是数据中包含信息最多的方向,换句话说,沿着这个方向的特征之间最为相关。然后,算法找到与第一个方向成直角、且包含最多信息的方向。在二维空间中,只有一个成直角的方向,但是在更高维的空间会存在(无穷)多的正交方向。

利用这一过程找到的方向被称为主成分,因为它们是数据方差的主要方向。一般来说,主成分的个数与原始特征相同。

第二张图(右上)显示的是同样数据,但将其旋转,使得第一主成分与x轴平行且第二主成分与y轴平行。在旋转之前,从数据中减去平均值,使得变换后的数据以零为中心。在PCA找到的选择中,两个坐标轴是不相关的。也就是说,对于这种数据表示,除了对角线,相关矩阵全部为零。

通过只保留一部分主成分来使用PCA进行降维。在这个例子中,我们可以仅保留第一个主成分,也就是左下图。这将数据从二维数据集降为一维数据集。但要注意的是,我们没有保留原始特征之一,而是找到了第一主成分的方向。

最后,反向旋转并将平均值重新加到数据中,就会得到右下图。这些数据点位于原始特征空间中,但我们仅保留了第一主成分中包含的信息。这种变换有时用于去除数据中的噪声影响,或者将主成分中保留的那部分信息可视化。

![流批一体计算引擎-10-[Flink]中的常用算子和DataStream转换](https://img-blog.csdnimg.cn/direct/d05f4a2969834c3d826feb57eb0a90b9.png)