时间复杂度

时间复杂度的全称是渐进时间复杂度,表示算法的执行时间与数据规模之间的增长关系

1、只关注循环执行次数最多的一段代码

2、加法法则:总复杂度等于量级最大的那段代码的复杂度

3、乘法法则:嵌套代码的复杂度等于嵌套内外代码复杂度的乘积

几种常见时间复杂度实例分析

1、O(1)

O(1)是常量级时间复杂度的一种表示方法,并不是指只执行了一行代码。

一般情况下,只要算法中不存在循环、递归,即使有成千上万行代码,其时间复杂度也是O(1)

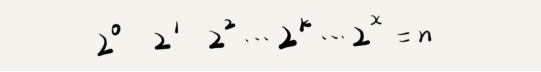

2、O(logn)、O(nlogn)

i=1;

while(i <= n) {

i = i*2;

}

x = log2n,这段代码的时间复杂度为O(log2n)

i=1;

while(i <= n) {

i = i*3;

}这段代码的时间复杂度为O(log3n),

由于log3n = log32 * log2n,所以O(log3n) = O(C * log2n),

采用大O标记复杂度的时候,可以忽略系数,即O(Cf(n)) = O(f(n))。因此,在对数阶时间复杂度的表示方法里,可以忽略对数的“底”,统一表示为O(logn)。

3. O(m+n)、O(m*n)

代码的时间复杂度由两个数据的规模来决定

int cal(int m, int n) {

int sum_1 = 0;

int i = 1;

for (; i < m; ++i) {

sum_1 = sum_1 + i;

}

int sum_2 = 0;

int j = 1;

for (; j < n; ++j) {

sum_2 = sum_2 + j;

}

return sum_1 + sum_2;

}从代码中可以看出,m 和 n 是表示两个数据规模。

我们无法事先评估 m 和 n 谁的量级大,所以我们在表示复杂度的时候,就不能简单地利用加法法则,省略掉其中一个。所以,上面代码的时间复杂度就是 O(m+n)。

针对这种情况,原来的加法法则就不正确了,我们需要将加法规则改为:T1(m) + T2(n) = O(f(m) + g(n))。但是乘法法则继续有效:T1(m)*T2(n) = O(f(m) * f(n))。

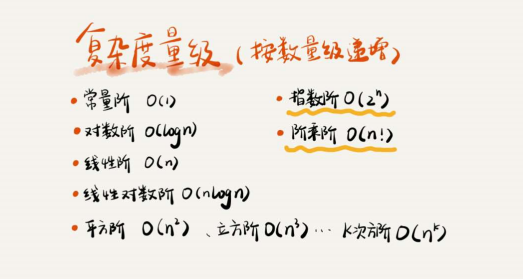

复杂度大小关系

![[FUNC]在AHK中实现Pyhton的range函数](https://img-blog.csdnimg.cn/img_convert/fcde9a487b1c204d9b7324e3a1f55a9c.png)

![[前端笔记——HTML介绍] 5.文档与网站架构](https://img-blog.csdnimg.cn/5846598d054c48898293853b8f610513.png)

![[HCTF 2018]admin (三种解法详细详解)](https://img-blog.csdnimg.cn/cb16ec5e52b34c6d95fe5c7cbdc675c8.png)