文章主题

本教程将介绍如何在嵌入式系统中使用C语言实现人工智能应用,特别是如何在资源受限的嵌入式设备上进行神经网络推理。

本文将详细介绍环境准备、基础知识、代码示例及其应用场景,并提供常见问题的解决方案与优化方法。

2. 环境准备

硬件

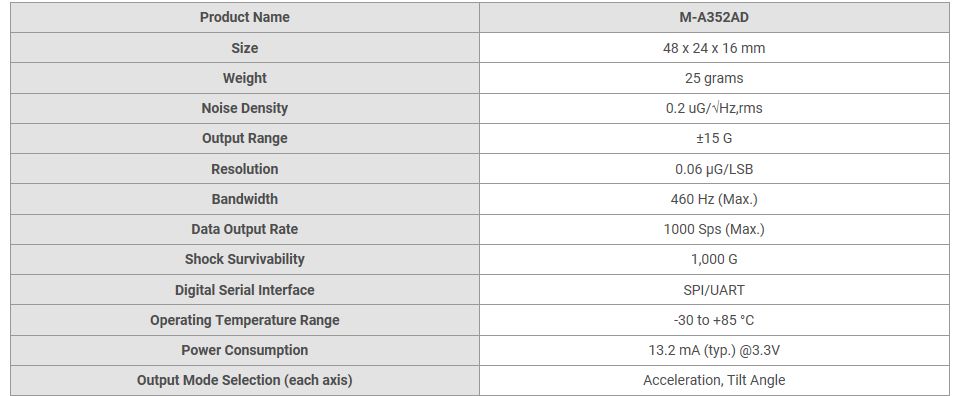

- 开发板:例如STM32F746 Discovery Kit。

- 调试器:ST-LINK V2或JTAG调试器。

软件

- 集成开发环境(IDE):STM32CubeIDE或Keil MDK。

- AI库:例如TensorFlow Lite for Microcontrollers。

- 调试工具:STM32 ST-LINK Utility或GDB。

安装步骤示例

- 下载并安装 STM32CubeMX。

- 下载并安装 STM32CubeIDE。

- 下载并安装 TensorFlow Lite for Microcontrollers 并将其集成到STM32CubeIDE项目中。

3. 人工智能简介与嵌入式系统结合

人工智能(AI)基础

人工智能指通过计算机实现智能行为的技术,包括机器学习、深度学习等。神经网络是深度学习的核心,能够通过大量数据训练模型,实现分类、预测等功能。

嵌入式系统中的AI

在嵌入式系统中实现AI,面临计算能力和内存的限制。通过使用轻量级的AI框架(如TensorFlow Lite for Microcontrollers),我们可以在嵌入式设备上进行简单的神经网络推理。

4. 代码示例:使用嵌入式系统实现简单的神经网络推理

模型准备

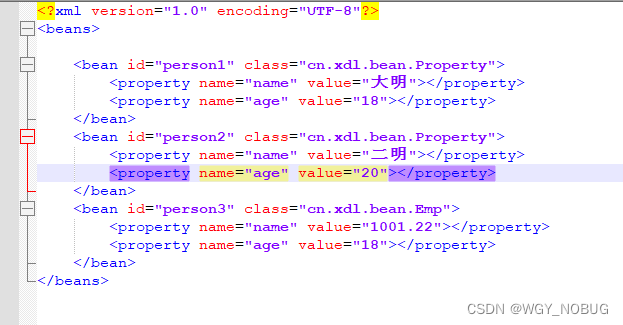

首先,需要在PC上使用TensorFlow训练一个简单的模型(例如,手写数字识别模型),并转换为TensorFlow Lite格式,然后将其转换为适用于嵌入式设备的C数组格式。

在嵌入式系统中进行推理

模型加载与初始化

#include "tensorflow/lite/micro/micro_interpreter.h"

#include "tensorflow/lite/micro/all_ops_resolver.h"

#include "tensorflow/lite/schema/schema_generated.h"

#include "tensorflow/lite/version.h"

// 包含模型的头文件

#include "model_data.h"

// 模型参数

const tflite::Model* model;

tflite::MicroInterpreter* interpreter;

TfLiteTensor* input;

TfLiteTensor* output;

// 内存分配

constexpr int tensor_arena_size = 2 * 1024;

uint8_t tensor_arena[tensor_arena_size];

// 初始化模型

void AI_Init(void) {

model = tflite::GetModel(g_model_data);

if (model->version() != TFLITE_SCHEMA_VERSION) {

// 模型版本不匹配

while (1);

}

static tflite::MicroOpResolver<10> micro_op_resolver;

tflite::MicroInterpreter static_interpreter(model, micro_op_resolver, tensor_arena, tensor_arena_size);

interpreter = &static_interpreter;

TfLiteStatus allocate_status = interpreter->AllocateTensors();

if (allocate_status != kTfLiteOk) {

// 分配张量内存失败

while (1);

}

input = interpreter->input(0);

output = interpreter->output(0);

}

推理过程

void AI_Inference(float* input_data, float* output_data) {

// 拷贝输入数据到模型的输入张量

for (int i = 0; i < input->dims->data[0]; i++) {

input->data.f[i] = input_data[i];

}

// 执行推理

TfLiteStatus invoke_status = interpreter->Invoke();

if (invoke_status != kTfLiteOk) {

// 推理失败

while (1);

}

// 获取输出结果

for (int i = 0; i < output->dims->data[0]; i++) {

output_data[i] = output->data.f[i];

}

}

int main(void) {

AI_Init();

float input_data[28*28]; // 假设输入为28x28的图像

float output_data[10]; // 输出为10类

// 模拟输入数据

for (int i = 0; i < 28*28; i++) {

input_data[i] = 0.0f; // 示例数据

}

AI_Inference(input_data, output_data);

// 处理输出数据

while (1) {

// 实时处理

}

}

5. 应用场景:智能传感器与边缘计算

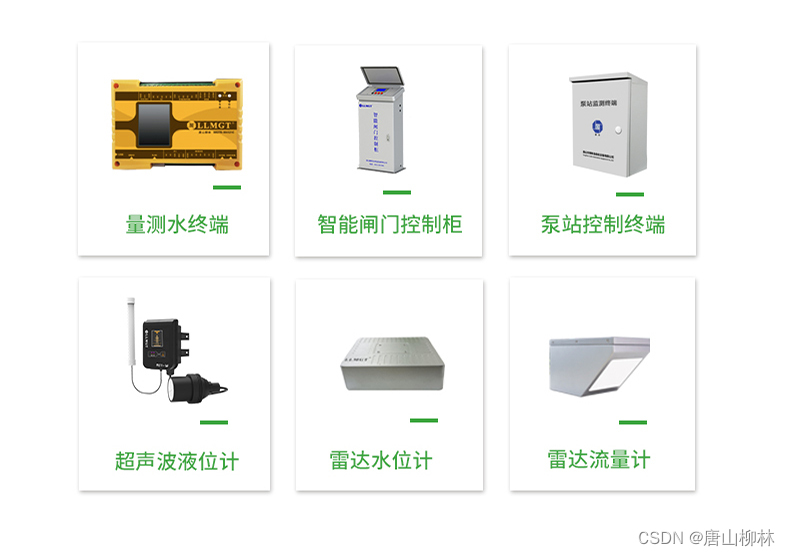

智能传感器

智能传感器结合AI技术,可以实时处理采集到的数据,实现更智能的感知与控制。例如,智能相机可以实时识别图像中的物体,智能温控器可以根据环境数据自动调节温度。

边缘计算

边缘计算将计算任务从云端下移到靠近数据源的边缘设备上,减少数据传输延迟,提高响应速度。在嵌入式系统中实现AI推理,即是一种边缘计算的应用。

6. 问题解决方案与优化

常见问题及解决方案

-

模型太大,内存不足

解决方案:使用模型压缩技术,如量化(Quantization),将浮点数模型转换为定点数模型,减少模型大小和计算量。

-

推理速度慢

解决方案:优化代码,提高执行效率。例如,使用硬件加速功能,如STM32的DSP指令集。

-

电源管理

解决方案:在不需要时,降低系统频率或进入低功耗模式,减少能耗。

高级优化

硬件加速

利用STM32的DSP指令集加速AI推理。

#include "arm_math.h"

// 使用CMSIS-DSP库加速矩阵乘法

void MatrixMultiply(const float32_t* A, const float32_t* B, float32_t* C, uint16_t M, uint16_t N, uint16_t K) {

arm_matrix_instance_f32 matA;

arm_matrix_instance_f32 matB;

arm_matrix_instance_f32 matC;

arm_mat_init_f32(&matA, M, N, (float32_t*)A);

arm_mat_init_f32(&matB, N, K, (float32_t*)B);

arm_mat_init_f32(&matC, M, K, C);

arm_mat_mult_f32(&matA, &matB, &matC);

}

电源管理优化

在AI推理前后调整系统功耗状态。

void EnterLowPowerMode(void) {

// 配置进入低功耗模式

HAL_PWR_EnterSLEEPMode(PWR_MAINREGULATOR_ON, PWR_SLEEPENTRY_WFI);

}

void ExitLowPowerMode(void) {

// 退出低功耗模式

__NOP();

}

⬇帮大家整理了单片机的资料

包括stm32的项目合集【源码+开发文档】

点击下方蓝字即可领取,感谢支持!⬇

点击领取更多嵌入式详细资料

问题讨论,stm32的资料领取可以私信!

通过本教程,你应该掌握了如何在嵌入式系统中使用C语言实现人工智能应用,包括环境准备、模型加载与推理、以及优化方法。如果有任何问题或需要进一步的帮助,请随时联系我。