初始爬虫

前言引入

随着大数据时代的来临,网络爬虫在互联网中的地位将越来越重要。互联网中的数据是海量的,如何自动高效地获取互联网中我们感兴趣的信息并为我们所用是一个重要的问题,而爬虫技术就是为了解决这些问题而生的。 我们感兴趣的信息分为不同的类型:如果只是做搜索引擎,那么感兴趣的信息就是互联网中尽可能多的高质量网页;如果要获取某一垂直领域的数据或者有明确的检索需求,那么感兴趣的信息就是根据我们的检索和需求所定位的这些信息,此时,需要过滤掉一些无用信息。前者我们称为通用网络爬虫,后者我们称为聚焦网络爬虫。

什么是爬虫?

网络爬虫又称网络蜘蛛、网络蚂蚁、网络机器人等,可以自动化浏览网络中的信息,当然浏览信息的时候需要按照我们制定的规则进行,这些规则我们称之为网络爬虫算法。使用Python可以很方便地编写出爬虫程序,进行互联网信息的自动化检索。

-

简单一句话就是代替人去模拟浏览器进行网页操作。

为什么需要爬虫?

-

为其他程序提供数据源 如搜索引擎(百度、Google等)、数据分析、大数据等等。

企业获取数据的方式?

-

1.公司自有的数据

-

2.第三方平台购买的数据 (百度指数、数据堂)

-

3.爬虫爬取的数据

Python做爬虫的优势

-

PHP : 对多线程、异步支持不太好

-

Java : 代码量大,代码笨重

-

C/C++ : 代码量大,难以编写

-

Python : 支持模块多、代码简介、开发效率高 (scrapy框架)

爬虫的分类

-

通用网络爬虫 例如 baidu google yahu

-

聚焦网络爬虫: 根据既定的目标有选择的抓取某一特定主题内容

爬虫的合法性

爬虫作为一种计算机技术就决定了它的中立性,因此爬虫本身在法律上并不被禁止,但是利用爬虫技术获取数据这一行为是具有违法甚至是犯罪的风险的。

http与https协议概念

1.什么是协议?

网络协议是计算机之间为了实现网络通信而达成的一种“约定”或者”规则“,有了这种”约定“,不同厂商的生产设备,以及不同操作系统组成的计算机之间,就可以实现通信。

2.HTTP协议是什么?

HTTP协议是超文本传输协议的缩写,英文是Hyper Text Transfer Protocol。它是从WEB服务器传输超文本标记语言(HTML)到本地浏览器的传送协议。 设计HTTP最初的目的是为了提供一种发布和接收HTML页面的方法。 HTPP有多个版本,目前广泛使用的是HTTP/1.1版本。有些网站运用的是http/2.0版本。

3.HTTP原理(了解)

HTTP是一个基于TCP/IP通信协议来传递数据的协议,传输的数据类型为HTML 文件,、图片文件, 查询结果等。 HTTP协议一般用于B/S架构(浏览器/服务器结构)。浏览器作为HTTP客户端通过URL向HTTP服务端即WEB服务器发送所有请求。

4.HTTP特点(了解)

-

http协议支持客户端/服务端模式,也是一种请求/响应模式的协议。

-

简单快速:客户向服务器请求服务时,只需传送请求方法和路径。请求方法常用的有GET、HEAD、POST。

-

灵活:HTTP允许传输任意类型的数据对象。传输的类型由Content-Type加以标记。

-

无连接:限制每次连接只处理一个请求。服务器处理完请求,并收到客户的应答后,即断开连接,但是却不利于客户端与服务器保持会话连接,为了弥补这种不足,产生了两项记录http状态的技术,一个叫做Cookie,一个叫做Session。

-

无状态:无状态是指协议对于事务处理没有记忆,后续处理需要前面的信息,则必须重传。

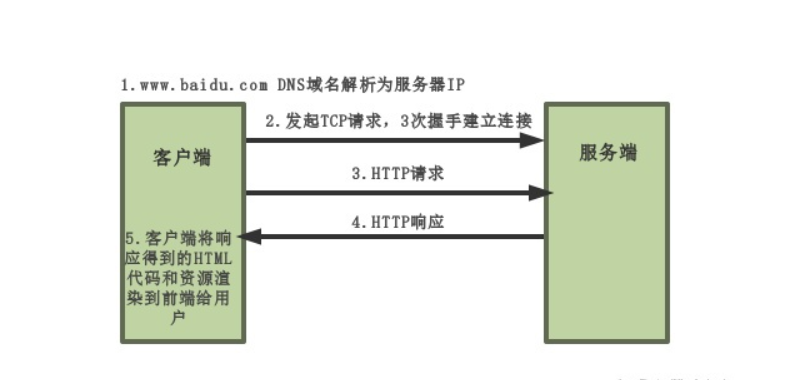

5.Http请求与响应(重点理解的)

HTTP通信由两部分组成: 客户端请求消息 与 服务器响应消息

-

当用户在浏览器的地址栏中输入一个URL并按回车键之后,浏览器会向HTTP服务器发送HTTP请求。HTTP请求主要分为“Get”和“Post”两种方法。

-

当我们在浏览器输入URL 百度一下,你就知道 的时候,浏览器发送一个Request请求去获取 百度一下,你就知道 的html文件,服务器把Response文件对象发送回给浏览器。

-

浏览器分析Response中的 HTML,发现其中引用了很多其他文件,比如Images文件,CSS文件,JS文件。 浏览器会自动再次发送Request去获取图片,CSS文件,或者JS文件。

-

当所有的文件都下载成功后,网页会根据HTML语法结构,完整的显示出来了。

6.HTTP报文组成

HTTP报文大致分为报文首部和报文主体两块,中间用空行来划分。通常,不一定有报文主体。

-

报文首部:包含服务器或客户端需处理的请求或响应的内容及属性。

-

报文主体:是应该被发送的数据。

请求报文首部的结构:

一个典型的HTTP请求示例打开控制台,查看Request Headers (重点)

GET / HTTP/1.1

Host: www.baidu.com

Connection: keep-alive

Upgrade-Insecure-Requests: 1

User-Agent: Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/53.0.2785.143 Safari/537.36

Accept: text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,*/*;q=0.8

Referer: https://www.baidu.com/s?wd=HTTP%20%E5%8D%8F%E8%AE%AE%E6%9C%89%E5%87%A0%E7%A7%8D%E5%92%8C.....

Accept-Encoding: gzip, deflate, sdch, br

Accept-Language: zh-CN,zh;q=0.8

Cookie: BIDUPSID=670A04B660AAF2716D3120BEAF946A11; BAIDUID=2454D4....

RA-Ver: 3.0.8

RA-Sid: CA623F7A-20150914-060054-2b9722-5fde41

第一行为请求行: GET / HTTP/1.1 方法是GET,协议版本http1.1 HOST:请求资源所在服务器 Connection keep-alive:一般情况下,一旦web服务器向浏览器发送了请求数据,他就要关闭TCP连接,然后如果浏览器或者服务器在其头信息加入了Connection:keep-alive,则TCP连接在发送后仍将保持打开状态,于是,浏览器可以继续通过相同的连接发送请求,保持连接节省了为每个请求建立新连接所需要的时间,还节约了网络带宽。 User-Agent:客户端程序的信息,就是我发送请求的浏览器信息。 Accept:列出了浏览器可以接收的媒体数据类型:

-

文本文件:text/html, text/palin,text/css,application/xhtml+xml...

-

图片文件:image/jpeg, image/gif, image/png...

-

视频文件: video/jpeg, video/quicktime... 等。

Accept-Encoding: 是浏览器用来告知服务器它能够支持的内容编码及内容编码的优先级顺序,可一次性指定多种内容编码。gzip:有文件压缩程序gzip生成的编码格式。deflate:组合使用zlib格式和deflate压缩算法生成的编码格式。sdch: Shared Dictionary Compression over HTTP字典压缩算法。 Accept-Language:告知服务器浏览器能够处理的自然语言集(中文、英文等)。zh-CN中文简体。 Cookie:浏览器记录的用户相关信息。

响应报文首部的结构

浏览器控制台给出了相应的Reponse Headers

HTTP/1.1 200 OK

Server: bfe/1.0.8.18

Date: Mon, 16 Jan 2017 06:35:24 GMT

Content-Type: text/html;charset=utf-8

Transfer-Encoding: chunked

Connection: keep-alive

Cache-Control: private

Expires: Mon, 16 Jan 2017 06:35:24 GMT

Content-Encoding: gzip

X-UA-Compatible: IE=Edge,chrome=1

Strict-Transport-Security: max-age=172800

BDPAGETYPE: 2

BDQID: 0xe0042a0200002ea3

BDUSERID: 252528851

Set-Cookie: BDSVRTM=104; path=/

Set-Cookie: BD_HOME=1; path=/

Set-Cookie: H_PS_PSSID=21767_1446_21111_18133_19898_20718; path=/; domain=.baidu.com

Set-Cookie: __bsi=17204004216256107848_00_0_I_R_105_0303_C02F_N_I_I_0; expires=Mon, 16-Jan-17 06:35:29 GMT; domain=www.baidu.com; path=/

第一行状态行:给出了状态码200,表示请求已被正常处理。 Server:这是服务器用来告诉客户端当前服务器上安装的HTTP服务器应用程序的信息,可能包含服务器上的软件应用名称,版本号等。 Content-Type:此字段标明了服务器返回给浏览器的实体内容的类型是text/html,charset为UTF-8。这部分与请求头中的Accept相对应。 Transfer-Encoding: chunked 表示输出的内容长度不能确定,普通的静态页面、图片之类的基本上都用不到这个。动态页面中可能会用到。 Cache-Control: 缓存控制,默认值为private,表示内容只缓存到私有缓存中(仅客户端可以缓存,代理服务器不可缓存)。 Expires:告知客户端资源失效的日期。当浏览器看到响应中有一个Expires头时,它会和相应的组件一起保存到其缓存中,只要组件没有过期,浏览器就会使用缓存版本而不会进行任何的HTTP请求。Expires设置的日期格式必须为GMT(格林尼治标准时间)。 X-UA-Compatible: 设置浏览器兼容模式。 IE=Edge 指定IE浏览器以最新的标准来渲染页面,chrome=1 则可以激活Chrome Frame,将允许站点在使用了谷歌浏览器内嵌框架(Chrome Frame)的客户端渲染,对于没有使用的,则没有任何影响。

报文主体部分

在刚才访问www.baidu.com的例子中,控制台点击Response,我们就可以看到服务器返回给浏览器的数据(如图),数据格式为html,浏览器拿到数据后解析渲染成我们所看到的百度首页。

7.什么是HTTPS?

-

https=http+ssl,顾名思义,https是在http的基础上加上了SSL保护壳,信息的加密过程就是在SSL中完成的

-

https,是以安全为目标的HTTP通道,简单讲是HTTP的安全版。即HTTP下加入SSL层,HTTPS的安全基础是SSL

8.SSL怎么理解?

-

SSL也是一个协议主要用于web的安全传输协议

9.HTTPS和HTTP的区别与总结(了解)

一般http中存在如下问题:

-

请求信息明文传输,容易被窃听截取。

-

数据的完整性未校验,容易被篡改

-

没有验证对方身份,存在冒充危险

HTTPS的缺点

-

HTTPS协议多次握手,导致页面的加载时间延长近50%;

-

HTTPS连接缓存不如HTTP高效,会增加数据开销和功耗;

-

申请SSL证书需要钱,功能越强大的证书费用越高。

-

SSL涉及到的安全算法会消耗 CPU 资源,对服务器资源消耗较大。

总结

-

HTTPS是HTTP协议的安全版本,HTTP协议的数据传输是明文的,是不安全的,HTTPS使用了SSL/TLS协议进行了加密处理。

-

http和https使用连接方式不同,默认端口也不一样,http是80,https是443。

在爬虫中使用HTTP协议主要请求方式

get请求

> https://www.baidu.com/s?wd=%E8%B6%B3%E7%90%83&rsv_spt=1&rsv_iqid=0x85adcdd500012556&issp=1&f=8&rsv_bp=1&rsv_idx=2&ie=utf-8&tn=68018901_2_oem_dg&rsv_enter=1&rsv_dl=tb&rsv_sug3=6&rsv_sug1=5&rsv_sug7=100&rsv_sug2=0&rsv_btype=i&prefixsug=%25E8%25B6%25B3%25E7%2590%2583&rsp=8&inputT=1287&rsv_sug4=1288

get请求所携带的参数,都包含在url(网址)里面,https://www.baidu.com/s 称作域名,域名后面如果有参数,用? 链接;参数和参数之间用&拼接,get请求不能无限制携带参数,大小在4kb左右

通过get请求,直接返回网页数据出来

post请求

> https://passport.hupu.com/pc/login/member.action

post请求携带的参数,通过form表单进行提交,所能够提交的数据大小,是无限制的

post请求,不能够在浏览器中直接访问

几个概念

认识url

发送http请求时,通过URL对网络资源进行定位。 URL(Uniform Resource Locator),中文叫统一资源定位符。是用来标识某一处资源的地址。也 即是我们常说的网址

常见请求方法

-

GET:请求指定的页面信息,并返回实体主体。

-

POST:向指定资源提交数据进行处理请求(例如提交表单或者上传文件)。数据被包含在请求体中。POST请求可能会导致新的资源的建立和/或已有资源的修改。

-

HEAD:类似于get请求,只不过返回的响应中没有具体的内容,用于获取报头

-

PUT:从客户端向服务器传送的数据取代指定的文档的内容。

-

DELETE:请求服务器删除指定的页面。

响应状态码

访问一个网页时,浏览器会向web服务器发出请求。此网页所在的服务器会返回一个包含HTTP状态码的信息头用以响应浏览器的请求。 状态码分类:

-

1XX- 信息型,服务器收到请求,需要请求者继续操作。

-

2XX- 成功型,请求成功收到,理解并处理。

-

3XX - 重定向,需要进一步的操作以完成请求。

-

4XX - 客户端错误,请求包含语法错误或无法完成请求。

-

5XX - 服务器错误,服务器在处理请求的过程中发生了错误。

常见状态码:

-

200 OK - 客户端请求成功

-

301 - 资源(网页等)被永久转移到其它URL

-

302 - 临时跳转

-

400 Bad Request - 客户端请求有语法错误,不能被服务器所理解

-

401 Unauthorized - 请求未经授权,这个状态代码必须和WWW-Authenticate报头域一起使用

-

404 - 请求资源不存在,可能是输入了错误的URL

-

500 - 服务器内部发生了不可预期的错误

-

503 Server Unavailable - 服务器当前不能处理客户端的请求,一段时间后可能恢复正常。

User-Agent 用户代理(反反爬的第一步)

-

作用:记录用户的浏览器、操作系统等,为了让用户更好的获取HTML页面效果

Referer防盗链

-

表明当前这个请求是从哪个url过来的。一般情况下可以用来做反爬的技术

抓包工具的使用

-

Elements : 元素 网页源代码,提取数据和分析数据(有些数据是经过特殊处理的所以并不是都是准确的)

-

Console : 控制台 (打印信息)

-

Sources : 信息来源 (整个网站加载的文件)

-

NetWork : 网络工作(信息抓包) 能够看到很多的网页请求

爬虫如何规避风险

1 从程序角度

> 测试环节,尽可能只拿一页数据进行测试 垃圾爬虫 相当于造成了网络攻击

>

> 实际爬取 控制你的访问速度

2 从商业角度

数据是否敏感

ETC -> 身份证 、车牌、姓名、手机号 >> 个人隐私

看是否对网站造成恶劣的影响

给网站干宕机