1 Title

Autoregressive Diffusion Model for Graph Generation(Lingkai Kong、Jiaming Cui、Haotian Sun、Yuchen Zhuang、B. Aditya Prakash、Chao Zhang)【PMLR 2022】

2 Conclusion

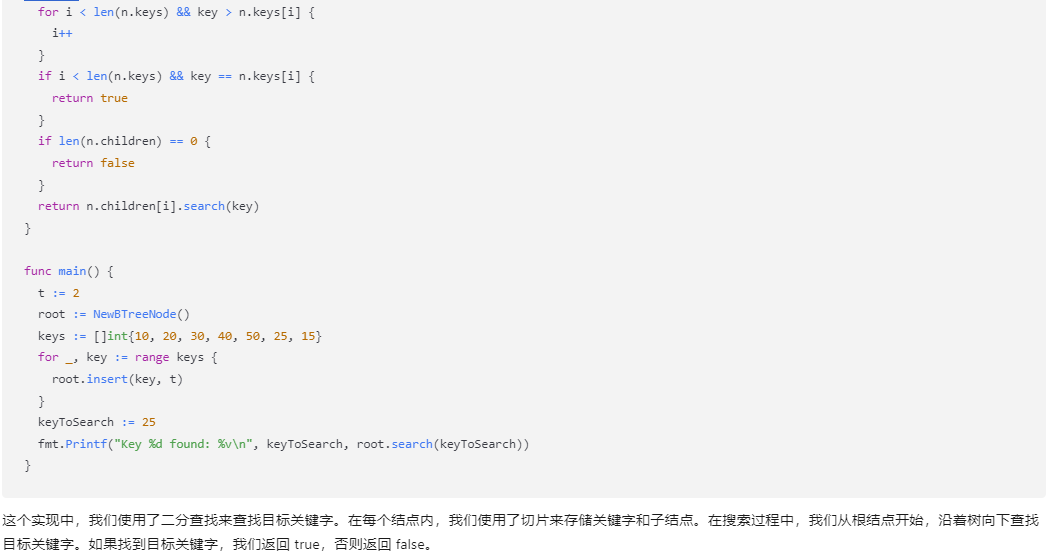

This study propose an autoregressive diffusion model for graph generation. Unlike existing methods, we define a node-absorbing diffusion process that operates directly in the discrete graph space. For forward diffusion, it designs a diffusion ordering network, which learns a datadependent node absorbing ordering from graph topology. For reverse generation, it designs a denoising network that uses the reverse node ordering to efficiently reconstruct the graph by predicting the node type of the new node and its edges with previously denoised nodes at a time.Based on the permutation invariance of graph, it shows that the two networks can be jointly trained by optimizing a simple lower bound of data likelihood.

3 Good Sentences

1、Diffusion-based graph generative models have recently obtained promising results for graph generation. However, existing diffusion-based graph generative models are mostly one-shot generative models that apply Gaussian diffusion in the dequantized adjacency matrix space. Such a strategy can suffer from difficulty in model training, slow sampling speed, and incapability of incorporating constraints.(The difficult problems of previous works has not solve.)

2、Diffusion models decompose the full complex transformation between noise and real data into man small steps of simple diffusion. Compared with prior deep generative models, diffusion models enjoy both flexibility in modeling architecture and tractability of the model’s probability distributions.(The advantages of Diffusion Model which used in graph generates)

3、While ARDM offers an efficient and general diffusion framework for discrete data, two key questions remain to be addressed for applying ARDM for graphs: (1) How do we define absorbing states for inter-dependent nodes and edges in graphs without losing the efficiency of ARDM? (2) While ARDM imposes a uniform ordering for arriving at an orderagnostic variational lower bound (VLB) of likelihood, a random ordering fails to capture graph topology(There are still two problems which needed to solve in ARDM)

4、Compared with the random diffusion ordering, our design has two benefits: (1) We can automatically learn a datadependent node generation ordering which leverages the graph structural information. (2) We can consider the diffusion ordering network as an optimized proposal distribution of importance sampling for computing the data likelihood,

which is more sample-efficient than a uniform proposal distribution.(The advantages of this method)

从目标分布生成图形是许多领域的基本问题,传统随机图模型方法用强大的深度生成模型拟合图形数据,包括变分自编码器(VAEs) 、生成对抗网络、归一化流(Madhawa等人,2019)和基于能量的模型(EBMs) ,这些模型捕获复杂的图结构模式,然后生成具有所需属性的新的高保真图。

与已有的深度生成模型相比,扩散模型既具有建模结构的灵活性,又具有模型概率分布的可追溯性。然而,现有的基于扩散的图生成模型有三个主要缺点:(1)Generation Efficiency。采样过程缓慢,因为需要很长的扩散过程才能达到平稳的噪声分布,因此反向生成过程也很耗时。(2) Incorporating constraints。它们都是一次性生成模型,因此在一次性生成过程中不容易合并约束。(3)Continuous Approximation。这会使得模型训练的难度加大。

在GRAPHARM中,本文为图设计了节点吸收自回归扩散算法,它直接将图扩散到离散图空间中,而不是在去量化的邻接矩阵空间中。前向传递通过屏蔽每个步骤中的一个节点及其连接边来吸收节点,重复此过程,直到所有用于图生成的自回归扩散模型节点被吸收,图变为空为止。除此以外,本文进一步在 GRAPHARM 中设计了一个扩散排序网络,该网络与反向生成器联合训练,以学习与数据相关的扩散节点排序。GRAPHARM 中的后向传递通过学习反向节点吸收扩散过程和去噪网络来恢复图结构。反向生成过程是自回归的,这使得 GRAPHARM 更容易处理生成过程中的约束条件。

如何学习反向节点排序分布以优化数据似然是一个关键挑战。本文的研究表明,只需使用精确的反向节点排序,并根据图形生成的置换不变性属性优化一个简单的似然下限,就能规避这一难题。利用似然下限,可以使用强化学习程序和梯度下降法联合训练去噪网络和扩散排序网络。

一些背景知识:

吸收离散扩散的定义:吸收扩散是在离散状态空间中定义的马尔可夫破坏过程,对于time steps:t,第i个维度中的元素都以独立概率α(t)衰变为吸收态(数据的一个维度或一旦数据进入吸收态,它就不会再对后续的扩散过程产生影响,相当于在这个维度上的信息已经被“吸收”或“丢失”了)吸收状态可以是文本的[MASK]标记或图像的灰度像素。扩散过程最终收敛到一个平稳分布,使所有元素都处于吸收态。利用分类分布学习吸收扩散的逆过程,生成原始数据。通常,衰减概率α(t)需要很小,扩散步长t需要很大才能获得良好的性能。

自回归扩散模型(ARDM):一种随机吸收过程,其中每一步恰好有一个维度衰减到吸收状态。这个过程重复进行,直到所有维度都被吸收。

这个定义的另一个描述是:首先采样一个队列σ,σ∈,

是一个从1到D的排列集合。然后,数据的每个维度都按照σ的顺序向吸收状态衰减,相应的生成过程然后以与排列完全相反的顺序对变量进行建模。ARDM相当于连续时间限制的吸收扩散

在本文中:两个节点之间没有边视为特定的边。

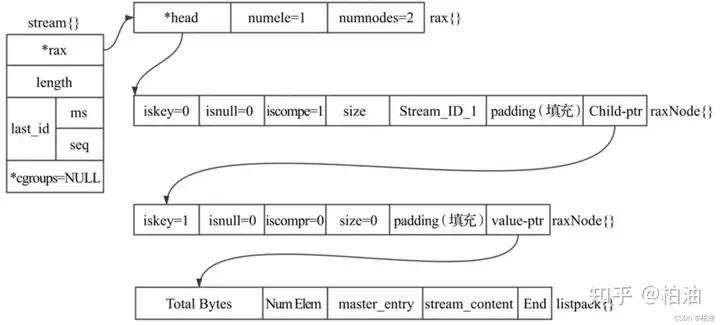

Autoregressive Graph Diffusion Process:当一个节点进入吸收状态时,会发生以下两个变化:

-

掩蔽(Masking): 该节点会被掩蔽,意味着在扩散过程中,该节点不再活跃,它的特征将不再对图中的其它节点产生影响。

-

连接所有其他节点(Connecting to All Other Nodes): 被掩蔽的节点会被连接到图中所有其他节点,这些连接通过掩蔽边(masked edges)表示。这样做的原因是在吸收状态下,我们不能确定被掩蔽节点的原始邻居节点,因此通过将它与所有其他节点连接,可以保持图中的连通性信息。

因此,图自回归扩散过程的定义如下:

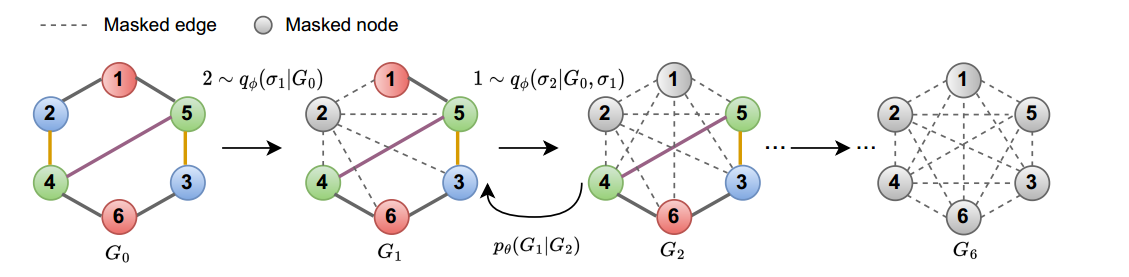

在自回归图扩散中,从扩散排序网络![]() 中采样节点衰减排序σ。然后,根据采样的扩散顺序,每次恰好有一个节点衰减到吸收状态。这个过程一直进行,直到所有的节点都被吸收。

中采样节点衰减排序σ。然后,根据采样的扩散顺序,每次恰好有一个节点衰减到吸收状态。这个过程一直进行,直到所有的节点都被吸收。

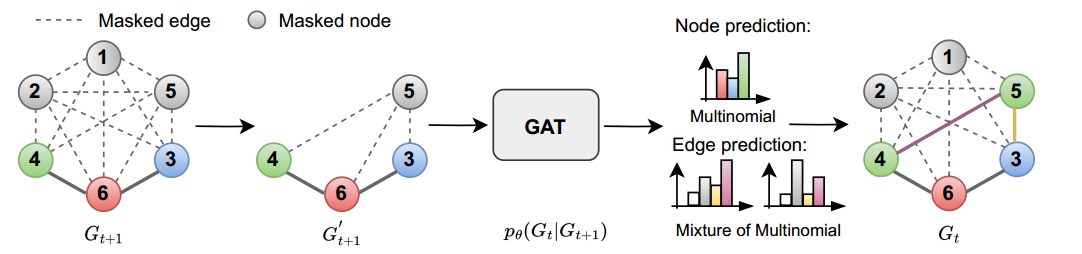

上图是自回归图扩散过程,正向传递中,节点自回归衰减到吸收状态,由扩散排序网络![]() 产生的排序决定顺序,在反向过程中,生成网络

产生的排序决定顺序,在反向过程中,生成网络![]() 使用反向节点排序重新生成图结构。因为扩散过程为

使用反向节点排序重新生成图结构。因为扩散过程为中的每个节点分配一个唯一的ID以获得衰减顺序,所以不需要考虑同自同构(具体来说就是,节点排列的置换不变性,这意味着无论节点如何重新排列,只要重新排列后的图在结构上与原始图相同,模型就能正确地生成图。)

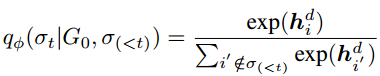

扩散排序网络遵循循环结构![]() ,这意味着每一步 t 的节点

,这意味着每一步 t 的节点 的分布不仅依赖于原始图

,还依赖于之前所有步骤

![]() 节点顺序。本文使用使用图神经网络(GNN)对图中的结构信息进行编码,为了捕获部分排序,本文将位置编码添加到节点特征中,将传递GNN后节点

节点顺序。本文使用使用图神经网络(GNN)对图中的结构信息进行编码,为了捕获部分排序,本文将位置编码添加到节点特征中,将传递GNN后节点的更新节点嵌入表示为

并参数化

![]() 为分类分布

为分类分布 。利用

。利用![]() ,grapharm就可以学习优化节点的扩散排序,不过这也需要我们推断反向传递中的反向生成顺序,这很难。

,grapharm就可以学习优化节点的扩散排序,不过这也需要我们推断反向传递中的反向生成顺序,这很难。

反向生成过程:一个去噪网络![]() 将按照与扩散过程相反的顺序对掩模图进行去噪。我们将

将按照与扩散过程相反的顺序对掩模图进行去噪。我们将![]() 设计为图注意网络(GAT),用θ参数化,使模型能够区分被屏蔽和未被屏蔽的边缘。

设计为图注意网络(GAT),用θ参数化,使模型能够区分被屏蔽和未被屏蔽的边缘。

在时刻t,去噪网络![]() 的输入是之前的掩模图

的输入是之前的掩模图,一种直接的方法是使用Gt+1,它包含了所有被屏蔽节点及其相应的被屏蔽边。然而,在最初的生成步骤中,图几乎与屏蔽边完全连接。这导致两个问题:(1)消息传递过程将由被屏蔽的边缘主导,这使得消息不具有信息性。(2)存储密集邻接矩阵占用大量内存,导致模型无法扩展到大型图。因此,在每个生成步骤中,本文只保留待去噪的被屏蔽节点及其相关的被屏蔽边,而忽略其他被屏蔽节点。

修改后的掩码图称为,如图所示

去噪网络首先使用一个嵌入层将每个节点编码为一个连续的嵌入空间,即

= embedding (

)。在第

条消息传递时,通过聚合来自相邻节点的关注消息来更新节点

的嵌入。

![]()

![]()

![]() ,其中其中W是权重矩阵,a是注意力向量。经过L轮消息传递后,最终得到每个节点的最终嵌入

,其中其中W是权重矩阵,a是注意力向量。经过L轮消息传递后,最终得到每个节点的最终嵌入,然后预测新节点

的节点类型以及

与所有先前去噪节点{

}之间的边缘类型。出于时间复杂度上的考虑,本文使用混合多项分布来预测新节点与所有先前节点的连接。混合分布可以捕获待生成边之间的依赖关系,同时将自回归生成步骤减少到O(n)。

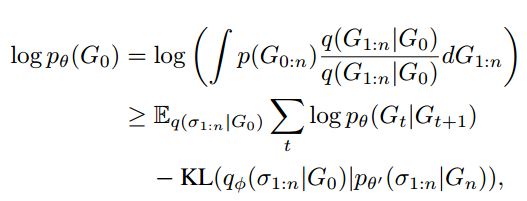

训练目标:使用近似最大似然作为grapharm的训练目标。首先推导似然的变分下界(VLB)为:

其中,表示t = 0,1,···,n时

的所有值,

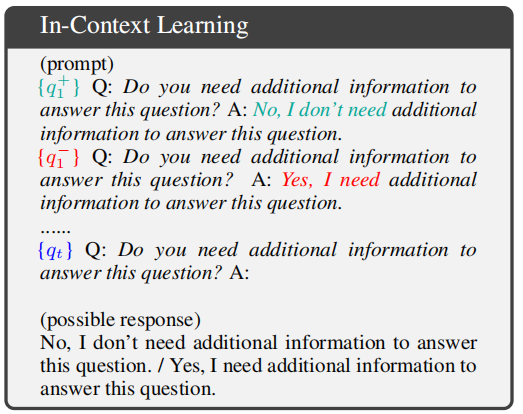

![]() 为生成排序的分布。从以上公式可以看出,扩散过程引入了一个单独的逆生成排序网络

为生成排序的分布。从以上公式可以看出,扩散过程引入了一个单独的逆生成排序网络![]() 。因为在中间学习过程中没有原始图

。因为在中间学习过程中没有原始图,所以

![]() 是一个非平凡任务,然而,在自回归扩散模型的标准变分下界(VLB)中,通常会包含一个KL散度项,用于衡量真实分布和近似分布之间的差异。作者提出,可以忽略这个KL散度项,简化模型的训练过程,从而避免或者非平凡任务。

是一个非平凡任务,然而,在自回归扩散模型的标准变分下界(VLB)中,通常会包含一个KL散度项,用于衡量真实分布和近似分布之间的差异。作者提出,可以忽略这个KL散度项,简化模型的训练过程,从而避免或者非平凡任务。

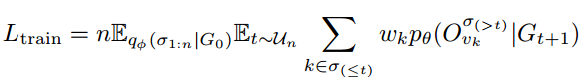

第一项将鼓励去噪网络![]() 以完全相反的扩散过程顺序预测节点和边缘类型,因此去噪网络本身可以作为生成顺序的代理。由于排列不变性,可以简单地在每个时间步用预测的节点和边类型替换任何被屏蔽节点及其被屏蔽边。因此,可以忽略第二项,最终得到一个简单的训练目标:

以完全相反的扩散过程顺序预测节点和边缘类型,因此去噪网络本身可以作为生成顺序的代理。由于排列不变性,可以简单地在每个时间步用预测的节点和边类型替换任何被屏蔽节点及其被屏蔽边。因此,可以忽略第二项,最终得到一个简单的训练目标:

其中,t被当作随机变量,且符合范围为0到n的均匀分布,

![]() 示

示的节点类型和它与所有先前去噪的节点的边,即

![]()

Soft Label Training : ARDM的架构同时预测所有被屏蔽的维度,这使得并行训练![]() 的单变量条件

的单变量条件![]() 成为可能。在grapharm中,由于图的节点排列不变性,这种并行训练可以简化为用扩散排序网络给出的概率加权的软标签训练:

成为可能。在grapharm中,由于图的节点排列不变性,这种并行训练可以简化为用扩散排序网络给出的概率加权的软标签训练: 其中,

其中,![]()

因此,通常只考虑那些与最高概率相关的节点标签就足够了

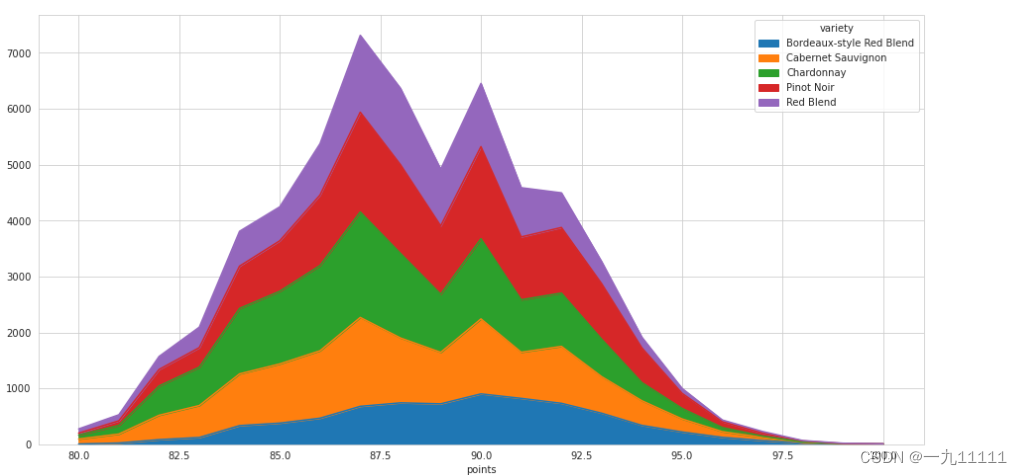

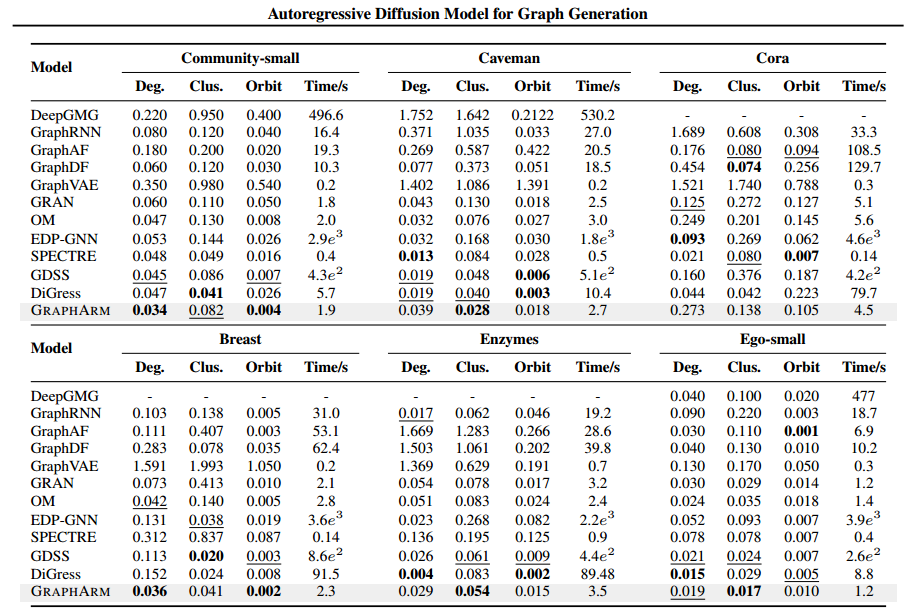

实验结果如图。