大家好啊,我是董董灿。

之前有小伙伴私信我,想了解下大模型比如 chatGPT 是如何进行训练的。

和他们聊了一下,发现有一个点一直困惑着大家,那就是:大模型的训练是无监督学习还是有监督学习?在大模型训练过程中,数据的标签是什么?如何计算损失然后进行反向传播的呢?

今天就和大家简单来聊一下这个问题。

1、是有监督还是无监督

事实上,很多自然语言处理(NLP)的模型,尤其是上文提到的大语言模型(如GPT系列),都是通过无监督学习或自监督学习的方式进行训练的。

也就是说它们不需要人工标注的标签来进行训练。

试想一下,训练 GPT 的数据样本大多来自于互联网,如果需要对这些数据进行标注的话,会花费大量的人力,并且很多长文本是没有办法或者很难去标注的。

因此这类模型的训练采用的基本是自监督学习的模式。

自监督学习可以认为是无监督学习的一种特殊方式。

模型通过从输入数据本身生成的伪标签来进行训练,这些伪标签不是由人工标注的,而是由模型根据一定的规则自动生成的。

常见的自监督学习任务模型有以下两种。

第一种是掩码语言模型(Masked Language Model, MLM),这是 BERT 等模型使用的一种训练方法。

它将其中一部分输入词进行随机掩码(替换为一个特殊的掩码符号),模型的任务就是是预测这些被掩码的词。

这样,模型就能学习到词与上下文之间的关系,有点类似于让模型不断进行完形填空的意思。

第二种是因果语言模型(Causal Language Model, CLM),这是 GPT 系列模型使用的一种训练方法。

在这种训练模式下,模型被训练来预测给定前文的下一个词,这样,模型就能学习到文本的顺序结构和语言的生成过程。

说到这你可能还不完全清楚,看下面的例子就明白了。

2、GPT 的训练过程

以因果语言模型的训练为例,假设给模型的输入数据是:The quick brown fox jumps over the lazy" 这句话。

当然实际训练时,输入给模型的数据还会经过 Tokenization、词嵌入和位置编码这些步骤,但是我们这里先绕过,不影响理解。

在 GPT 等模型的训练时,如果给定上述句子作为模型的输入,是希望模型可以预测出下一个词是什么,这是模型的任务。

因此,每给定一个单词(Token),模型都要预测下一个词,然后将预测出来的词加上原来已有的词作为新的输入,继续预测下一个词,如此反复迭代。

将训练过程写出伪代码是如下形式。

# 假设:# - input_tokens 是输入序列# - target_tokens 是目标序列# - transformer_model 是一个Transformer模型# - optimizer 是用于优化模型参数的优化器# - loss_function 是损失函数,例如交叉熵损失for epoch in range(num_epochs): # 迭代多个训练周期for input_tokens, target_tokens in data_loader:# 1. 模型输入# 将输入token转换为嵌入向量,进行词嵌入和位置编码input_embeddings = embedding_layer(input_tokens)position_embeddings = get_position_embeddings(input_embeddings)transformer_input = input_embeddings + position_embeddings# 2. Transformer模型# 通过Transformer模型得到输出transformer_output = transformer_model(transformer_input)# 3. 模型输出和损失计算# 将Transformer输出转换为logitslogits = output_layer(transformer_output)loss = loss_function(logits, target_tokens) # 计算损失# 4. 梯度下降和反向传播optimizer.zero_grad() # 清除之前的梯度loss.backward() # 反向传播,计算梯度optimizer.step() # 更新模型参数

上面的 input_tokens 就可以认为是输入的一句话。

可以看到在计算损失的时候,比较的是模型的输出和 target_tokens 的损失。

模型的输出我们好理解,就是模型预测的下一个词,那么target_tokens 是什么呢?

上面说到自监督学习的时候,说到一句话:“自监督学习中的伪标签是模型通过一定的规则生成的”。

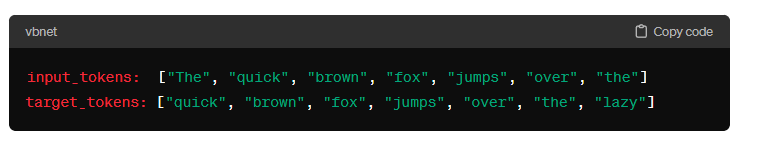

target_tokens 就是伪标签,因为模型需要预测下一个词,因此“一定的规则”就是对输入 token 往后移一位来实现的,如下所示。

input_tokens 是原始句子中的单词序列,而 target_tokens 是这个序列向右移动一个位置的结果。

在训练过程中,模型会试图根据 input_tokens 中的每个词来预测 target_tokens 中的下一个词。

例如,给定输入 "The",模型应该预测输出 "quick";然后将 "The" 和 "quick "合成新的输入 "The quick" 给模型,模型应该预测出 "brown",以此类推。

这样经过大量甚至是海量的文本数据的自监督学习,模型就可以学到很多自然语言的结构和句式了。

大语言模型也就训练完成了。

当然上面的过程说的很粗糙,仅仅是想让大家先搞清楚自监督学习这个概念,以及实际模型训练时,模型是如何自我监督的。

关于 token 的详细理解,可以参考这篇文章:5分钟了解什么是 token。