《从菜鸟到大师之路 ElasticSearch 篇》

(一):ElasticSearch 基础概念、生态和应用场景

为什么需要学习 ElasticSearch

根据 DB Engine 的排名显示, ElasticSearch 是最受欢迎的 企业级搜索引擎 。下图红色勾选的是我们前面的系列详解的,除此之外你可以看到搜索库ElasticSearch在前十名内:

所以为什么要学习 ElasticSearch 呢?

1、在当前软件行业中,搜索是一个软件系统或平台的基本功能, 学习ElasticSearch就可以为相应的软件打造出良好的搜索体验。

2、其次,ElasticSearch具备非常强的大数据分析能力。虽然Hadoop也可以做大数据分析,但是ElasticSearch的分析能力非常高,具备Hadoop不具备的能力。比如有时候用Hadoop分析一个结果,可能等待的时间比较长。

3、ElasticSearch可以很方便的进行使用,可以将其安装在个人的笔记本电脑,也可以在生产环境中,将其进行水平扩展。

4、国内比较大的互联网公司都在使用,比如小米、滴滴、携程等公司。另外,在腾讯云、阿里云的云平台上,也都有相应的ElasticSearch云产品可以使用。

5、在当今大数据时代,掌握近实时的搜索和分析能力,才能掌握核心竞争力,洞见未来。

什么是ElasticSearch

ElasticSearch是一款非常强大的、基于Lucene的开源搜索及分析引擎;它是一个实时的分布式搜索分析引擎,它能让你以前所未有的速度和规模,去探索你的数据。

它被用作全文检索、结构化搜索、分析以及这三个功能的组合:

-

Wikipedia_使用 Elasticsearch 提供带有高亮片段的全文搜索,还有 search-as-you-type 和 did-you-mean 的建议。

-

卫报使用 Elasticsearch 将网络社交数据结合到访客日志中,为它的编辑们提供公众对于新文章的实时反馈。

-

Stack Overflow_将地理位置查询融入全文检索中去,并且使用 more-like-this 接口去查找相关的问题和回答。

-

GitHub_使用 Elasticsearch 对1300亿行代码进行查询。

-

…

除了搜索,结合Kibana、Logstash、Beats开源产品,Elastic Stack(简称ELK)还被广泛运用在大数据近实时分析领域,包括: 日志分析、指标监控、信息安全 等。它可以帮助你 探索海量结构化、非结构化数据,按需创建可视化报表,对监控数据设置报警阈值,通过使用机器学习,自动识别异常状况。

ElasticSearch是基于Restful WebApi,使用Java语言开发的搜索引擎库类,并作为Apache许可条款下的开放源码发布,是当前流行的企业级搜索引擎。其客户端在Java、C#、PHP、Python等许多语言中都是可用的。

所以,ElasticSearch具备两个优势:

-

天生支持分布式,可水平扩展;

-

提供了Restful接口,降低全文检索的学习曲线,因为Restful接口,所以可以被任何编程语言调用;

ElasticSearch的由来

ElasticSearch背后的小故事。

许多年前,一个刚结婚的名叫 Shay Banon 的失业开发者,跟着他的妻子去了伦敦,他的妻子在那里学习厨师。在寻找一个赚钱的工作的时候,为了给他的妻子做一个食谱搜索引擎,他开始使用 Lucene 的一个早期版本。

直接使用 Lucene 是很难的,因此 Shay 开始做一个抽象层,Java 开发者使用它可以很简单的给他们的程序添加搜索功能。他发布了他的第一个开源项目 Compass。

后来 Shay 获得了一份工作,主要是高性能,分布式环境下的内存数据网格。这个对于高性能,实时,分布式搜索引擎的需求尤为突出, 他决定重写 Compass,把它变为一个独立的服务并取名 Elasticsearch。

第一个公开版本在2010年2月发布,从此以后,Elasticsearch 已经成为了 Github 上最活跃的项目之一,他拥有超过300名 contributors(目前736名 contributors )。一家公司已经开始围绕 Elasticsearch 提供商业服务,并开发新的特性,但是,Elasticsearch 将永远开源并对所有人可用。

据说,Shay 的妻子还在等着她的食谱搜索引擎…。

为什么不是直接使用Lucene

ElasticSearch是基于Lucene的,那么为什么不是直接使用Lucene呢?

Lucene 可以说是当下最先进、高性能、全功能的搜索引擎库。

但是 Lucene 仅仅只是一个库。为了充分发挥其功能,你需要使用 Java 并将 Lucene 直接集成到应用程序中。更糟糕的是,您可能需要获得信息检索学位才能了解其工作原理。Lucene 非常 复杂。

Elasticsearch 也是使用 Java 编写的,它的内部使用 Lucene 做索引与搜索,但是它的目的是使全文检索变得简单,通过隐藏 Lucene 的复杂性,取而代之的提供一套简单一致的 RESTful API。

然而,Elasticsearch 不仅仅是 Lucene,并且也不仅仅只是一个全文搜索引擎。它可以被下面这样准确的形容:

-

一个分布式的实时文档存储,每个字段 可以被索引与搜索

-

一个分布式实时分析搜索引擎

-

能胜任上百个服务节点的扩展,并支持 PB 级别的结构化或者非结构化数据

ElasticSearch的主要功能及应用场景

我们在哪些场景下可以使用ES呢?

主要功能

-

1)海量数据的分布式存储以及集群管理,达到了服务与数据的高可用以及水平扩展;

-

2)近实时搜索,性能卓越。对结构化、全文、地理位置等类型数据的处理;

-

3)海量数据的近实时分析(聚合功能)

应用场景

-

1)网站搜索、垂直搜索、代码搜索;

-

2)日志管理与分析、安全指标监控、应用性能监控、Web抓取舆情分析;

ElasticSearch的基础概念

我们还需对比结构化数据库,看看ES的基础概念,为我们后面学习作铺垫。

-

Near Realtime(NRT) 近实时。数据提交索引后,立马就可以搜索到。

-

Cluster 集群,一个集群由一个唯一的名字标识,默认为“elasticsearch”。集群名称非常重要,具有相同集群名的节点才会组成一个集群。集群名称可以在配置文件中指定。

-

Node 节点:存储集群的数据,参与集群的索引和搜索功能。像集群有名字,节点也有自己的名称,默认在启动时会以一个随机的UUID的前七个字符作为节点的名字,你可以为其指定任意的名字。通过集群名在网络中发现同伴组成集群。一个节点也可是集群。

-

Index 索引: 一个索引是一个文档的集合(等同于solr中的集合)。每个索引有唯一的名字,通过这个名字来操作它。一个集群中可以有任意多个索引。

-

Type 类型:指在一个索引中,可以索引不同类型的文档,如用户数据、博客数据。从6.0.0 版本起已废弃,一个索引中只存放一类数据。

-

Document 文档:被索引的一条数据,索引的基本信息单元,以JSON格式来表示。

-

Shard 分片:在创建一个索引时可以指定分成多少个分片来存储。每个分片本身也是一个功能完善且独立的“索引”,可以被放置在集群的任意节点上。

-

Replication 备份: 一个分片可以有多个备份(副本)

为了方便理解,作一个ES和数据库的对比

文档

ElasticSearch是面向文档的,文档是所有可搜索数据的最小单位。例如:

-

日志文件中的日志项;

-

一张唱片的详细信息;

-

一篇文章中的具体内容;

在ElasticSearch中,文档会被序列化成Json格式:

-

Json对象是由字段组成的;

-

每个字段都有对应的字段类型(如:字符串、数值、日期类型等);

每个文档都有一个唯一的ID(Unique ID)

-

可以自己指定此ID;

-

也可以通过ElasticSearch自动生成;

我们可以将文档理解成关系型数据库中的一条数据记录,一条记录包含了一系列的字段。

Json文档的格式不需要预先定义

-

字段的类型可以指定或者由ElasticSearch自动推算;

-

Json支持数组、支持嵌套;

每一个文档中都包含有一份元数据,元数据的作用主要是用来标注文档的相关信息,如:

-

_index:文档所属的索引名; -

_type:文档所属的类型名(从7.0开始,每一个索引只能创建一个Type:_doc,在此之前一个索引是可以设置多个Type的); -

_id:文档的Unqie Id; -

_source:文档的原始Json数据; -

_version:文档的版本信息; -

_score:文档的相关性算分;

索引(Index)

索引指的就是一类文档的集合,相当于文档的容器。

-

索引体现了逻辑空间的概念,每个索引都有自己的Mapping定义,用来定义所包含的文档的字段名和字段类型;

-

索引中的数据(文档)分散在Shard(分片)上,Shard体现了物理空间的概念;

索引的Mapping与Setting

Mapping定义文档字段的类型;

Setting定义不同的数据分布;

索引的含义

一般说“索引文档到ElasticSearch的索引中”,前面的索引指的是一个动词的含义,也就是保存一个文档到ElasticSearch中。后面的索引是指在ElasticSearch集群中,可以创建很多个不同的索引;

索引分为:B树索引和倒排索引,而倒排索引在ElasticSearch中是非常重要的;

ElasticSearch与RDBMS的代入理解与类比如下

两者相对比,若对数据进行全文检索,以及进行算分时,ElasticSearch更加合适;当涉及的数据事务比较高时,那RDBMS更加合适。在实际生产中,一般是两者进行结合使用。

集群

ElasticSearch集群实际上是一个分布式系统,而分布式系统需要具备两个特性:

-

高可用性

-

服务可用性:允许有节点停止服务;

-

数据可用性:部分节点丢失,不会丢失数据;

-

可扩展性

-

随着请求量的不断提升,数据量的不断增长,系统可以将数据分布到其他节点,实现水平扩展;

ElasticSearch的集群通过不同的名字来进行区分,默认名字“elasticsearch”;可以通过配置文件修改或者命令行修改:-E cluster.name=test一个集群中可以有一个或者多个节点。

节点

节点是什么?

-

节点是一个ElasticSearch的实例,其本质就是一个Java进程;

-

一台机器上可以运行多个ElasticSearch实例,但是建议在生产环境中一台机器上只运行一个ElasticSearch实例;

每个节点都有名字,可以通过配置文件进行配置,也可以通过命令行进行指定,如:-E node.name=node1

每个节点在启动之后,会被分配一个UID,保存在data目录下;

Master-Eligible【有资格、胜任者】 Node与Master Node的说明:

-

每个节点启动之后,默认就是一个Master Eligible节点,当然可以在配置文件中将其禁止,node.master:false

-

Master-Eligible Node可以参加选主流程,成为Master Node;

-

当第一个节点启动时,它会将其选举为Master Node;

-

每个节点都保存了集群状态,但只有Master Node才能修改集群的状态,包括如下:

-

所有的节点信息;

-

所有的索引和其相关的Mapping与Setting信息;

-

分片的路由信息;

Data Node与Coordinating【协调、整合】 Node的说明:

-

Data Node:可以保存数据的节点,负责保存分片数据,在数据扩展上起到至关重要的作用;

-

Coordinating Node:它通过接受Rest Client的请求,会将请求分发到合适的节点,最终将结果汇集到一起,再返回给Client;

-

每个节点都默认起到Coordinating Node的职责;

Hot Node(热节点)与Warm Node(冷节点)的说明:

-

Hot Node:有更好配置的节点,其有更好的资源配置,如磁盘吞吐、CPU速度;

-

Warm Node:资源配置较低的节点;

Machine Learning Node:负责机器学习的节点,常用来做异常检测;

配置节点类型

- 每个节点在启动时,会读取elasticsearch.yml配置文件,来确定当前节点扮演什么角色。在生产环境中,应该将节点设置为单一的角色节点,这样可以有更好的性能,更清晰的职责,可以针对节点的不同给予不能的机器配置。

分片

Primary Shard(主分片)

可以解决数据水平扩展的问题,通过主分片,可以将数据分布到集群内的所有节点之上。

一个主分片是一个运行的Lucene的实例;

注意:

-

一个节点对应一个ES实例;

-

一个节点可以有多个index(索引);

-

一个index可以有多个shard(分片);

-

一个分片是一个lucene index(此处的index是lucene自己的概念,与ES的index不是一回事);

主分片数是在索引创建时指定,后续不允许修改,除非Reindex;

Replica Shard(副本)

可以解决数据高可用的问题,它是主分片的拷贝。

-

副本分片数可以动态调整;

-

增加副本数,在一定程度上可以提高服务的可用性;

分片的设定

对于生产环境中分片的设定,需要提前做好容量规划,因为主分片数是在索引创建时预先设定的,后续无法修改。

-

分片数设置过小

-

导致后续无法增加节点进行水平扩展。

-

导致分片的数据量太大,数据在重新分配时耗时;

-

分片数设置过大

-

影响搜索结果的相关性打分,影响统计结果的准确性;

-

单个节点上过多的分片,会导致资源浪费,同时也会影响性能;

学习ElasticSearch的入手层面

开发层面

-

了解ElasticSearch有基本功能;

-

底层分布式工作原理;

-

针对数据进行数据建模;

运维层面

-

进行集群的容量规划;

-

对集群进行滚动升级;

-

对性能的优化;

-

出现问题后,对问题的诊断与解决;

方案层面

-

学习ElasticSearch后,可以针对实际情况,解决搜索的相关问题;

-

可以将ELK运用到大数据分析场景中;

Elastic Stack生态

Beats + Logstash + ElasticSearch + Kibana

如下是我从官方博客中找到图,这张图展示了ELK生态以及基于ELK的场景(最上方)。

由于Elastic X-Pack是面向收费的,所以我们不妨也把X-Pack放进去,看看哪些是由X-Pack带来的,在阅读官网文档时将方便你甄别重点:

Beats

Beats是一个面向轻量型采集器的平台,这些采集器可以从边缘机器向Logstash、ElasticSearch发送数据,它是由Go语言进行开发的,运行效率方面比较快。从下图中可以看出,不同Beats的套件是针对不同的数据源。

Logstash

Logstash是动态数据收集管道,拥有可扩展的插件生态系统,支持从不同来源采集数据,转换数据,并将数据发送到不同的存储库中。其能够与ElasticSearch产生强大的协同作用,后被Elastic公司在2013年收购。

它具有如下特性:

-

1)实时解析和转换数据;

-

2)可扩展,具有200多个插件;

-

3)可靠性、安全性。Logstash会通过持久化队列来保证至少将运行中的事件送达一次,同时将数据进行传输加密;

-

4)监控;

ElasticSearch

ElasticSearch对数据进行搜索、分析和存储,其是基于JSON的分布式搜索和分析引擎,专门为实现水平可扩展性、高可靠性和管理便捷性而设计的。

它的实现原理主要分为以下几个步骤:

-

1)首先用户将数据提交到ElasticSearch数据库中;

-

2)再通过分词控制器将对应的语句分词;

-

3)将分词结果及其权重一并存入,以备用户在搜索数据时,根据权重将结果排名和打分,将返回结果呈现给用户;

ElasticSearch与DB的集成

针对上图,可以分为两种情况:

-

将ElasticSearch当成数据库来存储数据,好处是架构比较简单;

-

若数据更新比较频繁,同时需要考虑数据事务性时,应该先将数据存入数据库,然后建立一个合适的同步机制,将数据同步到ElasticSearch中;

Kibana

Kibana实现数据可视化,其作用就是在ElasticSearch中进行民航。Kibana能够以图表的形式呈现数据,并且具有可扩展的用户界面,可以全方位的配置和管理ElasticSearch。

Kibana最早的时候是基于Logstash创建的工具,后被Elastic公司在2013年收购。

-

1)Kibana可以提供各种可视化的图表;

-

2)可以通过机器学习的技术,对异常情况进行检测,用于提前发现可疑问题;

从日志收集系统看 ES Stack的发展

我们看下ELK技术栈的演化,通常体现在日志收集系统中。

一个典型的日志系统包括:

-

收集:能够采集多种来源的日志数据

-

传输:能够稳定的把日志数据解析过滤并传输到存储系统

-

存储:存储日志数据

-

分析:支持 UI 分析

-

警告:能够提供错误报告,监控机制

beats+elasticsearch+kibana

Beats采集数据后,存储在ES中,有Kibana可视化的展示。

beats+logstath+elasticsearch+kibana

该框架是在上面的框架的基础上引入了logstash,引入logstash带来的好处如下:

-

(1)Logstash具有基于磁盘的自适应缓冲系统,该系统将吸收传入的吞吐量,从而减轻背压。

-

(2)从其他数据源(例如数据库,S3或消息传递队列)中提取。

-

(3)将数据发送到多个目的地,例如S3,HDFS或写入文件。

-

(4)使用条件数据流逻辑组成更复杂的处理管道。

beats结合logstash带来的优势:

-

(1)水平可扩展性,高可用性和可变负载处理:beats和logstash可以实现节点之间的负载均衡,多个logstash可以实现logstash的高可用

-

(2)消息持久性与至少一次交付保证:使用beats或Winlogbeat进行日志收集时,可以保证至少一次交付。从Filebeat或Winlogbeat到Logstash以及从Logstash到Elasticsearch的两种通信协议都是同步的,并且支持确认。Logstash持久队列提供跨节点故障的保护。对于Logstash中的磁盘级弹性,确保磁盘冗余非常重要。

-

(3)具有身份验证和有线加密的端到端安全传输:从Beats到Logstash以及从 Logstash到Elasticsearch的传输都可以使用加密方式传递 。与Elasticsearch进行通讯时,有很多安全选项,包括基本身份验证,TLS,PKI,LDAP,AD和其他自定义领域

增加更多的数据源 比如:TCP,UDP和HTTP协议是将数据输入Logstash的常用方法。

beats+MQ+logstash+elasticsearch+kibana

在如上的基础上我们可以在beats和logstash中间添加一些组件redis、kafka、RabbitMQ等,添加中间件将会有如下好处:

-

(1)降低对日志所在机器的影响,这些机器上一般都部署着反向代理或应用服务,本身负载就很重了,所以尽可能的在这些机器上少做事;

-

(2)如果有很多台机器需要做日志收集,那么让每台机器都向Elasticsearch持续写入数据,必然会对Elasticsearch造成压力,因此需要对数据进行缓冲,同时,这样的缓冲也可以一定程度的保护数据不丢失;

-

(3)将日志数据的格式化与处理放到Indexer中统一做,可以在一处修改代码、部署,避免需要到多台机器上去修改配置;

Elastic Stack最佳实践

我们再看下官方开发成员分享的最佳实践。

日志收集系统

基本的日志系统

增加数据源,和使用MQ

Metric收集和APM性能监控

多数据中心方案

通过冗余实现数据高可用

两个数据采集中心(比如采集两个工厂的数据),采集数据后的汇聚

数据分散,跨集群的搜索

来源:

https://www.pdai.tech/md/db/nosql-es/elasticsearch-x-introduce-2.html

(二):ElasticSearch 技术原理图解

图解 ElasticSearch

- 云上的集群

- 集群里的盒子

云里面的每个白色正方形的盒子代表一个节点——Node。

- 节点之间

在一个或者多个节点直接,多个绿色小方块组合在一起形成一个 ElasticSearch 的索引。

- 索引里的小方块

在一个索引下,分布在多个节点里的绿色小方块称为分片——Shard。

- Shard=Lucene Index

一个ElasticSearch的Shard本质上是一个Lucene Index。

Lucene是一个Full Text 搜索库(也有很多其他形式的搜索库),ElasticSearch是建立在Lucene之上的。接下来的故事要说的大部分内容实际上是ElasticSearch如何基于Lucene工作的。

图解 Lucene

Segment

- Mini索引——segment

在Lucene里面有很多小的segment,我们可以把它们看成Lucene内部的mini-index。

-

Segment内部(有着许多数据结构)

-

Inverted Index

-

Stored Fields

-

Document Values

-

Cache

Inverted Index

最最重要的Inverted Index

Inverted Index主要包括两部分:

-

一个有序的数据字典Dictionary(包括单词Term和它出现的频率)。

-

与单词Term对应的Postings(即存在这个单词的文件)。

当我们搜索的时候,首先将搜索的内容分解,然后在字典里找到对应Term,从而查找到与搜索相关的文件内容。

- 查询“the fury”

- 自动补全(AutoCompletion-Prefix)

如果想要查找以字母“c”开头的字母,可以简单的通过二分查找(Binary Search)在Inverted Index表中找到例如“choice”、“coming”这样的词(Term)。

- 昂贵的查找

如果想要查找所有包含“our”字母的单词,那么系统会扫描整个Inverted Index,这是非常昂贵的。

在此种情况下,如果想要做优化,那么我们面对的问题是如何生成合适的Term。

- 问题的转化

对于以上诸如此类的问题,我们可能会有几种可行的解决方案:

1.* suffix -> xiffus *如果我们想以后缀作为搜索条件,可以为Term做反向处理。

2.(60.6384, 6.5017) -> u4u8gyykk

对于GEO位置信息,可以将它转换为GEO Hash。

3.123 -> {1-hundreds, 12-tens, 123}

对于简单的数字,可以为它生成多重形式的Term。

- 解决拼写错误

一个Python库为单词生成了一个包含错误拼写信息的树形状态机,解决拼写错误的问题。

Stored Field字段查找

当我们想要查找包含某个特定标题内容的文件时,Inverted Index就不能很好的解决这个问题,所以Lucene提供了另外一种数据结构Stored Fields来解决这个问题。本质上,Stored Fields是一个简单的键值对key-value。默

Document Values 为了排序,聚合

即使这样,我们发现以上结构仍然无法解决诸如:排序、聚合、facet,因为我们可能会要读取大量不需要的信息。

所以,另一种数据结构解决了此种问题:Document Values。这种结构本质上就是一个列式的存储,它高度优化了具有相同类型的数据的存储结构。

为了提高效率,ElasticSearch可以将索引下某一个Document Value全部读取到内存中进行操作,这大大提升访问速度,但是也同时会消耗掉大量的内存空间。

总之,这些数据结构Inverted Index、Stored Fields、Document Values及其缓存,都在segment内部。

搜索发生时

搜索时,Lucene会搜索所有的segment然后将每个segment的搜索结果返回,最后合并呈现给客户。

Lucene的一些特性使得这个过程非常重要:

-

Segments是不可变的(immutable)

-

Delete? 当删除发生时,Lucene做的只是将其标志位置为删除,但是文件还是会在它原来的地方,不会发生改变

-

Update? 所以对于更新来说,本质上它做的工作是:先删除,然后重新索引(Re-index)

-

随处可见的压缩

-

Lucene非常擅长压缩数据,基本上所有教科书上的压缩方式,都能在Lucene中找到。

-

缓存所有的所有

-

Lucene也会将所有的信息做缓存,这大大提高了它的查询效率。

缓存的故事

当ElasticSearch索引一个文件的时候,会为文件建立相应的缓存,并且会定期(每秒)刷新这些数据,然后这些文件就可以被搜索到。

随着时间的增加,我们会有很多segments,

所以ElasticSearch会将这些segment合并,在这个过程中,segment会最终被删除掉

这就是为什么增加文件可能会使索引所占空间变小,它会引起merge,从而可能会有更多的压缩。

- 举个栗子

有两个segment将会merge

这两个segment最终会被删除,然后合并成一个新的segment

这时这个新的segment在缓存中处于cold状态,但是大多数segment仍然保持不变,处于warm状态。

以上场景经常在Lucene Index内部发生的。

在Shard中搜索

ElasticSearch从Shard中搜索的过程与Lucene Segment中搜索的过程类似。

与在Lucene Segment中搜索不同的是,Shard可能是分布在不同Node上的,所以在搜索与返回结果时,所有的信息都会通过网络传输。

需要注意的是:1次搜索查找2个shard = 2次分别搜索shard

- 对于日志文件的处理

当我们想搜索特定日期产生的日志时,通过根据时间戳对日志文件进行分块与索引,会极大提高搜索效率。

当我们想要删除旧的数据时也非常方便,只需删除老的索引即可。

在上种情况下,每个index有两个shards

- 如何Scale

shard不会进行更进一步的拆分,但是shard可能会被转移到不同节点上

所以,如果当集群节点压力增长到一定的程度,我们可能会考虑增加新的节点,这就会要求我们对所有数据进行重新索引,这是我们不太希望看到的,所以我们需要在规划的时候就考虑清楚,如何去平衡足够多的节点与不足节点之间的关系。

-

节点分配与Shard优化

-

为更重要的数据索引节点,分配性能更好的机器

-

确保每个shard都有副本信息replica

- 路由Routing

每个节点,每个都存留一份路由表,所以当请求到任何一个节点时,ElasticSearch都有能力将请求转发到期望节点的shard进一步处理。

ElasticSearch整体结构

通过上文,在通过图解了解了ES整体的原理后,我们梳理下ES的整体结构

-

一个 ES Index 在集群模式下,有多个 Node (节点)组成。每个节点就是 ES 的Instance (实例)。

-

每个节点上会有多个 shard (分片), P1 P2 是主分片, R1 R2 是副本分片

-

每个分片上对应着就是一个 Lucene Index(底层索引文件)

-

Lucene Index 是一个统称

-

由多个 Segment (段文件,就是倒排索引)组成。每个段文件存储着就是 Doc 文档。

-

commit point记录了所有 segments 的信息

Lucene索引结构

上图中Lucene的索引结构中有哪些文件呢?

文件的关系如下:

Lucene处理流程

上文图解过程,还需要理解Lucene处理流程, 这将帮助你更好的索引文档和搜索文档。

创建索引的过程:

-

准备待索引的原文档,数据来源可能是文件、数据库或网络

-

对文档的内容进行分词组件处理,形成一系列的Term

-

索引组件对文档和Term处理,形成字典和倒排表

搜索索引的过程:

-

对查询语句进行分词处理,形成一系列Term

-

根据倒排索引表查找出包含Term的文档,并进行合并形成符合结果的文档集

-

比对查询语句与各个文档相关性得分,并按照得分高低返回

ElasticSearch分析器

上图中很重要的一项是语法分析/语言处理, 所以我们还需要补充ElasticSearch分析器知识点。

分析 包含下面的过程:

-

首先,将一块文本分成适合于倒排索引的独立的 词条 ,

-

之后,将这些词条统一化为标准格式以提高它们的“可搜索性”,或者 recall

分析器执行上面的工作。分析器实际上是将三个功能封装到了一个包里:

-

字符过滤器 首先,字符串按顺序通过每个

字符过滤器。他们的任务是在分词前整理字符串。一个字符过滤器可以用来去掉HTML,或者将 & 转化成 and。 -

分词器 其次,字符串被

分词器分为单个的词条。一个简单的分词器遇到空格和标点的时候,可能会将文本拆分成词条。 -

Token 过滤器 最后,词条按顺序通过每个 token 过滤器 。这个过程可能会改变词条(例如,小写化 Quick ),删除词条(例如, 像 a, and, the 等无用词),或者增加词条(例如,像 jump 和 leap 这种同义词)。

Elasticsearch提供了开箱即用的字符过滤器、分词器和token 过滤器。这些可以组合起来形成自定义的分析器以用于不同的目的。

内置分析器

Elasticsearch还附带了可以直接使用的预包装的分析器。接下来我们会列出最重要的分析器。为了证明它们的差异,我们看看每个分析器会从下面的字符串得到哪些词条:

"Set the shape to semi-transparent by calling set_trans(5)"

- 标准分析器

标准分析器是Elasticsearch默认使用的分析器。它是分析各种语言文本最常用的选择。它根据 Unicode 联盟 定义的 单词边界 划分文本。删除绝大部分标点。最后,将词条小写。它会产生。

set, the, shape, to, semi, transparent, by, calling, set_trans, 5

- 简单分析器

简单分析器在任何不是字母的地方分隔文本,将词条小写。它会产生

set, the, shape, to, semi, transparent, by, calling, set, trans

- 空格分析器

空格分析器在空格的地方划分文本。它会产生

Set, the, shape, to, semi-transparent, by, calling, set_trans(5)

- 语言分析器

特定语言分析器可用于很多语言。它们可以考虑指定语言的特点。例如,英语 分析器附带了一组英语无用词(常用单词,例如 and 或者 the ,它们对相关性没有多少影响),它们会被删除。由于理解英语语法的规则,这个分词器可以提取英语单词的词干 。

英语 分词器会产生下面的词条:

set, shape, semi, transpar, call, set_tran, 5

注意看 transparent、 calling 和 set_trans 已经变为词根格式。

什么时候使用分析器

当我们索引一个文档,它的全文域被分析成词条以用来创建倒排索引。但是,当我们在全文域搜索的时候,我们需要将查询字符串通过相同的分析过程,以保证我们搜索的词条格式与索引中的词条格式一致。

全文查询,理解每个域是如何定义的,因此它们可以做正确的事:

-

当你查询一个

全文域时, 会对查询字符串应用相同的分析器,以产生正确的搜索词条列表。 -

当你查询一个

精确值域时,不会分析查询字符串,而是搜索你指定的精确值。

举个例子

ES中每天一条数据, 按照如下方式查询:

GET /_search?q=2014 # 12 results

GET /_search?q=2014-09-15 # 12 results !

GET /_search?q=date:2014-09-15 # 1 result

GET /_search?q=date:2014 # 0 results !

为什么返回那样的结果?

-

date 域包含一个精确值:单独的词条 2014-09-15。

-

_all 域是一个全文域,所以分词进程将日期转化为三个词条:2014, 09, 和 15。

当我们在_all域查询 2014,它匹配所有的12条推文,因为它们都含有 2014 :

GET /_search?q=2014 # 12 results

当我们在_all域查询 2014-09-15,它首先分析查询字符串,产生匹配 2014,09, 或 15 中任意词条的查询。这也会匹配所有12条推文,因为它们都含有 2014 :

GET /_search?q=2014-09-15 # 12 results !

当我们在 date 域查询 2014-09-15,它寻找精确日期,只找到一个推文:

GET /_search?q=date:2014-09-15 # 1 result

当我们在 date 域查询 2014,它找不到任何文档,因为没有文档含有这个精确日志:

GET /_search?q=date:2014 # 0 results !

来源:

https://www.pdai.tech/md/db/nosql-es/elasticsearch-y-th-2.html

(三):ElasticSearch 安装与基础使用

安装 ElasticSearch

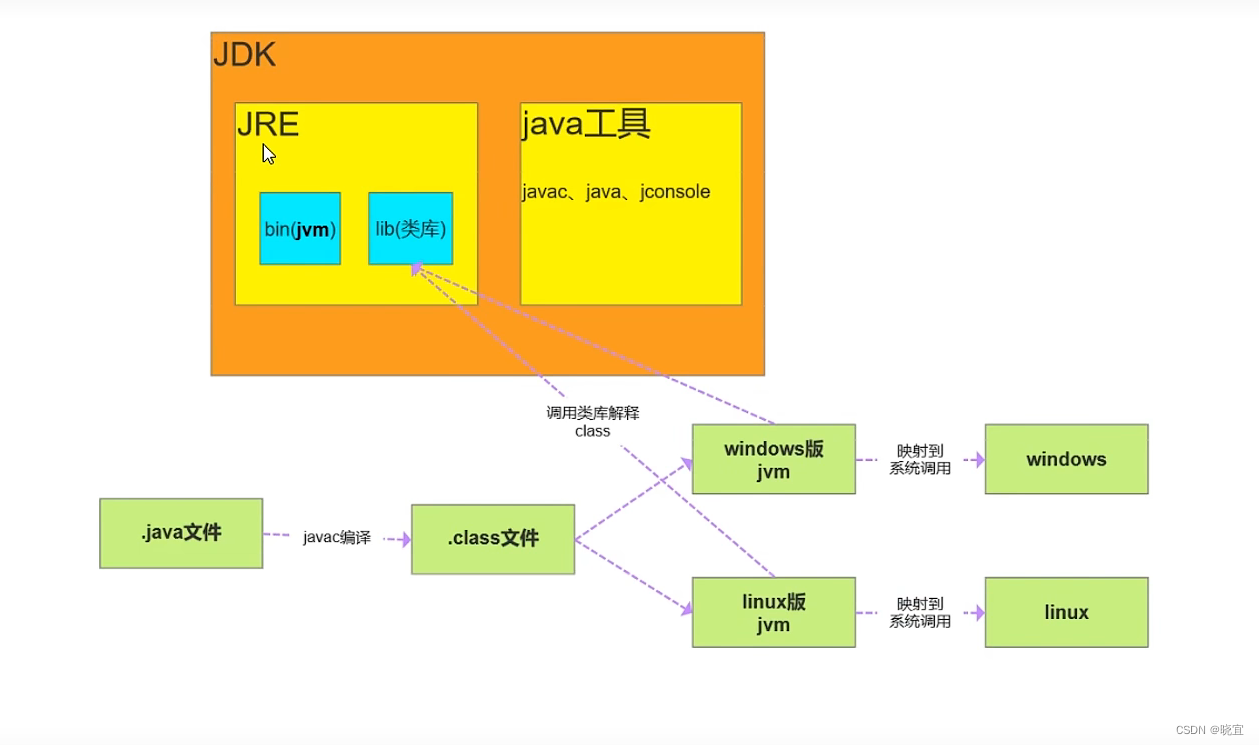

ElasticSearch 是基于Java平台的,所以先要安装Java。

平台确认

这里我准备了一台Centos7虚拟机, 为方便选择后续安装的版本,所以需要看下系统版本信息。

[root@centos ~]# uname -a

Linux centos 3.10.0-862.el7.x86_64 #1 SMP Fri Apr 20 16:44:24 UTC 2018 x86_64 x86_64 x86_64 GNU/Linux

安装Java

安装 Elasticsearch 之前,你需要先安装一个较新的版本的 Java,最好的选择是,你可以从http://www.java.com/获得官方提供的最新版本的 Java。安装以后,确认是否安装成功:

[root@centos ~]# java --version

openjdk 14.0.2 2020-07-14

OpenJDK Runtime Environment 20.3 (slowdebug build 14.0.2+12)

OpenJDK 64-Bit Server VM 20.3 (slowdebug build 14.0.2+12, mixed mode, sharing)

下载ElasticSearch

从https://www.elastic.co/cn/downloads/elasticsearch下载ElasticSearch

比如可以通过curl下载

[root@centos opt]# curl -O https://artifacts.elastic.co/downloads/elasticsearch/elasticsearch-7.12.0-linux-x86_64.tar.gz

% Total % Received % Xferd Average Speed Time Time Time Current

Dload Upload Total Spent Left Speed

解压

[root@centos opt]# tar zxvf /opt/elasticsearch-7.12.0-linux-x86_64.tar.gz

...

[root@centos opt]# ll | grep elasticsearch

drwxr-xr-x 9 root root 4096 Mar 18 14:21 elasticsearch-7.12.0

-rw-r--r-- 1 root root 327497331 Apr 5 21:05 elasticsearch-7.12.0-linux-x86_64.tar.gz

增加elasticSearch用户

必须创建一个非root用户来运行ElasticSearch(ElasticSearch5及以上版本,基于安全考虑,强制规定不能以root身份运行。)

如果你使用root用户来启动ElasticSearch,则会有如下错误信息:

[root@centos opt]# cd elasticsearch-7.12.0/

[root@centos elasticsearch-7.12.0]# ./bin/elasticsearch

[2021-04-05T21:36:46,510][ERROR][o.e.b.ElasticsearchUncaughtExceptionHandler] [centos] uncaught exception in thread [main]

org.elasticsearch.bootstrap.StartupException: java.lang.RuntimeException: can not run elasticsearch as root

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:163) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Elasticsearch.execute(Elasticsearch.java:150) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.cli.EnvironmentAwareCommand.execute(EnvironmentAwareCommand.java:75) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.cli.Command.mainWithoutErrorHandling(Command.java:116) ~[elasticsearch-cli-7.12.0.jar:7.12.0]

at org.elasticsearch.cli.Command.main(Command.java:79) ~[elasticsearch-cli-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:115) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:81) ~[elasticsearch-7.12.0.jar:7.12.0]

Caused by: java.lang.RuntimeException: can not run elasticsearch as root

at org.elasticsearch.bootstrap.Bootstrap.initializeNatives(Bootstrap.java:101) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Bootstrap.setup(Bootstrap.java:168) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Bootstrap.init(Bootstrap.java:397) ~[elasticsearch-7.12.0.jar:7.12.0]

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:159) ~[elasticsearch-7.12.0.jar:7.12.0]

... 6 more

uncaught exception in thread [main]

java.lang.RuntimeException: can not run elasticsearch as root

at org.elasticsearch.bootstrap.Bootstrap.initializeNatives(Bootstrap.java:101)

at org.elasticsearch.bootstrap.Bootstrap.setup(Bootstrap.java:168)

at org.elasticsearch.bootstrap.Bootstrap.init(Bootstrap.java:397)

at org.elasticsearch.bootstrap.Elasticsearch.init(Elasticsearch.java:159)

at org.elasticsearch.bootstrap.Elasticsearch.execute(Elasticsearch.java:150)

at org.elasticsearch.cli.EnvironmentAwareCommand.execute(EnvironmentAwareCommand.java:75)

at org.elasticsearch.cli.Command.mainWithoutErrorHandling(Command.java:116)

at org.elasticsearch.cli.Command.main(Command.java:79)

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:115)

at org.elasticsearch.bootstrap.Elasticsearch.main(Elasticsearch.java:81)

For complete error details, refer to the log at /opt/elasticsearch-7.12.0/logs/elasticsearch.log

2021-04-05 13:36:46,979269 UTC [8846] INFO Main.cc@106 Parent process died - ML controller exiting

所以我们增加一个独立的elasticsearch用户来运行

# 增加elasticsearch用户

[root@centos elasticsearch-7.12.0]# useradd elasticsearch

[root@centos elasticsearch-7.12.0]# passwd elasticsearch

Changing password for user elasticsearch.

New password:

BAD PASSWORD: The password contains the user name in some form

Retype new password:

passwd: all authentication tokens updated successfully.

# 修改目录权限至新增的elasticsearch用户

[root@centos elasticsearch-7.12.0]# chown -R elasticsearch /opt/elasticsearch-7.12.0

# 增加data和log存放区,并赋予elasticsearch用户权限

[root@centos elasticsearch-7.12.0]# mkdir -p /data/es

[root@centos elasticsearch-7.12.0]# chown -R elasticsearch /data/es

[root@centos elasticsearch-7.12.0]# mkdir -p /var/log/es

[root@centos elasticsearch-7.12.0]# chown -R elasticsearch /var/log/es

然后修改上述的data和log路径,vi /opt/elasticsearch-7.12.0/config/elasticsearch.yml

# -------------------------------------- Paths ---------------------------------------

#

# Path to directory where to store the data (separate multiple locations by comma):

#

path.data: /data/es

#

# Path to log files:

#

path.logs: /var/log/es

修改Linux系统的限制配置

-

1.修改系统中允许应用最多创建多少文件等的限制权限。Linux默认来说,一般限制应用最多创建的文件是65535个。但是ES至少需要65536的文件创建权限。

-

2.修改系统中允许用户启动的进程开启多少个线程。默认的Linux限制root用户开启的进程可以开启任意数量的线程,其他用户开启的进程可以开启1024个线程。必须修改限制数为4096+。因为ES至少需要4096的线程池预备。ES在5.x版本之后,强制要求在linux中不能使用root用户启动ES进程。所以必须使用其他用户启动ES进程才可以。

-

3.Linux低版本内核为线程分配的内存是128K。4.x版本的内核分配的内存更大。如果虚拟机的内存是1G,最多只能开启3000+个线程数。至少为虚拟机分配1.5G以上的内存。

修改如下配置

[root@centos elasticsearch-7.12.0]# vi /etc/security/limits.conf

elasticsearch soft nofile 65536

elasticsearch hard nofile 65536

elasticsearch soft nproc 4096

elasticsearch hard nproc 4096

启动ElasticSearch

[root@centos elasticsearch-7.12.0]# su elasticsearch

[elasticsearch@centos elasticsearch-7.12.0]$ ./bin/elasticsearch -d

[2021-04-05T22:03:38,332][INFO ][o.e.n.Node ] [centos] version[7.12.0], pid[13197], build[default/tar/78722783c38caa25a70982b5b042074cde5d3b3a/2021-03-18T06:17:15.410153305Z], OS[Linux/3.10.0-862.el7.x86_64/amd64], JVM[AdoptOpenJDK/OpenJDK 64-Bit Server VM/15.0.1/15.0.1+9]

[2021-04-05T22:03:38,348][INFO ][o.e.n.Node ] [centos] JVM home [/opt/elasticsearch-7.12.0/jdk], using bundled JDK [true]

[2021-04-05T22:03:38,348][INFO ][o.e.n.Node ] [centos] JVM arguments [-Xshare:auto, -Des.networkaddress.cache.ttl=60, -Des.networkaddress.cache.negative.ttl=10, -XX:+AlwaysPreTouch, -Xss1m, -Djava.awt.headless=true, -Dfile.encoding=UTF-8, -Djna.nosys=true, -XX:-OmitStackTraceInFastThrow, -XX:+ShowCodeDetailsInExceptionMessages, -Dio.netty.noUnsafe=true, -Dio.netty.noKeySetOptimization=true, -Dio.netty.recycler.maxCapacityPerThread=0, -Dio.netty.allocator.numDirectArenas=0, -Dlog4j.shutdownHookEnabled=false, -Dlog4j2.disable.jmx=true, -Djava.locale.providers=SPI,COMPAT, --add-opens=java.base/java.io=ALL-UNNAMED, -XX:+UseG1GC, -Djava.io.tmpdir=/tmp/elasticsearch-17264135248464897093, -XX:+HeapDumpOnOutOfMemoryError, -XX:HeapDumpPath=data, -XX:ErrorFile=logs/hs_err_pid%p.log, -Xlog:gc*,gc+age=trace,safepoint:file=logs/gc.log:utctime,pid,tags:filecount=32,filesize=64m, -Xms1894m, -Xmx1894m, -XX:MaxDirectMemorySize=993001472, -XX:G1HeapRegionSize=4m, -XX:InitiatingHeapOccupancyPercent=30, -XX:G1ReservePercent=15, -Des.path.home=/opt/elasticsearch-7.12.0, -Des.path.conf=/opt/elasticsearch-7.12.0/config, -Des.distribution.flavor=default, -Des.distribution.type=tar, -Des.bundled_jdk=true]

查看安装是否成功

[root@centos ~]# netstat -ntlp | grep 9200

tcp6 0 0 127.0.0.1:9200 :::* LISTEN 13549/java

tcp6 0 0 ::1:9200 :::* LISTEN 13549/java

[root@centos ~]# curl 127.0.0.1:9200

{

"name" : "centos",

"cluster_name" : "elasticsearch",

"cluster_uuid" : "ihttW8b2TfWSkwf_YgPH2Q",

"version" : {

"number" : "7.12.0",

"build_flavor" : "default",

"build_type" : "tar",

"build_hash" : "78722783c38caa25a70982b5b042074cde5d3b3a",

"build_date" : "2021-03-18T06:17:15.410153305Z",

"build_snapshot" : false,

"lucene_version" : "8.8.0",

"minimum_wire_compatibility_version" : "6.8.0",

"minimum_index_compatibility_version" : "6.0.0-beta1"

},

"tagline" : "You Know, for Search"

}

安装Kibana

Kibana是界面化的查询数据的工具,下载时尽量下载与ElasicSearch一致的版本。

- 下载Kibana

从https://www.elastic.co/cn/downloads/kibana下载Kibana

- 解压

[root@centos opt]# tar -vxzf kibana-7.12.0-linux-x86_64.tar.gz

- 使用elasticsearch用户权限

[root@centos opt]# chown -R elasticsearch /opt/kibana-7.12.0-linux-x86_64

#配置Kibana的远程访问

[root@centos opt]# vi /opt/kibana-7.12.0-linux-x86_64/config/kibana.yml

server.host: 0.0.0.0

- 启动

需要切换至elasticsearch用户。

[root@centos opt]# su elasticsearch

[elasticsearch@centos opt]$ cd /opt/kibana-7.12.0-linux-x86_64/

[elasticsearch@centos kibana-7.12.0-linux-x86_64]$ ./bin/kibana

log [22:30:22.185] [info][plugins-service] Plugin "osquery" is disabled.

log [22:30:22.283] [warning][config][deprecation] Config key [monitoring.cluster_alerts.email_notifications.email_address] will be required for email notifications to work in 8.0."

log [22:30:22.482] [info][plugins-system] Setting up [100] plugins: [taskManager,licensing,globalSearch,globalSearchProviders,banners,code,usageCollection,xpackLegacy,telemetryCollectionManager,telemetry,telemetryCollectionXpack,kibanaUsageCollection,securityOss,share,newsfeed,mapsLegacy,kibanaLegacy,translations,legacyExport,embeddable,uiActionsEnhanced,expressions,charts,esUiShared,bfetch,data,home,observability,console,consoleExtensions,apmOss,searchprofiler,painlessLab,grokdebugger,management,indexPatternManagement,advancedSettings,fileUpload,savedObjects,visualizations,visTypeVislib,visTypeVega,visTypeTimelion,features,licenseManagement,watcher,canvas,visTypeTagcloud,visTypeTable,visTypeMetric,visTypeMarkdown,tileMap,regionMap,visTypeXy,graph,timelion,dashboard,dashboardEnhanced,visualize,visTypeTimeseries,inputControlVis,discover,discoverEnhanced,savedObjectsManagement,spaces,security,savedObjectsTagging,maps,lens,reporting,lists,encryptedSavedObjects,dashboardMode,dataEnhanced,cloud,upgradeAssistant,snapshotRestore,fleet,indexManagement,rollup,remoteClusters,crossClusterReplication,indexLifecycleManagement,enterpriseSearch,beatsManagement,transform,ingestPipelines,eventLog,actions,alerts,triggersActionsUi,stackAlerts,ml,securitySolution,case,infra,monitoring,logstash,apm,uptime]

log [22:30:22.483] [info][plugins][taskManager] TaskManager is identified by the Kibana UUID: xxxxxx

...

如果是后台启动:

[elasticsearch@centos kibana-7.12.0-linux-x86_64]$ nohup ./bin/kibana &

- 界面访问

可以导入simple data

查看数据

其实以上的安装各个版本大同小异,都相差不大,所以,没有按目前的新版本来进行安装演示。官方网站也有具体的安装操作步骤,也可以参考。

配置密码访问

使用基本许可证时,默认情况下禁用Elasticsearch安全功能。由于我测试环境是放在公网上的,所以需要设置下密码访问。相关文档可以参考:https://www.elastic.co/guide/en/elasticsearch/reference/7.12/security-minimal-setup.html

-

停止kibana和elasticsearch服务

-

将

xpack.security.enabled设置添加到ES_PATH_CONF/elasticsearch.yml文件并将值设置为true -

启动elasticsearch (

./bin/elasticsearch -d) -

执行如下密码设置器,

./bin/elasticsearch-setup-passwords interactive来设置各个组件的密码 -

将elasticsearch.username设置添加到KIB_PATH_CONF/kibana.yml 文件并将值设置给elastic用户:

elasticsearch.username: "elastic" -

创建kibana keystore,

./bin/kibana-keystore create -

在kibana keystore 中添加密码

./bin/kibana-keystore add elasticsearch.password -

重启kibana 服务即可

nohup ./bin/kibana &

然后就可以使用密码登录了:

查询和聚合的基础使用

安装完ElasticSearch 和 Kibana后,为了快速上手,我们通过官网GitHub提供的一个数据进行入门学习,主要包括查询数据和聚合数据。

从索引文档开始

- 索引一个文档

PUT /customer/_doc/1

{

"name": "John Doe"

}

为了方便测试,我们使用kibana的dev tool来进行学习测试:

查询刚才插入的文档

学习准备:批量索引文档

ES 还提供了批量操作,比如这里我们可以使用批量操作来插入一些数据,供我们在后面学习使用。使用批量来批处理文档操作比单独提交请求要快得多,因为它减少了网络往返。

下载测试数据

数据是index为bank,accounts.json 下载地址:https://github.com/elastic/elasticsearch/blob/v6.8.18/docs/src/test/resources/accounts.json(如果你无法下载,也可以clone ES的官方仓库:https://github.com/elastic/elasticsearch,选择本文中使用的版本分支,然后进入/docs/src/test/resources/accounts.json目录获取)。

数据的格式如下:

{

"account_number": 0,

"balance": 16623,

"firstname": "Bradshaw",

"lastname": "Mckenzie",

"age": 29,

"gender": "F",

"address": "244 Columbus Place",

"employer": "Euron",

"email": "bradshawmckenzie@euron.com",

"city": "Hobucken",

"state": "CO"

}

批量插入数据

将accounts.json拷贝至指定目录,我这里放在/opt/下面,然后执行:

curl -H "Content-Type: application/json" -XPOST "localhost:9200/bank/_bulk?pretty&refresh" --data-binary "@/opt/accounts.json"

查看状态

[elasticsearch@centos root]$ curl "localhost:9200/_cat/indices?v=true" | grep bank

% Total % Received % Xferd Average Speed Time Time Time Current

Dload Upload Total Spent Left Speed

100 1524 100 1524 0 0 119k 0 --:--:-- --:--:-- --:--:-- 124k

yellow open bank yq3eSlAWRMO2Td0Sl769rQ 1 1 1000 0 379.2kb 379.2kb

查询数据

我们通过kibana来进行查询测试。

查询所有

match_all表示查询所有的数据,sort即按照什么字段排序

GET /bank/_search

{

"query": { "match_all": {} },

"sort": [

{ "account_number": "asc" }

]

}

结果

相关字段解释

-

took– Elasticsearch运行查询所花费的时间(以毫秒为单位) -

timed_out–搜索请求是否超时 -

_shards- 搜索了多少个碎片,以及成功,失败或跳过了多少个碎片的细目分类。 -

max_score– 找到的最相关文档的分数 -

hits.total.value- 找到了多少个匹配的文档 -

hits.sort- 文档的排序位置(不按相关性得分排序时) -

hits._score- 文档的相关性得分(使用match_all时不适用)

分页查询(from+size)

本质上就是from和size两个字段

GET /bank/_search

{

"query": { "match_all": {} },

"sort": [

{ "account_number": "asc" }

],

"from": 10,

"size": 10

}

结果

指定字段查询:match

如果要在字段中搜索特定字词,可以使用match; 如下语句将查询address 字段中包含 mill 或者 lane的数据。

GET /bank/_search

{

"query": { "match": { "address": "mill lane" } }

}

结果

(由于ES底层是按照分词索引的,所以上述查询结果是address 字段中包含 mill 或者 lane的数据)。

查询段落匹配:match_phrase

如果我们希望查询的条件是 address字段中包含 “mill lane”,则可以使用match_phrase。

GET /bank/_search

{

"query": { "match_phrase": { "address": "mill lane" } }

}

结果

多条件查询: bool

如果要构造更复杂的查询,可以使用bool查询来组合多个查询条件。例如,以下请求在bank索引中搜索40岁客户的帐户,但不包括居住在爱达荷州(ID)的任何人。

GET /bank/_search

{

"query": {

"bool": {

"must": [

{ "match": { "age": "40" } }

],

"must_not": [

{ "match": { "state": "ID" } }

]

}

}

}

结果

must, should, must_not 和 filter 都是bool查询的子句。那么filter和上述query子句有啥区别呢?

查询条件:query or filter

先看下如下查询, 在bool查询的子句中同时具备query/must 和 filter。

GET /bank/_search

{

"query": {

"bool": {

"must": [

{

"match": {

"state": "ND"

}

}

],

"filter": [

{

"term": {

"age": "40"

}

},

{

"range": {

"balance": {

"gte": 20000,

"lte": 30000

}

}

}

]

}

}

}

结果

两者都可以写查询条件,而且语法也类似。区别在于,query 上下文的条件是用来给文档打分的,匹配越好 _score 越高;filter 的条件只产生两种结果:符合与不符合,后者被过滤掉。

所以,我们进一步看只包含filter的查询。

GET /bank/_search

{

"query": {

"bool": {

"filter": [

{

"term": {

"age": "40"

}

},

{

"range": {

"balance": {

"gte": 20000,

"lte": 30000

}

}

}

]

}

}

}

结果,显然无_score

聚合查询:Aggregation

我们知道SQL中有group by,在ES中它叫Aggregation,即聚合运算。

简单聚合

比如我们希望计算出account每个州的统计数量, 使用aggs关键字对state字段聚合,被聚合的字段无需对分词统计,所以使用state.keyword对整个字段统计。

GET /bank/_search

{

"size": 0,

"aggs": {

"group_by_state": {

"terms": {

"field": "state.keyword"

}

}

}

}

结果

因为无需返回条件的具体数据, 所以设置size=0,返回hits为空。

doc_count表示bucket中每个州的数据条数。

嵌套聚合

ES还可以处理个聚合条件的嵌套。比如承接上个例子, 计算每个州的平均结余。涉及到的就是在对state分组的基础上,嵌套计算avg(balance):

GET /bank/_search

{

"size": 0,

"aggs": {

"group_by_state": {

"terms": {

"field": "state.keyword"

},

"aggs": {

"average_balance": {

"avg": {

"field": "balance"

}

}

}

}

}

}

结果

对聚合结果排序

可以通过在aggs中对嵌套聚合的结果进行排序。比如承接上个例子, 对嵌套计算出的avg(balance),这里是average_balance,进行排序。

GET /bank/_search

{

"size": 0,

"aggs": {

"group_by_state": {

"terms": {

"field": "state.keyword",

"order": {

"average_balance": "desc"

}

},

"aggs": {

"average_balance": {

"avg": {

"field": "balance"

}

}

}

}

}

}

结果

来源:

https://www.pdai.tech/md/db/nosql-es/elasticsearch-x-usage.html

(四):ElasticSearch 索引管理

索引管理的引入

我们在前文中增加文档时,如下的语句会动态创建一个customer的index:

PUT /customer/_doc/1

{

"name": "John Doe"

}

而这个index实际上已经自动创建了它里面的字段(name)的类型。我们不妨看下它自动创建的mapping:

{

"mappings": {

"_doc": {

"properties": {

"name": {

"type": "text",

"fields": {

"keyword": {

"type": "keyword",

"ignore_above": 256

}

}

}

}

}

}

}

那么如果我们需要对这个建立索引的过程做更多的控制:比如想要确保这个索引有数量适中的主分片,并且在我们索引任何数据之前,分析器和映射已经被建立好。那么就会引入两点:第一个禁止自动创建索引,第二个是手动创建索引。

- 禁止自动创建索引

可以通过在 config/elasticsearch.yml 的每个节点下添加下面的配置:

action.auto_create_index: false

手动创建索引就是接下来文章的内容。更多关于 ElasticSearch 数据库的学习文章,请参阅:NoSQL 数据库之 ElasticSearch ,本系列持续更新中。

索引的格式

在请求体里面传入设置或类型映射,如下所示:

PUT /my_index

{

"settings": { ... any settings ... },

"mappings": {

"properties": { ... any properties ... }

}

}

-

settings: 用来设置分片,副本等配置信息

-

mappings: 字段映射,类型等

-

properties: 由于type在后续版本中会被Deprecated, 所以无需被type嵌套

索引管理操作

我们通过kibana的devtool来学习索引的管理操作。

创建索引

我们创建一个user 索引test-index-users,其中包含三个属性:name,age, remarks; 存储在一个分片一个副本上。

PUT /test-index-users

{

"settings": {

"number_of_shards": 1,

"number_of_replicas": 1

},

"mappings": {

"properties": {

"name": {

"type": "text",

"fields": {

"keyword": {

"type": "keyword",

"ignore_above": 256

}

}

},

"age": {

"type": "long"

},

"remarks": {

"type": "text"

}

}

}

}

执行结果

- 插入测试数据

查看数据

- 我们再测试下不匹配的数据类型(age):

POST /test-index-users/_doc

{

"name": "test user",

"age": "error_age",

"remarks": "hello eeee"

}

你可以看到无法类型不匹配的错误:

修改索引

查看刚才的索引,curl 'localhost:9200/_cat/indices?v' | grep users

yellow open test-index-users LSaIB57XSC6uVtGQHoPYxQ 1 1 1 0 4.4kb 4.4kb

我们注意到刚创建的索引的状态是yellow的,因为我测试的环境是单点环境,无法创建副本,但是在上述number_of_replicas配置中设置了副本数是1;所以在这个时候我们需要修改索引的配置。

修改副本数量为0:

PUT /test-index-users/_settings

{

"settings": {

"number_of_replicas": 0

}

}

再次查看状态:

green open test-index-users LSaIB57XSC6uVtGQHoPYxQ 1 1 1 0 4.4kb 4.4kb

打开/关闭索引

- 关闭索引

一旦索引被关闭,那么这个索引只能显示元数据信息,不能够进行读写操作。

当关闭以后,再插入数据时:

- 打开索引

打开后又可以重新写数据了

删除索引

最后我们将创建的test-index-users删除。

DELETE /test-index-users

查看索引

由于test-index-users被删除,所以我们看下之前bank的索引的信息。

- mapping

GET /bank/_mapping

- settings

GET /bank/_settings

Kibana 管理索引

在Kibana如下路径,我们可以查看和管理索引

前文介绍了索引的一些操作,特别是手动创建索引,但是批量和脚本化必然需要提供一种模板方式快速构建和管理索引,这就是本文要介绍的索引模板(Index Template),它是一种告诉Elasticsearch在创建索引时如何配置索引的方法。为了更好的复用性,在7.8中还引入了组件模板。

索引模板

索引模板是一种告诉Elasticsearch在创建索引时如何配置索引的方法。

- 使用方式

在创建索引之前可以先配置模板,这样在创建索引(手动创建索引或通过对文档建立索引)时,模板设置将用作创建索引的基础。

模板类型

模板有两种类型:索引模板和组件模板。

-

组件模板是可重用的构建块,用于配置映射,设置和别名;它们不会直接应用于一组索引。

-

索引模板可以包含组件模板的集合,也可以直接指定设置,映射和别名。

索引模板中的优先级

-

可组合模板优先于旧模板。如果没有可组合模板匹配给定索引,则旧版模板可能仍匹配并被应用。

-

如果使用显式设置创建索引并且该索引也与索引模板匹配,则创建索引请求中的设置将优先于索引模板及其组件模板中指定的设置。

-

如果新数据流或索引与多个索引模板匹配,则使用优先级最高的索引模板。

内置索引模板

Elasticsearch具有内置索引模板,每个索引模板的优先级为100,适用于以下索引模式:

-

logs-*-* -

metrics-*-* -

synthetics-*-*

所以在涉及内建索引模板时,要避免索引模式冲突。更多可以参考https://www.elastic.co/guide/en/elasticsearch/reference/current/index-templates.html。

案例

- 首先创建两个索引组件模板:

PUT _component_template/component_template1

{

"template": {

"mappings": {

"properties": {

"@timestamp": {

"type": "date"

}

}

}

}

}

PUT _component_template/runtime_component_template

{

"template": {

"mappings": {

"runtime": {

"day_of_week": {

"type": "keyword",

"script": {

"source": "emit(doc['@timestamp'].value.dayOfWeekEnum.getDisplayName(TextStyle.FULL, Locale.ROOT))"

}

}

}

}

}

}

执行结果如下

- 创建使用组件模板的索引模板

PUT _index_template/template_1

{

"index_patterns": ["bar*"],

"template": {

"settings": {

"number_of_shards": 1

},

"mappings": {

"_source": {

"enabled": true

},

"properties": {

"host_name": {

"type": "keyword"

},

"created_at": {

"type": "date",

"format": "EEE MMM dd HH:mm:ss Z yyyy"

}

}

},

"aliases": {

"mydata": { }

}

},

"priority": 500,

"composed_of": ["component_template1", "runtime_component_template"],

"version": 3,

"_meta": {

"description": "my custom"

}

}

执行结果如下

- 创建一个匹配

bar*的索引bar-test

PUT /bar-test

然后获取mapping

GET /bar-test/_mapping

执行结果如下

模拟多组件模板

由于模板不仅可以由多个组件模板组成,还可以由索引模板自身组成;那么最终的索引设置将是什么呢?ElasticSearch设计者考虑到这个,提供了API进行模拟组合后的模板的配置。

模拟某个索引结果

比如上面的template_1, 我们不用创建bar*的索引(这里模拟bar-pdai-test),也可以模拟计算出索引的配置:

POST /_index_template/_simulate_index/bar-pdai-test

执行结果如下

模拟组件模板结果

当然,由于template_1模板是由两个组件模板组合的,我们也可以模拟出template_1被组合后的索引配置:

POST /_index_template/_simulate/template_1

执行结果如下:

{

"template" : {

"settings" : {

"index" : {

"number_of_shards" : "1"

}

},

"mappings" : {

"runtime" : {

"day_of_week" : {

"type" : "keyword",

"script" : {

"source" : "emit(doc['@timestamp'].value.dayOfWeekEnum.getDisplayName(TextStyle.FULL, Locale.ROOT))",

"lang" : "painless"

}

}

},

"properties" : {

"@timestamp" : {

"type" : "date"

},

"created_at" : {

"type" : "date",

"format" : "EEE MMM dd HH:mm:ss Z yyyy"

},

"host_name" : {

"type" : "keyword"

}

}

},

"aliases" : {

"mydata" : { }

}

},

"overlapping" : [ ]

}

模拟组件模板和自身模板结合后的结果

- 新建两个模板

PUT /_component_template/ct1

{

"template": {

"settings": {

"index.number_of_shards": 2

}

}

}

PUT /_component_template/ct2

{

"template": {

"settings": {

"index.number_of_replicas": 0

},

"mappings": {

"properties": {

"@timestamp": {

"type": "date"

}

}

}

}

}

模拟在两个组件模板的基础上,添加自身模板的配置

POST /_index_template/_simulate

{

"index_patterns": ["my*"],

"template": {

"settings" : {

"index.number_of_shards" : 3

}

},

"composed_of": ["ct1", "ct2"]

}

执行的结果如下

{

"template" : {

"settings" : {

"index" : {

"number_of_shards" : "3",

"number_of_replicas" : "0"

}

},

"mappings" : {

"properties" : {

"@timestamp" : {

"type" : "date"

}

}

},

"aliases" : { }

},

"overlapping" : [ ]

}

链接:

https://pdai.tech/md/db/nosql-es/elasticsearch-x-index-template.html

(五):ElasticSearch DSL 查询原理与实践

DSL 查询之复合查询

在查询中会有多种条件组合的查询,在 ElasticSearch 中叫复合查询。它提供了5种复合查询方式:bool query(布尔查询)、boosting query(提高查询)、constant_score(固定分数查询)、dis_max(最佳匹配查询)、function_score(函数查询)。

复合查询引入

在前文中,我们使用bool查询来组合多个查询条件。比如之前介绍的语句:

GET /bank/_search

{

"query": {

"bool": {

"must": [

{ "match": { "age": "40" } }

],

"must_not": [

{ "match": { "state": "ID" } }

]

}

}

}

这种查询就是本文要介绍的复合查询,并且bool查询只是复合查询一种。

bool query(布尔查询)

通过布尔逻辑将较小的查询组合成较大的查询。

概念

Bool查询语法有以下特点

-

子查询可以任意顺序出现

-

可以嵌套多个查询,包括bool查询

-

如果bool查询中没有must条件,should中必须至少满足一条才会返回结果。

bool查询包含四种操作符,分别是must,should,must_not,filter。他们均是一种数组,数组里面是对应的判断条件。

-

must: 必须匹配。贡献算分 -

must_not:过滤子句,必须不能匹配,但不贡献算分 -

should: 选择性匹配,至少满足一条。贡献算分 -

filter: 过滤子句,必须匹配,但不贡献算分

一些例子

看下官方举例

- 例子1

POST _search

{

"query": {

"bool" : {

"must" : {

"term" : { "user.id" : "kimchy" }

},

"filter": {

"term" : { "tags" : "production" }

},

"must_not" : {

"range" : {

"age" : { "gte" : 10, "lte" : 20 }

}

},

"should" : [

{ "term" : { "tags" : "env1" } },

{ "term" : { "tags" : "deployed" } }

],

"minimum_should_match" : 1,

"boost" : 1.0

}

}

}

在filter元素下指定的查询对评分没有影响 , 评分返回为0。分数仅受已指定查询的影响。

- 例子2

GET _search

{

"query": {

"bool": {

"filter": {

"term": {

"status": "active"

}

}

}

}

}

这个例子查询查询为所有文档分配0分,因为没有指定评分查询。

- 例子3

GET _search

{

"query": {

"bool": {

"must": {

"match_all": {}

},

"filter": {

"term": {

"status": "active"

}

}

}

}

}

此bool查询具有match_all查询,该查询为所有文档指定1.0分。

- 例子4

GET /_search

{

"query": {

"bool": {

"should": [

{ "match": { "name.first": { "query": "shay", "_name": "first" } } },

{ "match": { "name.last": { "query": "banon", "_name": "last" } } }

],

"filter": {

"terms": {

"name.last": [ "banon", "kimchy" ],

"_name": "test"

}

}

}

}

}

每个query条件都可以有一个_name属性,用来追踪搜索出的数据到底match了哪个条件。

boosting query(提高查询)

不同于bool查询,bool查询中只要一个子查询条件不匹配那么搜索的数据就不会出现。而boosting query则是降低显示的权重/优先级(即score)。

概念

比如搜索逻辑是 name = ‘apple’ and type =‘fruit’,对于只满足部分条件的数据,不是不显示,而是降低显示的优先级(即score)。

例子

首先创建数据

POST /test-dsl-boosting/_bulk

{ "index": { "_id": 1 }}

{ "content":"Apple Mac" }

{ "index": { "_id": 2 }}

{ "content":"Apple Fruit" }

{ "index": { "_id": 3 }}

{ "content":"Apple employee like Apple Pie and Apple Juice" }

对匹配pie的做降级显示处理

GET /test-dsl-boosting/_search

{

"query": {

"boosting": {

"positive": {

"term": {

"content": "apple"

}

},

"negative": {

"term": {

"content": "pie"

}

},

"negative_boost": 0.5

}

}

}

执行结果如下

constant_score(固定分数查询)

查询某个条件时,固定的返回指定的score;显然当不需要计算score时,只需要filter条件即可,因为filter context忽略score。

例子

首先创建数据

POST /test-dsl-constant/_bulk

{ "index": { "_id": 1 }}

{ "content":"Apple Mac" }

{ "index": { "_id": 2 }}

{ "content":"Apple Fruit" }

查询apple

GET /test-dsl-constant/_search

{

"query": {

"constant_score": {

"filter": {

"term": { "content": "apple" }

},

"boost": 1.2

}

}

}

执行结果如下

dis_max(最佳匹配查询)

分离最大化查询(Disjunction Max Query)指的是: 将任何与任一查询匹配的文档作为结果返回,但只将最佳匹配的评分作为查询的评分结果返回。更多关于 ElasticSearch 数据库的学习文章,请参阅:NoSQL 数据库之 ElasticSearch ,本系列持续更新中。

例子

假设有个网站允许用户搜索博客的内容,以下面两篇博客内容文档为例:

POST /test-dsl-dis-max/_bulk

{ "index": { "_id": 1 }}

{"title": "Quick brown rabbits","body": "Brown rabbits are commonly seen."}

{ "index": { "_id": 2 }}

{"title": "Keeping pets healthy","body": "My quick brown fox eats rabbits on a regular basis."}

用户输入词组 “Brown fox” 然后点击搜索按钮。事先,我们并不知道用户的搜索项是会在 title 还是在 body 字段中被找到,但是,用户很有可能是想搜索相关的词组。用肉眼判断,文档 2 的匹配度更高,因为它同时包括要查找的两个词:

现在运行以下 bool 查询:

GET /test-dsl-dis-max/_search

{

"query": {

"bool": {

"should": [

{ "match": { "title": "Brown fox" }},

{ "match": { "body": "Brown fox" }}

]

}

}

}

为了理解导致这样的原因,需要看下如何计算评分的。

- should 条件的计算分数

GET /test-dsl-dis-max/_search

{

"query": {

"bool": {

"should": [

{ "match": { "title": "Brown fox" }},

{ "match": { "body": "Brown fox" }}

]

}

}

}

要计算上述分数,首先要计算match的分数

- 1.第一个match 中

brown的分数

doc 1 分数 = 0.6931471

- 2.title中没有fox,所以第一个match 中

brown fox 的分数 = brown分数 + 0 = 0.6931471

doc 1 分数 = 0.6931471 + 0 = 0.6931471

- 3.第二个 match 中

brown分数

doc 1 分数 = 0.21110919

doc 2 分数 = 0.160443

- 4.第二个 match 中

fox分数

doc 1 分数 = 0

doc 2 分数 = 0.60996956

- 5.所以第二个 match 中

brown fox分数 = brown分数 + fox分数

doc 1 分数 = 0.21110919 + 0 = 0.21110919

doc 2 分数 = 0.160443 + 0.60996956 = 0.77041256

- 6.所以整个语句分数,

should分数 = 第一个match + 第二个match分数

doc 1 分数 = 0.6931471 + 0.21110919 = 0.90425634

doc 2 分数 = 0 + 0.77041256 = 0.77041256

- 引入了dis_max

不使用 bool 查询,可以使用 dis_max 即分离 最大化查询(Disjunction Max Query) 。分离(Disjunction)的意思是 或(or) ,这与可以把结合(conjunction)理解成 与(and) 相对应。分离最大化查询(Disjunction Max Query)指的是: 将任何与任一查询匹配的文档作为结果返回,但只将最佳匹配的评分作为查询的评分结果返回 :

GET /test-dsl-dis-max/_search

{

"query": {

"dis_max": {

"queries": [

{ "match": { "title": "Brown fox" }},

{ "match": { "body": "Brown fox" }}

],

"tie_breaker": 0

}

}

}

0.77041256怎么来的呢? 下文给你解释它如何计算出来的。

- dis_max 条件的计算分数

分数 = 第一个匹配条件分数+ tie_breaker *第二个匹配的条件的分数

GET /test-dsl-dis-max/_search

{

"query": {

"dis_max": {

"queries": [

{ "match": { "title": "Brown fox" }},

{ "match": { "body": "Brown fox" }}

],

"tie_breaker": 0

}

}

}

doc 1 分数 = 0.6931471 + 0.21110919 * 0 = 0.6931471

doc 2 分数 = 0.77041256 = 0.77041256

这样你就能理解通过dis_max将doc 2 置前了, 当然这里如果缺省tie_breaker字段的话默认就是0,你还可以设置它的比例(在0到1之间)来控制排名。(显然值为1时和should查询是一致的)。

function_score(函数查询)

简而言之就是用自定义function的方式来计算_score。可以ES有哪些自定义function呢?

-

script_score使用自定义的脚本来完全控制分值计算逻辑。如果你需要以上预定义函数之外的功能,可以根据需要通过脚本进行实现。 -

weight对每份文档适用一个简单的提升,且该提升不会被归约:当weight为2时,结果为2 * _score。 -

random_score使用一致性随机分值计算来对每个用户采用不同的结果排序方式,对相同用户仍然使用相同的排序方式。 -

field_value_factor使用文档中某个字段的值来改变_score,比如将受欢迎程度或者投票数量考虑在内。 -

衰减函数(Decay Function)-linear,exp,gauss

例子

以最简单的random_score 为例。

GET /_search

{

"query": {

"function_score": {

"query": { "match_all": {} },

"boost": "5",

"random_score": {},

"boost_mode": "multiply"

}

}

}

进一步的,它还可以使用上述function的组合(functions)。

GET /_search

{

"query": {

"function_score": {

"query": { "match_all": {} },

"boost": "5",

"functions": [

{

"filter": { "match": { "test": "bar" } },

"random_score": {},

"weight": 23

},

{

"filter": { "match": { "test": "cat" } },

"weight": 42

}

],

"max_boost": 42,

"score_mode": "max",

"boost_mode": "multiply",

"min_score": 42

}

}

}

script_score 可以使用如下方式。

GET /_search

{

"query": {

"function_score": {

"query": {

"match": { "message": "elasticsearch" }

},

"script_score": {

"script": {

"source": "Math.log(2 + doc['my-int'].value)"

}

}

}

}

}

更多相关内容,可以参考官方文档,PS: 形成体系化认知以后,具体用的时候查询下即可。

DSL 查询之全文搜索

DSL查询极为常用的是对文本进行搜索,我们叫全文搜索,本文主要对全文搜索进行详解。

谈谈如何从官网学习

很多读者在看官方文档学习时存在一个误区,以DSL中full text查询为例,其实内容是非常多的, 没有取舍/没重点去阅读,要么需要花很多时间,要么头脑一片浆糊。所以这里重点谈谈我的理解。

- 第一点:全局观,即我们现在学习内容在整个体系的哪个位置?

如下图,可以很方便的帮助你构筑这种体系:

- 第二点: 分类别,从上层理解,而不是本身

比如Full text Query中,我们只需要把如下的那么多点分为3大类,你的体系能力会大大提升。

- 第三点: 知识点还是API? API类型的是可以查询的,只需要知道大致有哪些功能就可以了。

Match类型

第一类:match 类型

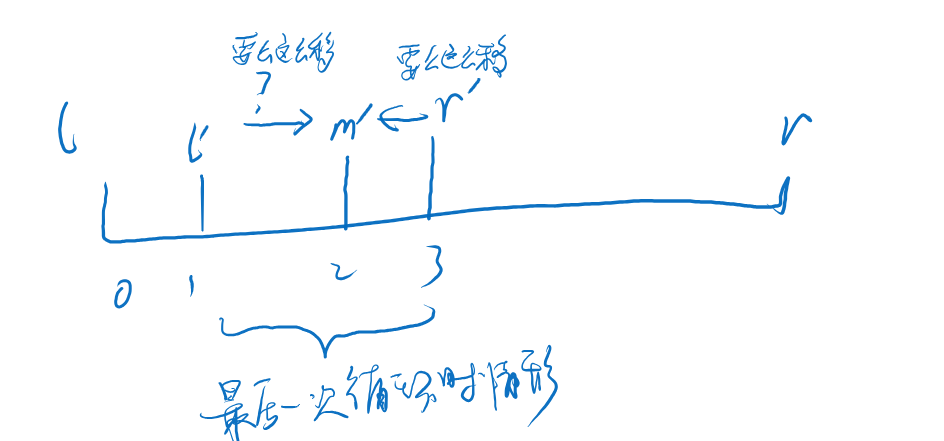

match 查询的步骤

在前文中我们已经介绍了match查询。

- 准备一些数据

这里我们准备一些数据,通过实例看match 查询的步骤。

PUT /test-dsl-match

{ "settings": { "number_of_shards": 1 }}

POST /test-dsl-match/_bulk

{ "index": { "_id": 1 }}

{ "title": "The quick brown fox" }

{ "index": { "_id": 2 }}

{ "title": "The quick brown fox jumps over the lazy dog" }

{ "index": { "_id": 3 }}

{ "title": "The quick brown fox jumps over the quick dog" }

{ "index": { "_id": 4 }}

{ "title": "Brown fox brown dog" }

- 查询数据

GET /test-dsl-match/_search

{

"query": {

"match": {

"title": "QUICK!"

}

}

}

Elasticsearch 执行上面这个 match 查询的步骤是:

1.检查字段类型 。

标题 title 字段是一个 string 类型( analyzed )已分析的全文字段,这意味着查询字符串本身也应该被分析。

2.分析查询字符串 。

将查询的字符串 QUICK! 传入标准分析器中,输出的结果是单个项 quick 。因为只有一个单词项,所以 match 查询执行的是单个底层 term 查询。

3.查找匹配文档 。

用 term 查询在倒排索引中查找 quick 然后获取一组包含该项的文档,本例的结果是文档:1、2 和 3 。

4.为每个文档评分 。

用 term 查询计算每个文档相关度评分 _score ,这是种将词频(term frequency,即词 quick 在相关文档的 title 字段中出现的频率)和反向文档频率(inverse document frequency,即词 quick 在所有文档的 title 字段中出现的频率),以及字段的长度(即字段越短相关度越高)相结合的计算方式。

- 验证结果

match多个词深入

我们在上文中复合查询中已经使用了match多个词,比如“Quick pets”; 这里我们通过例子带你更深入理解match多个词。

- match多个词的本质

查询多个词"BROWN DOG!"

GET /test-dsl-match/_search

{

"query": {

"match": {

"title": "BROWN DOG"

}

}

}

因为 match 查询必须查找两个词(["brown","dog"]),它在内部实际上先执行两次 term 查询,然后将两次查询的结果合并作为最终结果输出。为了做到这点,它将两个 term 查询包入一个 bool 查询中。

所以上述查询的结果,和如下语句查询结果是等同的。

GET /test-dsl-match/_search

{

"query": {

"bool": {

"should": [

{

"term": {

"title": "brown"

}

},

{

"term": {

"title": "dog"

}

}

]

}

}

}

- match多个词的逻辑

上面等同于should(任意一个满足),是因为 match还有一个operator参数,默认是or, 所以对应的是should。

所以上述查询也等同于:

GET /test-dsl-match/_search

{

"query": {

"match": {

"title": {

"query": "BROWN DOG",

"operator": "or"

}

}

}

}

那么我们如果是需要and操作呢,即同时满足呢?

GET /test-dsl-match/_search

{

"query": {

"match": {

"title": {

"query": "BROWN DOG",

"operator": "and"

}

}

}

}

等同于

GET /test-dsl-match/_search

{

"query": {

"bool": {

"must": [

{

"term": {

"title": "brown"

}

},

{

"term": {

"title": "dog"

}

}

]

}

}

}

控制match的匹配精度

如果用户给定 3 个查询词,想查找至少包含其中 2 个的文档,该如何处理?将 operator 操作符参数设置成 and 或者 or 都是不合适的。

match 查询支持 minimum_should_match 最小匹配参数,这让我们可以指定必须匹配的词项数用来表示一个文档是否相关。我们可以将其设置为某个具体数字,更常用的做法是将其设置为一个百分数,因为我们无法控制用户搜索时输入的单词数量:

GET /test-dsl-match/_search

{

"query": {

"match": {

"title": {

"query": "quick brown dog",

"minimum_should_match": "75%"

}

}

}

}

当给定百分比的时候, minimum_should_match 会做合适的事情:在之前三词项的示例中,75% 会自动被截断成 66.6% ,即三个里面两个词。无论这个值设置成什么,至少包含一个词项的文档才会被认为是匹配的。

当然也等同于:

GET /test-dsl-match/_search

{

"query": {

"bool": {

"should": [

{ "match": { "title": "quick" }},

{ "match": { "title": "brown" }},

{ "match": { "title": "dog" }}

],

"minimum_should_match": 2

}

}

}

其它match类型

- match_pharse

match_phrase在前文中我们已经有了解,我们再看下另外一个例子。

GET /test-dsl-match/_search

{

"query": {

"match_phrase": {

"title": {

"query": "quick brown"

}

}

}

}

很多人对它仍然有误解的,比如如下例子:

GET /test-dsl-match/_search

{

"query": {

"match_phrase": {

"title": {

"query": "quick brown f"

}

}

}

}

这样的查询是查不出任何数据的,因为前文中我们知道了match本质上是对term组合,match_phrase本质是连续的term的查询,所以f并不是一个分词,不满足term查询,所以最终查不出任何内容了。

- match_pharse_prefix

那有没有可以查询出quick brown f的方式呢?ELasticSearch在match_phrase基础上提供了一种可以查最后一个词项是前缀的方法,这样就可以查询quick brown f了

GET /test-dsl-match/_search

{

"query": {

"match_phrase_prefix": {

"title": {

"query": "quick brown f"

}

}

}

}

(ps: prefix的意思不是整个text的开始匹配,而是最后一个词项满足term的prefix查询而已)。

- match_bool_prefix

除了match_phrase_prefix,ElasticSearch还提供了match_bool_prefix查询

GET /test-dsl-match/_search

{

"query": {

"match_bool_prefix": {

"title": {

"query": "quick brown f"

}

}

}

}

它们两种方式有啥区别呢?match_bool_prefix本质上可以转换为:

GET /test-dsl-match/_search

{

"query": {

"bool" : {

"should": [

{ "term": { "title": "quick" }},

{ "term": { "title": "brown" }},

{ "prefix": { "title": "f"}}

]

}

}

}

所以这样你就能理解,match_bool_prefix查询中的quick,brown,f是无序的。

- multi_match

如果我们期望一次对多个字段查询,怎么办呢?ElasticSearch提供了multi_match查询的方式

{

"query": {

"multi_match" : {

"query": "Will Smith",

"fields": [ "title", "*_name" ]

}

}

}

*表示前缀匹配字段。

query string类型

第二类:query string 类型

query_string

此查询使用语法根据运算符(例如AND或)来解析和拆分提供的查询字符串NOT。然后查询在返回匹配的文档之前独立分析每个拆分的文本。

可以使用该query_string查询创建一个复杂的搜索,其中包括通配符,跨多个字段的搜索等等。尽管用途广泛,但查询是严格的,如果查询字符串包含任何无效语法,则返回错误。

例如:

GET /test-dsl-match/_search

{

"query": {

"query_string": {

"query": "(lazy dog) OR (brown dog)",

"default_field": "title"

}

}

}

这里查询结果,你需要理解本质上查询这四个分词(term)or的结果而已,所以doc 3和4也在其中。对构筑知识体系已经够了,但是它其实还有很多参数和用法。

query_string_simple

该查询使用一种简单的语法来解析提供的查询字符串并将其拆分为基于特殊运算符的术语。然后查询在返回匹配的文档之前独立分析每个术语。

尽管其语法比query_string查询更受限制 ,但simple_query_string 查询不会针对无效语法返回错误。而是,它将忽略查询字符串的任何无效部分。

举例:

GET /test-dsl-match/_search

{

"query": {

"simple_query_string" : {

"query": "\"over the\" + (lazy | quick) + dog",

"fields": ["title"],

"default_operator": "and"

}

}

}

Interval类型

第三类:interval类型

Intervals是时间间隔的意思,本质上将多个规则按照顺序匹配。比如:

GET /test-dsl-match/_search

{

"query": {

"intervals" : {

"title" : {

"all_of" : {

"ordered" : true,

"intervals" : [

{

"match" : {

"query" : "quick",

"max_gaps" : 0,

"ordered" : true

}

},

{

"any_of" : {

"intervals" : [

{ "match" : { "query" : "jump over" } },

{ "match" : { "query" : "quick dog" } }

]

}

}

]

}

}

}

}

}

因为interval之间是可以组合的,所以它可以表现的很复杂。

DSL 查询之 Term

DSL查询另一种极为常用的是对词项进行搜索,官方文档中叫”term level“查询,本文主要对term level搜索进行详解。

Term查询引入

如前文所述,查询分基于文本查询和基于词项的查询:本文主要讲基于词项的查询。

Term查询

很多比较常用,也不难,就是需要结合实例理解。这里综合官方文档的内容,我设计一个测试场景的数据,以覆盖所有例子。

准备数据

PUT /test-dsl-term-level

{

"mappings": {

"properties": {

"name": {

"type": "keyword"

},

"programming_languages": {

"type": "keyword"

},

"required_matches": {

"type": "long"

}

}

}

}

POST /test-dsl-term-level/_bulk

{ "index": { "_id": 1 }}

{"name": "Jane Smith", "programming_languages": [ "c++", "java" ], "required_matches": 2}

{ "index": { "_id": 2 }}

{"name": "Jason Response", "programming_languages": [ "java", "php" ], "required_matches": 2}

{ "index": { "_id": 3 }}

{"name": "Dave Pdai", "programming_languages": [ "java", "c++", "php" ], "required_matches": 3, "remarks": "hello world"}

字段是否存在:exist

由于多种原因,文档字段的索引值可能不存在:

-

源JSON中的字段是null或[]

-

该字段已"index" : false在映射中设置

-

字段值的长度超出ignore_above了映射中的设置

-

字段值格式错误,并且ignore_malformed已在映射中定义

所以exist表示查找是否存在字段。

id查询:ids

ids 即对id查找

GET /test-dsl-term-level/_search

{

"query": {

"ids": {

"values": [3, 1]

}

}

}

前缀:prefix

通过前缀查找某个字段

GET /test-dsl-term-level/_search

{

"query": {

"prefix": {

"name": {

"value": "Jan"

}

}

}

}

分词匹配:term

前文最常见的根据分词查询

GET /test-dsl-term-level/_search

{

"query": {

"term": {

"programming_languages": "php"

}

}

}

多个分词匹配:terms

按照读个分词term匹配,它们是or的关系。

GET /test-dsl-term-level/_search

{

"query": {

"terms": {

"programming_languages": ["php","c++"]

}

}

}

按某个数字字段分词匹配:term set

设计这种方式查询的初衷是用文档中的数字字段动态匹配查询满足term的个数。

GET /test-dsl-term-level/_search

{

"query": {

"terms_set": {

"programming_languages": {

"terms": [ "java", "php" ],

"minimum_should_match_field": "required_matches"

}

}

}

}

通配符:wildcard

通配符匹配,比如*

GET /test-dsl-term-level/_search

{

"query": {

"wildcard": {

"name": {

"value": "D*ai",

"boost": 1.0,

"rewrite": "constant_score"

}

}

}

}

范围:range

常常被用在数字或者日期范围的查询。

GET /test-dsl-term-level/_search

{

"query": {

"range": {

"required_matches": {

"gte": 3,

"lte": 4

}

}

}

}

正则:regexp

通过正则表达式查询。以"Jan"开头的name字段。

GET /test-dsl-term-level/_search

{

"query": {

"regexp": {

"name": {

"value": "Ja.*",

"case_insensitive": true

}

}

}

}

模糊匹配:模糊

官方文档对模糊匹配:编辑距离是将一个术语转换为另一个术语所需的一个字符更改的次数。这些更改可以包括:

-

更改字符(box→ fox)

-

删除字符(black→ lack)

-

插入字符(sic→ sick)

-

转置两个相邻字符(act→ cat)

GET /test-dsl-term-level/_search

{

"query": {

"fuzzy": {

"remarks": {

"value": "hell"

}

}

}

}

来源:

https://www.pdai.tech/md/db/nosql-es/elasticsearch-x-dsl-term.html

https://www.pdai.tech/md/db/nosql-es/elasticsearch-x-dsl-full-text.html

(六):ElasticSearch 聚合查询原理与实践

除了查询之外,最常用的聚合了,ElasticSearch提供了三种聚合方式:桶聚合(Bucket Aggregation),指标聚合(Metric Aggregation) 和 管道聚合(Pipline Aggregation)。本文主要讲讲桶聚合(Bucket Aggregation)。

聚合查询之Bucket聚合

聚合的引入

我们在SQL结果中常有:

SELECT COUNT(color)

FROM table

GROUP BY color

ElasticSearch中桶在概念上类似于 SQL 的分组(GROUP BY),而指标则类似于 COUNT() 、 SUM() 、 MAX() 等统计方法。

进而引入了两个概念:

-

桶(Buckets) 满足特定条件的文档的集合

-

指标(Metrics) 对桶内的文档进行统计计算

所以ElasticSearch包含3种聚合(Aggregation)方式

-

桶聚合(Bucket Aggregation) - 本文中详解

-

指标聚合(Metric Aggregation) - 下文中讲解

-

管道聚合(Pipline Aggregation) - 再下一篇讲解

-

聚合管道化,简单而言就是上一个聚合的结果成为下个聚合的输入;

(PS:指标聚合和桶聚合很多情况下是组合在一起使用的,其实你也可以看到,桶聚合本质上是一种特殊的指标聚合,它的聚合指标就是数据的条数count)。

如何理解Bucket聚合

如果你直接去看文档,大概有几十种:

要么你需要花大量时间学习,要么你已经迷失或者即将迷失在知识点中…

所以你需要稍微站在设计者的角度思考下,不难发现设计上大概分为三类(当然有些是第二和第三类的融合)。

(图中并没有全部列出内容,因为图要表达的意图我觉得还是比较清楚的,这就够了;有了这种思虑和认知,会大大提升你的认知效率。)。

按知识点学习聚合

我们先按照官方权威指南中的一个例子,学习Aggregation中的知识点。

准备数据

让我们先看一个例子。我们将会创建一些对汽车经销商有用的聚合,数据是关于汽车交易的信息:车型、制造商、售价、何时被出售等。

首先我们批量索引一些数据:

POST /test-agg-cars/_bulk

{ "index": {}}

{ "price" : 10000, "color" : "red", "make" : "honda", "sold" : "2014-10-28" }

{ "index": {}}

{ "price" : 20000, "color" : "red", "make" : "honda", "sold" : "2014-11-05" }

{ "index": {}}

{ "price" : 30000, "color" : "green", "make" : "ford", "sold" : "2014-05-18" }

{ "index": {}}

{ "price" : 15000, "color" : "blue", "make" : "toyota", "sold" : "2014-07-02" }

{ "index": {}}

{ "price" : 12000, "color" : "green", "make" : "toyota", "sold" : "2014-08-19" }

{ "index": {}}

{ "price" : 20000, "color" : "red", "make" : "honda", "sold" : "2014-11-05" }

{ "index": {}}

{ "price" : 80000, "color" : "red", "make" : "bmw", "sold" : "2014-01-01" }

{ "index": {}}

{ "price" : 25000, "color" : "blue", "make" : "ford", "sold" : "2014-02-12" }

标准的聚合

有了数据,开始构建我们的第一个聚合。汽车经销商可能会想知道哪个颜色的汽车销量最好,用聚合可以轻易得到结果,用 terms 桶操作:

GET /test-agg-cars/_search

{

"size" : 0,

"aggs" : {

"popular_colors" : {

"terms" : {

"field" : "color.keyword"

}

}

}

}

-

聚合操作被置于顶层参数 aggs 之下(如果你愿意,完整形式 aggregations 同样有效)。

-

然后,可以为聚合指定一个我们想要名称,本例中是:popular_colors 。

-

最后,定义单个桶的类型 terms。

结果如下:

-

因为我们设置了 size 参数,所以不会有 hits 搜索结果返回。

-

popular_colors 聚合是作为 aggregations 字段的一部分被返回的。

-

每个桶的 key 都与 color 字段里找到的唯一词对应。它总会包含 doc_count 字段,告诉我们包含该词项的文档数量。

-

每个桶的数量代表该颜色的文档数量。

多个聚合

同时计算两种桶的结果:对color和对make。

GET /test-agg-cars/_search

{

"size" : 0,

"aggs" : {

"popular_colors" : {

"terms" : {

"field" : "color.keyword"

}

},

"make_by" : {

"terms" : {

"field" : "make.keyword"

}

}

}

}

结果如下:

聚合的嵌套

这个新的聚合层让我们可以将 avg 度量嵌套置于 terms 桶内。实际上,这就为每个颜色生成了平均价格。

GET /test-agg-cars/_search

{

"size" : 0,

"aggs": {

"colors": {

"terms": {

"field": "color.keyword"

},

"aggs": {

"avg_price": {

"avg": {

"field": "price"

}

}

}

}

}

}

结果如下:

动态脚本的聚合

这个例子告诉你,ElasticSearch还支持一些基于脚本(生成运行时的字段)的复杂的动态聚合。

GET /test-agg-cars/_search

{

"runtime_mappings": {

"make.length": {

"type": "long",

"script": "emit(doc['make.keyword'].value.length())"

}

},

"size" : 0,

"aggs": {

"make_length": {

"histogram": {

"interval": 1,

"field": "make.length"

}

}

}

}

结果如下:

按分类学习Bucket聚合

我们在具体学习时,也无需学习每一个点,基于上面图的认知,我们只需用20%的时间学习最为常用的80%功能即可,其它查查文档而已。

前置条件的过滤:filter

在当前文档集上下文中定义与指定过滤器(Filter)匹配的所有文档的单个存储桶。通常,这将用于将当前聚合上下文缩小到一组特定的文档。

GET /test-agg-cars/_search

{

"size": 0,

"aggs": {

"make_by": {

"filter": { "term": { "type": "honda" } },

"aggs": {

"avg_price": { "avg": { "field": "price" } }

}

}

}

}

结果如下:

对filter进行分组聚合:filters

设计一个新的例子, 日志系统中,每条日志都是在文本中,包含warning/info等信息。

PUT /test-agg-logs/_bulk?refresh

{ "index" : { "_id" : 1 } }

{ "body" : "warning: page could not be rendered" }

{ "index" : { "_id" : 2 } }

{ "body" : "authentication error" }

{ "index" : { "_id" : 3 } }

{ "body" : "warning: connection timed out" }

{ "index" : { "_id" : 4 } }

{ "body" : "info: hello pdai" }

我们需要对包含不同日志类型的日志进行分组,这就需要filters:

GET /test-agg-logs/_search

{

"size": 0,

"aggs" : {

"messages" : {

"filters" : {

"other_bucket_key": "other_messages",

"filters" : {

"infos" : { "match" : { "body" : "info" }},

"warnings" : { "match" : { "body" : "warning" }}

}

}

}

}

}

结果如下:

对number类型聚合:Range

基于多桶值源的聚合,使用户能够定义一组范围-每个范围代表一个桶。在聚合过程中,将从每个存储区范围中检查从每个文档中提取的值,并“存储”相关/匹配的文档。请注意,此聚合包括 from 值,但不包括 to 每个范围的值。

GET /test-agg-cars/_search

{

"size": 0,

"aggs": {

"price_ranges": {

"range": {

"field": "price",

"ranges": [

{ "to": 20000 },

{ "from": 20000, "to": 40000 },

{ "from": 40000 }

]

}

}

}

}

结果如下:

对IP类型聚合:IP Range

专用于IP值的范围聚合。

GET /ip_addresses/_search

{

"size": 10,

"aggs": {

"ip_ranges": {

"ip_range": {

"field": "ip",

"ranges": [

{ "to": "10.0.0.5" },

{ "from": "10.0.0.5" }

]

}

}

}

}

返回

{

...

"aggregations": {

"ip_ranges": {

"buckets": [

{

"key": "*-10.0.0.5",

"to": "10.0.0.5",

"doc_count": 10

},

{

"key": "10.0.0.5-*",

"from": "10.0.0.5",

"doc_count": 260

}

]

}

}

}

- CIDR Mask分组

此外还可以用CIDR Mask分组

GET /ip_addresses/_search

{

"size": 0,

"aggs": {

"ip_ranges": {

"ip_range": {

"field": "ip",

"ranges": [

{ "mask": "10.0.0.0/25" },

{ "mask": "10.0.0.127/25" }

]

}

}

}

}

返回

{

...

"aggregations": {

"ip_ranges": {

"buckets": [

{

"key": "10.0.0.0/25",

"from": "10.0.0.0",

"to": "10.0.0.128",

"doc_count": 128

},

{

"key": "10.0.0.127/25",

"from": "10.0.0.0",

"to": "10.0.0.128",

"doc_count": 128

}

]

}

}

}

- 增加key显示

GET /ip_addresses/_search

{

"size": 0,

"aggs": {

"ip_ranges": {

"ip_range": {

"field": "ip",

"ranges": [

{ "to": "10.0.0.5" },

{ "from": "10.0.0.5" }

],

"keyed": true // here

}

}

}

}

返回

{

...

"aggregations": {

"ip_ranges": {

"buckets": {

"*-10.0.0.5": {

"to": "10.0.0.5",

"doc_count": 10

},

"10.0.0.5-*": {

"from": "10.0.0.5",

"doc_count": 260

}

}

}

}

}

- 自定义key显示

GET /ip_addresses/_search

{

"size": 0,

"aggs": {

"ip_ranges": {

"ip_range": {

"field": "ip",

"ranges": [

{ "key": "infinity", "to": "10.0.0.5" },

{ "key": "and-beyond", "from": "10.0.0.5" }

],

"keyed": true

}

}

}

}

返回

{

...

"aggregations": {

"ip_ranges": {

"buckets": {

"infinity": {

"to": "10.0.0.5",

"doc_count": 10

},

"and-beyond": {

"from": "10.0.0.5",

"doc_count": 260

}

}

}

}

}

对日期类型聚合:Date Range

专用于日期值的范围聚合。

GET /test-agg-cars/_search

{

"size": 0,

"aggs": {

"range": {

"date_range": {

"field": "sold",

"format": "yyyy-MM",

"ranges": [

{ "from": "2014-01-01" },

{ "to": "2014-12-31" }

]

}

}

}

}

结果如下:

此聚合与Range聚合之间的主要区别在于 from和to值可以在Date Math表达式中表示,并且还可以指定日期格式,通过该日期格式将返回from and to响应字段。请注意,此聚合包括from值,但不包括to每个范围的值。

对柱状图功能:Histrogram

直方图 histogram 本质上是就是为柱状图功能设计的。

创建直方图需要指定一个区间,如果我们要为售价创建一个直方图,可以将间隔设为 20,000。这样做将会在每个 $20,000 档创建一个新桶,然后文档会被分到对应的桶中。

对于仪表盘来说,我们希望知道每个售价区间内汽车的销量。我们还会想知道每个售价区间内汽车所带来的收入,可以通过对每个区间内已售汽车的售价求和得到。

可以用 histogram 和一个嵌套的 sum 度量得到我们想要的答案:

GET /test-agg-cars/_search

{

"size" : 0,

"aggs":{

"price":{

"histogram":{

"field": "price.keyword",

"interval": 20000

},

"aggs":{

"revenue": {

"sum": {

"field" : "price"

}

}

}

}

}

}

-

histogram 桶要求两个参数:一个数值字段以及一个定义桶大小间隔。

-

sum 度量嵌套在每个售价区间内,用来显示每个区间内的总收入。

如我们所见,查询是围绕 price 聚合构建的,它包含一个 histogram 桶。它要求字段的类型必须是数值型的同时需要设定分组的间隔范围。间隔设置为 20,000 意味着我们将会得到如 [0-19999, 20000-39999, ...]这样的区间。

接着,我们在直方图内定义嵌套的度量,这个 sum 度量,它会对落入某一具体售价区间的文档中 price 字段的值进行求和。这可以为我们提供每个售价区间的收入,从而可以发现到底是普通家用车赚钱还是奢侈车赚钱。

响应结果如下:

结果很容易理解,不过应该注意到直方图的键值是区间的下限。键 0 代表区间 0-19,999 ,键 20000 代表区间 20,000-39,999 ,等等。

当然,我们可以为任何聚合输出的分类和统计结果创建条形图,而不只是 直方图 桶。让我们以最受欢迎 10 种汽车以及它们的平均售价、标准差这些信息创建一个条形图。我们会用到 terms 桶和 extended_stats 度量:

GET /test-agg-cars/_search

{

"size" : 0,

"aggs": {

"makes": {

"terms": {

"field": "make.keyword",

"size": 10

},

"aggs": {

"stats": {

"extended_stats": {

"field": "price"

}

}

}

}

}

}

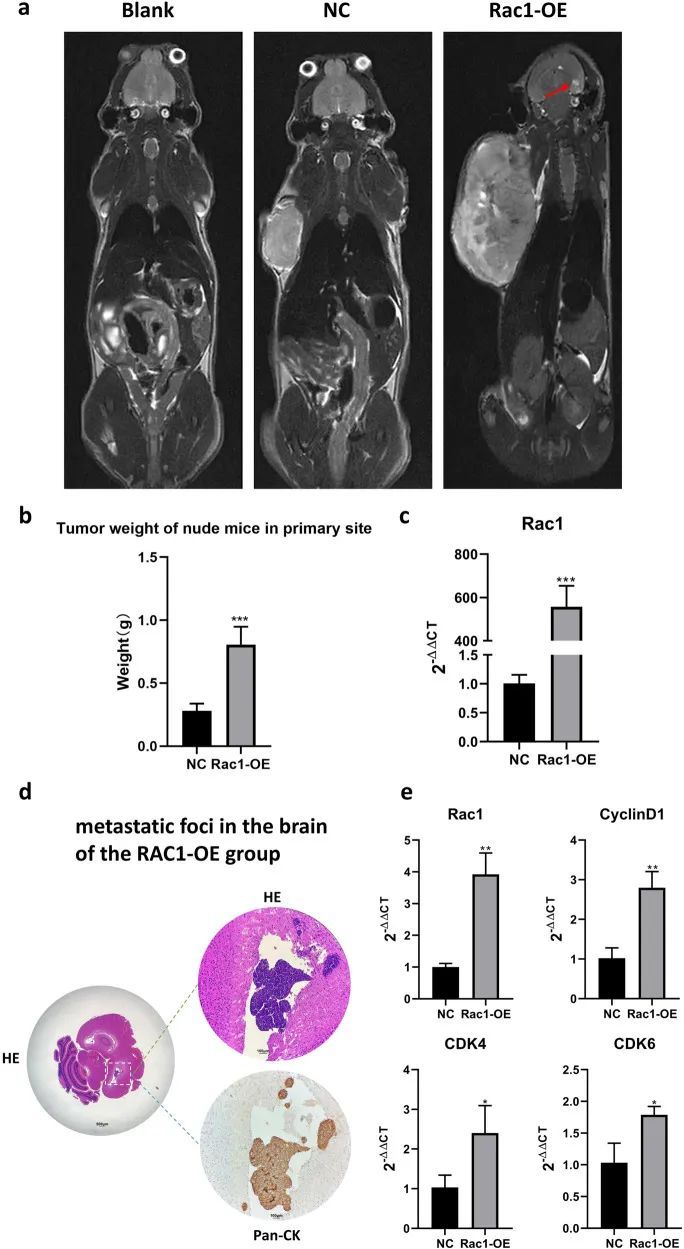

上述代码会按受欢迎度返回制造商列表以及它们各自的统计信息。我们对其中的 stats.avg 、 stats.count 和 stats.std_deviation 信息特别感兴趣,并用 它们计算出标准差:

std_err = std_deviation / count

报表:

聚合查询之 Metric 聚合

前文主要讲了 ElasticSearch提供的三种聚合方式之桶聚合(Bucket Aggregation),本文主要讲讲指标聚合(Metric Aggregation)。

如何理解metric聚合

在bucket聚合中,我画了一张图辅助你构筑体系,那么metric聚合又如何理解呢?

如果你直接去看官方文档,大概也有十几种:

那么metric聚合又如何理解呢?我认为从两个角度:

-

从分类看:Metric聚合分析分为单值分析和多值分析两类

-

从功能看:根据具体的应用场景设计了一些分析api, 比如地理位置,百分数等等

融合上述两个方面,我们可以梳理出大致的一个mind图:

-

单值分析: 只输出一个分析结果

-

cardinality基数(distinct去重) -

weighted_avg带权重的avg -

median_absolute_deviation中位值 -

avg平均值 -

max最大值 -

min最小值 -

sum和 -

value_count数量 -

标准stat型

-

其它类型

-

多值分析: 单值之外的

-

top_hits分桶后的top hits -

top_metrics -

geo_boundsGeo bounds -

geo_centroidGeo-centroid -

geo_lineGeo-Line -

percentiles百分数范围 -

percentile_ranks百分数排行 -

stats包含avg,max,min,sum和count -

matrix_stats针对矩阵模型 -

extended_stats -

string_stats针对字符串 -

stats型

-

百分数型

-

地理位置型

-

Top型

通过上述列表(我就不画图了),我们构筑的体系是基于分类和功能,而不是具体的项(比如avg,percentiles…);这是不同的认知维度: 具体的项是碎片化,分类和功能这种是你需要构筑的体系。

单值分析: 标准stat类型

avg 平均值

计算班级的平均分

POST /exams/_search?size=0

{

"aggs": {

"avg_grade": { "avg": { "field": "grade" } }

}

}

返回

{

...

"aggregations": {

"avg_grade": {

"value": 75.0

}

}

}

max 最大值

计算销售最高价

POST /sales/_search?size=0

{

"aggs": {

"max_price": { "max": { "field": "price" } }

}

}

返回

{

...

"aggregations": {

"max_price": {

"value": 200.0

}

}

}

min 最小值

计算销售最低价

POST /sales/_search?size=0

{

"aggs": {

"min_price": { "min": { "field": "price" } }

}

}

返回

{

...

"aggregations": {

"min_price": {

"value": 10.0

}

}

}

sum 和

计算销售总价

POST /sales/_search?size=0

{

"query": {

"constant_score": {

"filter": {

"match": { "type": "hat" }

}

}

},

"aggs": {

"hat_prices": { "sum": { "field": "price" } }

}

}

返回

{

...

"aggregations": {

"hat_prices": {

"value": 450.0

}

}

}

value_count 数量

销售数量统计

POST /sales/_search?size=0

{

"aggs" : {

"types_count" : { "value_count" : { "field" : "type" } }

}

}

返回

{

...

"aggregations": {

"types_count": {

"value": 7

}

}

}

单值分析: 其它类型

weighted_avg 带权重的avg

POST /exams/_search

{

"size": 0,

"aggs": {

"weighted_grade": {

"weighted_avg": {

"value": {

"field": "grade"

},

"weight": {

"field": "weight"

}

}

}

}

}

返回

{

...

"aggregations": {

"weighted_grade": {

"value": 70.0

}

}

}

cardinality 基数(distinct去重)

POST /sales/_search?size=0

{

"aggs": {

"type_count": {

"cardinality": {

"field": "type"

}

}

}

}

返回

{

...

"aggregations": {

"type_count": {

"value": 3

}

}

}

median_absolute_deviation 中位值

GET reviews/_search

{

"size": 0,

"aggs": {

"review_average": {

"avg": {

"field": "rating"

}

},

"review_variability": {

"median_absolute_deviation": {

"field": "rating"

}

}

}

}

返回

{

...

"aggregations": {

"review_average": {

"value": 3.0

},

"review_variability": {

"value": 2.0

}

}

}

非单值分析:stats型

stats 包含avg,max,min,sum和count

POST /exams/_search?size=0

{

"aggs": {

"grades_stats": { "stats": { "field": "grade" } }

}

}

返回

{

...

"aggregations": {

"grades_stats": {

"count": 2,

"min": 50.0,

"max": 100.0,

"avg": 75.0,

"sum": 150.0

}

}

}

matrix_stats 针对矩阵模型

以下示例说明了使用矩阵统计量来描述收入与贫困之间的关系。

GET /_search

{

"aggs": {

"statistics": {

"matrix_stats": {

"fields": [ "poverty", "income" ]

}

}

}

}

返回

{

...

"aggregations": {

"statistics": {

"doc_count": 50,

"fields": [ {

"name": "income",

"count": 50,

"mean": 51985.1,

"variance": 7.383377037755103E7,

"skewness": 0.5595114003506483,

"kurtosis": 2.5692365287787124,

"covariance": {

"income": 7.383377037755103E7,

"poverty": -21093.65836734694

},

"correlation": {

"income": 1.0,

"poverty": -0.8352655256272504

}

}, {

"name": "poverty",

"count": 50,

"mean": 12.732000000000001,

"variance": 8.637730612244896,

"skewness": 0.4516049811903419,

"kurtosis": 2.8615929677997767,

"covariance": {

"income": -21093.65836734694,

"poverty": 8.637730612244896

},

"correlation": {

"income": -0.8352655256272504,

"poverty": 1.0

}

} ]

}

}

}

extended_stats

根据从汇总文档中提取的数值计算统计信息。

GET /exams/_search

{

"size": 0,

"aggs": {

"grades_stats": { "extended_stats": { "field": "grade" } }

}

}

上面的汇总计算了所有文档的成绩统计信息。聚合类型为extended_stats,并且字段设置定义将在其上计算统计信息的文档的数字字段。

{

...

"aggregations": {

"grades_stats": {

"count": 2,

"min": 50.0,

"max": 100.0,

"avg": 75.0,

"sum": 150.0,

"sum_of_squares": 12500.0,

"variance": 625.0,

"variance_population": 625.0,

"variance_sampling": 1250.0,

"std_deviation": 25.0,

"std_deviation_population": 25.0,

"std_deviation_sampling": 35.35533905932738,

"std_deviation_bounds": {

"upper": 125.0,

"lower": 25.0,

"upper_population": 125.0,

"lower_population": 25.0,

"upper_sampling": 145.71067811865476,

"lower_sampling": 4.289321881345245

}

}

}

}

string_stats 针对字符串

用于计算从聚合文档中提取的字符串值的统计信息。这些值可以从特定的关键字字段中检索。

POST /my-index-000001/_search?size=0

{

"aggs": {

"message_stats": { "string_stats": { "field": "message.keyword" } }

}

}

返回

{

...

"aggregations": {

"message_stats": {

"count": 5,

"min_length": 24,

"max_length": 30,

"avg_length": 28.8,

"entropy": 3.94617750050791

}

}

}

非单值分析:百分数型

percentiles 百分数范围

针对从聚合文档中提取的数值计算一个或多个百分位数。

GET latency/_search

{

"size": 0,

"aggs": {

"load_time_outlier": {

"percentiles": {

"field": "load_time"

}

}

}

}

默认情况下,百分位度量标准将生成一定范围的百分位:[1,5,25,50,75,95,99]。

{

...

"aggregations": {

"load_time_outlier": {

"values": {

"1.0": 5.0,

"5.0": 25.0,

"25.0": 165.0,

"50.0": 445.0,

"75.0": 725.0,

"95.0": 945.0,

"99.0": 985.0

}

}

}

}

percentile_ranks 百分数排行

根据从汇总文档中提取的数值计算一个或多个百分位等级。

GET latency/_search

{

"size": 0,

"aggs": {

"load_time_ranks": {