1. 前言

之前介绍过卷积的基本概念,具体的可以参考图片的卷积和池化操作,这里给出可视化的操作,因为卷积在初学的时候比较抽象,现在有时间就写写看,希望可以给初学的同学一点启发吧(这里前提是学过pytorch和相关的图像处理库-opencv、pillow等,最低也要会安装库,不然代码都运行不起来)

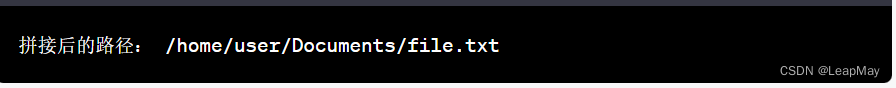

2. 开发环境配置

我使用的是pycharm,IDE根据自己的喜好,没有固定的要求(缺什么库,按照缺的去补,没人会手把手的教你,尽快转变思想,不要还是学生思想,工作了连指导都难)

| python | 3.6.9 |

| torch | 1.10.1 |

| torchbiomed | 0.0.1 |

| torchfile | 0.1.0 |

| torchsummary | 1.5.1 |

| torchvision | 0.11.2 |

| torchviz | 0.0.2 |

| Pillow | 8.4.0 |

3.参考代码

相关参数的说明:

这里我只定义了一层卷积,像多用几层的,把注释去掉就行(大聪明应该都看得懂的)

(1) 这里的每一个卷积的输出和下一个卷积的输入channels要对上!!!

比如:conv1:out_channels=9和conv2:in_channels=9要对的上,不然会报错,shape都不对了,肯定不对的,你们说呢。

(2) 那最后的out_channels要怎么定义?

回答:随便几个都行,定义几个就几张图输出(其实就是多少个卷积核的结果)

(3)聪明的你肯定要问了,那这些卷积核怎么来的,为什么有不同的结果?

回答:都是科研人员的经验,大多数都是验证过的参数在里面,比如有一些是提取整体特征,有一些提取边缘特征,反正不用你操心,想要深究去查资料(反正我讲不好,框架已经给你,就用吧)

self.conv1 = nn.Conv2d(in_channels=3, out_channels=9, kernel_size=3, padding=1) # self.conv2 = nn.Conv2d(in_channels=9, out_channels=12, kernel_size=3, padding=1) # self.conv3 = nn.Conv2d(in_channels=12, out_channels=16, kernel_size=3, padding=1) def forward(self, x): x = self.conv1(x) # x = self.conv2(x) # x = self.conv3(x) return x

import torch.nn as nn

import torchvision.transforms as transforms

from PIL import Image

import matplotlib.pyplot as plt

from pylab import *

def get_row_col(num_pic):

squr = num_pic ** 0.5

row = round(squr)

col = row + 1 if squr - row > 0 else row

return row, col

def visualize_feature_map(img_batch):

feature_map = img_batch

feature_map_combination = []

plt.figure()

num_pic = feature_map.shape[2]

row, col = get_row_col(num_pic)

for i in range(0, num_pic):

feature_map_split = feature_map[:, :, i]

feature_map_combination.append(feature_map_split)

plt.subplot(row, col, i + 1)

plt.imshow(feature_map_split)

axis('off')

plt.savefig('feature_map.png')

# plt.show()

# 读取图像并转换为Tensor

def load_image(image_path):

image = Image.open(image_path)

transform = transforms.Compose([

transforms.Resize((256, 256)),

transforms.ToTensor(),

])

return transform(image).unsqueeze(0) # 增加一个维度,使其成为batch为1的数据

# 定义简单的卷积模型

class SimpleConvNet(nn.Module):

def __init__(self):

super(SimpleConvNet, self).__init__()

self.conv1 = nn.Conv2d(in_channels=3, out_channels=9, kernel_size=3, padding=1)

# self.conv2 = nn.Conv2d(in_channels=9, out_channels=12, kernel_size=3, padding=1)

# self.conv3 = nn.Conv2d(in_channels=12, out_channels=16, kernel_size=3, padding=1)

def forward(self, x):

x = self.conv1(x)

# x = self.conv2(x)

# x = self.conv3(x)

return x

# 读取图片并进行卷积变换

image_path = 'cat.jpg' # 替换为你的图片路径'3.jpg'

input_image = load_image(image_path)

# 初始化模型并加载预训练的权重(或训练模型)

model = SimpleConvNet()

# 进行卷积变换

output_image = model(input_image)

output_image = output_image.detach().numpy()

# print(output_image.shape)

feature = output_image.reshape(output_image.shape[1:]).transpose(1, 2, 0)

# print(feature.shape)

visualize_feature_map(feature)

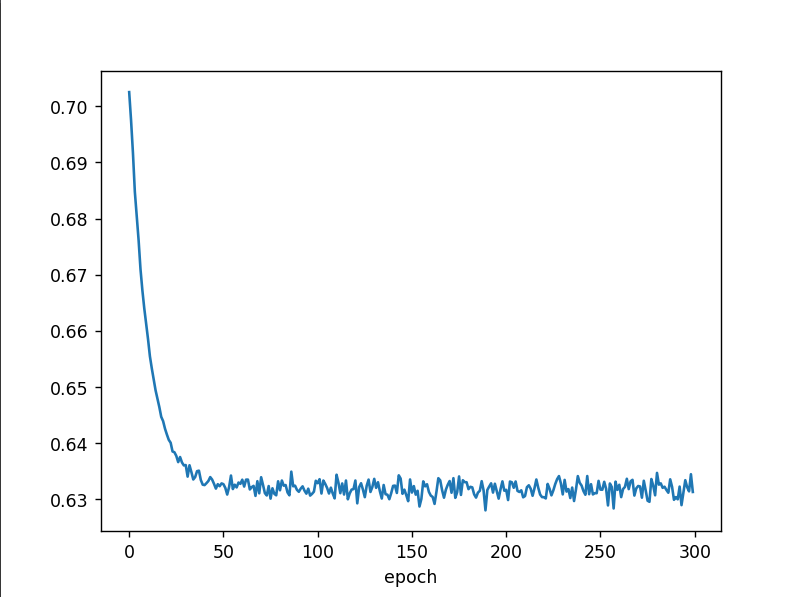

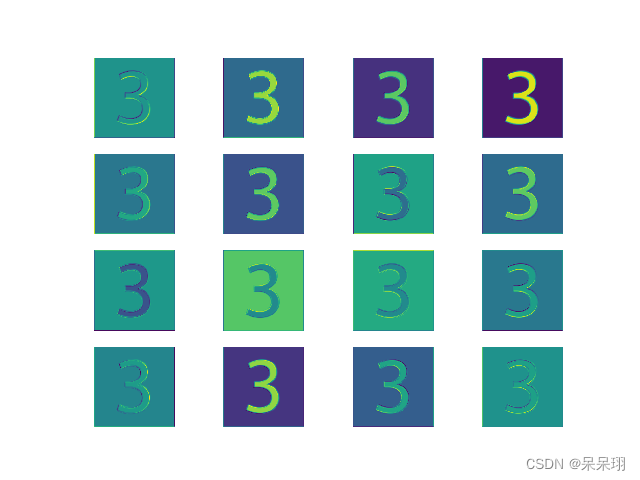

4. 结果展示

这里的图片你们自己换一个也可以,我这里提供两张,你们试试看

4.1 一层卷积的结果

4.2 两层卷积的结果

4.3 三层卷积的结果

![[CrackMe]Cruehead.2.exe的逆向及注册机编写](https://img-blog.csdnimg.cn/bae1f080560c48bf86faa218add09559.png)