1、Softmax Loss

公式

特点

Softmax鼓励不同类别的特征分开,但没有对特征分离的距离进行限制

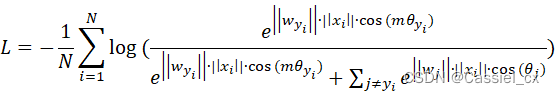

2、L-Softmax Loss

公式

特点

- 增加margin角度参数m,压缩类内角度范围,实现类内紧凑,增加类间决策边界间隔

- 参数m压缩了cos函数角度的单调区间,导致优化困难

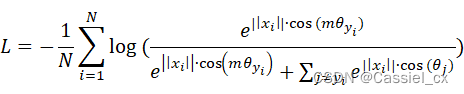

3、A-Softmax(SphereFace) Loss

公式

特点

归一化了权重W,使得||W||=1,让训练更加集中在优化深度特征映射和特征向量的角度上,降低样本数量不均衡的影响(ID数量越大,权重W的二范数也越大,W.shape=[embedding_size, cls_nums])

4、AM-Softmax(CosFace) Loss

公式

特点

- embedding特征x的二范数与图像质量相关,质量越好,x的模长越大,因此增加了特征归一化,使得||x||=1,让训练更加集中在优化特征向量的角度上,使得到的深度人脸特征更加分离

- 特征归一化后,特征向量都固定映射到半径为1的超球面上,压缩了特征表达空间,不利于模型收敛,因此引入缩放因子s,扩大特征表达空间,有利于模型收敛

- 把乘性margin改成加性margin

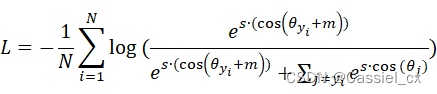

5、ArcFace Loss

公式

特点

在AM-Softmax的基础上修改,margin从余弦空间改到角度空间,直接在角度空间中最大化分类界限,而CosFace则是在余弦空间中最大化分类界限

6、MagFace Loss

公式

特点

把margin从常数项m改成了与特征模长(模长越大,图片越清洗,人脸上有更多的细节信息)相关的函数并额外引入了一个基于模长的惩罚项,对不同质量的图像施加的惩罚也不一样(较大的模长会有较大的角度惩罚,较小的模长会有较大的模长惩罚)

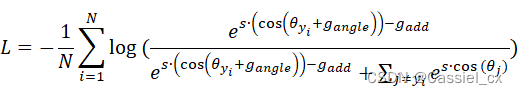

7、AdaFace Loss

人脸识别AdaFace学习笔记_Cassiel_cx的博客-CSDN博客

公式

特点

- 论文讲解了缩放参数s和margin参数m在不同取值时是如何影响模型训练并给出自适应参数调节函数

- 重点挖掘和加强:质量较高的图像中的困难样本、质量较低的图像中的简单样本,同时减轻对质量较低的图像中的困难样本的关注(如果让模型去关注质量较低的图像中的困难样本,模型很可能学习到如衣服颜色等非人脸特征信息)

【参考文献】

人脸识别的LOSS(上) - 知乎

人脸识别的LOSS(下) - 知乎

人脸识别Loss总结【最全思维导图】 - 知乎

人脸识别loss总结 - 知乎