IFSepR: A General Framework for Image Fusion Based on Separate Representation Learning

(IFSepR:一种基于分离表示学习的通用图像融合框架)

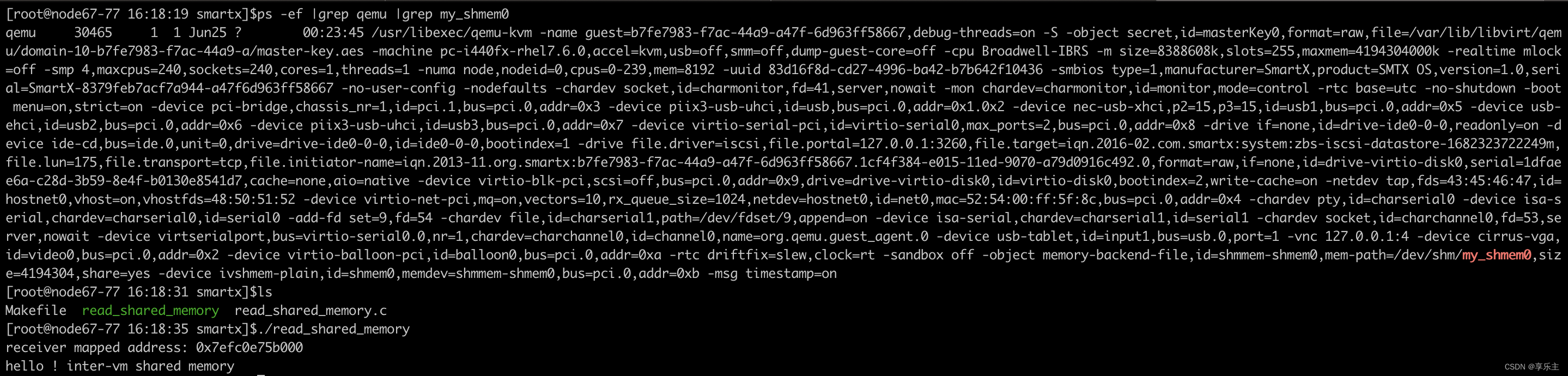

提出了一种基于分离表示学习的图像融合框架IFSepR。我们认为,基于先验知识的共模态图像和多模态图像都具有共同特征和私有特征,利用这种非纠缠表示方法可以帮助图像融合,特别是融合规则的设计。受自编码器网络和对比学习的启发,构建了一个具有对比约束的多分支编码器来学习成对图像的公共和私有特征。在融合阶段,基于解纠缠后的特征,设计通用的融合规则,将融合后的私有特征与公共特征进行融合,然后将融合后的私有特征与公共特征一起送入解码器,重构融合图像。我们对三种典型的图像融合任务,包括多聚焦图像融合,红外和可见光图像融合,医学图像融合进行了一系列的评估。

图像融合是图像处理领域的一个重要分支。图像融合可以弥补使用单个传感器的缺点,使融合后的图像包含更多的可靠信息。在数码摄影领域,同一场景的多焦点图像可以在不同焦距设置下融合,获得清晰的全焦点图像;在军事或民用监视系统中,红外和可见光图像的融合可以带来更多的可观测信息,有利于环境监测;在医学图像领域中,计算机断层扫描图像(CT)、磁共振图像(MRI)和增强磁共振图像(GAD)显示关于疾病的各种信息以用于可靠的诊断。图像融合方法一般可分为基于变换域的方法和基于空间域的方法。

基于空间域的方法通常将整个源图像划分为许多小块,并根据设计的融合规则对每对块进行融合。这类方法主要用于融合具有一致模态的图像,限制了它在某些特定任务中的应用。

基于变换域的方法通常将源图像变换到特征域,然后在变换后的空间上进行特征融合操作,最后通过逆变换重建融合图像。最经典的融合方法是基于多尺度变换(MST),其中大量的融合方法已经出现。最近的发展集中在使用先进的信号表示理论,如独立分量分析(ICA)和稀疏表示(SR)。而传统的基于变换域的融合方法的性能很大程度上依赖于变换工具和每个融合过程的手工设计,其复杂度高导致计算量大,限制了融合实时任务的应用。近年来,深度学习在图像融合方面变得越来越有效。卷积神经网络(CNN)因其在图像特征提取方面的强大能力而受到广泛关注。Liu等人采用CNNA作为焦点检测,将多焦点图像分为清晰和模糊部分。为了推广到多模态图像融合中,他们进一步使用所获得的决策图来融合MST系数。该方法构建了一个用于共模态图像特征学习的单片编码器,忽略了图像之间的潜在关系。遵循单片编码器框架,Li等人采用了一种经过良好训练的自编码器从图像中提取特征,然后设计了一种融合策略,在重构前对特征进行融合。但该方法只讨论了红外与可见光的融合任务。Zhang等人在合成的多焦点数据集上训练了一个简单的四层CNN,并使用choose-max规则融合中间特征,这在不同的图像融合任务中表现出很强的泛化能力,并证明在数据驱动的图像融合领域,特征学习和重建这两个关键步骤可以通过交叉模态学习来训练。然而,如何解析多模态图像之间的关系仍然是一个悬而未决的问题。将图像融合到生成对抗网络(GAN)是另一个最近的发展。Ma等人首先采用GAN融合红外图像和可见光图像。它们的内容损失函数使融合图像同时具有红外辐射和可见光梯度信息,并且生成器和鉴别器之间的最小-最大博弈有助于引入更多的可见细节。尽管GAN具有更好的自适应能力,但融合步骤的可解释性不足,这破坏了基于GAN的方法被推广到更多模态。总体而言,基于深度学习的图像融合方法已经取得了先进的性能,但仍存在一些局限性:(1)上述基于CNN的方法同等地处理来自源图像的特征,忽略相应的模态特征;(2)大多数方法处理单一的融合任务,对各种模态的泛化能力有待进一步验证。因此,有必要利用共模态图像之间的关系,并开发一个更通用的图像融合框架。为了探索多个数据源之间的内在相关性,已经提出了许多方法。基于多视图表示学习,Liu等人提出了一种揭示数据间一致性和互补关系的半监督算法。基于子空间学习,Li 等人通过利用几何结构中的局部和全局一致性,进一步弥合低级空间特征和高级语义信息的差异。实际上,利用自动编码器中的潜在数据结构和先验知识可以促进解纠缠特征学习,并且将先验知识联合嵌入深度网络可以使下游计算机视觉任务受益。具体而言,对于图像融合,成对的源图像之间总是存在冗余和互补关系。冗余特征通常代表共享结构,而互补特征反映了融合过程中的关键成分的排他性信息。通过学习这种关系,应提高的可解释性的特征,这有利于设计一个良好的定向融合过程。

根据上述考虑,我们的目标是发现一个解开的共同和独特特征的潜在空间,这是适合于图像融合的自动编码器框架下。本文提出了一种三码流的自动编码器,两个流的独特特征和一个共同的特征,本文提出。该方法将公共特征和独特特征结合起来分别重建成对的图像,然后对这些特征进行融合运算,得到相应的融合图像。然而,如果没有适当的约束,神经网络将倾向于给予一个平凡的解决方案在解开,保留几乎所有的信息在独特特征。近年来对比学习的突破,为我们提供了解决这一问题的视角。Chen等人提出了一个具有对比交叉熵损失的简单框架,以最大化来自同一类别但具有不同视图的目标的潜在表示之间的相似性,并有效提高分类任务的准确性。Mei等人使用对比三元组损失对预训练的网络进行了微调,以改善表示,从而解开人类感知相关和不相关维度,从而在图像翻译任务中保持良好的视觉质量。受他们工作的启发,设计了差异损失,以确保公共和私人特征的解开。此外,为了促进自动编码器的特征学习,经过良好训练的分类网络VGG19 的一部分被转移到编码层中。此外,为了提高算法在不同类型图像融合任务中的泛化能力,设计了一种能更好地适应不同图像融合任务的融合规则。为了证明我们的方法的有效性,我们定量和定性地评估它对三个图像融合任务:多焦点融合、红外和可见光融合以及多模态医学图像融合。

综上所述,所提出的方法的贡献如下:

1)本文提出了一种新的解纠缠特征学习方法,实现了深度学习框架下的图像融合。该算法利用三流自动编码器中的公共和私有特征,提高了潜在呈现的可解释性,为设计精确的融合规则提供了帮助.设计了一种对比度差损失,以提高所提出的自动编码器的解缠能力。

2)提出了一种自适应融合策略,该策略综合考虑图像各位置所包含的能量,选择合适的融合规则,能够更好地保留重要信息。

3)所提出的方法提供了一个通用的框架,它可以在多聚焦,红外和可见光,以及医学图像融合任务中获得有竞争力的性能。

RELATED WORK

最近,已经提出了许多基于深度学习的图像融合方法。由于图像融合数据集没有地面真值,经过良好训练的自动编码器被广泛使用,它可以学习更鲁棒和层次化的特征。为了解决多曝光图像融合问题,Prabhakar提出了一种具有两个编码层和三个解码层的自动编码器。同时,权重共享解码层可以减少网络参数。通过融合层中的简单处理,可以将学习到的特征合并到解码层中,以获得重建的曝光图像。为了将先验知识纳入特征学习,Baruch Epstein提出了一种具有多任务并行结构的自动编码器。该模型由公共分支和私有分支组成。公共分支倾向于通过在训练期间共享权重来学习公共特征,而私有分支不共享权重并且倾向于学习独特特征。虽然图像融合中的一些数据具有不同的模态,但在同一视场内采集的图像具有相似的特征,因此它们的共同特征和私有特征可以看作是先验知识的关系,区分这种关系在图像融合过程中具有重要意义。

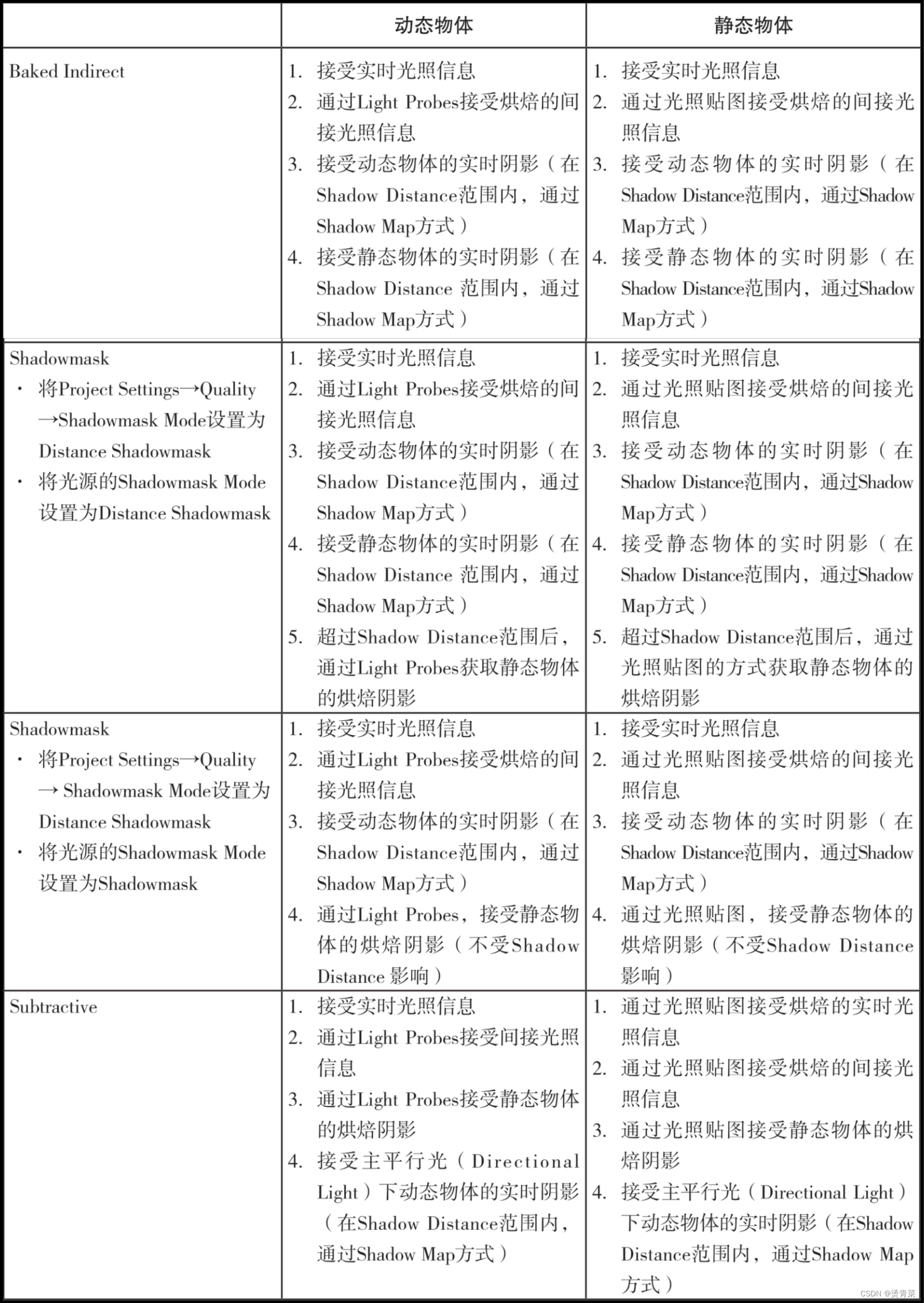

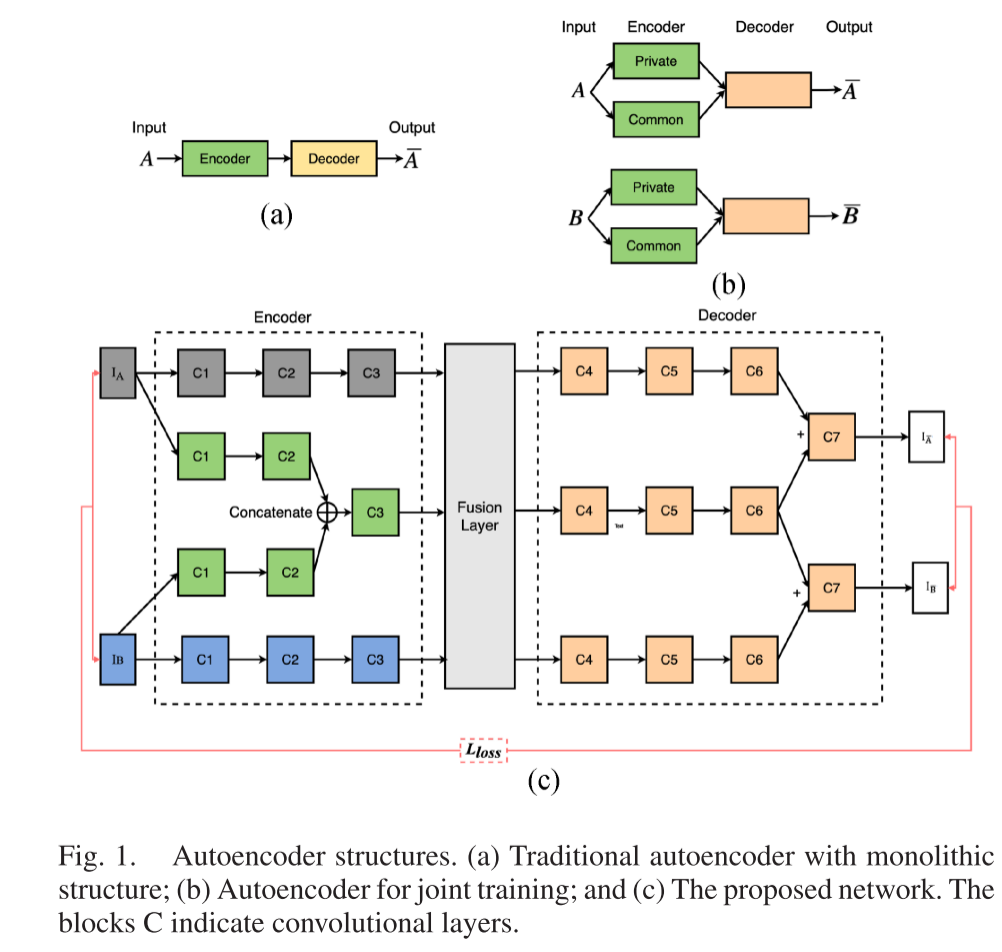

传统的自动编码器如图1(a)所示。以图像A为例。A是输入图像,并且通过对从编码部分的卷积层提取的特征进行解码来重构图像A。重建过程被示出为以下等式:

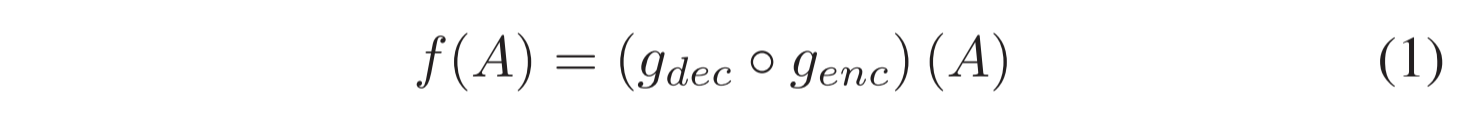

在图像融合任务中,图像A和图像B是在同一场景中捕获的,因此它们具有公共特征信息和私有特征信息。通过应用先验知识,可以将自动编码器网络修改为如图1(b)所示的多流结构。重建方程如下所示:

每个源图像,编码器被划分为公共分支和私有分支。中间的公共分支学习两个图像的公共特征。之后,通过共享权重的解码层重构图像。与在各自特征空间中编码的源图像相比,该网络结构中的私有分支和公共分支能够更好地分离和表达图像特征。以图像A为例。(

g

A

g^A

gAdec ◦

g

P

A

g^PA

gPAenc)是图像A私有分支的编码过程和解码过程,而(

g

A

g^A

gAdec ◦

g

C

A

g^CA

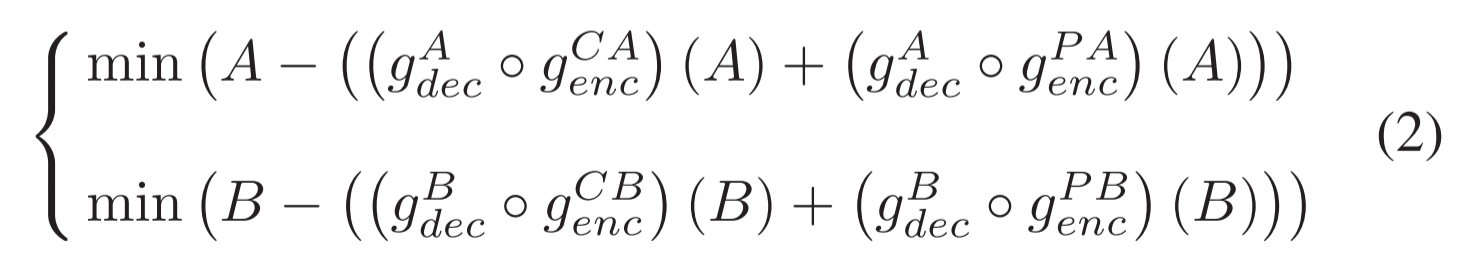

gCAenc)(A)是图像A公共分支的编码过程和解码过程。可以通过组合来自公共分支和私有分支的特征来获得重建图像 -A。同样的事情可以用图像B进行。然而,在上述自动编码器中,图像A和B的公共分支不能提取真实的的共享信息。即使采用权重分担方法,图像A的公共部分和图像B的公共部分也经常不相等。同时,公共特征提取的不完全会影响到私有特征,进而影响到最终的融合图像。为了更好地提取图像的私有和公共特征,我们在图1(c)中设计了如下的网络结构,私有分支专注于区分与公共分支不同的特征,而公共分支学习图像A和B中的特征。为了实现两个图像的单独表示,学习过程的等式简单地总结如下:

然而,仅依靠多分支自动编码器模型仍然难以准确区分一对图像的公共特征和私有特征。因此,对比学习方法的流行也给了我们启发。

对比学习方法的目的是学习编码器F,得分函数score(f(x),f(x+))和score(f(x),f(x-)),其中x+是与x相似或等于x的数据点,即阳性样本。x-是不同于x的数据点,即阴性样本得分函数是测量两个特征之间的相似性的指标。基于这些观察,我们在训练阶段向自动编码器添加评分函数,以最大限度地区分图像特征的公共部分和私有部分。同时,我们使用分数作为损失函数的一部分来实时训练我们的网络,以达到分离表示学习的目的。

PROPOSED METHOD

我们的网络架构包括三个部分:编码层、融合层和解码层。在编码层,公共分支和私有分支独立训练,但在解码层,输入图像通过共享权重重构。整个过程分为两个阶段:第一阶段是特征学习阶段,第二阶段是融合阶段。

Disentangled Feature Learning

在特征学习阶段,通过图像重构的训练过程实现了自动编码器的解缠特征提取能力。我们使用一对图像A和B作为编码器的单独私有分支的输入,以学习单个特征。对于公共分支,A和B首先被输入到它并且由前两个共享层处理以获得与私有特征不同的相应特征。然后,将A和B的特征连接在一起到卷积层,以提取A和B中的共同特征。接下来,在解码部分的最后一层中,将从中提取的公共特征与源图像A和源图像B的私有特征组合,以分别重构源图像-A和-B-。

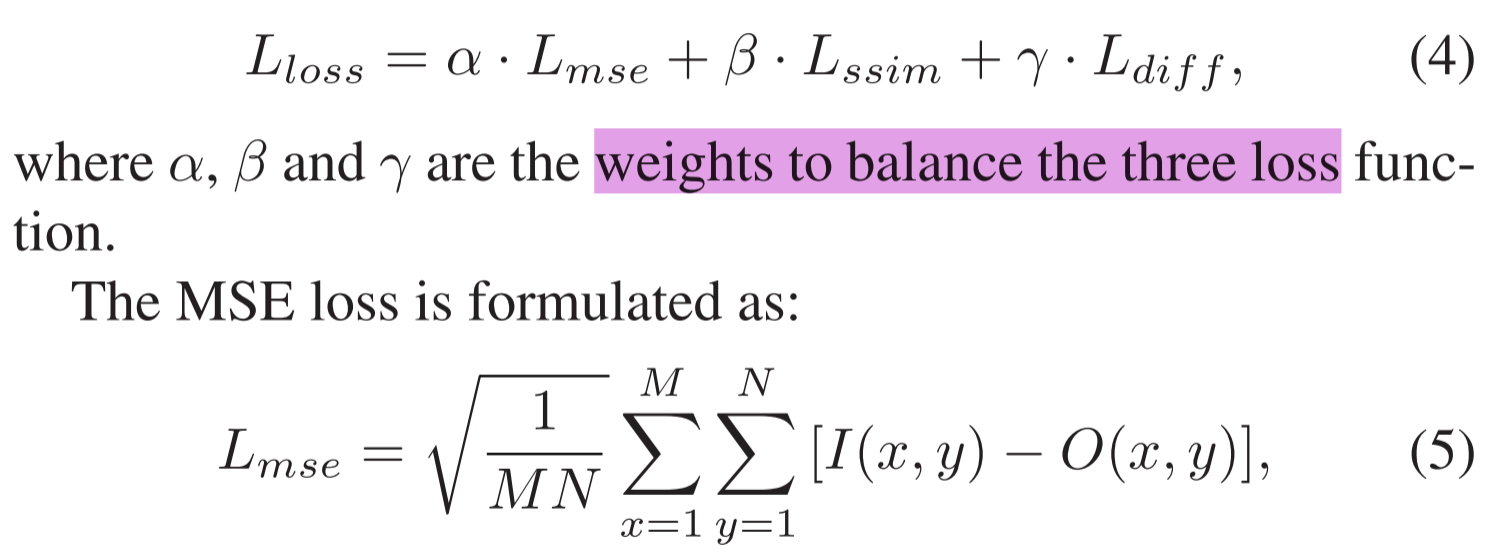

为了更准确地重建输入图像,我们最小化输出和输入图像之间的损失函数Lloss来训练我们的编码器和解码器:

其中M和N分别是图像的宽度和高度。I(x,y)是输入图像的像素矩阵,O(x,y)是重建图像的像素矩阵。Lmse可以引导网络拟合图像的像素,使间隙最小化。同时,我们增加了结构相似度(SSIM)Lssim,使其在训练过程中更好地保持结构完整性成为可能。

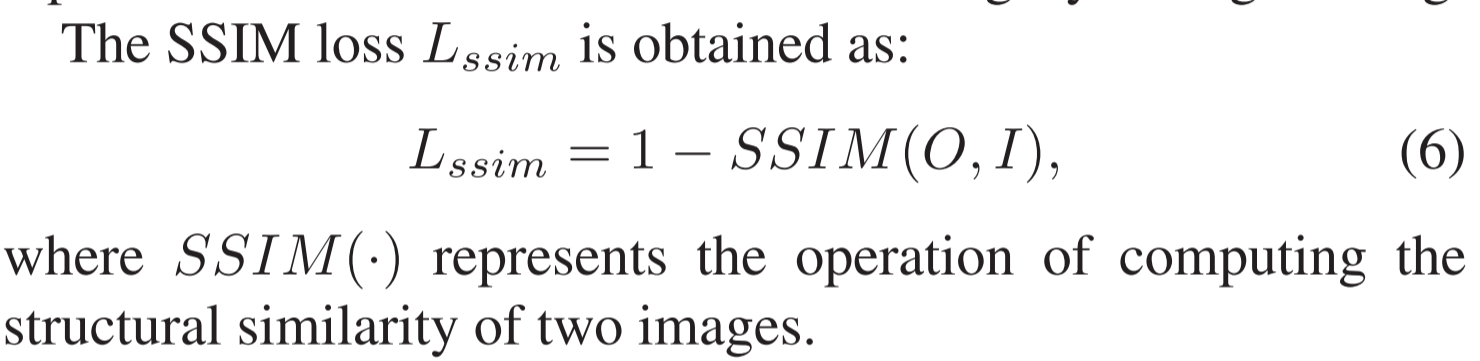

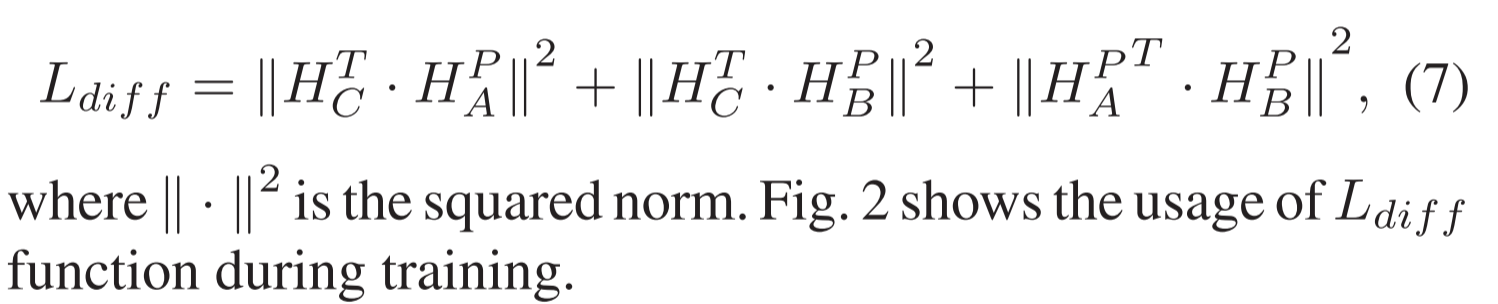

此外,我们在训练阶段添加了对比学习函数Ldiff,以鼓励公共和私有编码器对输入的不同方面进行编码。HC表示图像的隐藏公共表示。

H

P

H^P

HPA和

H

P

H^P

HPB是输入图像A和B的私有表示。差异损失通过最小化公共表示和私有表示之间的点积来扩大差异的程度。同时,为了减少两个私有分支提取的特征的交集,我们还对两个私有特征

H

P

H^P

HPA和

H

P

H^P

HPB的子空间进行点积运算:

Network Structure

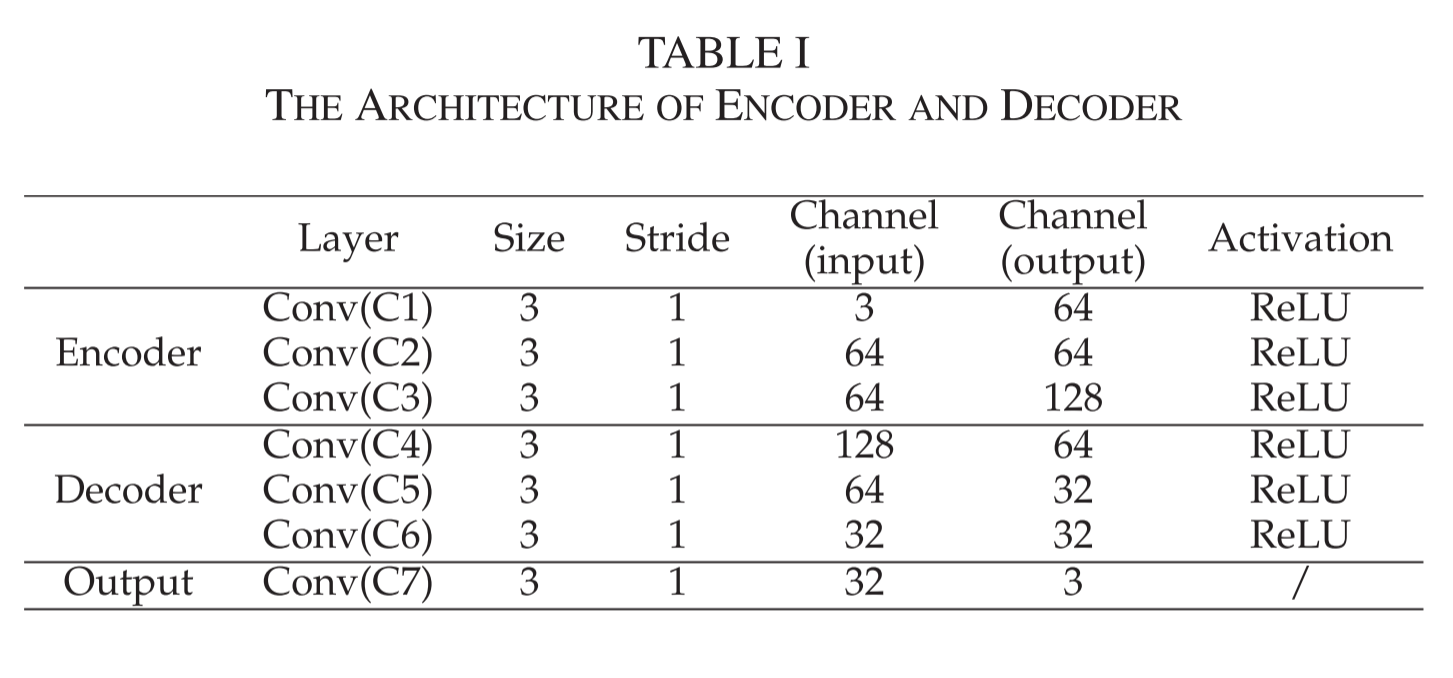

VGG19在特征学习方面有很好的能力,可以从与像素和边缘相关的低层特征中学习,抽象出高层语义特征,而图像融合则更侧重于从底层学习的低层特征。为了提高网络训练的速度和精度,我们选择VGG19网络的前三个卷积层作为网络的编码层,通过使用VGG19网络的前三个卷积层的权值来初始化编码层。我们的详细参数如表I所示。

Fusion Layer

当模型在训练阶段之后能够重建源图像并提取相应的特征时,模型可以进一步用于融合任务。在融合阶段,一对源图像A、B被输入到编码器网络以分别获得公共特征和私有特征。然后,通过前三个解码器层重建公共和私有特征,然后基于设计的融合策略进行合并。最终的融合图像通过解码器中的最后一层重建。

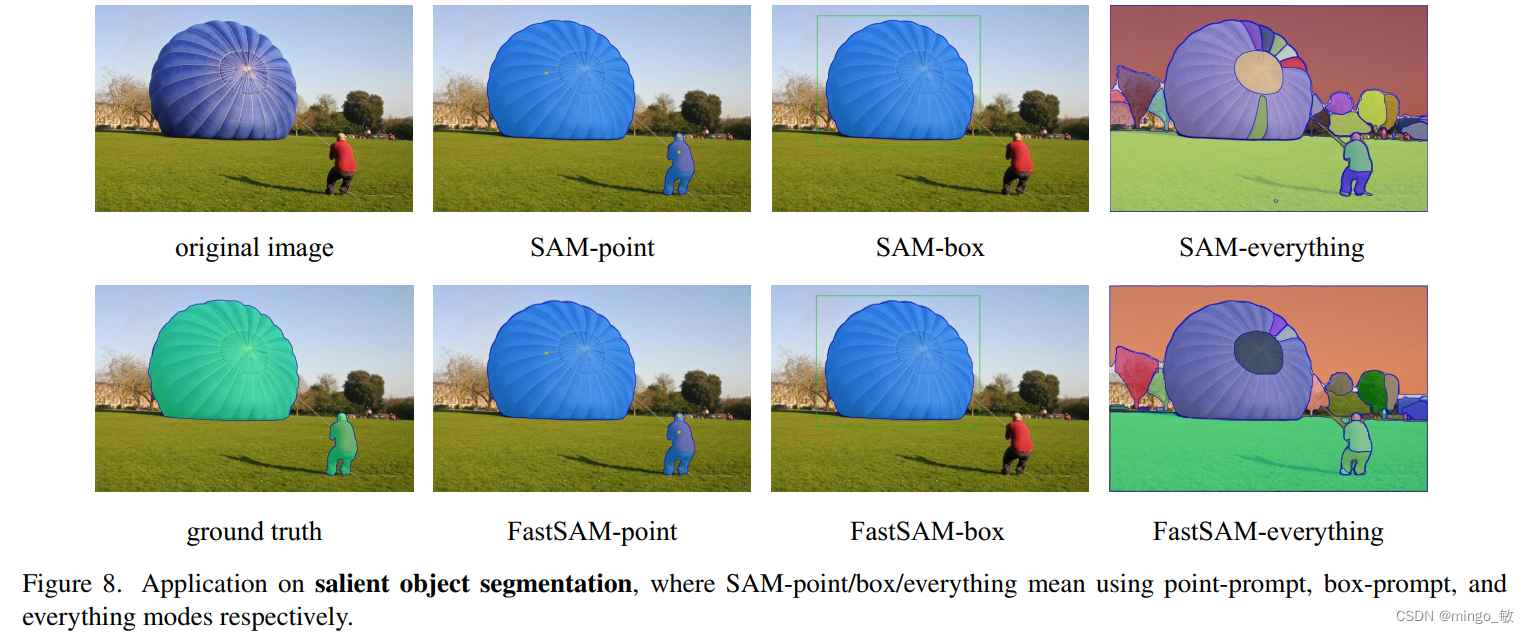

由于提取的共同特征是冗余的,代表共享的形状和结构信息,在两个源图像中,我们只需要设计私有特征的两个私有分支,代表互补的特征的融合规则。而互补关系可以反映不同类型源图像的不同特征。在共模态输入图像(例如,图7中的热气球的多焦点图像)的情况下,可以使用多焦点图像),通过取两个共模态图像特征的最大值可以获得最佳效果,因为它们之间的互补信息在于像边缘和线的高频细节。然而,当两个图像是多模态图像时,多模态图像对的特征倾向于在私有特征空间中具有不同重要性级别的分层信息。基于这些考虑,我们提出了一种自适应的融合策略,在特征空间,以确保保留互补信息。

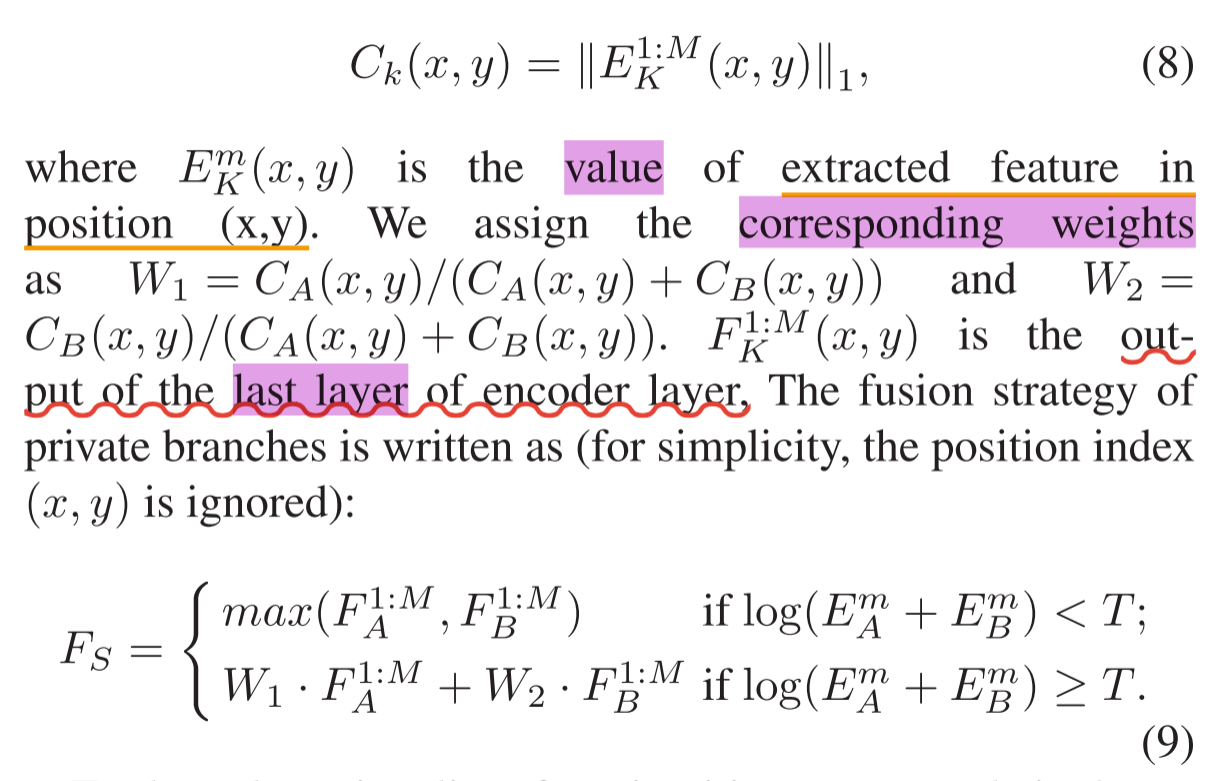

我们给出了两个活性测度

E

m

E^m

EmK(K ∈{A,B})和CK。M表示特征图的总数,并且m代表特征图中的通道索引。当两幅图像的总信息量log(

E

m

E^m

EmA +

E

m

E^m

EmB)小于阈值T时,采用选择最大规则,否则采用L1范数规则。

E

m

E^m

EmK的L1范数可以是特征图的活动水平度量。因此,初始活动水平图Ck(x,y)被计算为:

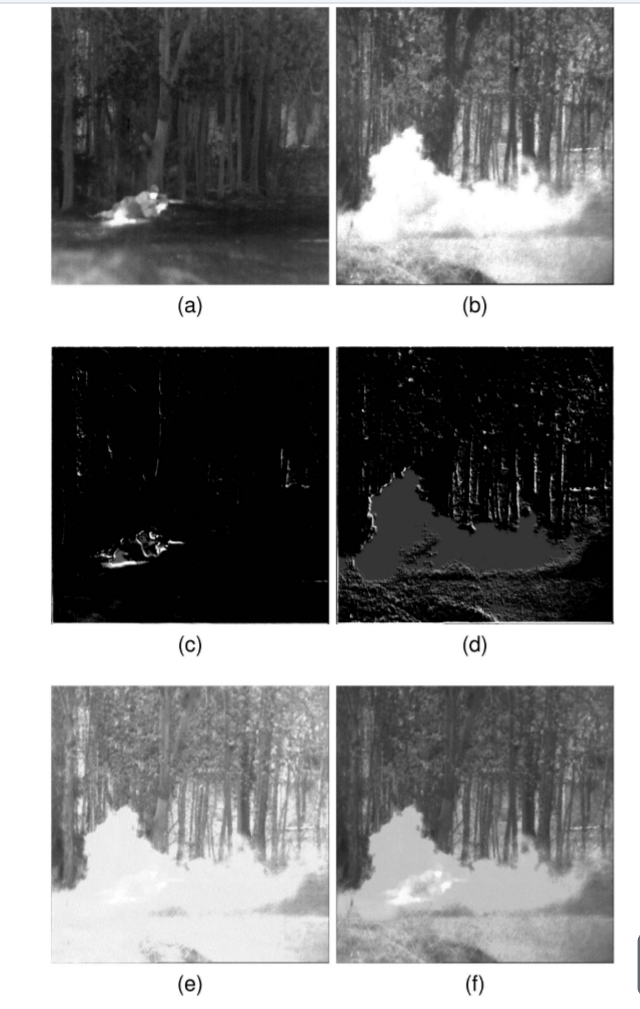

为了说明我们的直觉的合理性,图1给出了一个例子。3比较自适应策略和选择最大策略。图3(a)和图3(b)是红外和可见光图像。3(c)和图图3(d)是它们对应的提取的私有特征。图3(c)包含人的热辐射信息,而在图3(c)中包含人的热辐射信息。在图3(d)中,人被烟雾遮蔽,并且仅提取烟雾的信息。来自私有分支的显著特征表现出相同的特征,即。高能量。在融合的过程中,我们希望既能提取出人的信息,又能提取出烟雾的信息。

基于choose-max策略和自适应融合策略的融合结果如图所示。3(e)和图3(f)分别。显然,简单地采取选择最大规则会导致重要信息的丢失,并且人的信息几乎被烟雾信息覆盖,然而图1B显示了烟雾的信息。3(f)不仅可以保存烟雾,而且可以确保人的区别。由于choose-max策略保留了高能量的信息,这将降低对两个显著信息的识别,而自适应融合策略考虑了所提取的特征中包含的能量。当两个私有特征中的能量太低时,这意味着信息不重要,则选择最大规则足以确定更重要的一个。当能量过高时,采用L1范数,根据特征的重要性水平为两个特征分配权值,使两个特征都能保持层次性,验证了自适应策略的有效性。