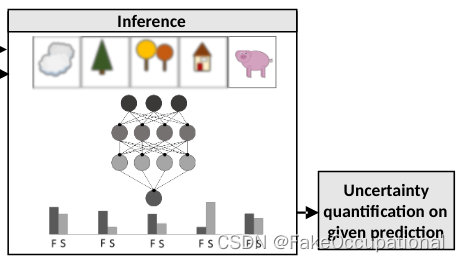

- 随着深度学习技术的不断发展,DNN模型的预测能力变得越来越强,然而在一些情况下这却并不是我们想要的,比如说给模型一个与训练集完全不相关的测试样本,我们希望模型能够承认自己的“无知”,而不是强行给出一个预测结果,这种能力对于自动驾驶或者医疗诊断等重视风险的任务是至关重要的。因此,为了达到这个目的,我们的模型需要具有量化不确定性的能力,对于那些它没有把握的样本,模型应该给出较高的不确定性,这样就能指导我们更好地利用模型的预测结果。

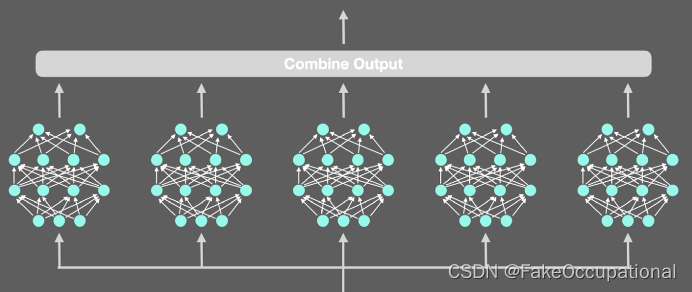

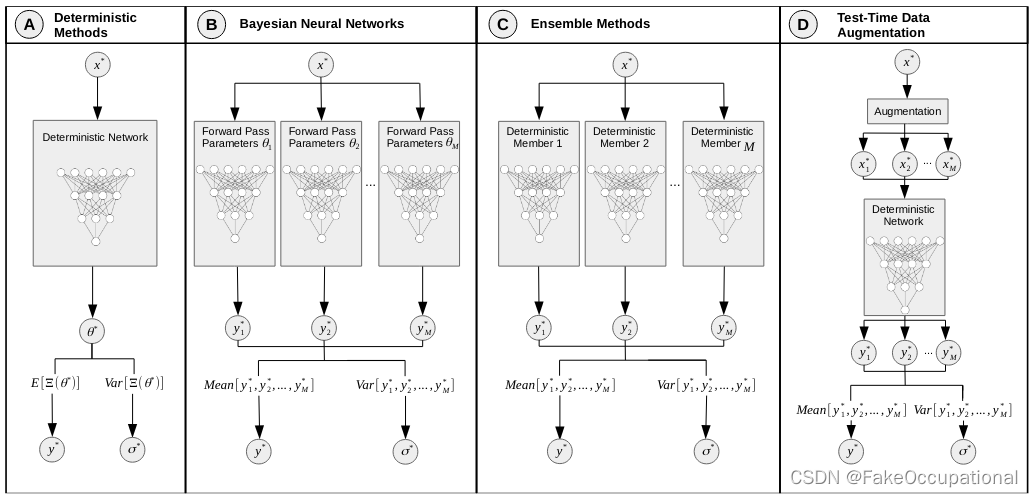

与其使用一个模型并预测5次,不如使用同一类型的多个模型,随机初始化它们的权重,并根据相同的数据对它们进行训练。

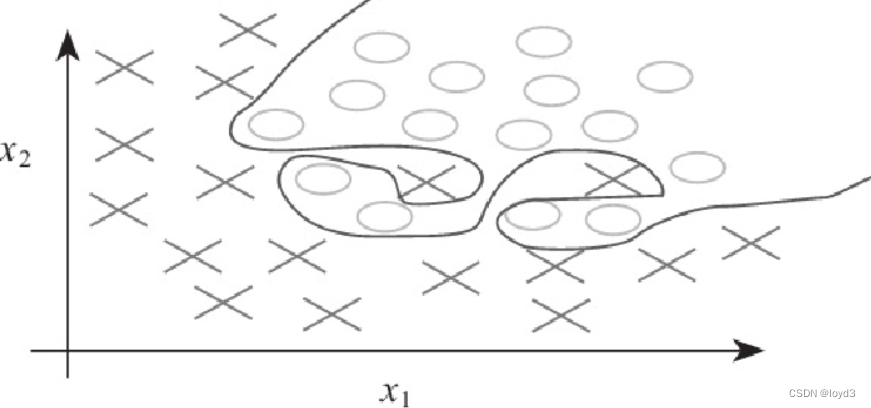

多个神经网络集成的可视化:

这也将在模型参数中创建变化。如果模型经过稳健训练,并且对图像有把握,它将为每个前向传播输出类似的值。

- for OOD data even same data can generate different out put

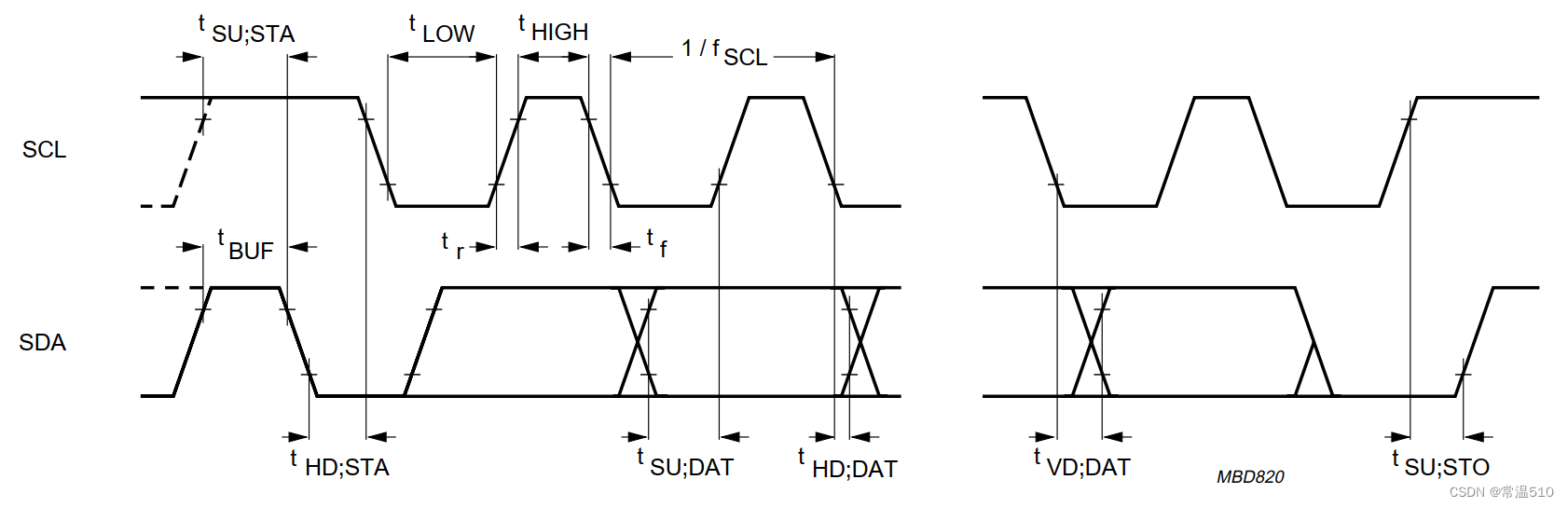

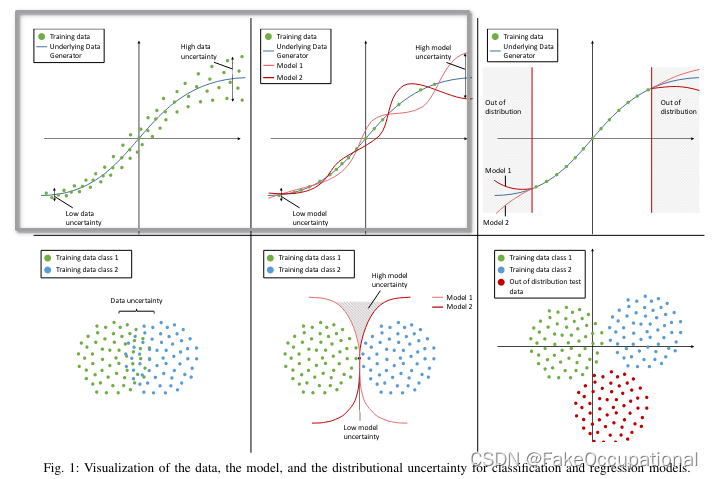

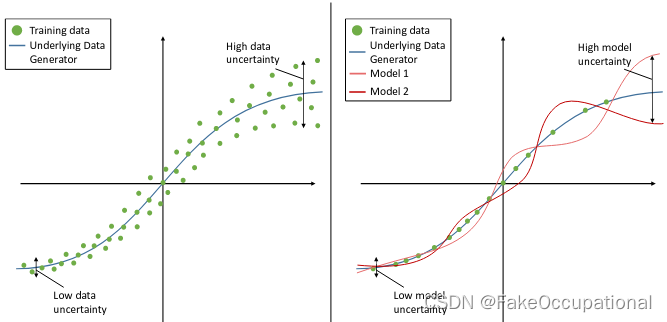

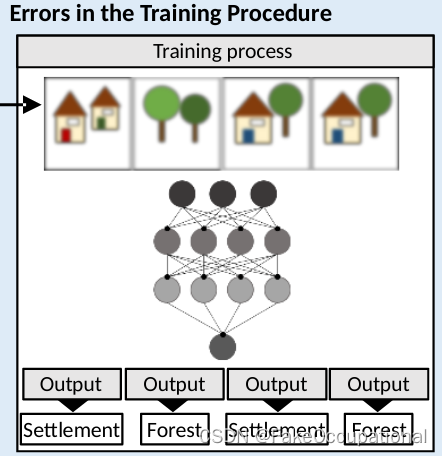

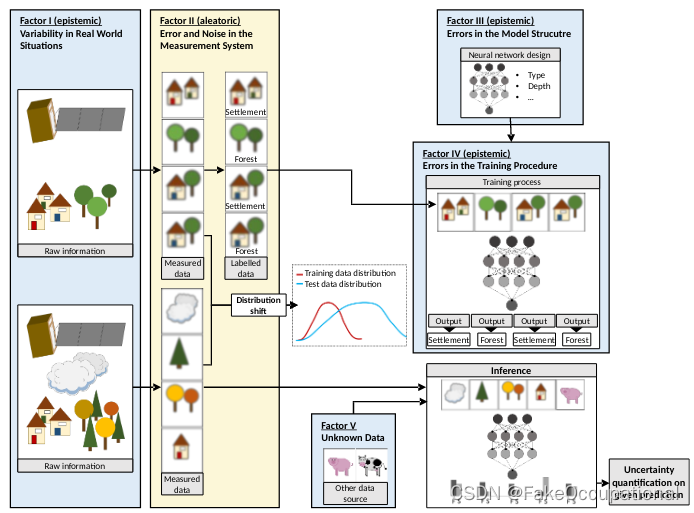

该图显示了神经网络管道的不同步骤,基于基于光学图像的土地覆盖分类(此处为定居点和森林)的地球观测示例。框中突出显示了影响预测不确定性的不同因素。因子I被云覆盖的树木、不同类型和颜色的树木显示为环境的变化。因子II的表现是测量不充分,不能直接用于区分居民点和森林以及标签噪声。实际上,这种图像的分辨率可能很低,这也是因素II的一部分。因子III和因子IV分别表示网络结构和随机训练过程引起的不确定性。相比之下,因子V通过用未知类型的图像(即奶牛和猪)喂养训练网络来表示

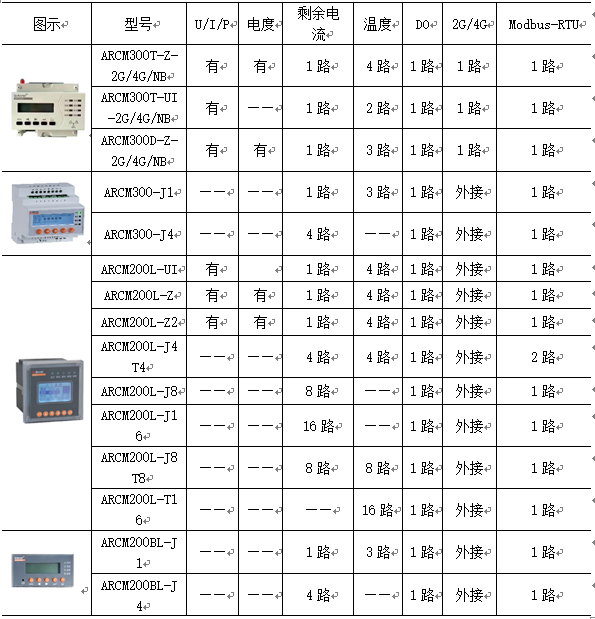

- 概述了本文中提出的四种通用方法,即贝叶斯神经网络、集成、单确定性神经网络和测试时间数据增强。高和低的标签是相对于其他方法给出的,并基于它们背后的一般思想。

| 单确定性网络 | Bayesian Methods | Ensemble Methods | Test-Time Data Augmentation | |

|---|---|---|---|---|

| Description | 直接通过网络预测 | 模型参数被明确地建模为随机变量。对于forward,参数从该分布中采样。因此,预测是随机的,每个预测都基于不同的模型权重。 | 将几个模型的预测合并为一个预测。单一模型的多样性至关重要。 | 推断时的预测和不确定性量化基于原始输入样本的不同扩增产生的若干预测。 |

| Description of Model Uncertainties | N | Y | N | N |

| 是否需要修改网络结构 | 不确定 | Y | Y(可能需要多次训练) | N |

| 对初始化和培训过程参数的敏感性 | High (in general) | Low(Usage of uninformative priors possible) | Low | Low |

| Number of networks trained | 1 | 1 | N | 1 |

| 训练期间的计算工作量 | L | H | H | L |

| Forward passes per prediction | 1 | N | N | N |

| Computational effort during inference | L | H | H | H |

| Memory Consumption Inference | L | L | H | L |

CG

A Survey of Uncertainty in Deep Neural Networks

https://blog.csdn.net/c9Yv2cf9I06K2A9E/article/details/118885847