kubernetespod控制器详解2与service详解1

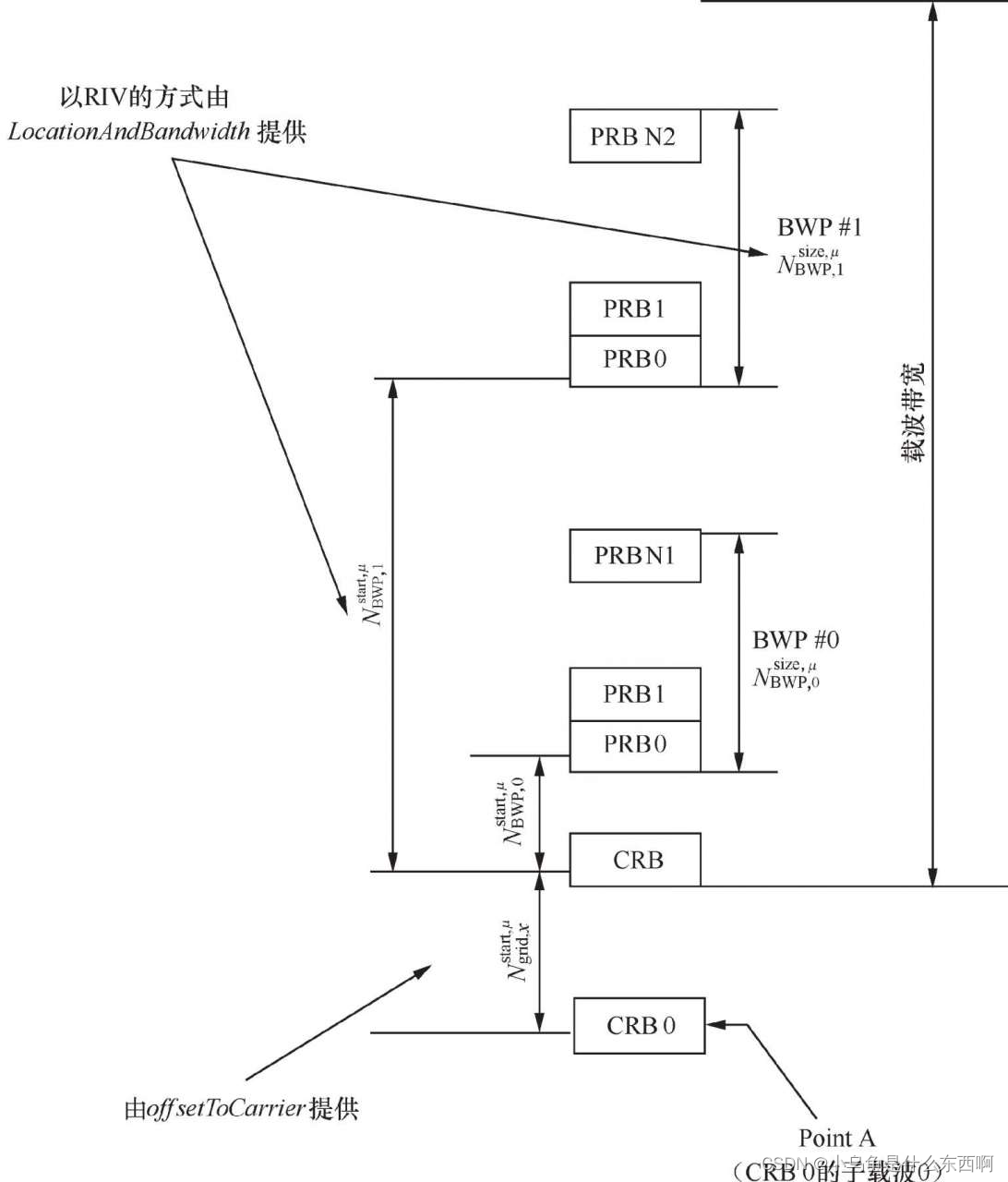

Horizontal Pod Autoscaler(HPA)

Kubernetes期望可以实现通过监测Pod的使用情况,实现pod数量的自动调整,于是就产生了Horizontal Pod Autoscaler(HPA)这种控制器。

HPA可以获取每个Pod利用率,然后和HPA中定义的指标进行对比,同时计算出需要伸缩的具体值,最后实现Pod的数量的调整。其实HPA与之前的Deployment一样,也属于一种Kubernetes资源对象,它通过追踪分析RC控制的所有目标Pod的负载变化情况,来确定是否需要针对性地调整目标Pod的副本数,这是HPA的实现原理。

安装metrics-server

[root@master ~]# yum install git -y

[root@master ~]# git clone -b v0.3.6 https://github.com/kubernetes-incubator/metrics-server

[root@master ~]# cd /root/metrics-server/deploy/1.8+/

在https://github.com/kubernetes,找metrics-server,找到最新的版本,将最新版本的yaml文件下载到本地中来,然后进行修改

[root@master ~]# git clone -b v0.3.6 https://github.com/kubernetes-incubator/metrics-server

spec:

hostNetwork: true //增加此处

containers:

- args:

- --cert-dir=/tmp

- --secure-port=4443

- --kubelet-preferred-address-types=InternalIP,ExternalIP,Hostname

- --kubelet-use-node-status-port

- --metric-resolution=15s

- --kubelet-insecure-tls //增加此处

image: registry.cn-hangzhou.aliyuncs.com/goole_containers/metrics-server:v0.6.2 修改此处

安装metrics-server并查看pod运行状态

[root@master 1.8+]# kubectl apply -f components.yaml

[root@master 1.8+]# kubectl get pod -n kube-system

metrics-server-6b976979db-2xwbj 1/1 Running 0 42s

[root@k8s-master01 1.8+]# kubectl top node

NAME CPU(cores) CPU% MEMORY(bytes) MEMORY%

k8s-master01 296m 14% 1582Mi 54%

k8s-node01 81m 4% 1195Mi 40%

k8s-node02 72m 3% 1211Mi 41%

[root@k8s-master01 1.8+]# kubectl top pod -n kube-system

NAME CPU(cores) MEMORY(bytes)

coredns-6955765f44-7ptsb 3m 9Mi

coredns-6955765f44-vcwr5 3m 8Mi

etcd-master 14m 145Mi

准备deployment和service

创建pc-hpa-pod.yaml文件,内容如下

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx

namespace: lh

spec:

strategy: # 策略

type: RollingUpdate # 滚动更新策略

replicas: 1

selector:

matchLabels:

app: nginx-pod

template:

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: nginx

image: nginx:1.17.1

resources: # 资源配额

limits: # 限制资源(上限)

cpu: "1" # CPU限制,单位是core数

requests: # 请求资源(下限)

cpu: "100m" # CPU限制,单位是core数

创建service并查看

[root@master 1.8+]# kubectl expose deployment nginx --type=NodePort --port=80 -n lh

[root@master 1.8+]# kubectl get deployment,pod,svc -n lh

NAME READY UP-TO-DATE AVAILABLE AGE

deployment.apps/nginx 1/1 1 1 56s

NAME READY STATUS RESTARTS AGE

pod/nginx-7df9756ccc-bh8dr 1/1 Running 0 56s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/nginx NodePort 10.101.18.29 <none> 80:31830/TCP 41s

部署HPA

创建pc-hpa.yaml文件,内容如下:

apiVersion: autoscaling/v1

kind: HorizontalPodAutoscaler

metadata:

name: pc-hpa

namespace: lh

spec:

minReplicas: 1 #最小pod数量

maxReplicas: 10 #最大pod数量

targetCPUUtilizationPercentage: 3 # CPU使用率指标

scaleTargetRef: # 指定要控制的nginx信息

apiVersion: apps/v1

kind: Deployment

name: nginx

创建hpa

[root@master 1.8+]# kubectl create -f pc-hpa.yaml

horizontalpodautoscaler.autoscaling/pc-hpa created

查看hpa

[root@master 1.8+]# kubectl get hpa -n lh

NAME REFERENCE TARGETS MINPODS MAXPODS REPLICAS AGE

pc-hpa Deployment/nginx 0%/3% 1 10 1 65s

测试

使用压测工具对service地址192.168.5.4:31830进行压测,

while :;do curl http://127.0.0.1:31100;done

然后通过控制台查看hpa和pod的变化

hpa变化

[root@master ~]# kubectl get hpa -n lh -w

NAME REFERENCE TARGETS MINPODS MAXPODS REPLICAS AGE

pc-hpa Deployment/nginx 0%/3% 1 10 1 5m13s

pc-hpa Deployment/nginx 0%/3% 1 10 1 6m15s

pc-hpa Deployment/nginx 22%/3% 1 10 1 6m50s

pc-hpa Deployment/nginx 22%/3% 1 10 4 7m5s

pc-hpa Deployment/nginx 22%/3% 1 10 8 7m21s

pc-hpa Deployment/nginx 6%/3% 1 10 8 7m51s

pc-hpa Deployment/nginx 0%/3% 1 10 8 9m6s

pc-hpa Deployment/nginx 0%/3% 1 10 8 23m

pc-hpa Deployment/nginx 0%/3% 1 10 1 24m

deployment变化

[root@master ~]# kubectl get deployment -n lh -w

NAME READY UP-TO-DATE AVAILABLE AGE

nginx 1/1 1 1 11m

nginx 1/4 1 1 13m

nginx 1/4 1 1 13m

nginx 1/4 1 1 13m

nginx 1/4 4 1 13m

nginx 1/8 4 1 14m

nginx 1/8 4 1 14m

nginx 1/8 4 1 14m

nginx 1/8 8 1 14m

nginx 2/8 8 2 14m

nginx 3/8 8 3 14m

nginx 4/8 8 4 14m

nginx 5/8 8 5 14m

nginx 6/8 8 6 14m

nginx 7/8 8 7 14m

nginx 8/8 8 8 15m

nginx 8/1 8 8 20m

nginx 8/1 8 8 20m

nginx 1/1 1 1 20m

pod变化

[root@master ~]# kubectl get pods -n lh -w

NAME READY STATUS RESTARTS AGE

nginx-7df9756ccc-bh8dr 1/1 Running 0 11m

nginx-7df9756ccc-cpgrv 0/1 Pending 0 0s

nginx-7df9756ccc-8zhwk 0/1 Pending 0 0s

nginx-7df9756ccc-rr9bn 0/1 Pending 0 0s

nginx-7df9756ccc-cpgrv 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-8zhwk 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-rr9bn 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-m9gsj 0/1 Pending 0 0s

nginx-7df9756ccc-g56qb 0/1 Pending 0 0s

nginx-7df9756ccc-sl9c6 0/1 Pending 0 0s

nginx-7df9756ccc-fgst7 0/1 Pending 0 0s

nginx-7df9756ccc-g56qb 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-m9gsj 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-sl9c6 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-fgst7 0/1 ContainerCreating 0 0s

nginx-7df9756ccc-8zhwk 1/1 Running 0 19s

nginx-7df9756ccc-rr9bn 1/1 Running 0 30s

nginx-7df9756ccc-m9gsj 1/1 Running 0 21s

nginx-7df9756ccc-cpgrv 1/1 Running 0 47s

nginx-7df9756ccc-sl9c6 1/1 Running 0 33s

nginx-7df9756ccc-g56qb 1/1 Running 0 48s

nginx-7df9756ccc-fgst7 1/1 Running 0 66s

nginx-7df9756ccc-fgst7 1/1 Terminating 0 6m50s

nginx-7df9756ccc-8zhwk 1/1 Terminating 0 7m5s

nginx-7df9756ccc-cpgrv 1/1 Terminating 0 7m5s

nginx-7df9756ccc-g56qb 1/1 Terminating 0 6m50s

nginx-7df9756ccc-rr9bn 1/1 Terminating 0 7m5s

nginx-7df9756ccc-m9gsj 1/1 Terminating 0 6m50s

nginx-7df9756ccc-sl9c6 1/1 Terminating 0 6m50s

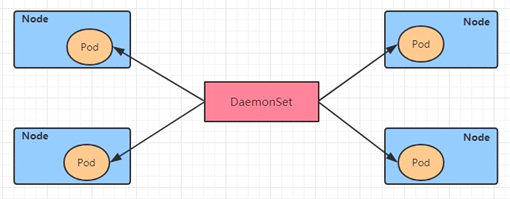

DaemonSet(DS)

DaemonSet类型的控制器可以保证在集群中的每一台(或指定)节点上都运行一个副本。一般适用于日志收集、节点监控等场景。也就是说,如果一个Pod提供的功能是节点级别的(每个节点都需要且只需要一个),那么这类Pod就适合使用DaemonSet类型的控制器创建。

DaemonSet控制器的特点:

• 每当向集群中添加一个节点时,指定的 Pod 副本也将添加到该节点上

• 当节点从集群中移除时,Pod 也就被垃圾回收了

下面先来看下DaemonSet的资源清单文件

apiVersion: apps/v1 # 版本号

kind: DaemonSet # 类型

metadata: # 元数据

name: # rs名称

namespace: # 所属命名空间

labels: #标签

controller: daemonset

spec: # 详情描述

revisionHistoryLimit: 3 # 保留历史版本

updateStrategy: # 更新策略

type: RollingUpdate # 滚动更新策略

rollingUpdate: # 滚动更新

maxUnavailable: 1 # 最大不可用状态的 Pod 的最大值,可以为百分比,也可以为整数

selector: # 选择器,通过它指定该控制器管理哪些pod

matchLabels: # Labels匹配规则

app: nginx-pod

matchExpressions: # Expressions匹配规则

- {key: app, operator: In, values: [nginx-pod]}

template: # 模板,当副本数量不足时,会根据下面的模板创建pod副本

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: nginx

image: nginx:1.17.1

ports:

- containerPort: 80

创建pc-daemonset.yaml,内容如下:

apiVersion: apps/v1

kind: DaemonSet

metadata:

name: pc-daemonset

namespace: xn

spec:

selector:

matchLabels:

app: nginx-pod

template:

metadata:

labels:

app: nginx-pod

spec:

containers:

- name: nginx

image: nginx:1.17.1

创建daemonset

[root@master ~]# kubectl create -f pc-daemonset.yaml

daemonset.apps/pc-daemonset created

查看daemonset

[root@master ~]# kubectl get ds -n xn -o wide

NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE AGE CONTAINERS IMAGES

pc-daemonset 2 2 2 2 2 57s nginx nginx:1.17.1

查看pod,发现在每个Node上都运行一个pod

[root@master ~]# kubectl get pods -n xn -o wide

NAME READY STATUS RESTARTS AGE IP NODE

pc-daemonset-9bck8 1/1 Running 0 65s 10.244.1.43 node1

pc-daemonset-k224w 1/1 Running 0 65s 10.244.2.74 node2

删除daemonset

[root@master ~]# kubectl delete -f pc-daemonset.yaml

daemonset.apps "pc-daemonset" deleted

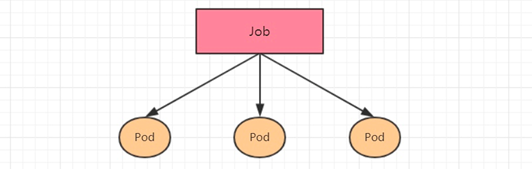

Job

Job,主要用于负责批量处理(一次要处理指定数量任务)短暂的一次性(每个任务仅运行一次就结束)任务。Job特点如下:

• 当Job创建的pod执行成功结束时,Job将记录成功结束的pod数量

• 当成功结束的pod达到指定的数量时,Job将完成执行

Job的资源清单文件:

apiVersion: batch/v1 # 版本号

kind: Job # 类型

metadata: # 元数据

name: # rs名称

namespace: # 所属命名空间

labels: #标签

controller: job

spec: # 详情描述

completions: 1 # 指定job需要成功运行Pods的次数。默认值: 1

parallelism: 1 # 指定job在任一时刻应该并发运行Pods的数量。默认值: 1

activeDeadlineSeconds: 30 # 指定job可运行的时间期限,超过时间还未结束,系统将会尝试进行终止。

backoffLimit: 6 # 指定job失败后进行重试的次数。默认是6

manualSelector: true # 是否可以使用selector选择器选择pod,默认是false

selector: # 选择器,通过它指定该控制器管理哪些pod

matchLabels: # Labels匹配规则

app: counter-pod

matchExpressions: # Expressions匹配规则

- {key: app, operator: In, values: [counter-pod]}

template: # 模板,当副本数量不足时,会根据下面的模板创建pod副本

metadata:

labels:

app: counter-pod

spec:

restartPolicy: Never # 重启策略只能设置为Never或者OnFailure

containers:

- name: counter

image: busybox:1.30

command: ["bin/sh","-c","for i in 9 8 7 6 5 4 3 2 1; do echo $i;sleep 2;done"]

关于重启策略设置的说明:

如果指定为OnFailure,则job会在pod出现故障时重启容器,而不是创建pod,failed次数不变

如果指定为Never,则job会在pod出现故障时创建新的pod,并且故障pod不会消失,也不会重启,failed次数加1

如果指定为Always的话,就意味着一直重启,意味着job任务会重复去执行了,当然不对,所以不能设置为Always

创建pc-job.yaml,内容如下

apiVersion: batch/v1

kind: Job

metadata:

name: pc-job

namespace: xn

spec:

manualSelector: true

selector:

matchLabels:

app: counter-pod

template:

metadata:

labels:

app: counter-pod

spec:

restartPolicy: Never

containers:

- name: counter

image: busybox:1.30

command: ["bin/sh","-c","for i in 9 8 7 6 5 4 3 2 1; do echo $i;sleep 3;done"]

创建job

[root@master ~]# kubectl create -f pc-job.yaml

job.batch/pc-job created

查看job

[root@master ~]# kubectl get job -n xn -o wide -w

NAME COMPLETIONS DURATION AGE CONTAINERS IMAGES SELECTOR

pc-job 0/1 21s 21s counter busybox:1.30 app=counter-pod

pc-job 1/1 31s 79s counter busybox:1.30 app=counter-pod

通过观察pod状态可以看到,pod在运行完毕任务后,就会变成Completed状态

[root@k8s-master01 ~]# kubectl get pods -n xn -w

NAME READY STATUS RESTARTS AGE

pc-job-rxg96 1/1 Running 0 29s

pc-job-rxg96 0/1 Completed 0 33s

接下来,调整下pod运行的总数量和并行数量 即:在spec下设置下面两个选项# completions: 6 # 指定job需要成功运行Pods的次数为6# parallelism: 3 # 指定job并发运行Pods的数量为3# 然后重新运行job,观察效果,此时会发现,job会每次运行3个pod,总共执行了6个pod

[root@master ~]# kubectl get pods -n xn -w

NAME READY STATUS RESTARTS AGE

pc-job-684ft 1/1 Running 0 5s

pc-job-jhj49 1/1 Running 0 5s

pc-job-pfcvh 1/1 Running 0 5s

pc-job-684ft 0/1 Completed 0 11s

pc-job-v7rhr 0/1 Pending 0 0s

pc-job-v7rhr 0/1 Pending 0 0s

pc-job-v7rhr 0/1 ContainerCreating 0 0s

pc-job-jhj49 0/1 Completed 0 11s

pc-job-fhwf7 0/1 Pending 0 0s

pc-job-fhwf7 0/1 Pending 0 0s

pc-job-pfcvh 0/1 Completed 0 11s

pc-job-5vg2j 0/1 Pending 0 0s

pc-job-fhwf7 0/1 ContainerCreating 0 0s

pc-job-5vg2j 0/1 Pending 0 0s

pc-job-5vg2j 0/1 ContainerCreating 0 0s

pc-job-fhwf7 1/1 Running 0 2s

pc-job-v7rhr 1/1 Running 0 2s

pc-job-5vg2j 1/1 Running 0 3s

pc-job-fhwf7 0/1 Completed 0 12s

pc-job-v7rhr 0/1 Completed 0 12s

pc-job-5vg2j 0/1 Completed 0 12s

删除job

[root@master ~]# kubectl delete -f pc-job.yaml

job.batch "pc-job" deleted

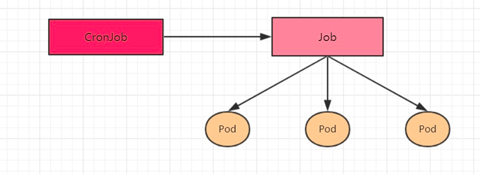

CronJob(CJ)

CronJob控制器以Job控制器资源为其管控对象,并借助它管理pod资源对象,Job控制器定义的作业任务在其控制器资源创建之后便会立即执行,但CronJob可以以类似于Linux操作系统的周期性任务作业计划的方式控制其运行时间点及重复运行的方式。也就是说,CronJob可以在特定的时间点(反复的)去运行job任务。

CronJob的资源清单文件:

apiVersion: batch/v1 # 版本号

kind: CronJob # 类型

metadata: # 元数据

name: # rs名称

namespace: # 所属命名空间

labels: #标签

controller: cronjob

spec: # 详情描述

schedule: # cron格式的作业调度运行时间点,用于控制任务在什么时间执行

concurrencyPolicy: # 并发执行策略,用于定义前一次作业运行尚未完成时是否以及如何运行后一次的作业

failedJobHistoryLimit: # 为失败的任务执行保留的历史记录数,默认为1

successfulJobHistoryLimit: # 为成功的任务执行保留的历史记录数,默认为3

startingDeadlineSeconds: # 启动作业错误的超时时长

jobTemplate: # job控制器模板,用于为cronjob控制器生成job对象;下面其实就是job的定义

metadata:

spec:

completions: 1

parallelism: 1

activeDeadlineSeconds: 30

backoffLimit: 6

manualSelector: true

selector:

matchLabels:

app: counter-pod

matchExpressions: 规则

- {key: app, operator: In, values: [counter-pod]}

template:

metadata:

labels:

app: counter-pod

spec:

restartPolicy: Never

containers:

- name: counter

image: busybox:1.30

command: ["bin/sh","-c","for i in 9 8 7 6 5 4 3 2 1; do echo $i;sleep 20;done"]

需要重点解释的几个选项:

schedule: cron表达式,用于指定任务的执行时间

*/1 * * * *

<分钟> <小时> <日> <月份> <星期>

分钟 值从 0 到 59.

小时 值从 0 到 23.

日 值从 1 到 31.

月 值从 1 到 12.

星期 值从 0 到 6, 0 代表星期日

多个时间可以用逗号隔开; 范围可以用连字符给出;*可以作为通配符; /表示每...

concurrencyPolicy:

Allow: 允许Jobs并发运行(默认)

Forbid: 禁止并发运行,如果上一次运行尚未完成,则跳过下一次运行

Replace: 替换,取消当前正在运行的作业并用新作业替换它

创建pc-cronjob.yaml,内容如下:

apiVersion: batch/v1

kind: CronJob

metadata:

name: pc-cronjob

namespace: xn

labels:

controller: cronjob

spec:

schedule: "*/1 * * * *"

jobTemplate:

metadata:

spec:

template:

spec:

restartPolicy: Never

containers:

- name: counter

image: busybox:1.30

command: ["bin/sh","-c","for i in 9 8 7 6 5 4 3 2 1; do echo $i;sleep 3;done"]

创建cronjob

[root@master ~]# kubectl create -f pc-cronjob.yaml

cronjob.batch/pc-cronjob created

查看cronjob

[root@master ~]# kubectl get cronjobs -n xn

NAME SCHEDULE SUSPEND ACTIVE LAST SCHEDULE AGE

pc-cronjob */1 * * * * False 0 <none> 6s

查看job

[root@master ~]# kubectl get jobs -n xn

NAME COMPLETIONS DURATION AGE

pc-cronjob-1592587800 1/1 28s 3m26s

pc-cronjob-1592587860 1/1 28s 2m26s

pc-cronjob-1592587920 1/1 28s 86s

查看pod

[root@master ~]# kubectl get pods -n xn

pc-cronjob-1592587800-x4tsm 0/1 Completed 0 2m24s

pc-cronjob-1592587860-r5gv4 0/1 Completed 0 84s

pc-cronjob-1592587920-9dxxq 1/1 Running 0 24s

删除cronjob

[root@master ~]# kubectl delete -f pc-cronjob.yaml

cronjob.batch "pc-cronjob" deleted

service详解

service介绍

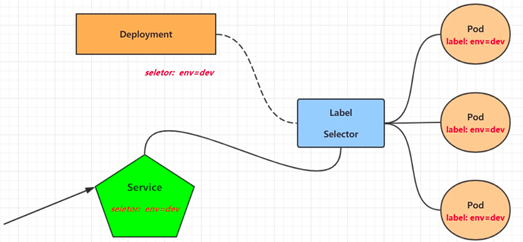

在kubernetes中,pod是应用程序的载体,我们可以通过pod的ip来访问应用程序,但是pod的ip地址不是固定的,这也就意味着不方便直接采用pod的ip对服务进行访问。

为了解决这个问题,kubernetes提供了Service资源,Service会对提供同一个服务的多个pod进行聚合,并且提供一个统一的入口地址。通过访问Service的入口地址就能访问到后面的pod服务。

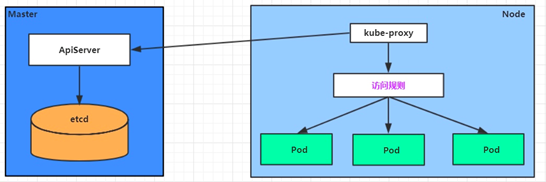

Service在很多情况下只是一个概念,真正起作用的其实是kube-proxy服务进程,每个Node节点上都运行着一个kube-proxy服务进程。当创建Service的时候会通过api-server向etcd写入创建的service的信息,而kube-proxy会基于监听的机制发现这种Service的变动,然后它会将最新的Service信息转换成对应的访问规则。

10.97.97.97:80 是service提供的访问入口# 当访问这个入口的时候,可以发现后面有三个pod的服务在等待调用, kube-proxy会基于rr(轮询)的策略,将请求分发到其中一个pod上去 这个规则会同时在集群内的所有节点上都生成,所以在任何一个节点上访问都可以。

[root@master ~]# ipvsadm -Ln

IP Virtual Server version 1.2.1 (size=4096)Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConnTCP 10.97.97.97:80 rr

-> 10.244.1.39:80 Masq 1 0 0

-> 10.244.1.40:80 Masq 1 0 0

-> 10.244.2.33:80 Masq 1 0 0

查看iptables防火墙规则

[root@master ~]# iptables -t nat -nvL

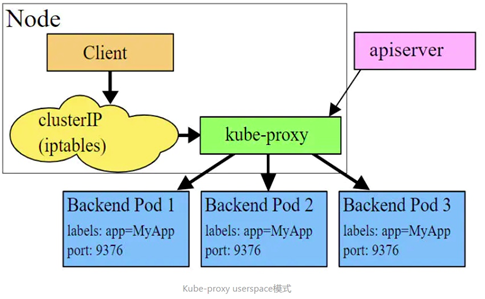

userspace 模式

userspace模式下,kube-proxy会为每一个Service创建一个监听端口,发向Cluster IP的请求被Iptables规则重定向到kube-proxy监听的端口上,kube-proxy根据LB算法选择一个提供服务的Pod并和其建立链接,以将请求转发到Pod上。 该模式下,kube-proxy充当了一个四层负责均衡器的角色。由于kube-proxy运行在userspace中,在进行转发处理时会增加内核和用户空间之间的数据拷贝,虽然比较稳定,但是效率比较低。

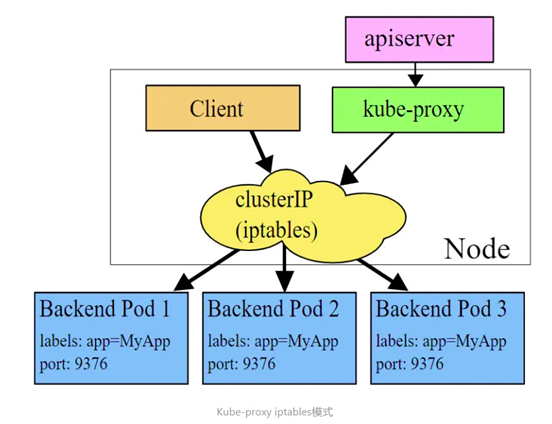

iptables 模式

iptables模式下,kube-proxy为service后端的每个Pod创建对应的iptables规则,直接将发向Cluster IP的请求重定向到一个Pod IP。 该模式下kube-proxy不承担四层负责均衡器的角色,只负责创建iptables规则。该模式的优点是较userspace模式效率更高,但不能提供灵活的LB策略,当后端Pod不可用时也无法进行重试。

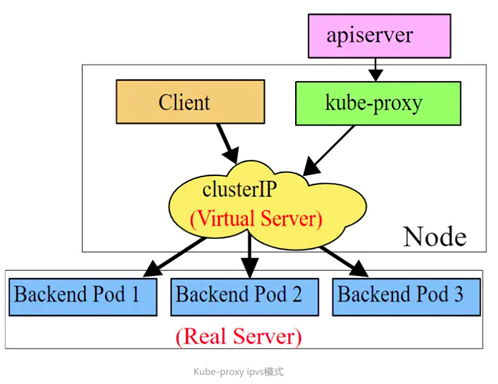

ipvs 模式

ipvs模式和iptables类似,kube-proxy监控Pod的变化并创建相应的ipvs规则。ipvs相对iptables转发效率更高。除此以外,ipvs支持更多的LB算法。

此模式必须安装ipvs内核模块,否则会降级为iptables# 开启ipvs

使用kubectl api-resources可以查看cm是什么?

[root@master ~]# kubectl edit cm kube-proxy -n kube-system

修改mode: “ipvs”

[root@master ~]# kubectl delete pod -l k8s-app=kube-proxy -n kube-system

[root@node1 ~]# ipvsadm -LnIP Virtual Server version 1.2.1 (size=4096)Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConnTCP 10.97.97.97:80 rr

-> 10.244.1.39:80 Masq 1 0 0

-> 10.244.1.40:80 Masq 1 0 0

-> 10.244.2.33:80 Masq 1 0 0

Service类型

Service的资源清单文件:

kind: Service # 资源类型

apiVersion: v1 # 资源版本

metadata: # 元数据

name: service # 资源名称

namespace: dev # 命名空间

spec: # 描述

selector: # 标签选择器,用于确定当前service代理哪些pod

app: nginx

type: # Service类型,指定service的访问方式

clusterIP: # 虚拟服务的ip地址

sessionAffinity: # session亲和性,支持ClientIP、None两个选项

ports: # 端口信息

- protocol: TCP

port: 3017 # service端口

targetPort: 5003 # pod端口

nodePort: 31122 # 主机端口

ClusterIP:默认值,它是Kubernetes系统自动分配的虚拟IP,只能在集群内部访问

NodePort:将Service通过指定的Node上的端口暴露给外部,通过此方法,就可以在集群外部访问服务

LoadBalancer:使用外接负载均衡器完成到服务的负载分发,注意此模式需要外部云环境支持

ExternalName: 把集群外部的服务引入集群内部,直接使用

![[附源码]计算机毕业设计基于Springboot的专业技能认证系统](https://img-blog.csdnimg.cn/e1f497c83b204ad7b00f01e9ac4cd5a2.png)

![[附源码]计算机毕业设计基于SpringBoot动漫电影网站](https://img-blog.csdnimg.cn/c55785c6294144c9bc164949c57a34e1.png)