经典神经网络(5)GoogLeNet及其在Fashion-MNIST数据集上的应用

1 Inception V1 的简述

-

Inception网络是卷积神经网络的一个重要里程碑。在Inception之前,大部分流行的卷积神经网络仅仅是把卷积层堆叠得越来越多,使得网络越来越深。这使得网络越来越复杂,参数越来越多,从而导致网络容易出现过拟合,增加计算量。而

Inception网络考虑的是多种卷积核的并行计算,扩展了网络的宽度。 -

Inception Net核心思想是:稀疏连接。 -

Inception网络的最大特点是大量使用了Inception模块。 -

论文地址:https://arxiv.org/pdf/1409.4842.pdf

1.1 Inception V1的概述

1.1.1 原始的Inception模块

原始的Inception 模块对输入同时执行:3个不同大小的卷积操作(1x1、3x3、5x5)、1个最大池化操作(3x3 )。所有操作的输出都在深度方向拼接起来,向后一级传递。

-

三种不同大小卷积:通过不同尺寸的卷积核抓取不同大小的对象的特征。

使用

1x1、3x3、5x5这些具体尺寸仅仅是为了便利性,事实上也可以使用更多的、其它尺寸的滤波器。 -

1个最大池化:提取图像的原始特征(不经过过滤器)。

1.1.2 改进的Inception模块

原始Inception 模块中,模块的输出通道数量为四个子层的输出通道数的叠加。这种叠加不可避免的使得Inception 模块的输出通道数增加,这就增加了Inception 模块中每个卷积的计算量。因此在经过若干个模块之后,计算量会爆炸性增长。

解决方案是:在3x3 和 5x5 卷积层之前额外添加1x1 卷积层,来限制输入给卷积层的输入通道的数量。

注意:

1x1卷积是在最大池化层之后,而不是之前。这是因为:池化层是为了提取图像的原始特征,一旦它接在1x1卷积之后就失去了最初的本意。1x1卷积在3x3、5x5卷积之前。这是因为:如果1x1卷积在它们之后,则3x3卷积、5x5卷积的输入通道数太大,导致计算量仍然巨大。

1.1.3 改进的Inception模块的代码实现

import torch.nn as nn

import torch

import torch.nn.functional as F

'''

Inception块由四条并⾏路径组成。

前三条路径使⽤窗⼝⼤⼩为1 × 1、3 × 3和5 × 5的卷积层,从不同空间⼤⼩中提取信息。

中间的两条路径在输⼊上执⾏1 × 1卷积,以减少通道数,从⽽降低模型的复杂性。

第四条路径使⽤3 × 3最⼤汇聚层,然后使⽤1 × 1卷积层来改变通道数。

这四条路径都使⽤合适的填充来使输⼊与输出的⾼和宽⼀致,最后我们将每条线路的输出在通道维度上连结,并构成Inception块的输出。

在Inception块中,通常调整的超参数是每层输出通道数。

'''

class Inception(nn.Module):

# c1到c4是每条路径的输出通道数

def __init__(self, in_channels, c1, c2, c3, c4, **kwargs):

super(Inception, self).__init__(**kwargs)

# 线路1,单1x1卷积层

self.p1_1 = nn.Conv2d(in_channels,c1, kernel_size=1)

# 线路2,1x1卷积层后接3x3卷积层

self.p2_1 = nn.Conv2d(in_channels, c2[0], kernel_size=1)

self.p2_2 = nn.Conv2d(c2[0], c2[1], kernel_size=3, padding=1)

# 线路3,1x1卷积层后接5x5卷积层

self.p3_1 = nn.Conv2d(in_channels, c3[0], kernel_size=1)

self.p3_2 = nn.Conv2d(c3[0], c3[1], kernel_size=5, padding=2)

# 线路4,3x3最大汇聚层后接1x1卷积层

self.p4_1 = nn.MaxPool2d(kernel_size=3, stride=1, padding=1)

self.p4_2 = nn.Conv2d(in_channels, c4, kernel_size=1)

def forward(self,x):

p1 = F.relu(self.p1_1(x))

p2 = F.relu(self.p2_2(F.relu(self.p2_1(x))))

p3 = F.relu(self.p3_2(F.relu(self.p3_1(x))))

p4 = F.relu(self.p4_2(self.p4_1(x)))

# 连接输出

return torch.cat((p1,p2,p3,p4), dim=1)

1.2 GoogLeNet(InceptionNet V1)的概述

1.2.1 GoogLeNet介绍

InceptionNet V1 是一个22层的深度网络。 如果考虑池化层,则有29层。

网络具有三组Inception 模块,分别为:

-

inception(3a)/inception(3b)、 -

inception(4a)/inception(4b)/inception(4c)/inception(4d)/inception(4e)、 -

inception(5a)、inception(5b)。

三组Inception 模块被池化层分隔。

1.2.2 辅助分类器

-

为了缓解梯度消失的问题,

InceptionNet V1给出了两个辅助分类器。这两个辅助分类器被添加到网络的中间层,它们和主分类器共享同一套训练数据及其标记。其中:- 第一个辅助分类器位于

Inception(4a)之后,Inception(4a)模块的输出作为它的输入。 - 第二个辅助分类器位于

Inception(4d)之后,Inception(4d)模块的输出作为它的输入。 - 两个辅助分类器的结构相同,包括以下组件:

- 一个尺寸为

5x5、步长为3的平均池化层。 - 一个尺寸为

1x1、输出通道数为128的卷积层。 - 一个具有

1024个单元的全连接层。 - 一个

drop rate = 70%的dropout层。 - 一个使用

softmax损失的线性层作为输出层。

- 一个尺寸为

- 第一个辅助分类器位于

-

在训练期间,两个辅助分类器的损失函数的权重是0.3,它们的损失被叠加到网络的整体损失上。在推断期间,这两个辅助网络被丢弃。

在

Inception v3的实验中表明:辅助网络的影响相对较小,只需要其中一个就能够取得同样的效果。事实上辅助分类器在训练早期并没有多少贡献。只有在训练接近结束,辅助分支网络开始发挥作用,获得超出无辅助分类器网络的结果。

-

两个辅助分类器的作用:提供正则化的同时,克服了梯度消失问题。

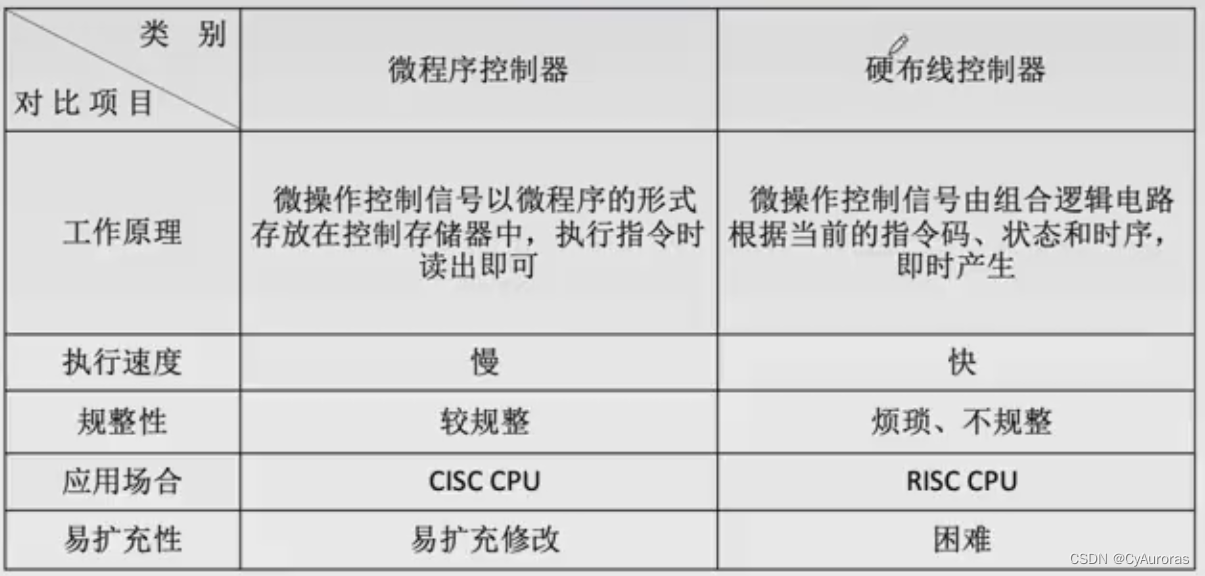

1.2.3 GoogLeNet层次结构和参数

type列:给出了每个模块/层的类型。patch size/stride列:给出了卷积层/池化层的尺寸和步长。output size列:给出了每个模块/层的输出尺寸和输出通道数。depth列:给出了每个模块/层包含的、含有训练参数层的数量。#1x1列:给出了每个模块/层包含的1x1卷积核的数量,它就是1x1卷积核的输出通道数。#3x3 reduce列:给出了每个模块/层包含的、放置在3x3卷积层之前的1x1卷积核的数量,它就是1x1卷积核的输出通道数。#3x3列:给出了每个模块/层包含的3x3卷积核的数量,它就是3x3卷积核的输出通道数。#5x5 reduce列:给出了每个模块/层包含的、放置在5x5卷积层之前的1x1卷积核的数量,它就是1x1卷积核的输出通道数。#5x5列:给出了每个模块/层包含的5x5卷积核的数量,它就是5x5卷积核的输出通道数。pool proj列:给出了每个模块/层包含的、放置在池化层之后的1x1卷积核的数量,它就是1x1卷积核的输出通道数。params列:给出了每个模块/层的参数数量。ops列:给出了每个模块/层的计算量。

1.2.4 GoogLeNet参数量的减少

Inception V1 的参数数量为 697.7 万,其参数数量远远小于AlexNet(6千万)、 VGG-Net(超过1亿)。

Inception V1 参数数量能缩减的一个主要技巧是:在inception(5b)输出到linear之间插入一个平均池化层avg pool。

- 如果没有平均池化层,则

inception(5b)到linear之间的参数数量为:7x7x1024x1024,约为 5 千万。 - 插入了平均池化层之后,

inception(5b)到linear之间的参数数量为:1x1x1024x1024,约为 1百万。

1.2.5 GoogLeNet的实现

下面实现⼀个稍微简化的GoogLeNet版本

import torch.nn as nn

import torch

# 导入Inception块

from _05_Inception import Inception

class GoogLeNet(nn.Module):

def __init__(self):

super(GoogLeNet, self).__init__()

self.model = self.get_net()

def forward(self, X):

X = self.model(X)

return X

def get_net(self):

# 第⼀个模块使⽤64个通道、7 × 7卷积层。

b1 = nn.Sequential(nn.Conv2d(1, 64, kernel_size=7, stride=2, padding=3),

nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

# 第二个模块使⽤两个卷积层:

# 第1个卷积层是64个通道、1 × 1卷积层;

# 第2个卷积层使⽤将通道数量增加三倍的3 × 3卷积层。这对应于Inception块中的第二条路径。

b2 = nn.Sequential(nn.Conv2d(64, 64, kernel_size=1),

nn.ReLU(),

nn.Conv2d(64, 192, kernel_size=3, padding=1),

nn.ReLU(),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

'''

第三个模块串联两个完整的Inception块。

第⼀个Inception块的输出通道数为64 + 128 + 32 + 32 = 256,四个路径之间的输出通道数量⽐为64 : 128 : 32 : 32 = 2 : 4 : 1 : 1。

第⼆个和第三个路径⾸先将输⼊通道的数量分别减少到96/192 = 1/2和16/192 = 1/12,然后连接第⼆个卷积层。

第⼆个Inception块的输出通道数增加到128 + 192 + 96 + 64 = 480,四个路径之间的输出通道数量⽐为128 : 192 : 96 : 64 = 4 : 6 : 3 : 2。

第⼆条和第三条路径⾸先将输⼊通道的数量分别减少到128/256 = 1/2和32/256 = 1/8。

'''

b3 = nn.Sequential(Inception(192, 64, (96, 128), (16, 32), 32),

Inception(256, 128, (128, 192), (32, 96), 64),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

'''

第四模块更加复杂,它串联了5个Inception块,其输出通道数分别是

192 + 208 + 48 + 64 = 512、

160 + 224 + 64 + 64 = 512、

128 + 256 + 64 + 64 = 512、

112 + 288 + 64 + 64 = 528 和

256 + 320 + 128 + 128 = 832。

这些路径的通道数分配和第三模块中的类似,

⾸先是含3×3卷积层的第⼆条路径输出最多通道,

其次是仅含1×1卷积层的第⼀条路径,

之后是含5×5卷积层的第三条路径和含3×3最⼤汇聚层的第四条路径。

其中第⼆、第三条路径都会先按⽐例减⼩通道数。这些⽐例在各个Inception块中都略有不同。

'''

b4 = nn.Sequential(Inception(480, 192, (96, 208), (16, 48), 64),

Inception(512, 160, (112, 224), (24, 64), 64),

Inception(512, 128, (128, 256), (24, 64), 64),

Inception(512, 112, (144, 288), (32, 64), 64),

Inception(528, 256, (160, 320), (32, 128), 128),

nn.MaxPool2d(kernel_size=3, stride=2, padding=1))

'''

第五模块包含输出通道数为256 + 320 + 128 + 128 = 832和384 + 384 + 128 + 128 = 1024的两个Inception块。

其中每条路径通道数的分配思路和第三、第四模块中的⼀致,只是在具体数值上有所不同。

需要注意的是,第五模块的后⾯紧跟输出层,该模块同NiN⼀样使⽤全局平均汇聚层,将每个通道的⾼和宽变成1。

最后我们将输出变成⼆维数组,再接上⼀个输出个数为标签类别数的全连接层。

'''

b5 = nn.Sequential(Inception(832, 256, (160, 320), (32, 128), 128),

Inception(832, 384, (192, 384), (48, 128), 128),

nn.AdaptiveAvgPool2d((1, 1)),

nn.Flatten())

return nn.Sequential(b1, b2, b3, b4, b5, nn.Linear(1024, 10))

if __name__ == '__main__':

net = GoogLeNet()

X = torch.rand(size=(1, 1, 96, 96), dtype=torch.float32)

for layer in net.model:

X = layer(X)

print(layer.__class__.__name__, 'output shape:', X.shape)

Sequential output shape: torch.Size([1, 64, 24, 24])

Sequential output shape: torch.Size([1, 192, 12, 12])

Sequential output shape: torch.Size([1, 480, 6, 6])

Sequential output shape: torch.Size([1, 832, 3, 3])

Sequential output shape: torch.Size([1, 1024])

Linear output shape: torch.Size([1, 10])

2 GoogLeNet在Fashion-MNIST数据集上的应用示例

2.1 创建GoogLeNet网络模型

如1.1.3及1.2.4代码所示。

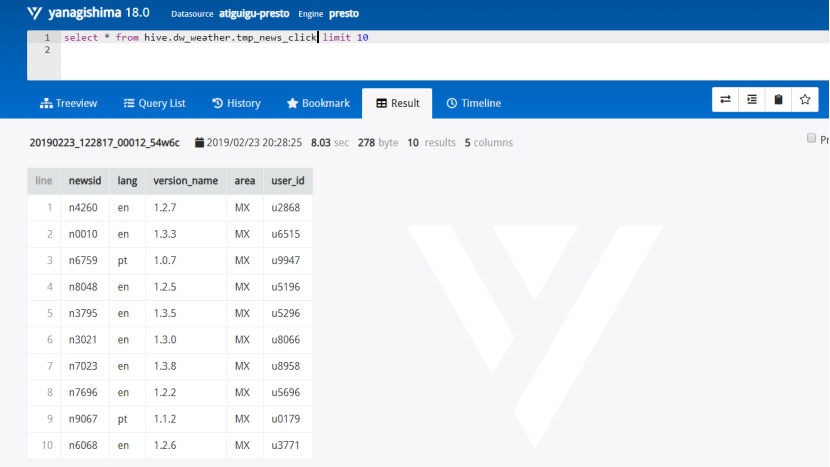

2.2 读取Fashion-MNIST数据集

其他所有的函数,与经典神经网络(1)LeNet及其在Fashion-MNIST数据集上的应用完全一致。

batch_size = 128

# 为了使Fashion-MNIST上的训练短⼩精悍,将输⼊的⾼和宽从224降到96,简化计算

train_iter,test_iter = get_mnist_data(batch_size,resize=96)

2.3 在GPU上进行模型训练

from _05_GoogLeNet import GoogLeNet

# 初始化模型

net = GoogLeNet()

lr, num_epochs = 0.1, 10

train_ch(net, train_iter, test_iter, num_epochs, lr, try_gpu())

总结

-

Inception块相当于⼀个有4条路径的子网络。它通过不同窗⼝形状的卷积层和最⼤汇聚层来并⾏抽取信息,并使⽤1×1卷积层减少每像素级别上的通道维数从⽽降低模型复杂度。

-

GoogLeNet将多个设计精细的Inception块与其他层(卷积层、全连接层)串联起来。其中Inception块的通道数分配之比是在ImageNet数据集上通过⼤量的实验得来的。

-

除了Inception V1网络外,还有Inception V2、Inception V3、Inception V4、Inception-ResNet等改进版本。