回归分析-简单线性回归模型

在大数据分析中,回归分析是一种预测性的建模技术,它研究的是因变量(目标)和自变量(预测器)之间的关系。这种技术通常用于预测分析,时间序列模型以及发现变量之间的因果关系。例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究方法就是回归。来自百度百科

可以说是数据分析中非常简单的一个知识点,有一点点统计、分析、建模经验的人都知道这个分析的含义,也会用各种工具来做这个分析。这里面想把这个分析背后的细节讲讲清楚,也就是后面的数学原理。

一元线性回归是最简单的形式,它只包含一个自变量和一个因变量,二者直接的关系可以用一条直线近似表示,这种回归分析被称为简单线性回归。

可以用下面的公式表示 y是因变量,x是自变量。

y

‾

=

a

x

+

b

(1.1)

\overline{y}=ax+b \tag{1.1}

y=ax+b(1.1)

假如广告投入与销售额存在这样一种线性关系,收集了一组广告投入与销售额的历史数据,那么如何确定a和b的值呢?这里先给出答案,后面再说推导过程。

b

=

y

‾

−

a

x

‾

(1.2)

b=\overline{y}-a\overline{x} \tag{1.2}

b=y−ax(1.2)

a

=

∑

i

=

1

n

(

x

i

−

x

‾

)

(

y

i

−

y

‾

)

∑

i

=

1

n

(

x

i

−

x

‾

)

2

(1.3)

a=\frac{\sum_{i=1}^n(x_i-\overline{x})(y_i-\overline{y})}{\sum_{i=1}^n(x_i-\overline{x})^2} \tag{1.3}

a=∑i=1n(xi−x)2∑i=1n(xi−x)(yi−y)(1.3)

通过例子验算

摘自《商务与经济统计》这本书的一个示例

Armand比萨饼连锁店是经营意大利食品的餐馆,它们分布在美国5个州的范围内。Armand比萨饼连锁店的最佳位置在大学校园附近。管理人员确信,这些连锁店的季度销售收入(用y表示)与学生人数(用x表示)是正相关的。也就是说,学生较多比学生较少的校园附近的连锁店有获得较大的季度销售收入的倾向。利用回归分析,我们能求出一个说明因变量y是如何依赖自变量x的方程。

下面是10家Armand比萨饼店的季度销售数据,观测次数n=10,数据中给出了应变量为比萨饼店季度销售额,自变量为当前比萨饼店所在的学校的学生人数,现有一家新开的比萨饼店,已知这家店附近的学生人数,求比萨饼店季度销售额。

数据如下表

| 序号 | x i x_i xi | y i y_i yi | x i − x ‾ x_i-\overline{x} xi−x | y i − y ‾ y_i-\overline{y} yi−y | ( x i − x ‾ ) 2 (x_i-\overline{x})^2 (xi−x)2 | ( x i − x ‾ ) ( y i − y ‾ ) (x_i-\overline{x})(y_i-\overline{y}) (xi−x)(yi−y) |

|---|---|---|---|---|---|---|

| 1 | 2 | 58 | -12 | -72 | 144 | 864 |

| 2 | 6 | 105 | -8 | -25 | 64 | 200 |

| 3 | 8 | 88 | -6 | -42 | 36 | 252 |

| 4 | 8 | 118 | -6 | -12 | 36 | 72 |

| 5 | 12 | 117 | -2 | -13 | 4 | 26 |

| 6 | 16 | 137 | 2 | 7 | 4 | 14 |

| 7 | 20 | 157 | 6 | 27 | 36 | 162 |

| 8 | 20 | 169 | 6 | 39 | 36 | 234 |

| 9 | 22 | 149 | 8 | 19 | 64 | 152 |

| 10 | 26 | 202 | 12 | 72 | 144 | 864 |

根据上表计算

x

‾

=

14

\overline{x}=14

x=14 ;

y

‾

=

130

\overline{y}=130

y=130 ;

∑

i

=

1

n

(

x

i

−

x

‾

)

2

=

568

\sum_{i=1}^n(x_i-\overline{x})^2=568

∑i=1n(xi−x)2=568 ;

∑

i

=

1

n

(

x

i

−

x

‾

)

(

y

i

−

y

‾

)

=

2840

\sum_{i=1}^n(x_i-\overline{x})(y_i-\overline{y})=2840

∑i=1n(xi−x)(yi−y)=2840

求解简单线性回归方程

按公式 1.3 计算系统 a

a

=

∑

i

=

1

n

(

x

i

−

x

‾

)

(

y

i

−

y

‾

)

∑

i

=

1

n

(

x

i

−

x

‾

)

2

=

5

a=\frac{\sum_{i=1}^n(x_i-\overline{x})(y_i-\overline{y})}{\sum_{i=1}^n(x_i-\overline{x})^2}=5

a=∑i=1n(xi−x)2∑i=1n(xi−x)(yi−y)=5

按公式1.2 计算系数 b

b

=

y

‾

−

a

x

‾

=

60

b=\overline{y}-a\overline{x}=60

b=y−ax=60

解得方程为

y

‾

=

5

x

+

60

\overline{y}=5x+60

y=5x+60

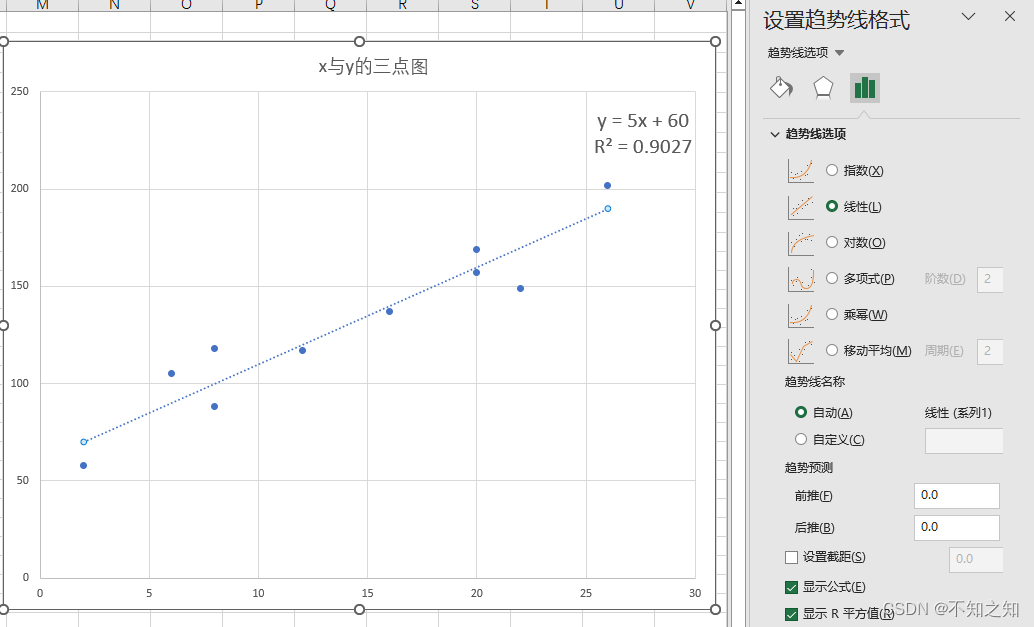

与用Excel生成散点图,添加趋势线,显示的线性方程一致。

推导过程

因为本人基本忘光了高中和大学的数学知识,所以在学习原理的过程中废了很多时间,这个推导过程适合和我一样数学底子弱的人,大神可以略过!!

言归正传,上述方程(1.1)叫做Y对x的回归直线方程,b叫做回归系数。要想确定回归直线方程,我们只需确定a与回归系数b即可。

该方程预测出来的y值和实际的值差别越小越好,只有如此才能使直线最贴近已知点。我们求回归直线方程的过程其实就是求差别最小值的过程。

一个很自然的想法是把各个差加起来作为总差。可是,由于差有正有负,直接相加会互相抵消, 一般做法是我们用差的平方和,即:

Q = ∑ i = 1 n ( y i − y i ^ ) 2 = ∑ i = 1 n ( y i − ( a x i + b ) ) 2 = ∑ i = 1 n ( y i − a x i − b ) 2 (2.1) Q=\sum_{i=1}^n(y_i-\hat{y_i})^2=\sum_{i=1}^n(y_i-(ax_i+b))^2=\sum_{i=1}^n(y_i-ax_i-b)^2 \tag{2.1} Q=i=1∑n(yi−yi^)2=i=1∑n(yi−(axi+b))2=i=1∑n(yi−axi−b)2(2.1)

Q作为总差 ,并使之达到最小。这样回归直线就是所有直线中Q取最小值的那一条。由于平方又叫二乘方,所以这种使“离差平方和为最小”的方法,叫做最小二乘法。

怎么求最小的Q值呢?这是一个二次函数,对其求导,导数为0的时候取得最小值。至于为什么导数为了取值最小可以参考这篇文章极值与导数。这里就引出了导数,对导数不明白的可以参考这篇文章导数概念。

由于公式2.1描述的是因变量Q关于自变量a,b的函数 $Q=f(a,b) $ 是个二元函数,对二元函数求导,可以让其中一个自变量b固定(即看作常量),这时它就是a的一元函数,这时函数对a求导,就称为二元函数Q对于a的偏导数,又引入了偏导数的概念,不明白偏导数的可以参考这篇文章偏导数。

求导过程

∂ f ∂ b = 2 ∑ i = 1 n ( y i − a x i − b ) ) (2.2) \frac{\partial f}{\partial b}=2\sum_{i=1}^n(y_i-ax_i-b)) \tag{2.2} ∂b∂f=2i=1∑n(yi−axi−b))(2.2)

2.2 式的推导过程

①幂函数求导公式

若 f ( x ) = x n f(x)=x^n f(x)=xn,则 f ′ ( x ) = n ⋅ x n − 1 f\prime(x)=n \cdot x^{n-1} f′(x)=n⋅xn−1

②复合函数求导法则

$ f(g(x)) $ 求导

令 u = g ( x ) u=g(x) u=g(x) , [ f ( g ( x ) ) ] ′ = f ′ ( u ) g ′ ( x ) [f(g(x))]\prime=f\prime(u)g\prime(x) [f(g(x))]′=f′(u)g′(x)

③ 根据上两条规程推导

令 $u=y_i-ax_i-b $

$\frac{\partial f}{\partial b}=\sum_{i=1}^n{2u} \cdot (-1)=-2\sum_{i=1}^n(y_i-ax_i-b) $

∂ f ∂ a = ∑ i = 1 n 2 ( y i − a x i − b ) ⋅ ( − x i ) = − 2 ( ∑ i = 1 n x i y i − a ∑ i = 1 n x i 2 − b ∑ i = 1 n x i ) (2.3) \frac{\partial f}{\partial a}=\sum_{i=1}^n2(y_i-ax_i-b) \cdot (-x_i)=-2(\sum_{i=1}^n{x_iy_i}-a\sum_{i=1}^nx_i^2-b\sum_{i=1}^nx_i) \tag{2.3} ∂a∂f=i=1∑n2(yi−axi−b)⋅(−xi)=−2(i=1∑nxiyi−ai=1∑nxi2−bi=1∑nxi)(2.3)

令

∂

f

∂

a

=

0

\frac{\partial f}{\partial a}=0

∂a∂f=0,

∂

f

∂

b

=

0

\frac{\partial f}{\partial b}=0

∂b∂f=0,

n

x

‾

=

∑

i

=

1

n

x

i

n\overline{x}=\sum_{i=1}^nx_i

nx=∑i=1nxi ,

n

y

‾

=

∑

i

=

1

n

y

i

n\overline{y}=\sum_{i=1}^ny_i

ny=∑i=1nyi

求解 a 和 b

n

y

‾

−

a

n

x

‾

−

n

b

=

0

(2.4)

n\overline{y}-an\overline{x}-nb=0 \tag{2.4}

ny−anx−nb=0(2.4)

∑

i

=

1

n

x

i

y

i

−

a

∑

i

=

1

n

x

i

2

−

b

∑

i

=

1

n

x

i

=

0

(2.5)

\sum_{i=1}^n{x_iy_i}-a\sum_{i=1}^nx_i^2-b\sum_{i=1}^nx_i=0 \tag{2.5}

i=1∑nxiyi−ai=1∑nxi2−bi=1∑nxi=0(2.5)

b

=

y

‾

−

a

x

‾

(2.6)

b=\overline{y}-a\overline{x} \tag{2.6}

b=y−ax(2.6)

∑

i

=

1

n

x

i

y

i

−

a

∑

i

=

1

n

x

i

2

−

y

‾

∑

i

=

1

n

x

i

+

a

x

‾

∑

i

=

1

n

x

i

=

0

(2.7)

\sum_{i=1}^nx_iy_i-a\sum_{i=1}^nx_i^2-\overline{y}\sum_{i=1}^nx_i+a\overline{x}\sum_{i=1}^nx_i=0 \tag{2.7}

i=1∑nxiyi−ai=1∑nxi2−yi=1∑nxi+axi=1∑nxi=0(2.7)

a = ∑ i = 0 n x i y i − y ‾ ∑ i = 0 n x i ∑ i = 0 n x i 2 − x ‾ ∑ i = 0 n x i = ∑ i = 0 n ( x i − x ‾ ) ( y i − y ‾ ) ∑ i = 0 n ( x i − x ‾ ) 2 (2.8) a=\frac{\sum_{i=0}^nx_iy_i-\overline{y}\sum_{i=0}^nx_i}{\sum_{i=0}^nx_i^2-\overline{x}\sum_{i=0}^nx_i}=\frac{\sum_{i=0}^n(x_i-\overline{x})(y_i-\overline{y})}{\sum_{i=0}^n(x_i-\overline{x})^2} \tag{2.8} a=∑i=0nxi2−x∑i=0nxi∑i=0nxiyi−y∑i=0nxi=∑i=0n(xi−x)2∑i=0n(xi−x)(yi−y)(2.8)

式2.8 的推导请看求和性质

求和性质

求和性质,具体可以参考Introductory Econometrics A Modern Approach (Fourth Edition) 一书(计量经济学导论,第4版,杰弗里·M·伍德里奇 著)的附录A。

求和性质证明

∑ i = 0 n ( x i − x ‾ ) 2 = ∑ i = 0 n ( x i 2 − 2 x i x ‾ + x ‾ 2 ) = ∑ i = 0 n x i 2 − 2 x ‾ ∑ i = 0 n x i + ∑ i = 0 n x ‾ 2 = ∑ i = 0 n x i 2 − 2 n x ‾ 2 + n x ‾ 2 = ∑ i = 0 n x i 2 − n x ‾ 2 = ∑ i = 0 n x i 2 − x ‾ ∑ i = 0 n x i \begin{aligned} & \sum_{i=0}^n(x_i-\overline{x})^2=\sum_{i=0}^n(x_i^2-2x_i\overline{x}+\overline{x}^2) \\ & =\sum_{i=0}^nx_i^2-2\overline{x}\sum_{i=0}^nx_i+\sum_{i=0}^n\overline{x}^2 \\ & =\sum_{i=0}^nx_i^2-2n\overline{x}^2+n\overline{x}^2 \\ & =\sum_{i=0}^nx_i^2-n\overline{x}^2 \\ & =\sum_{i=0}^nx_i^2-\overline{x}\sum_{i=0}^nx_i \end{aligned} i=0∑n(xi−x)2=i=0∑n(xi2−2xix+x2)=i=0∑nxi2−2xi=0∑nxi+i=0∑nx2=i=0∑nxi2−2nx2+nx2=i=0∑nxi2−nx2=i=0∑nxi2−xi=0∑nxi

分母得证

∑ i = 0 n ( x i − x ‾ ) ( y i − y ‾ ) = ∑ i = 0 n ( x i y i − x i y ‾ − x ‾ y i + x ‾ y ‾ ) = ∑ i = 0 n x i y i − n x ‾ y ‾ − n x ‾ y ‾ + n x ‾ y ‾ = ∑ i = 0 n x i y i − y ‾ ∑ i = 0 n x i \begin{aligned} & \sum_{i=0}^n(x_i-\overline{x})(y_i-\overline{y}) \\ & =\sum_{i=0}^n(x_iy_i-x_i\overline{y}-\overline{x}y_i+\overline{x}\overline{y}) \\ & =\sum_{i=0}^nx_iy_i-n\overline{x}\overline{y}-n\overline{x}\overline{y}+n\overline{x}\overline{y} \\ & =\sum_{i=0}^nx_iy_i-\overline{y}\sum_{i=0}^nx_i \end{aligned} i=0∑n(xi−x)(yi−y)=i=0∑n(xiyi−xiy−xyi+xy)=i=0∑nxiyi−nxy−nxy+nxy=i=0∑nxiyi−yi=0∑nxi

分子得证

很原始(笨)的导数推导过程

求函数f(x,y),对x的偏导

∂ f ∂ x = lim Δ x → 0 f ( x + Δ x , y ) − f ( x , y ) Δ x (3.1) \frac{\partial f}{\partial x}=\lim_ {\Delta x \to 0}\frac{f(x+\Delta x,y)-f(x,y)}{\Delta x} \tag{3.1} ∂x∂f=Δx→0limΔxf(x+Δx,y)−f(x,y)(3.1)

求函数f(x,y),对y的偏导

∂ f ∂ y = lim Δ y → 0 f ( x , y + Δ y ) − f ( x , y ) Δ y (3.2) \frac{\partial f}{\partial y}=\lim_ {\Delta y \to 0}\frac{f(x,y+\Delta y)-f(x,y)}{\Delta y} \tag{3.2} ∂y∂f=Δy→0limΔyf(x,y+Δy)−f(x,y)(3.2)

对 a 求偏导

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n ( y i − ( ( a + Δ a ) x i + b ) ) 2 − ( y i − ( a x i + b ) ) 2 Δ a (3.3) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{(yi-((a+\Delta a)x_i+b))^2-(y_i-(ax_i+b))^2}{\Delta a} \tag{3.3} ∂a∂f=Δa→0limi=1∑nΔa(yi−((a+Δa)xi+b))2−(yi−(axi+b))2(3.3)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n ( ( y i − b ) − ( a + Δ a ) x i ) 2 − ( ( y i − b ) − a x i ) 2 Δ a (3.4) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{((yi-b)-(a+\Delta a)x_i)^2-((y_i-b)-ax_i)^2}{\Delta a} \tag{3.4} ∂a∂f=Δa→0limi=1∑nΔa((yi−b)−(a+Δa)xi)2−((yi−b)−axi)2(3.4)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n ( ( y i − b ) 2 − 2 x i ( y i − b ) ( a + Δ a ) + x i 2 ( a + Δ a ) 2 ) − ( ( y i − b ) 2 − 2 a ( y i − b ) x i + a 2 x i 2 ) Δ a (3.5) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{((yi-b)^2-2x_i(yi-b)(a+\Delta a)+x_i^2(a+\Delta a)^2)-((y_i-b)^2-2a(y_i-b)x_i+a^2x_i^2)}{\Delta a} \tag{3.5} ∂a∂f=Δa→0limi=1∑nΔa((yi−b)2−2xi(yi−b)(a+Δa)+xi2(a+Δa)2)−((yi−b)2−2a(yi−b)xi+a2xi2)(3.5)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n ( y i − b ) 2 − 2 x i ( y i − b ) ( a + Δ a ) + x i 2 ( a + Δ a ) 2 − ( y i − b ) 2 + 2 a ( y i − b ) x i − a 2 x i 2 Δ a (3.6) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{(yi-b)^2-2x_i(y_i-b)(a+\Delta a)+x_i^2(a+\Delta a)^2-(y_i-b)^2+2a(y_i-b)x_i-a^2x_i^2}{\Delta a} \tag{3.6} ∂a∂f=Δa→0limi=1∑nΔa(yi−b)2−2xi(yi−b)(a+Δa)+xi2(a+Δa)2−(yi−b)2+2a(yi−b)xi−a2xi2(3.6)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n − 2 x i ( a + Δ a ) ( y i − b ) + x i 2 ( a + Δ a ) 2 + 2 a ( y i − b ) x i − a 2 x i 2 Δ a (3.7) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{-2x_i(a+\Delta a)(y_i-b)+x_i^2(a+\Delta a)^2+2a(y_i-b)x_i-a^2x_i^2}{\Delta a} \tag{3.7} ∂a∂f=Δa→0limi=1∑nΔa−2xi(a+Δa)(yi−b)+xi2(a+Δa)2+2a(yi−b)xi−a2xi2(3.7)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n − 2 x i ( y i − b ) Δ a + x i 2 ( a + Δ a ) 2 − a 2 x i 2 Δ a (3.8) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{-2x_i(y_i-b)\Delta a+x_i^2(a+\Delta a)^2-a^2x_i^2}{\Delta a} \tag{3.8} ∂a∂f=Δa→0limi=1∑nΔa−2xi(yi−b)Δa+xi2(a+Δa)2−a2xi2(3.8)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n − 2 x i ( y i − b ) Δ a + x i 2 ( a 2 + 2 a Δ a + Δ a 2 ) − a 2 x i 2 Δ a (3.9) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{-2x_i(y_i-b)\Delta a+x_i^2(a^2+2a\Delta a+\Delta a^2)-a^2x_i^2}{\Delta a} \tag{3.9} ∂a∂f=Δa→0limi=1∑nΔa−2xi(yi−b)Δa+xi2(a2+2aΔa+Δa2)−a2xi2(3.9)

∂ f ∂ a = lim Δ a → 0 ∑ i = 1 n − 2 x i ( y i − b ) Δ a + a 2 x i 2 + x i 2 2 a Δ a + x i 2 Δ a 2 − a 2 x i 2 Δ a (3.10) \frac{\partial f}{\partial a}=\lim_ {\Delta a \to 0}\sum_{i=1}^n\frac{-2x_i(yi-b)\Delta a+a^2x_i^2+x_i^22a\Delta a+x_i^2\Delta a^2-a^2x_i^2}{\Delta a} \tag{3.10} ∂a∂f=Δa→0limi=1∑nΔa−2xi(yi−b)Δa+a2xi2+xi22aΔa+xi2Δa2−a2xi2(3.10)

∂ f ∂ a = lim ∑ i = 1 n − 2 x i ( y i − b ) + x i 2 2 a + x i 2 Δ a (3.11) \frac{\partial f}{\partial a}=\lim_ {}\sum_{i=1}^n{-2x_i(y_i-b)+x_i^22a+x_i^2\Delta a} \tag{3.11} ∂a∂f=limi=1∑n−2xi(yi−b)+xi22a+xi2Δa(3.11)

∂ f ∂ a = lim ∑ i = 1 n 2 x i 2 a − 2 x i y i + 2 x i b (3.12) \frac{\partial f}{\partial a}=\lim_ {}\sum_{i=1}^n{2x_i^2a-2x_iy_i+2x_ib} \tag{3.12} ∂a∂f=limi=1∑n2xi2a−2xiyi+2xib(3.12)

∂ f ∂ a = lim ∑ i = 1 n 2 x i ( x i a − y i + b ) (3.13) \frac{\partial f}{\partial a}=\lim_ {}\sum_{i=1}^n{2x_i(x_ia-y_i+b)} \tag{3.13} ∂a∂f=limi=1∑n2xi(xia−yi+b)(3.13)

∂ f ∂ a = − 2 lim ∑ i = 1 n x i ( y i − x i a − b ) ) (3.14) \frac{\partial f}{\partial a}=-2\lim_ {}\sum_{i=1}^n{x_i(y_i-x_ia-b))} \tag{3.14} ∂a∂f=−2limi=1∑nxi(yi−xia−b))(3.14)

对 b 求偏导

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n ( y i − ( a x i + ( b + Δ b ) ) 2 − ( y i − ( a x i + b ) ) 2 Δ b (4.1) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n\frac{(yi-(ax_i+(b+\Delta b))^2-(y_i-(ax_i+b))^2}{\Delta b} \tag{4.1} ∂b∂f=Δb→0limi=1∑nΔb(yi−(axi+(b+Δb))2−(yi−(axi+b))2(4.1)

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n ( ( y i − a x i ) − ( b + Δ b ) ) 2 − ( ( y i − a x i ) − b ) ) 2 Δ b (4.2) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n\frac{((y_i-ax_i)-(b+\Delta b))^2-((y_i-ax_i)-b))^2}{\Delta b} \tag{4.2} ∂b∂f=Δb→0limi=1∑nΔb((yi−axi)−(b+Δb))2−((yi−axi)−b))2(4.2)

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n ( y i − a x i ) 2 − 2 ( y i − a x i ) ( b + Δ b ) + ( b + Δ b ) 2 − ( y i − a x i ) 2 + 2 ( y i − a x i ) b − b 2 Δ b (4.3) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n\frac{(y_i-ax_i)^2-2(y_i-ax_i)(b+\Delta b)+(b+\Delta b)^2-(y_i-ax_i)^2+2(y_i-ax_i)b-b^2}{\Delta b} \tag{4.3} ∂b∂f=Δb→0limi=1∑nΔb(yi−axi)2−2(yi−axi)(b+Δb)+(b+Δb)2−(yi−axi)2+2(yi−axi)b−b2(4.3)

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n Δ b 2 + 2 b Δ b − 2 ( y i − a x i ) Δ b Δ b (4.4) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n\frac{\Delta b^2+2b\Delta b-2(y_i-ax_i)\Delta b}{\Delta b} \tag{4.4} ∂b∂f=Δb→0limi=1∑nΔbΔb2+2bΔb−2(yi−axi)Δb(4.4)

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n 2 b − 2 ( y i − a x i ) (4.5) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n{2b-2(y_i-ax_i)} \tag{4.5} ∂b∂f=Δb→0limi=1∑n2b−2(yi−axi)(4.5)

∂ f ∂ b = lim Δ b → 0 ∑ i = 1 n 2 ( b + a x i − y i ) (4.6) \frac{\partial f}{\partial b}=\lim_ {\Delta b \to 0}\sum_{i=1}^n{2(b+ax_i-y_i)} \tag{4.6} ∂b∂f=Δb→0limi=1∑n2(b+axi−yi)(4.6)

参考最小二乘法推导