先验知识:

Self-Attention结构细节及计算过程 https://blog.csdn.net/weixin_54039182/article/details/130515594?csdn_share_tail=%7B%22type%22%3A%22blog%22%2C%22rType%22%3A%22article%22%2C%22rId%22%3A%22130515594%22%2C%22source%22%3A%22weixin_54039182%22%7D

https://blog.csdn.net/weixin_54039182/article/details/130515594?csdn_share_tail=%7B%22type%22%3A%22blog%22%2C%22rType%22%3A%22article%22%2C%22rId%22%3A%22130515594%22%2C%22source%22%3A%22weixin_54039182%22%7D

一、结构

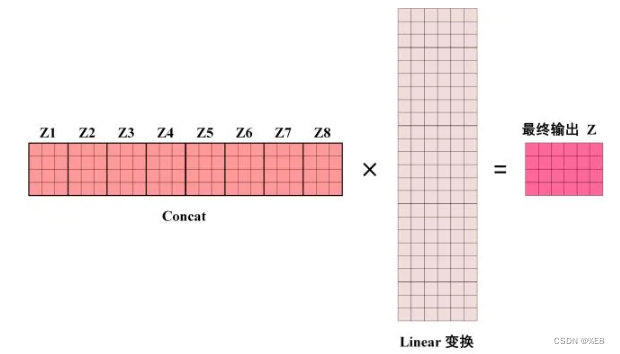

Multi-Head Attention由N个self-Attention(Self-Attention结构细节及计算过程)组成,每个self-Attention接受的K、Q、V都不同(过线性层),所以生成N个不同的Z矩阵,将N个Z矩阵拼接起来乘一个linear矩阵即得到最后的矩阵,最后的输出矩阵的形状与输入X矩阵一致。

二、Multi-head self-Attention输出

每个self-Attention接受的K、Q、V都不同(过线性层),所以生成N个不同的Z矩阵:

将N个矩阵拼接起来乘一个矩阵就得到了输出结果,结果与原始输入x矩阵形状一致:

Reference:Transformer模型详解(图解最完整版) - 知乎