[2303.10816] IMF: Interactive Multimodal Fusion Model for Link Prediction (arxiv.org)

目录

1 背景

2 贡献

3 模型

3.1 Overall Architecture

3.2 Modality-Specific Encoders

3.3 Multimodal Fusion

3.4 Contextual Relational Model

3.5 Decision Fusion

3.6 Inference

1 背景

为了获得更好的结果,一些研究方法将多模态信息引入到连接预测。但是这些研究将所有模态投影到一个统一空间中,具有相同的关系来捕捉共性,可能无法保证每个模态中的特定信息;这些方法分别利用多模态信息,忽略不同模态之间的复杂交互,无法捕捉互补性。

2 贡献

作者提出了一种新的交互式多模式融合模型(IMF),用于知识图上的多模式链接预测。

IMF可以在每个模态中单独学习知识,并通过两阶段融合对不同模态之间的复杂交互进行联合建模,类似于人类自然识别过程。

在多模态融合阶段,采用双线性融合机制,通过对比学习充分捕捉多模态特征之间的复杂交互。

对于基本链路预测模型,作者利用关系信息作为上下文来对三元组进行排序,作为每个模态中的预测。

在最终决策融合阶段,作者整合来自不同模态的预测,并利用互补信息进行最终预测。

文章的贡献如下:

(1)提出了一种新的两阶段融合模型IMF,该模型能够有效地整合不同模式的互补信息,用于链路预测。

(2)设计了一个有效的多模态融合模块,通过对比学习来捕捉双线性交互,从而对共性和互补性进行联合建模。

(3)在四个广泛使用的多模态链路预测数据集上进行了大量实验,证明了IMF的有效性和通用性

3 模型

一个知识图谱被定义为,每个实体由来自不同模态的多个特征表示

,s,v,t,m分别示图结构模态、视觉模态、文本模态和多模态模态。链接预测模型期望学习关系三元组的得分函数,以估计三元组的可能性。

3.1 Overall Architecture

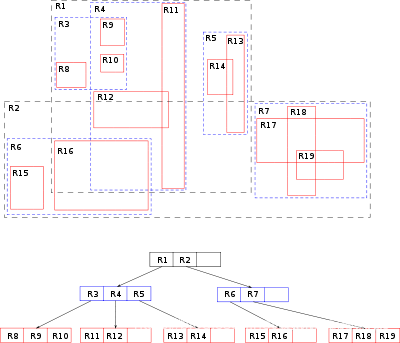

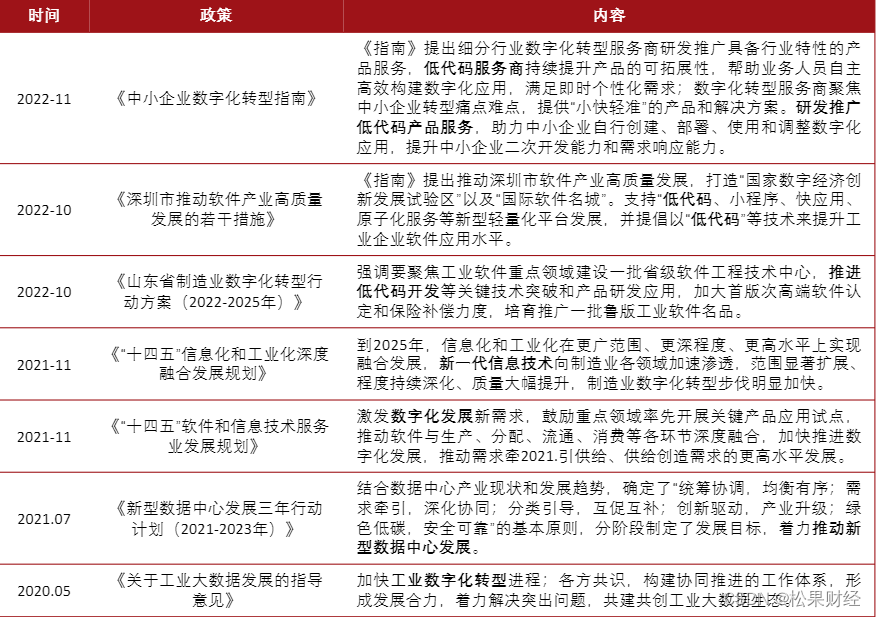

IMF由四个关键组件组成:

(1)模态特定编码器用于提取结构、视觉和文本特征,作为多模态融合阶段的输入。

(2)多模态融合模块是第一个融合阶段,它基于Tucker分解和对比学习对不同模态之间的双线性相互作用进行了有效建模。

(3)上下文关系模型计算上下文实体表示的相似性,以将三元组得分公式化为决策融合阶段的模态特定预测。

(4)决策融合模块是第二个融合阶段,它考虑了结构、视觉、文本和多模态模型的所有相似性得分,以进行最终预测。

3.2 Modality-Specific Encoders

Structural Encoder作者使用了TransE损失的GAT,并采用了对比损失。Visual Encoder使用VGG16。Textual Encoder使用BERT。

3.3 Multimodal Fusion

多模态融合阶段旨在有效地获得多模态表示,充分捕捉不同模态之间的复杂交互。许多现有的多模态融合方法已经在许多任务中取得了有希望的结果,然而,他们中的大多数人旨在通过模态投射或跨模态注意力来寻找共性,以获得更精确的表示。这些类型的方法将遭受不同模态中独特信息的损失,并且无法实现模态之间的充分交互。因此,作者使用双线性模型进行多模态信息融合,因为双线性模型具有很强的实现全参数交互的能力。

作者基于Tucker分解的方法,结构,视觉,文本模态的实体嵌入首先被投影到低维空间中,作者通过分解核心张量进一步降低复杂度,通过将所有模态的表示合并到具有逐元素乘积的统一空间中,得到每个实体的多模态表征向量

。(原来的结构,视觉,文本的实体嵌入在不同空间中,通过投影矩阵投影到相同的低维空间中)。

![]()

然后,文章对于三个模态中两两进行对比学习,正样例是不同模态之间的相同实体i,负样例是不同实体i与j

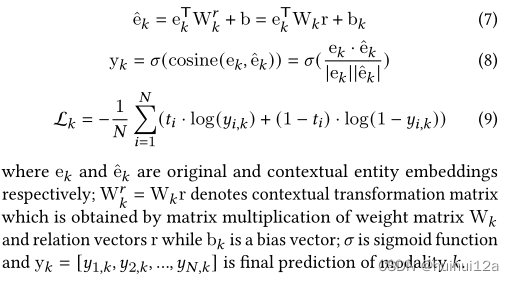

3.4 Contextual Relational Model

对于每一个模态k,作者在实体和关系嵌入之间使用双线性外积(因为它提高参数的交互),将上下文信息合并到实体表示中。利用关系在实体嵌入的转换矩阵中提供上下文,然后使用上下文转换矩阵来投影实体嵌入(转换矩阵等于权重矩阵乘关系向量,再加上偏差),从而获得上下文嵌入。

上下文嵌入用于计算与所有候选实体的相似性。预测损失函数是交叉熵损失。

![]()

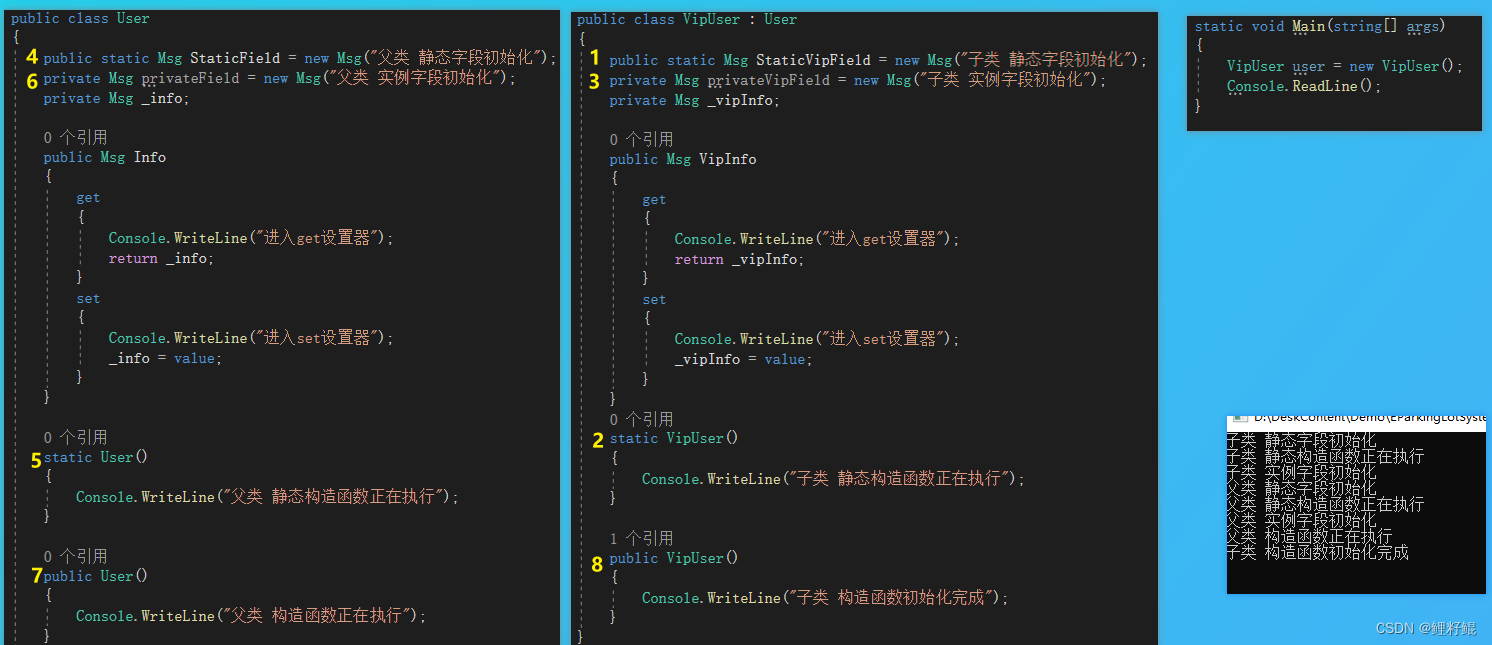

3.5 Decision Fusion

决策融合阶段的损失函数等于每个模块单独的预测损失式(9)和两两之间的对比学习损失式(6)的加权和。

![]()

3.6 Inference

作者联合考虑每个模态的预测以及多模态的预测的加权和。

最后,总体的算法流程为