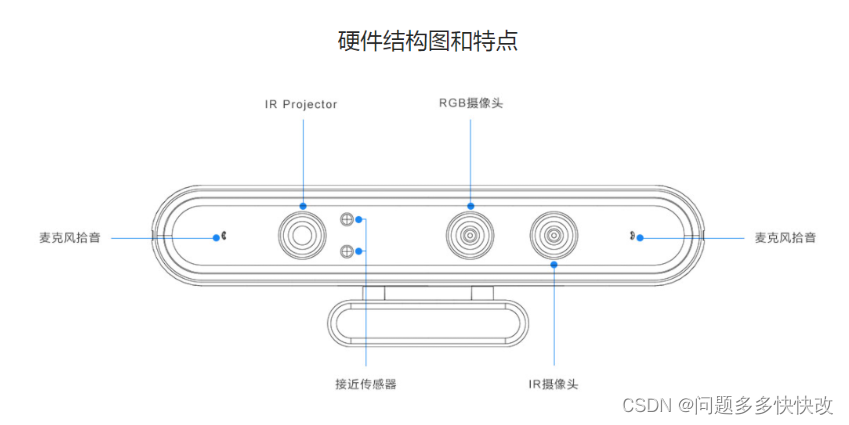

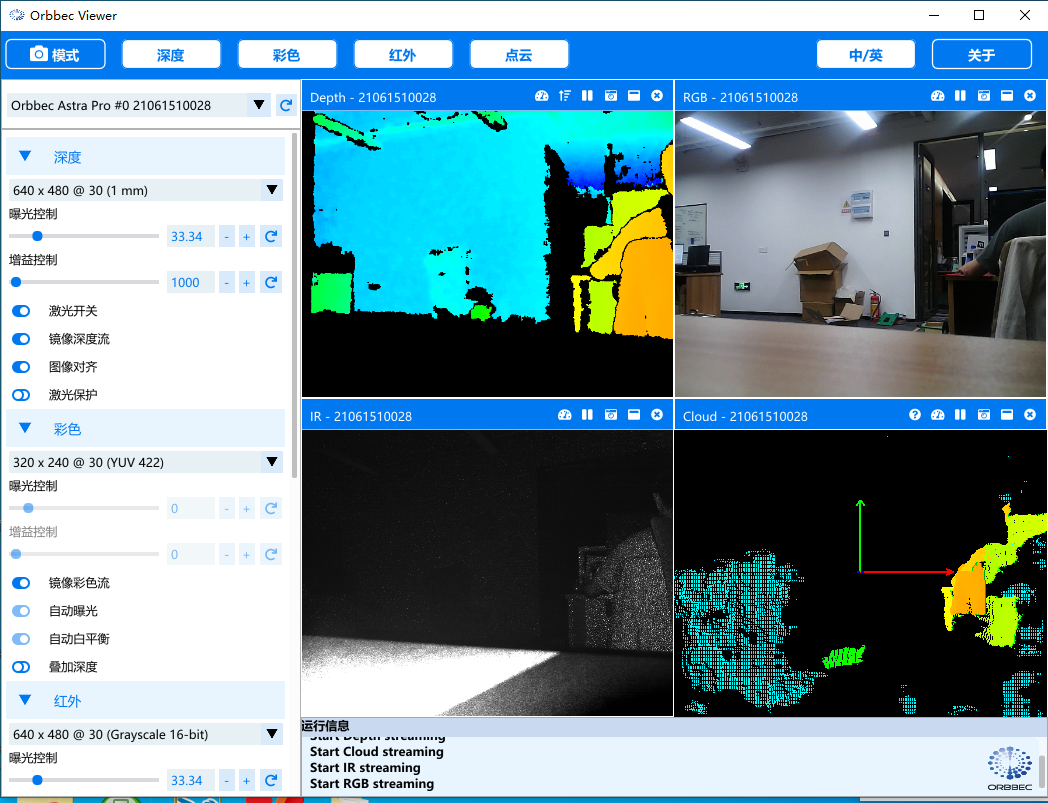

背景:我用的rosmaster r2小车配的摄像头是Astra pro,也就是下图这款:

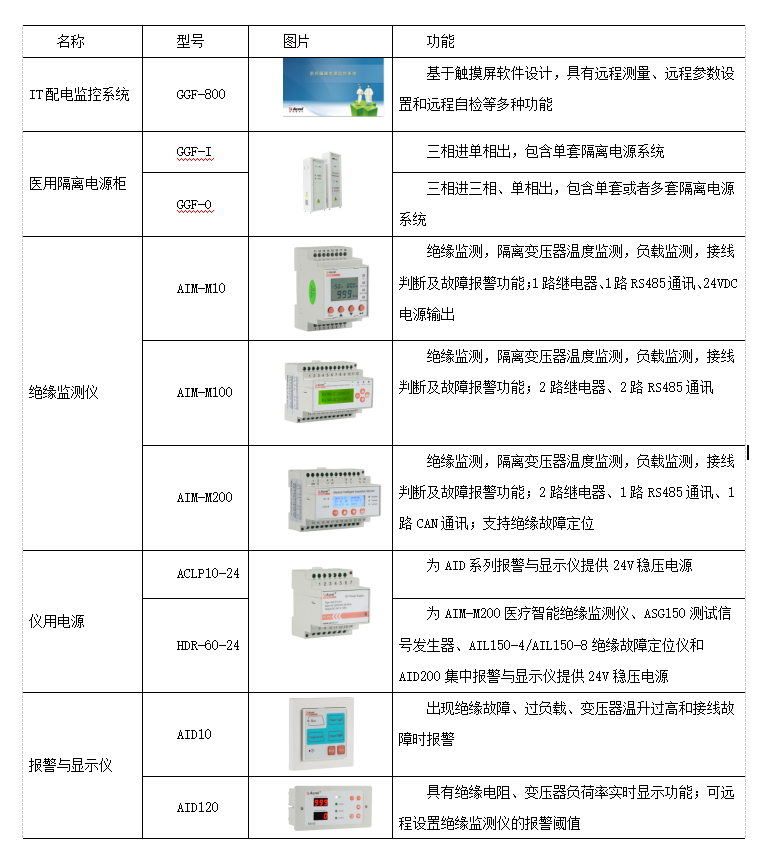

1. 支持的摄像头

Jetson开发包有多个用于连接相机的接口,包括USB、以太网和MIPI CSI-2。流行的相机是现成的支持,而Jetson生态系统合作伙伴支持广泛的附加相机组合。

现成支持的流行摄像头包括IMX219摄像头模块,如Raspberry Pi camera Module V2、Intel Realsense和Stereozed 3D摄像头以及标准USB网络摄像头,这里以usb接口的摄像头为例。

2. nvgstcapture

下面的示例使用nvgstcapture gstreamer应用程序通过nvidiaapi访问相机功能。

3. USB摄像头

安装v4l2-utils协助工具

sudo apt install v4l-utils

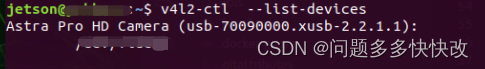

查看主板usb摄像头设备连接情况

v4l2-ctl --list-devices

可以看到是可以识别Astra pro相机的插入的

需要告诉nvgstcapture在哪里可以找到USB摄像头设备(代替默认的CSI摄像头)。

# V4L2 USB camera (where <N> is the /dev/videoN node)

nvgstcapture-1.0 --camsrc=0 --cap-dev-node=0

不出意外的话就可以直接看到摄像头实时画面了:

如果还想进行拍摄和录像等操作可以参考以下一些文章:

英伟达 Jetson Nano 新手必备:使用CSI或USB摄像头拍摄第一张照片

零基础入门Jetson Nano——通过OpenCV调用CSI和USB摄像头

Jetson Nano使用CSI摄像头以及USB摄像头(CSI摄像头打开失败,USB摄像头打不开)

关于rosmaster r2小车的Astra pro相机:

本来官网教程里说的可以实现的功能有骨骼检测、手指跟随、深度相机等一系列效果:

但由于jetson的CPU是ARM64架构,区别于电脑上的X86架构,所以小车官网上针对Ubuntu18.4(x86)的教程不适用于jetson的arm64架构:

Astra相机使用

按理来说,这教程里截图所示,相机的资源也有匹配Ubuntu arm版本的,问题不大:

但不幸的是:

我能力有限,花了俩小时也没搞懂所谓“提供Orbbec SDK搭配Orbbec Pose SDK方案或者Orbbec SDK搭配Astra Pose SDK方案,用于替代Astra SDK。” 的路子怎么走。

哪位厉害的朋友能搞定适用于jetson nano的用于替代Astra SDK方案的话,千万要不吝赐教啊

退而求其次,我只能先把usb接口的Astra相机调出来,也就是最普通的rgb通道的画面。

![[Platforimio] LVGL +TFT_eSPI实现触摸功能](https://img-blog.csdnimg.cn/818c9d07e01d43e3a2150e2f3de37df2.png)

![[MLIR] CodeGen Pipeline总结](https://img-blog.csdnimg.cn/img_convert/92185c37e19c27a9f89f70af3c32a0b2.png)