https://www.cnblogs.com/nickchen121/p/16470569.html#tid-458p3Y

参考这个文档学习条件概率的链式法则:这个是需要去补充的知识.

首先我们来看一下上一节说到的预训练,可以看到,我们比如有个鹅鸭的分类问题,

这个鹅鸭分类我们是用10万张图片训练的模型,这个已经可以把这个模型训练的很好了,然后再来看

因为:CNN卷积神经网络的浅层参数是通用的,所以我们在做另一个模型的时候,比如

我们做猫狗分类的时候,我们就可以使用我们之前做好的鹅鸭分类的,CNN的浅层,比如前50层,拿过来直接用就可以了,然后后面,我们就可以对猫狗分类问题,通过冻结的方法,也就是,我们在训练后面的50层的时候,前面50层卷积神经网络保持不变,或者通过微调的方法,比如我们在训练后面的50层的时候,前面的50层卷积神经网络也跟着变化.

还或者,第三种情况:任务B也就是猫狗分类问题,也有大数据的基础,那么这个时候,我还可以直接使用模型A,也就是鹅鸭分类问题的,卷积神经网络CNN的前50层,基础上再去训练,用这种方法来节省训练时间,节省训练成本.

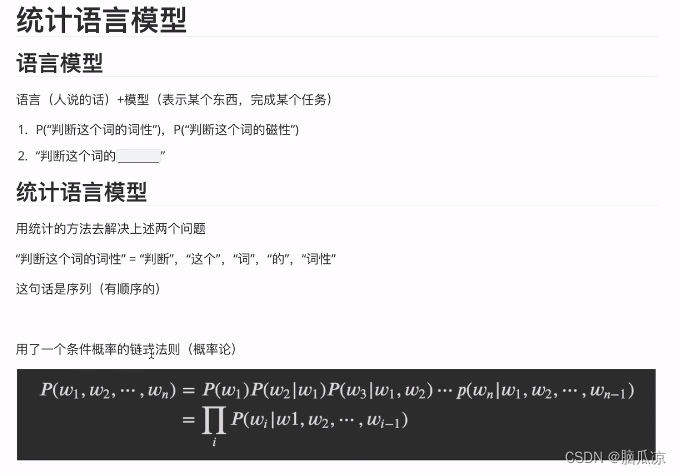

可以看到这里的语言模型

可以分成 语言 和 模型 两个部分,比如:

语言模型完成的两个主要功能:

1.P("判断这个词的词性"), P("判断这个词的磁性")

这是一种常用功能NLP的,其中一个常用功能,给出两句话,用来判断,判断,这两句话,哪个出现的概率大.

2."