© 2023 Conmajia

Initiated 10th March, 2023

昨天跟某化学家喝酒,期间提到了 ChatGPT。他的评价是:这鬼东西大量输出毫无意义、错漏百出甚至是虚假的信息,“in a confident accent”。例如某次 GPT 针对“描述某某记者”这一问题,给出了“某某是畅销图书作者”,事实上该记者从未写过或者出版过任何书籍。而 GPT 解释给出这个答案的原因竟是“因为很多记者都写过书,所以某某也写过。甚至因为其人受到关注,所以他的书作就应该是畅销书。”

听起来很离谱,不过对“人工智能”来说也很正常。所谓人工智能,现在市场上有一种弥漫着“磨刀霍霍向韭菜”的风气却把人们带到了只要一提 AI 潜意识里便只会觉得它是“智能”,而忽略了它终究是“人工”的,不可信的。毕竟人工智能的哲学基础便是“不确定性原理”。🐶

于是我们以此话题下酒,继续聊了下去。初用 GPT 时,我曾一度认为这个产品像是古早人工智能分支——“专家系统”——的现代版本,通过收集、存储数据并根据问题需求合成相应的回答,当然其中加入了现代深度学习的特性使其回答更符合人类的自然语言。但是随着使用次数增加,我从 GPT 那得到了明显错误的回答,让我意识到,这玩意儿是真的设计成了不在乎或者不能验证回答正确性的形式:但尽

人

机事,各凭天命。

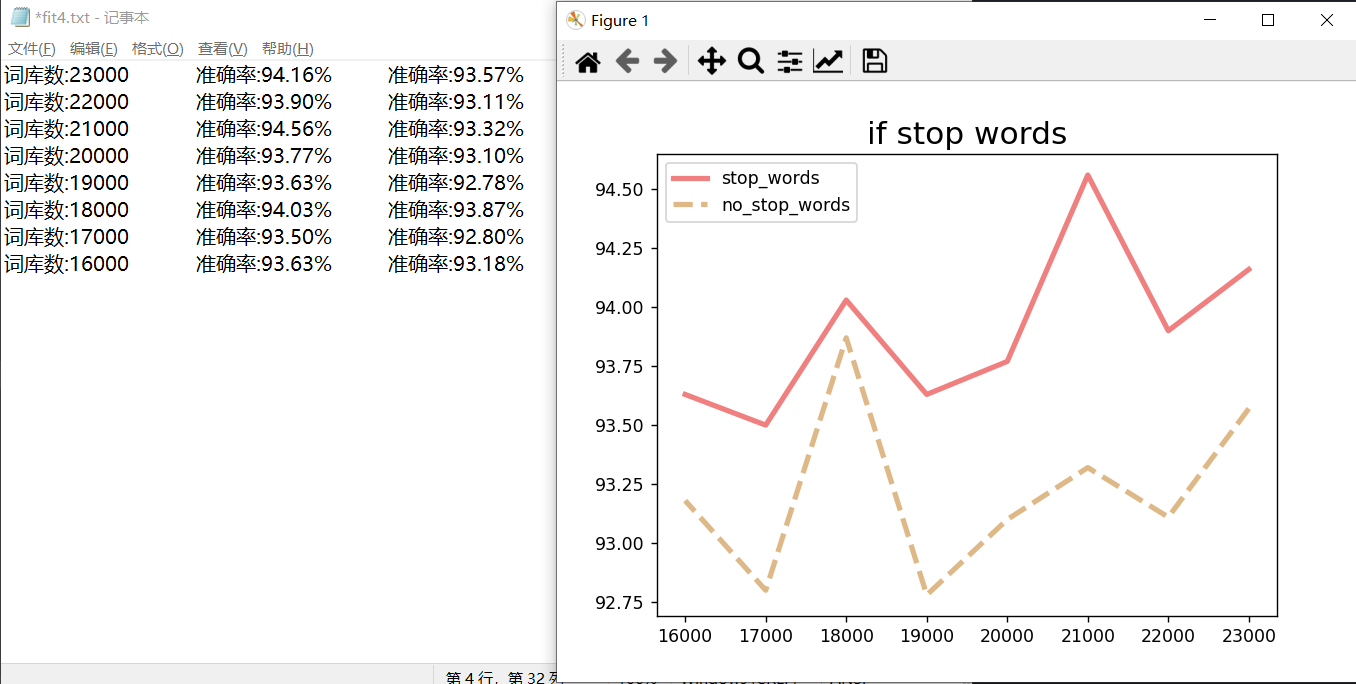

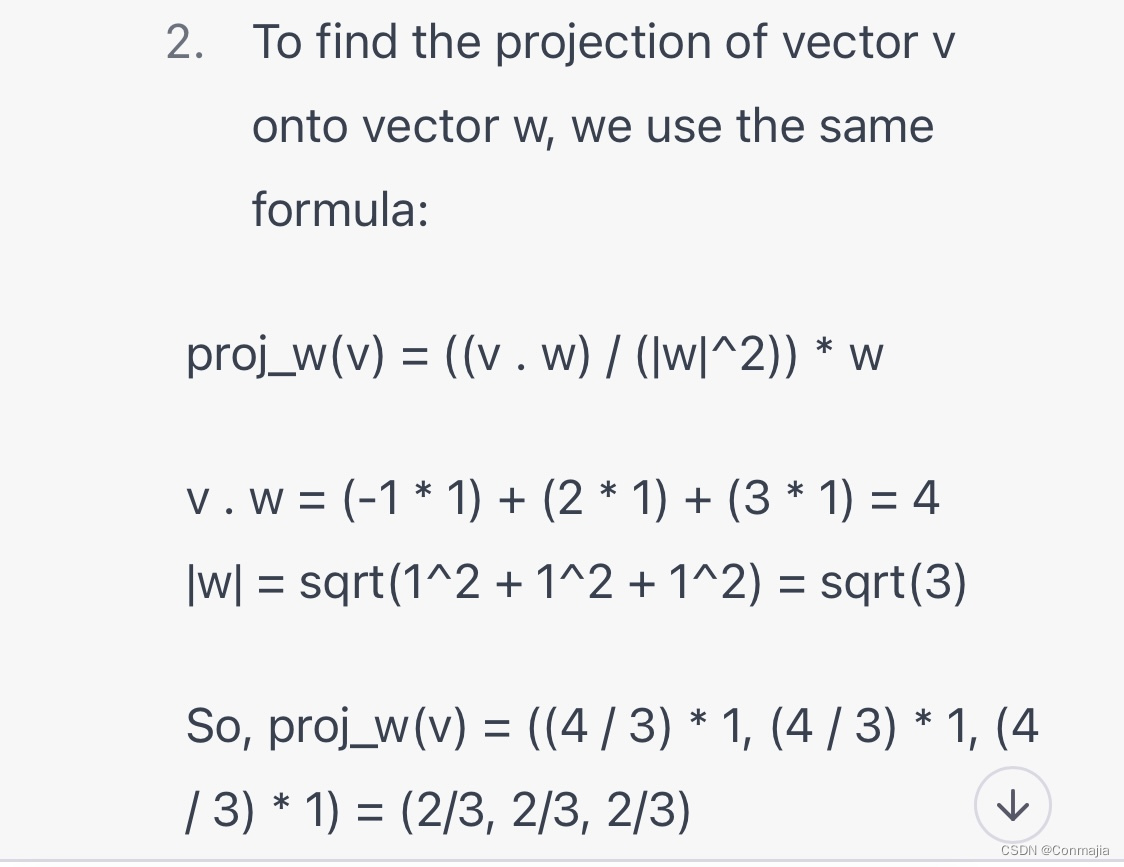

久仰于其“无所不会”的盛名,我曾要求 GPT 计算一个简单的矢量问题:求 v ⃗ = ( − 1 , 2 , 3 ) \vec{v}=(-1,2,3) v=(−1,2,3) 在 w ⃗ = ( 1 , 1 , 1 ) \vec{w}=(1,1,1) w=(1,1,1) 上的投影。我得到了如下回答:

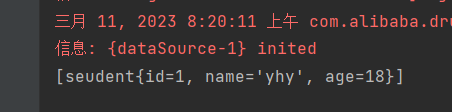

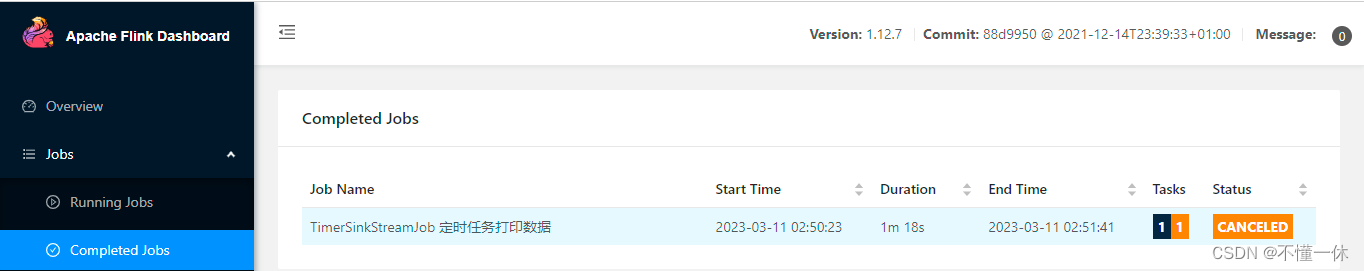

▲ ChatGPT 关于矢量投影的一次回答

GPT 找到了正确的计算公式 p r o j w ⃗ ( v ⃗ ) = v ⃗ ⋅ w ⃗ ∣ w ⃗ ∣ 2 w ⃗ \mathrm{proj}_{\vec{w}}(\vec{v})=\dfrac{\vec{v}\cdot\vec{w}}{\left|\vec{w}\right|^2}\vec{w} projw(v)=∣w∣2v⋅ww 却得到了明显错误的答案 ( 4 3 × 1 , 4 3 × 1 , 4 3 × 1 ) = ( 2 3 , 2 3 , 2 3 ) \left(\dfrac{4}{3}\times1,\dfrac{4}{3}\times 1,\dfrac{4}{3}\times 1\right)=\left(\dfrac{2}{3},\dfrac{2}{3},\dfrac{2}{3}\right) (34×1,34×1,34×1)=(32,32,32)。但是,正如化学家所遭遇的,它以“看起来非常确信”的语气,理直气壮地给出了错误答案。

酒桌上,我们的心理学家朋友呷了一大口酒,然后指出,GPT 其实只是一个语言模型。它的目标,或者说功能,仅限于尽量生成一些“语义上正确的回答”,至于这个回答是不是事实上正确的,并不是它关心的——人类终究还是一个自找麻烦的物种。当然我并不知道他的断言正确与否,毕竟我早就把 ChatGPT 标记为“仅供参考”了。

其实正确与否没人在乎,开发者只是领命行事,投资人要的显然是热度。不会真有人觉得他们是“为了人类”在努力改变世界吧?犹记得当初炒作“元宇宙”时,好似创世神降临,全体人类皆需顶礼膜拜。只要是资本推出的产品,不管是免费用户还是付出真金白银的消费者,仿佛只要你使用了产品享受了便利,你不给出品公司和资本家磕几个响头那就是愚民。结果却总是当某产品短期内成为话题焦点后,资本就到了“小试牛刀”的收获季节。比如近期 ChatGPT 从所谓“非盈利模式”正式亮明锋刃,推出 20 美金一月的 Plus 版服务,实实在在割了一茬尝鲜的韭菜。只是不知道又有多少人想要给资本家大老板下跪谢恩呢?我建议这些人每天吃完饭至少给饭馆大厨磕一个头,不过分吧?

这几日的“高温超导”新闻让媒体和股市沸腾雀跃,无论提出者有多少造假前科,也无论所谓的试验无法复现,一个个网友营销号似乎比真正的研究员、科学家们都要激动。这时候没有人再提“狼来了”,没人再提“科学需要严谨”,有的只是股价的飙升和资本的狂欢。每当人类有了“万一是真的呢”这种念头,也就意味着又一场赌局正式开始,无非就是谁是韭菜的击鼓传花游戏罢了。——评价来自两个在股市赔得底裤都快没了的倒霉蛋。😅

后记

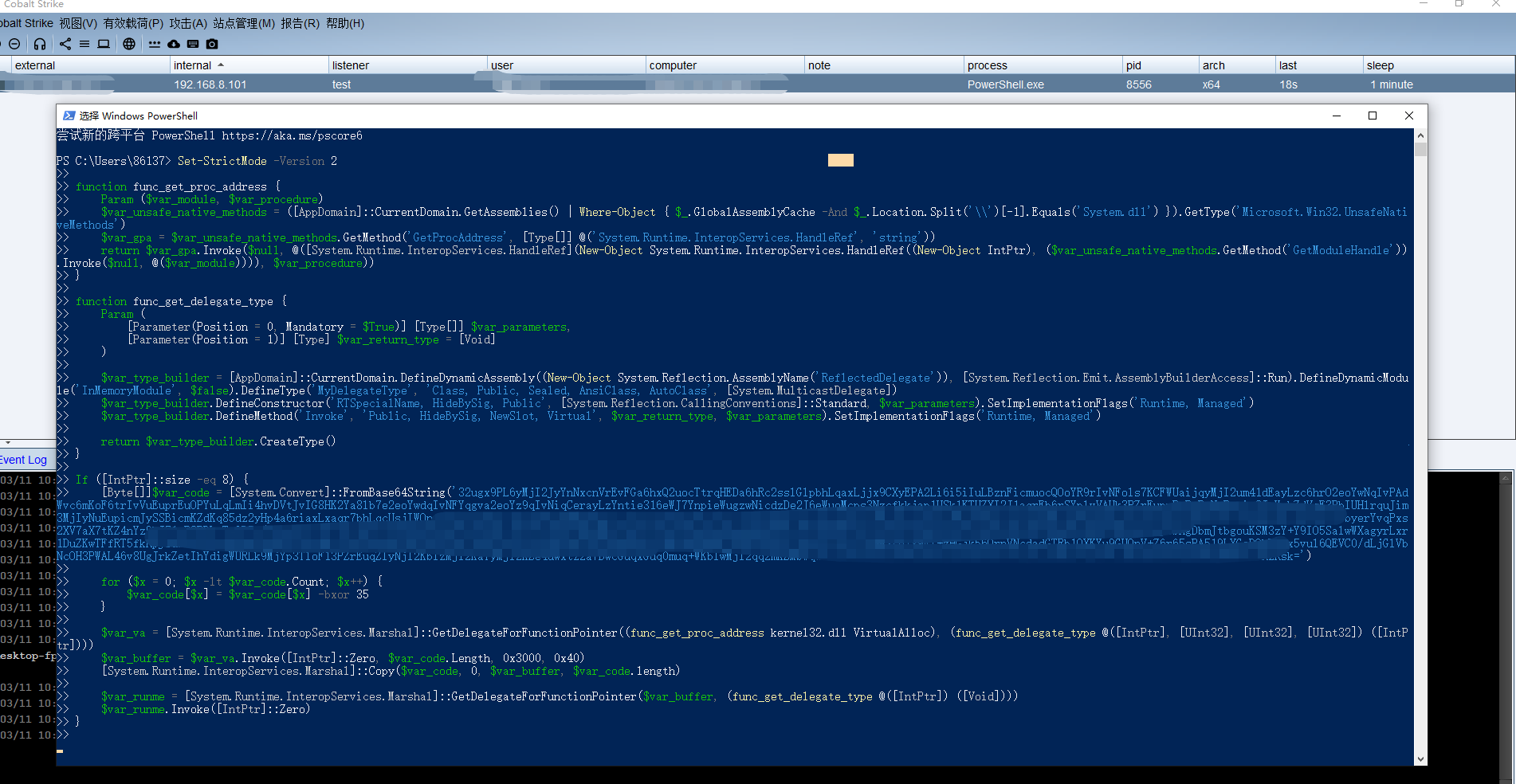

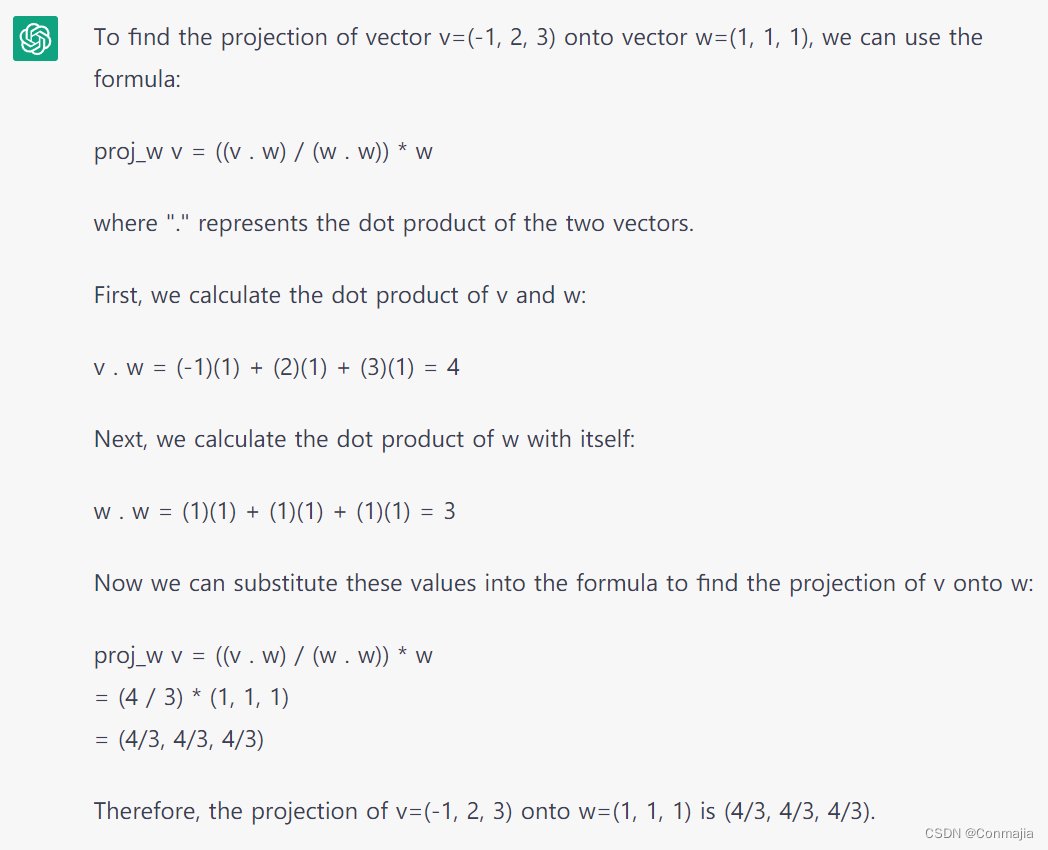

当我再次尝试提问 ( − 1 , 2 , 3 ) ⋅ ( 1 , 1 , 1 ) (-1,2,3)\cdot(1,1,1) (−1,2,3)⋅(1,1,1),得到了正确的答案 ( 4 / 3 , 4 / 3 , 4 / 3 ) \left(4/3,4/3,4/3\right) (4/3,4/3,4/3):

▲ ChatGPT 关于矢量投影的另一次回答

对于只是“玩一玩”人工智能产品的体验型用户来说,这似乎属于尚可接受的有趣经验。不过对于“依赖型”用户而言,可以说是噩梦一般的感受:承担了所有的风险(懂的都懂),却得到错误的答案——想想都很 drama。