人体行为识别任务旨在通过对人体姿态进行分析,识别出人体的具体动作,为人体行为预测、突发事件处理、智能健身、智能看护等领域提供技术支持。

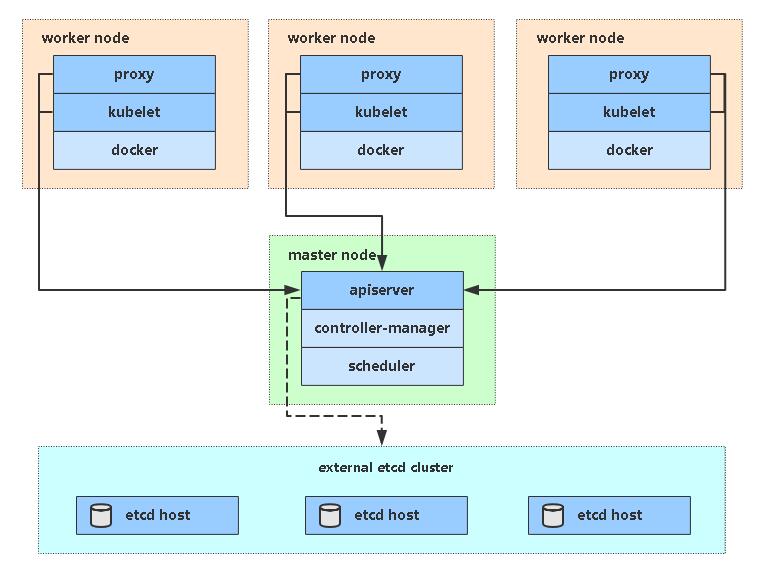

图片

图片

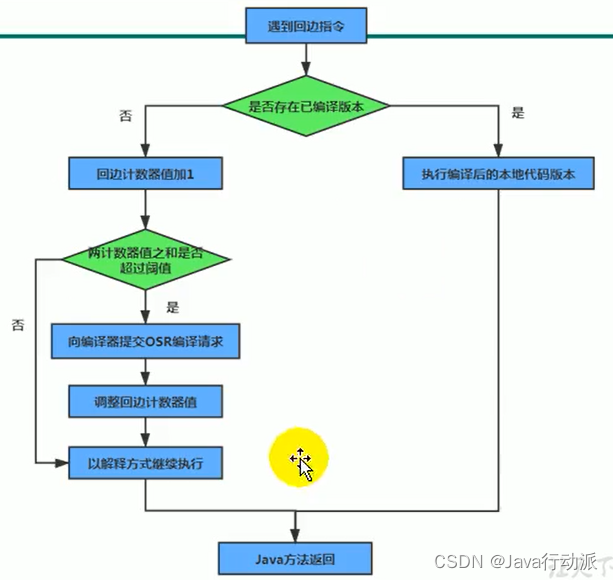

人体行为识别数据标注方式

人体行为数据通用的标注方式包括人体关键点标注和动作标签标注,人体关键点标注提供人体各关节点的位置信息。

根据不同的识别精度需求,人体关键点通常可用14点、18点、22点甚至更多点位对人体进行标注,均基于人体骨骼中可以活动的关节点扩展。

标签标注主要标注该动作对应的行为类别,是对人体行为的整体描述。人体行为通常分为静态行为和动态行为,具体标注形式如下:

静态行为:直接对图像中的目标人体进行关键点标注,并对整体行为种类做标签标注。

动态行为:对于动态行为,还需增加视频抽帧模块,对动态人体行为视频基于特定的采样率抽取图像帧,然后对图像帧标注人体关键点信息,对动态行为视频整体标注人体行为种类标签标注。

图片

图片

人体行为识别任务难点

基于实际情况,人体行为识别任务具备以下三个难点:

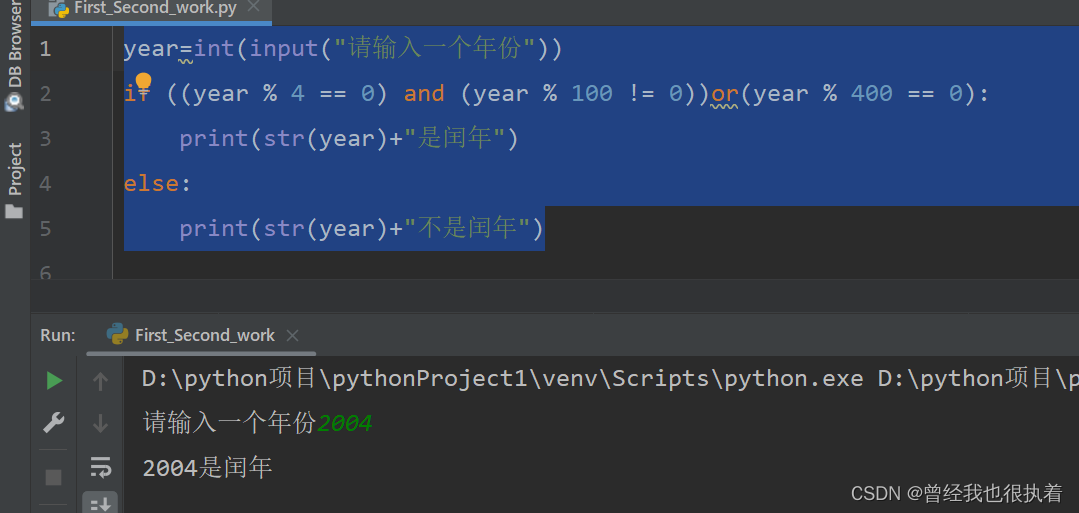

行为复杂:人体行为种类众多,并且部分行为存在一定程度的主观性(例如徘徊行为),造成算法识别难度较大。

人体遮挡:人体在做特定行为时会出现自身遮挡现象,此外人体在真实场景下会被场景中其他的目标遮挡,造成关键点检测困难。

数据噪声:在真实场景下数据噪声影响较大,以安防监控场景为例,首先安防摄像头分辨率普遍较低、拍摄距离较远,人体特征占比较小;其次安防场景下不同的光照条件对人体特征影响较大;此外,人体做动态动作时还会造成动态模糊现象。

以上各种因素对人体识别算法的鲁棒性提出了挑战。

图片

图片

数据堂人体行为识别数据集

数据堂针对人体行为识别的任务需求和难点,从数据层面分别对静态行为和动态行为针对性设计了下述数据集,分别介绍如下:

01

50356张人体抠图及18关键点数据

该数据集采集黄种人、黑人、白人共50356张图像。为提升行为多样性,数据针对性采集了正常人体动作数据和众多体育锻炼场景下大幅度人体姿态变化数据,同时为了保证数据的真实性,图像中会出现大量的人体附属物遮挡及场景遮挡现象。在数据标注方面,标注了人体目标的18关键点位置、语义分割轮廓。

数据具体介绍如下:

02

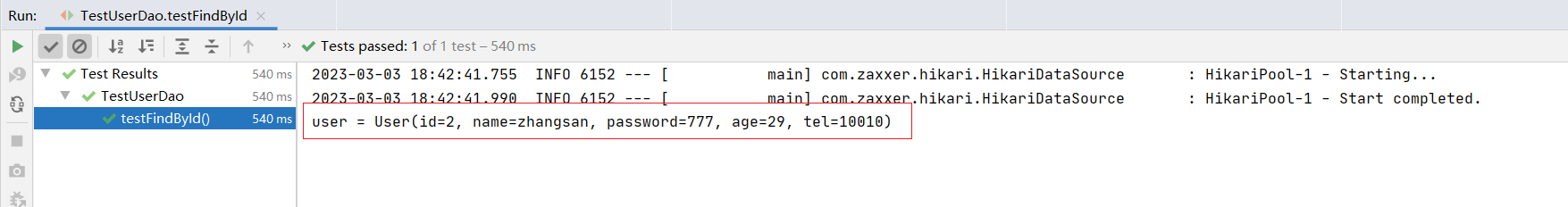

466人18880张3D人体实例分割及人体22关键点标注数据

该数据采用深度相机采集466人的3D人体行为数据,且深度信息与2D信息已完成配准。采集了人体常见的行为姿态,包括简单的舞蹈动作、四肢伸展动作和一些盘腿俯身等非站立动作。在标注方面,标注了人体目标的22关键点位置、语义分割轮廓和动作大类别标签。

数据具体介绍如下:

图片

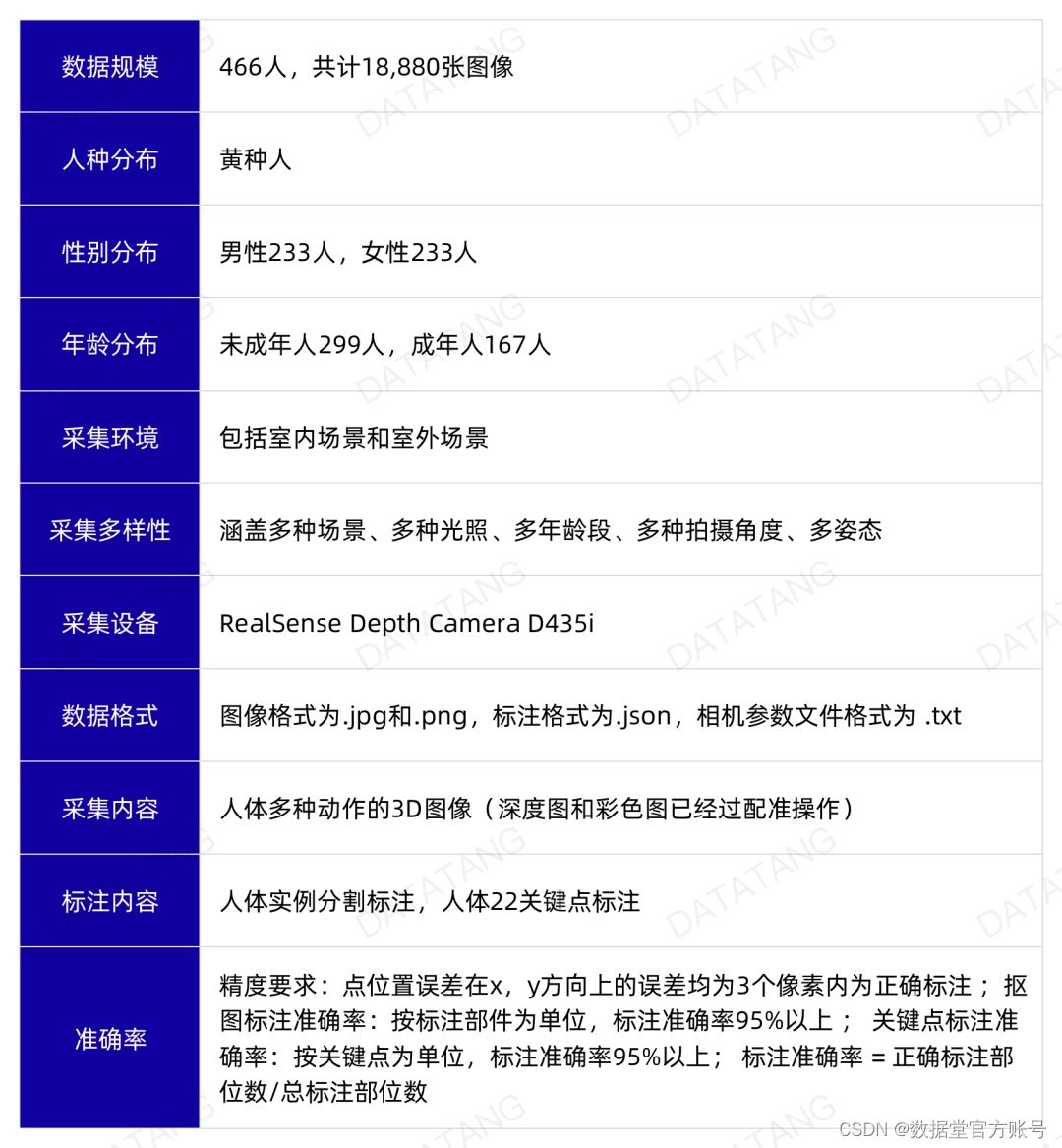

5500人安防监控人体行为识别数据

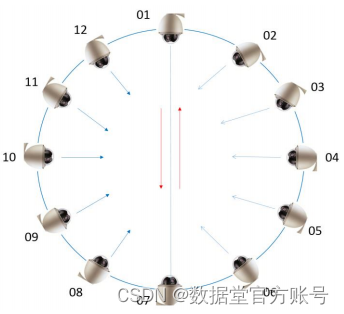

该数据集在采集过程中首先进行采集场景搭建,在场地周围环形布置了12个采集摄像头(每30度一个摄像头,保证同一行为可获取多视角数据),被采集者按要求采集安防监控场景下通常出现的人体行为,包括站立、蹲下、走路、打招呼我、握手、打电话、抽烟、徘徊、跌倒、蹲下护头等。在标注方面,数据集对每一段行为均进行了行为标签标注。

数据具体介绍如下:

图片 摄像头机位布置示意图

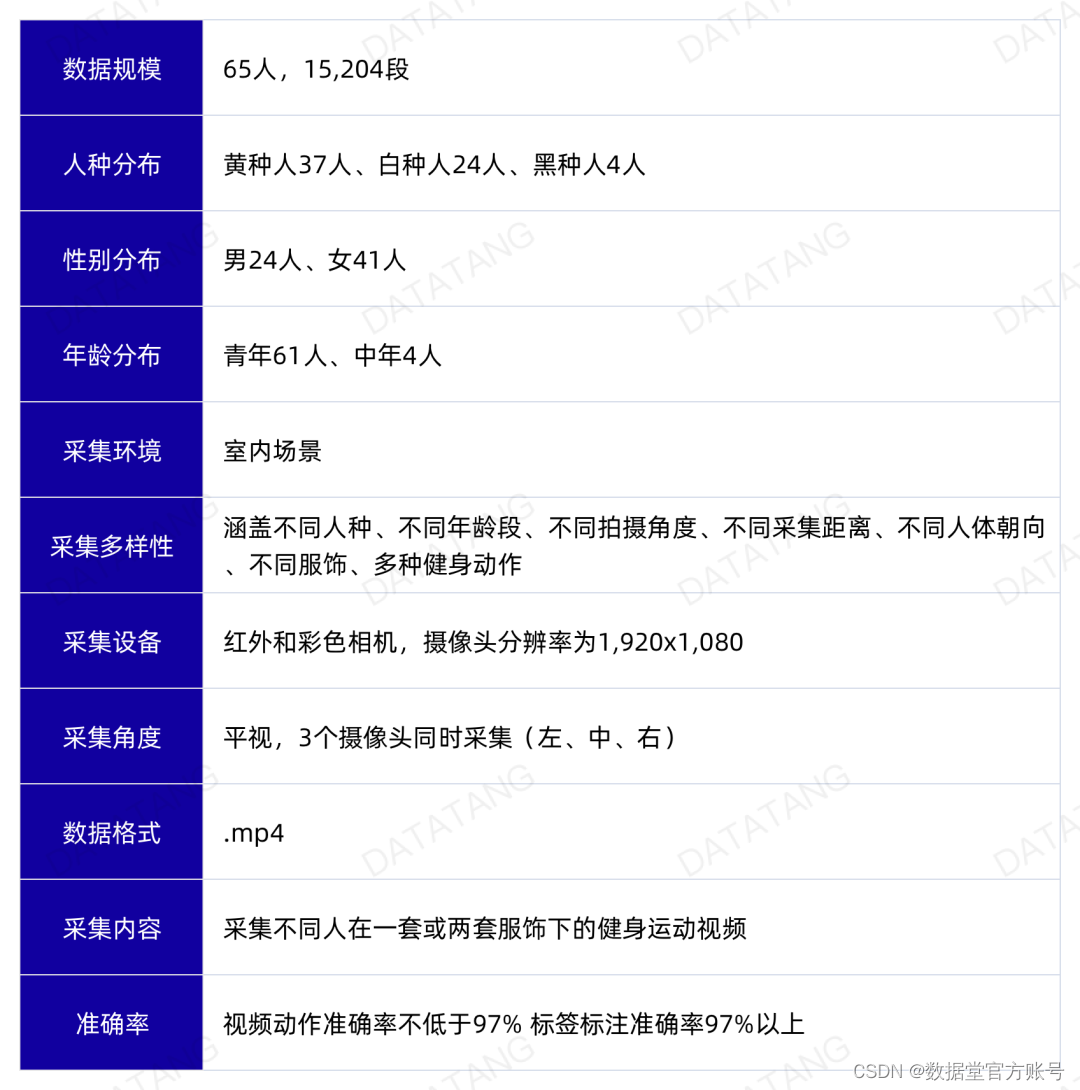

65人15204段健身视频行为识别数据

该数据集利用彩色相机和红外相机采集人体健身视频数据,为保证数据多样性,在采集过程中对拍摄距离、采集服饰等都做了多样化设计。在具体健身行为方面,数据涵盖了常见的健身动作50种,包括跳绳、俯卧撑、平板支撑、纵跳、深蹲、开合跳等,可以满足大多数健身行为识别算法需求。在数据标注方面,数据集标注了每段视频对应的健身动作标签。

数据具体介绍如下:

依托自身的数据优势以及丰富的数据处理经验,数据堂推出的人体行为识别数据集,为人体行为识别技术应用的广泛落地提供助力。