【论文速递】CVPR2021 - 基于自引导和交叉引导的小样本分割算法

【论文原文】:Self-Guided and Cross-Guided Learning for Few-Shot Segmentation

【作者信息】:Bingfeng Zhang, Jimin Xiao , Terry Qin

获取地址:https://openaccess.thecvf.com/content/CVPR2021/papers/Zhang_Self-Guided_and_Cross-Guided_Learning_for_Few-Shot_Segmentation_CVPR_2021_paper.pdf

博主关键词: 小样本学习,语义分割,自引导,交叉引导

推荐相关论文:

- 无

摘要:

小样本分割由于其对带有少量注释样本的不可见对象类分割的有效性而引起了广泛的关注。现有方法大多使用掩码全局平均池(GAP)将带注释的支持图像编码为特征向量,以方便查询图像分割。然而,由于平均操作,这个管道不可避免地会丢失一些鉴别信息。在本文中,我们提出了一种简单而有效的自引导学习方法,其中挖掘丢失的关键信息。具体来说,通过对标注后的支持图像进行初始预测,将覆盖前景区域和未覆盖前景区域分别用掩码GAP编码为主支持向量和辅助支持向量。通过主支持向量和辅助支持向量的聚合,对查询图像具有较好的分割效果。受到我们用于1shot分割的自引导模块的启发,我们提出了一个用于多镜头分割的交叉引导模块,其中最终的掩模使用来自多个注释样本的预测融合,高质量的支持向量贡献更多,反之亦然。该模块在无需重新训练的情况下提高了推理阶段的最终预测。大量的实验表明,我们的方法在PASCAL-5i和COCO-20i数据集上都达到了最新的性能。源代码可在https://github.com/zbf1991/SCL获得。

简介:

随着深度神经网络特别是全卷积网络[18]的发展,语义分割技术取得了很大的进展。目前最先进的语义分割方法需要足够和准确的像素级标注数据,可以产生令人满意的分割掩码。然而,这些方法严重依赖于大量带注释的数据。在不可见的类或注释数据不足时,它们的性能会急剧下降。

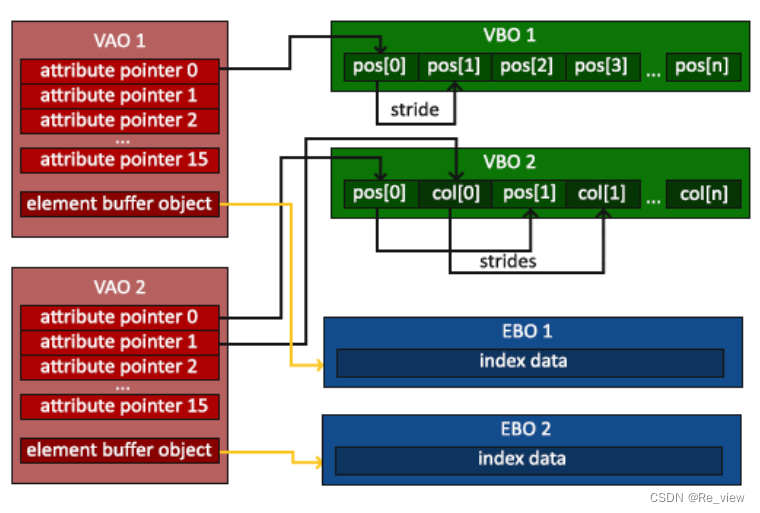

小样本分割[8,14,20,24]是解决这一问题的一种很有前途的方法。与全监督语义分割[3,5,11,13]只能分割训练集中相同的类相比,小样本分割的目的是利用一个或几个带注释的样本来分割新的类。具体来说,将小样本分割中的数据分为支持集和查询集两个集。该任务需要从查询集中分割图像,给定支持集中的一个或多个带注释的图像。因此,这项任务的关键挑战是如何利用来自支持集的信息。大多数方法[6,17,30,35,32,26]采用暹罗卷积神经网络(SCNN)对支持图像和查询图像进行编码。为了应用支持图像中的信息,他们主要使用mask Global Average Pooling (GAP)[38]或其他增强方法[19],将所有前景[30,35,16]或背景[30]提取为一个特征向量,作为原型计算余弦距离[36]或对查询图像进行密集比较[35]。

使用从支持图像中提取的支持特征向量确实便于查询图像分割,但它携带的信息不足。图1显示了支持图像和查询图像完全相同的极端示例。然而,即使是现有的最好的方法也不能准确地分割查询图像。我们认为,当我们使用掩码GAP或其他方法[19]将支持图像编码为特征向量时,由于平均运算而丢失一些有用的信息是不可避免的。使用这样的特征向量来指导分割,并不能对像素点进行精确的预测,这需要丢失的信息作为支持。此外,对于多镜头的情况,如5shot分割,通常的做法是使用5个独立支持图像的预测的平均值作为最终预测[36]或5个支持向量的平均值作为最终支持向量[30]。但是,不同的支持图像的质量是不同的,使用一个平均的操作力所有的支持图像共享相同的贡献。

在本文中,我们提出了一种简单而有效的自引导和交叉引导学习方法(SCL)来克服上述缺点。具体来说,我们设计了一个自引导模块(Self-Guided Module, SGM)来从支持集中提取全面的支持信息。通过对带有初始原型的注释支持图像进行初始预测,将覆盖前景区域和未覆盖前景区域分别用掩码GAP编码为主支持向量和辅助支持向量。通过主支持向量和辅助支持向量的聚合,对查询图像具有较好的分割效果。

受到我们提出的SGM的启发,我们提出了一个用于多镜头分割的交叉引导模块(CGM),我们可以使用其他注释的支持图像来评估每个支持图像的预测质量,这样高质量的支持图像将在最终的融合中贡献更多,反之亦然。与其他复杂的方法如注意力机制[35,34]相比,我们的CGM不需要重新训练模型,在推理时直接应用它可以提高最终的性能。大量的实验表明,我们的方法在PASCAL-5i和COCO-20i数据集上实现了新的最先进的性能。

我们的贡献总结如下:

- 我们观察到,使用平均运算来获取支持向量,不可避免地会丢失一些有用的关键信息。为了缓解这一问题,我们提出了一种自引导机制,通过强化这些容易丢失的信息来挖掘更全面的支持信息,从而对查询图像预测准确的分割掩码。

- 我们提出了一个交叉引导模块来融合来自不同支持图像的多个预测,以完成多shot分割任务。无需对模型进行重新训练,可以直接在推理过程中使用,从而提高最终的性能。

- 我们的方法可以应用于不同的基线,直接提高他们的性能。使用我们的方法在PASCAL-5i数据集(mIoU用于1次拍摄:61.8%,5次拍摄:62.9%)和COCO-20i数据集(mIoU用于1次拍摄:37.0%,5次拍摄:39.9%)上实现了这项任务的最新性能。