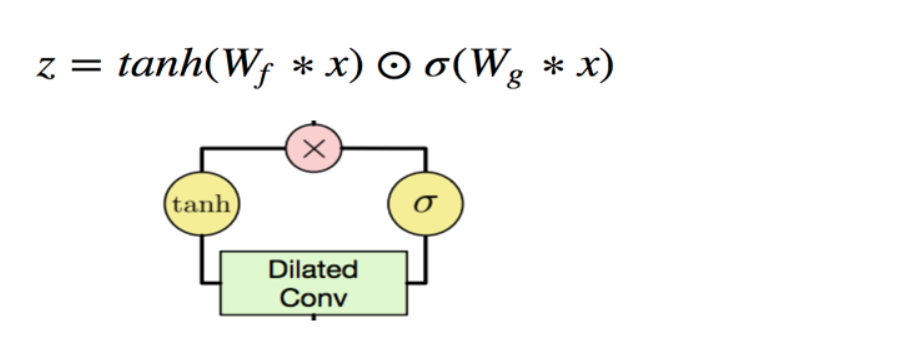

门控激活

在架构图的方框部分,您会注意到扩张卷积输出分成两个分支,随后通过逐元素乘法重新组合。这描绘了一个门控激活单元,其中我们将tanh激活分支解释为一个学习过滤器,将sigmoid激活分支解释为一个学习门,用于调节来自过滤器的信息流。如果这让您想起LSTM 或 GRU中使用的门控机制,那么您说对了,因为这些模型使用相同类型的信息门控来控制对其细胞状态的调整。

在数学符号中,这意味着我们通过以下公式将卷积块的输入x映射到输出z ,其中Ws对应于(学习的)扩张因果卷积权重:

为什么使用门控激活而不是更标准的ReLU激活?WaveNet 设计者发现,门控激活在音频数据方面比 ReLU 激活具有更强的经验性能,并且这种优异性能可能广泛扩展到时间序列数据。也许ReLU 激活引起的稀疏性不像其他问题领域那样适合时间序列预测,或者门控激活允许更平滑的信息(梯度)在多层 WaveNet 架构上流动。