本文用于记录搭建昇思MindSpore开发及使用环境的过程,并通过MindSpore的API快速实现了一个简单的深度学习模型。

什么是MindSpore?

昇思MindSpore是一个全场景深度学习框架,旨在实现易开发、高效执行、全场景覆盖三大目标。

安装步骤

鉴于笔者手头硬件资源有限,这里采用的环境是CPU。如下是在CPU环境的Windows系统上,使用pip方式快速安装MindSpore的步骤:

- 确认系统环境信息

- 确认安装Windows 10是x86架构64位操作系统。

- 确认安装Python(>=3.7.5),已有Python环境是Python3.9.7版本,满足要求。

- 安装MindSpore

运行以下命令:

# Python3.9

pip install https://ms-release.obs.cn-north-4.myhuaweicloud.com/2.0.0a0/MindSpore/cpu/x86_64/mindspore-2.0.0a0-cp39-cp39-win_amd64.whl --trusted-host ms-release.obs.cn-north-4.myhuaweicloud.com -i https://pypi.tuna.tsinghua.edu.cn/simple

在联网状态下,安装whl包时会自动下载mindspore安装包的依赖项。

安装报错 :

ERROR: Could not install packages due to an OSError: [WinError 5] 拒绝访问。: 'D:\\Program Files\\Anaconda\\Lib\\site-packages\\~-mpy\\.libs\\libopenblas.FB5AE2TYXYH2IJRDKGDGQ3XBKLKTF43H.gfortran-win_amd64.dll' Consider using the `--user` option or check the permissions.

这是因为pip安装模块的权限不够导致失败,笔者是通过执行下面的命令得以解决。

pip install -i http://pypi.douban.com/simple/ pip -U --trusted-host pypi.douban.com --user

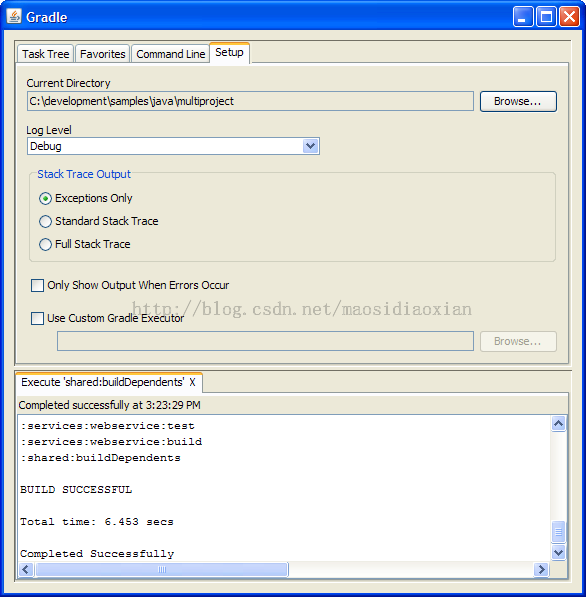

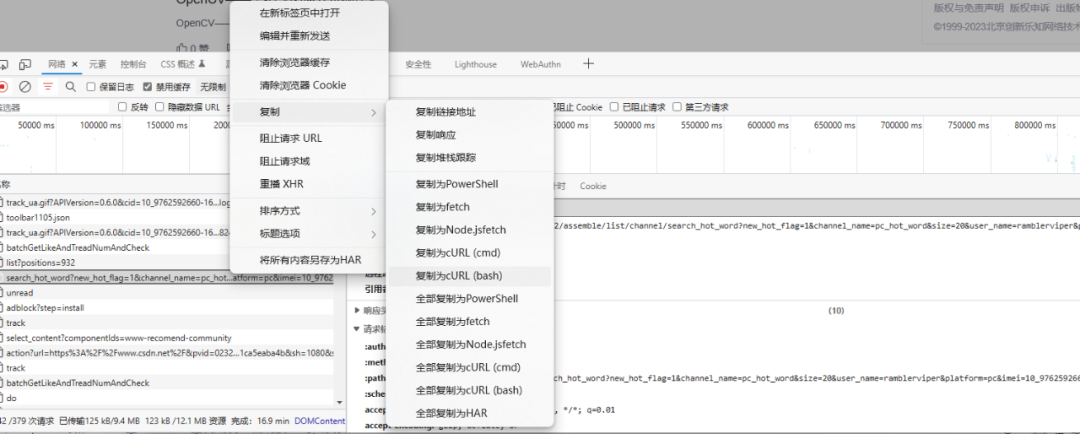

执行完上述命令之后再次安装mindspore,如下图。

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-sRliKJ4o-1676715767200)(imgs/230217155424.png)]

- 验证安装是否成功

python -c "import mindspore;mindspore.run_check()"

输出如下内容,表明安装成功。

快速入门

这里以手写体数字识别为例,体验了基于MindSpore的API实现深度学习模型的过程。

场景描述

本文使用Mindspore,基于Resnet50神经网络完成手写体数字识别。

数据集处理

下载Mnist数据集

Mnist数据集是机器学习领域的一款经典数据集,其中包括6w个训练样本和1w个测试样本,每个样本都是28*28像素的灰度手写数字图片,数字0-9共10类。通过如下代码下载:

# Download data from open datasets

from download import download

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

"notebook/datasets/MNIST_Data.zip"

path = download(url, "./", kind="zip", replace=True)

获取数据集对象

train_dataset = MnistDataset('MNIST_Data/train')

test_dataset = MnistDataset('MNIST_Data/test')

print(train_dataset.get_col_names()) #['image', 'label']

数据集目录如下,其中标记为images的是图片,labels是标签。

数据处理

数据集自动下载完成后,可使用数据处理模块 mindspore.dataset 进行预处理。这里采用的是流水线处理,在海量数据下,该处理模式可以实现数据的高效处理,当然也会占用更多的CPU和内存资源。

- 使用map对图像数据及标签进行变换处理,并将处理完的数据集打包,batchsize为64。map函数会将数据集中第二个参数的指定的列作为输入,调用第一个参数的处理函数执行处理,如果有多个处理函数,上一个函数的输出作为下一个函数的输入。其中,map的第一个参数是处理函数列表,第二个参数表示需要处理的列。

def data_process(dataset, batch_size):

image_transforms = [

#图像缩放,输出像素值output = image * rescale + shift.

vision.Rescale(1.0 / 255.0, 0),

#根据平均值和标准偏差对输入图像进行归一化,其中,mean是图像各个通道的均值,std是各个通道的标准差

vision.Normalize(mean=(0.1307,), std=(0.3081,)),

#转换图像格式,在不同的硬件设备中可能会对(height, width, channel)

# 或(channel, height, width)两种不同格式有针对性优化。MindSpore设

# 置HWC为默认图像格式,在有CWH格式需求时,可使用该变换进行处理。

vision.HWC2CHW()

]

# 转为mindspore的int32格式

label_transform = transforms.TypeCast(mindspore.int32)

# 对各个图像按照流水线处理

dataset = dataset.map(image_transforms, 'image')

# 将各个标签转为int32类型

dataset = dataset.map(label_transform, 'label')

dataset = dataset.batch(batch_size)

return dataset

train_dataset = data_process(train_dataset, 64)

test_dataset = data_process(test_dataset, 64)

- 使用create_tuple_iterator或create_dict_iterator对数据集进行迭代。

# image, label = next(train_dataset.create_tuple_iterator())

for image, label in test_dataset.create_tuple_iterator():

print(f"Shape of image [N, C, H, W]: {image.shape} {image.dtype}")

print(f"Shape of label: {label.shape} {label.dtype}")

break

for data in test_dataset.create_dict_iterator():

print(f"Shape of image [N, C, H, W]: {data['image'].shape} {data['image'].dtype}")

print(f"Shape of label: {data['label'].shape} {data['label'].dtype}")

break

网络构建

基于mindspore的nn.Cell类,构建Resnet50神经网络。

神经网络模型由神经网络层和Tensor操作构成,基于 mindspore.nn 可实现常见的神经网络层,其中 nn.Cell 类是构建所有网络的基类,也是网络的基本单元。一个神经网络模型可表示为一个Cell,它又是由

不同的子Cell组成。基于这样的嵌套结构,即可简单地使用面向对象编程的思维,对神经网络结构进行构建和管理。

定义模型类

定义神经网络模型继承nn.Cell类,再在__init__方法中进行子Cell的实例化和状态管理,在construct方法中实现Tensor操作。

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

构建完成后,实例化Network对象,并查看结构。

model = Network()

print(model)

模型层分解

构造一个shape为(3, 28, 28)的随机数据(3个28x28的图像)。

input_image = ops.ones((3, 28, 28), mindspore.float32)

print(input_image.shape) #(3, 28, 28)

-

nn.Flatten

实例化nn.Flatten层,将28x28的2D张量转换为784大小的连续数组。

flatten = nn.Flatten() flat_image = flatten(input_image) print(flat_image.shape) # (3, 784) -

nn.Dense

nn.Dense为全连接层,其使用权重和偏差对输入进行线性变换。

layer1 = nn.Dense(in_channels=28*28, out_channels=20) hidden1 = layer1(flat_image) print(hidden1.shape) #(3, 20) -

nn.ReLU

nn.ReLU层给网络中加入非线性的激活函数,帮助神经网络学习各种复杂的特征。

print(f"Before ReLU: {hidden1}\n\n") hidden1 = nn.ReLU()(hidden1) print(f"After ReLU: {hidden1}")

-

nn.SequentialCell

nn.SequentialCell是一个有序的Cell容器。输入Tensor将按照定义的顺序通过所有Cell。我们可以使用SequentialCell来快速组合构造一个神经网络模型。

seq_modules = nn.SequentialCell( flatten, layer1, nn.ReLU(), nn.Dense(20, 10) ) logits = seq_modules(input_image) print(logits.shape) #(3,10) -

nn.Softmax

最后使用nn.Softmax将神经网络最后一个全连接层返回的logits的值缩放为[0, 1],表示每个类别的预测概率。axis指定的维度数值和为1。

softmax = nn.Softmax(axis=1) pred_probab = softmax(logits)输出如下:

[[0.09906127 0.09989168 0.101061 0.10052359 0.09982764 0.1007046 0.10100672 0.09960879 0.09997301 0.09834171] [0.09906127 0.09989168 0.101061 0.10052359 0.09982764 0.1007046 0.10100672 0.09960879 0.09997301 0.09834171] [0.09906127 0.09989168 0.101061 0.10052359 0.09982764 0.1007046 0.10100672 0.09960879 0.09997301 0.09834171]]

模型参数

网络内部神经网络层具有权重参数和偏置参数(如nn.Dense),这些参数会在训练过程中不断进行优化,可通过 model.parameters_and_names() 来获取参数名及对应的参数详情。

print(f"Model structure: {model}\n\n")

for name, param in model.parameters_and_names():

print(f"Layer: {name}\nSize: {param.shape}\nValues : {param[:2]} \n")

模型训练

#定义损失函数和优化器

loss_fn = nn.CrossEntropyLoss()

optimizer = nn.SGD(model.trainable_params(), 1e-2)

通常,一个完成的模型训练过程包括如下三步:

- 正向计算:模型对结果预测,输出logits值,并与正确标签label求预测损失loss。

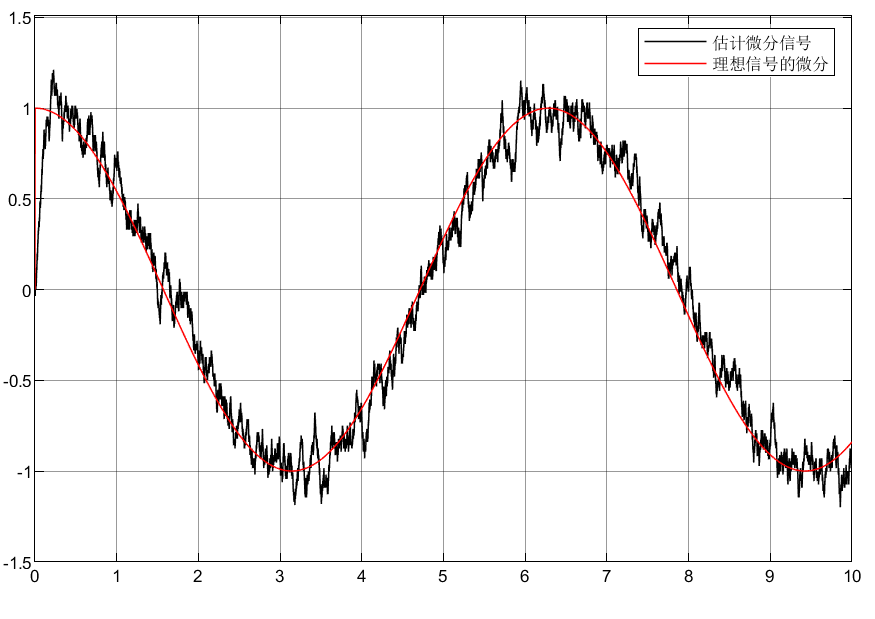

- 反向传播:利用自动微分机制,自动求模型参数(parameters)对于loss的梯度(gradients)。

- 参数优化:将梯度更新到参数上。

# 定义正向计算函数

def forward_fn(data, label):

logits = model(data)

loss = loss_fn(logits, label)

return loss, logits

#通过mindspore中的函数变换获取梯度计算函数

grad_fn = mindspore.value_and_grad(forward_fn, None, optimizer.parameters, has_aux=True)

# 定义训练函数

def train_step(data, label):

(loss, _), grads = grad_fn(data, label)

optimizer(grads)

return loss

def train(model, dataset):

size = dataset.get_dataset_size()

model.set_train()

for batch, (data, label) in enumerate(dataset.create_tuple_iterator()):

loss = train_step(data, label)

if batch % 100 == 0:

loss, current = loss.asnumpy(), batch

print(f"loss: {loss:>7f} [{current:>3d}/{size:>3d}]")

定义测试函数,评估模型性能。

def test(model, dataset, loss_fn):

num_batches = dataset.get_dataset_size()

model.set_train(False)

total, test_loss, correct = 0, 0, 0

for data, label in dataset.create_tuple_iterator():

pred = model(data)

total += len(data)

test_loss += loss_fn(pred, label).asnumpy()

correct += (pred.argmax(1) == label).asnumpy().sum()

test_loss /= num_batches

correct /= total

print(f"Test: \n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \n")

训练过程需多次迭代数据集,一次完整的迭代称为一轮(epoch)。在每一轮,遍历训练集进行训练,结束后使用测试集进行预测。打印每一轮的loss值和预测准确率(Accuracy),可以看出,

loss不断下降,准确度不断提高。

epochs = 3

for t in range(epochs):

print(f"Epoch {t+1}\n-------------------------------")

train(model, train_dataset)

test(model, test_dataset, loss_fn)

print("Done!")

保存模型

模型训练完成后,将参数进行保存。

# Save checkpoint

mindspore.save_checkpoint(model, "model.ckpt")

print("Saved Model to model.ckpt")

加载模型

加载模型包括两步,具体如下。

# 实例化模型对象,构造模型。

model = Network()

# 加载模型参数,并将其加载至模型上。

param_dict = mindspore.load_checkpoint("model.ckpt")

param_not_load = mindspore.load_param_into_net(model, param_dict)

#param_not_load是未被加载的参数列表,为空时代表所有参数均加载成功。

print(param_not_load)#[]

模型推理

加载后的模型即可直接用于预测推理。

model.set_train(False)

for data, label in test_dataset:

pred = model(data)

predicted = pred.argmax(1)

print(f'Predicted: "{predicted[:10]}", Actual: "{label[:10]}"')

break